"金融数据分析:人工智能与数据挖掘技术的应用"

版权申诉

147 浏览量

更新于2024-02-25

收藏 1.7MB PDF 举报

人工智能和数据挖掘技术正日益成为金融数据采集和分析的重要工具。本研究通过对《人工智能-数据挖掘-基于数据挖掘算法的金融数据采集与分析研究.pdf》的分析,探讨了人工智能和数据挖掘在金融领域的应用。股票市场作为金融市场的重要组成部分,对于经济起着重要作用,有效的股票预测在金融投资领域占据着重要地位。然而,要分析股票市场,需要及时获取与股票市场相关的数据。随着经济的不断发展,股票数据规模越来越庞大,无法单靠人工获取。因此,利用人工智能和数据挖掘技术来进行金融数据采集和分析具有重要意义。

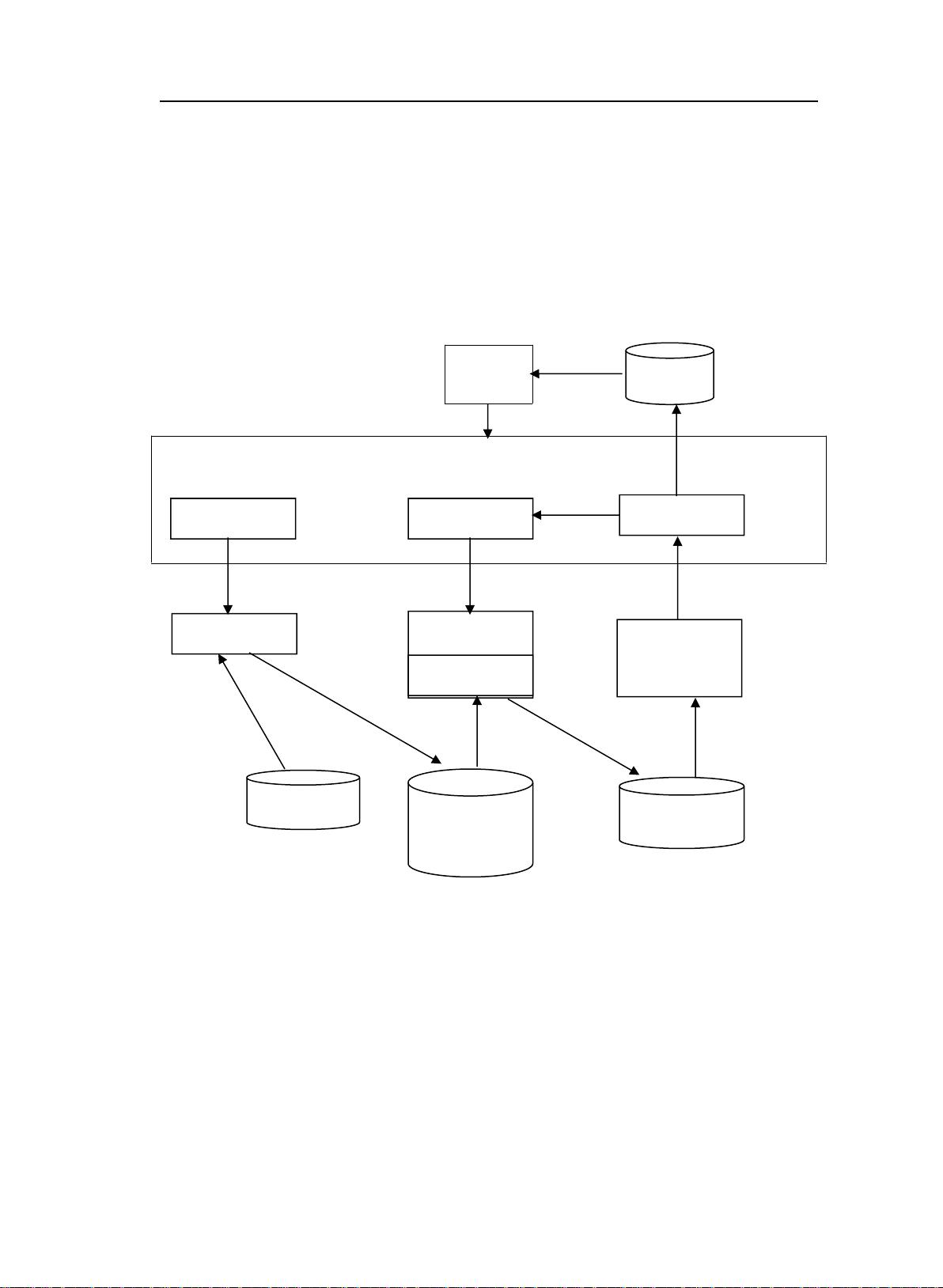

本研究首先分析了金融数据采集的重要性以及传统的金融数据采集方式存在的问题,主要包括数据规模大、数据来源多样、数据类型复杂等问题,同时也分析了人工智能和数据挖掘技术在金融数据采集中的优势,如高效处理大规模数据、自动化数据获取和多源数据整合等特点。接着,本研究探讨了基于数据挖掘算法的金融数据分析方法,包括基于机器学习的数据挖掘技术在股票市场分析中的应用以及数据挖掘算法在股票预测中的实际应用案例。通过对比传统的股票市场分析方法和基于数据挖掘算法的分析方法,可以发现基于数据挖掘算法的分析方法在预测准确性和实时性上具有明显的优势。

除了对金融数据采集和分析方法的探讨,本研究还分析了人工智能和数据挖掘在金融领域的发展趋势和应用前景。随着数据挖掘技术的不断进步和金融行业对于智能化的需求,人工智能和数据挖掘在金融领域的应用前景广阔。例如,人工智能可以用于金融风险管理、股票市场监控、智能投顾等方面,提高金融机构的效率和盈利能力。同时,数据挖掘技术也可以用于发现金融市场中的规律和趋势,为投资者提供更加准确的决策依据。

综上所述,人工智能和数据挖掘技术对于金融数据采集和分析具有重要意义,并且具有广阔的应用前景。随着技术的不断进步和金融行业的发展,人工智能和数据挖掘技术将在金融领域发挥越来越大的作用,为金融行业的发展带来新的机遇和挑战。希望本研究可以对相关领域的研究工作提供一定的借鉴和参考,推动人工智能和数据挖掘技术在金融领域的应用和发展。

2022-06-29 上传

2022-06-29 上传

2022-06-29 上传

2022-07-02 上传

2021-07-14 上传

2021-07-14 上传

programyp

- 粉丝: 90

- 资源: 9323

最新资源

- C语言数组操作:高度检查器编程实践

- 基于Swift开发的嘉定单车LBS iOS应用项目解析

- 钗头凤声乐表演的二度创作分析报告

- 分布式数据库特训营全套教程资料

- JavaScript开发者Robert Bindar的博客平台

- MATLAB投影寻踪代码教程及文件解压缩指南

- HTML5拖放实现的RPSLS游戏教程

- HT://Dig引擎接口,Ampoliros开源模块应用

- 全面探测服务器性能与PHP环境的iprober PHP探针v0.024

- 新版提醒应用v2:基于MongoDB的数据存储

- 《我的世界》东方大陆1.12.2材质包深度体验

- Hypercore Promisifier: JavaScript中的回调转换为Promise包装器

- 探索开源项目Artifice:Slyme脚本与技巧游戏

- Matlab机器人学习代码解析与笔记分享

- 查尔默斯大学计算物理作业HP2解析

- GitHub问题管理新工具:GIRA-crx插件介绍