特斯拉自动驾驶系统安全研究:远程操控与攻击漏洞剖析

需积分: 10 153 浏览量

更新于2024-07-15

1

收藏 3.03MB PDF 举报

本研究论文《Experimental Security Research of Tesla Autopilot》由腾讯科恩安全实验室(Keen Security Lab)进行,针对特斯拉车辆的自动驾驶系统(Autopilot)进行深入的安全研究,并连续在2017年和2018年的Black Hat USA大会上分享了相关成果。研究的重点集中在特斯拉自动驾驶电子控制单元(APE,软件版本18.6.1)的底层权限上。

论文首先介绍了背景,探讨了自动驾驶技术的快速发展及其潜在安全挑战。研究团队利用了APE的根级权限,对汽车控制器局域网(CAN Bus System)进行深入分析,特别是AEP2LB_CAN模块,这一部分涉及到了车辆通信协议的关键部分,通过CAN消息实现对车辆控制系统的远程操控。

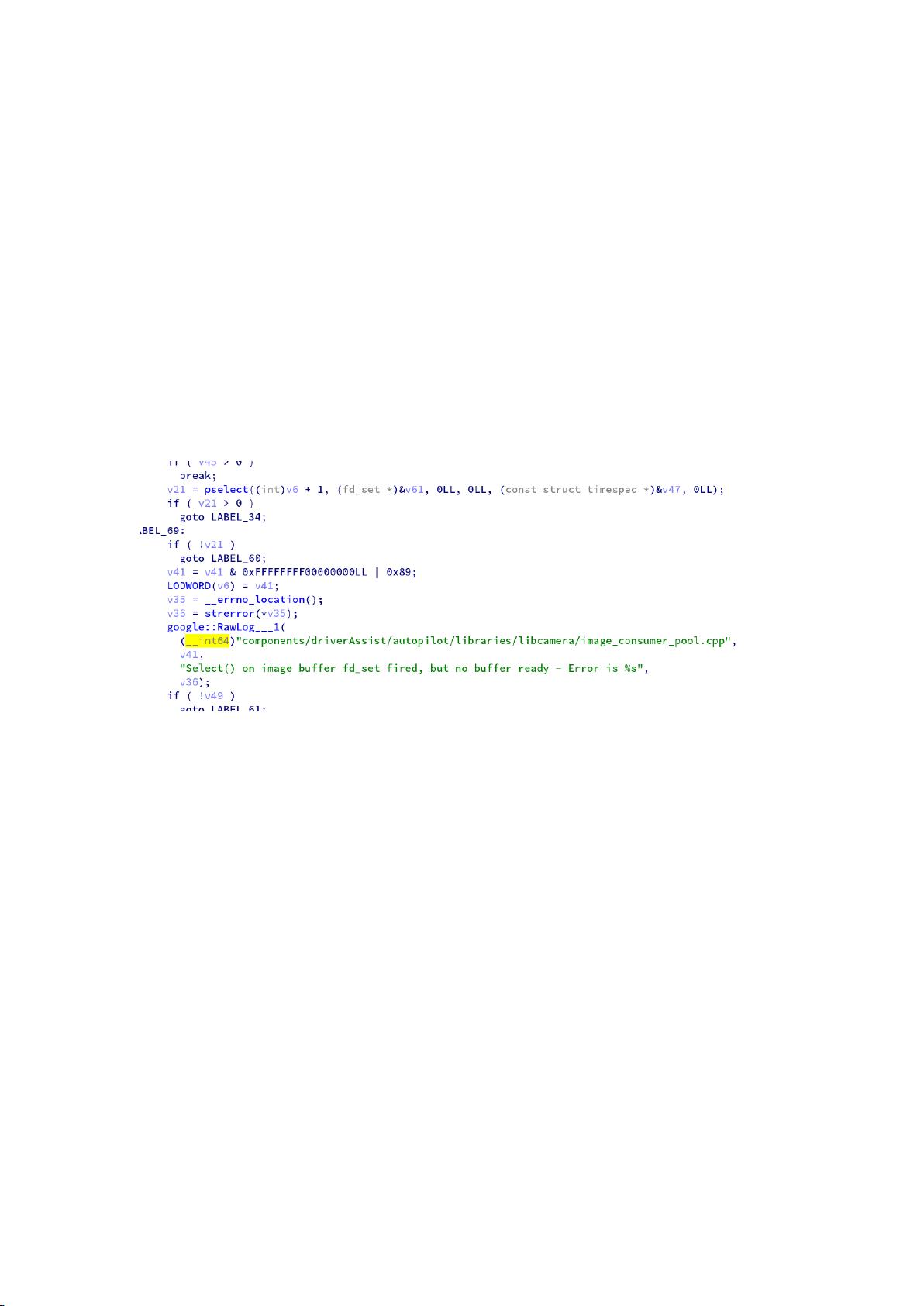

在实验中,研究人员成功实现了无接触式远程控制转向系统,这是通过分析并利用CAN消息中的控制信息来实现的。他们优化了一种算法,生成对抗性示例(digital adversarial examples),针对那些完全依赖于摄像头数据做出决策的功能,如雨刮器和车道识别。通过这些优化后的攻击,他们在物理世界中成功地实施了对抗性示例攻击,这显示了潜在的安全漏洞。

对于车道检测功能,研究者发现了当车辆处于自动驾驶模式(Autosteer mode)时可能存在的一种高风险设计弱点。他们详细描述了车道检测器的实现细节,包括如何伪造或消除车道信息,以达到欺骗自动驾驶系统的目的。这种攻击可能对行车安全构成严重威胁。

论文结论部分总结了研究发现的重要性和对未来安全措施的建议,强调了在自动驾驶系统中确保安全性和鲁棒性的紧迫性。最后,引用了相关的研究文献,并在附录中提供了进一步的技术细节和实验步骤。

这篇论文揭示了特斯拉Autopilot系统中的关键安全漏洞,并展示了黑客可能利用这些漏洞进行恶意操控的可能性。这对于汽车行业和自动驾驶技术的发展具有重要的警示作用,也提出了加强安全防护和改进设计的迫切需求。

2024-09-08 上传

2023-01-09 上传

AttributeError: module 'tensorflow_core._api.v2.config' has no attribute 'experimental_list_devices'

2023-03-28 上传

2023-05-11 上传

2023-07-11 上传

2023-07-11 上传

2023-05-24 上传

2023-07-14 上传

2023-07-10 上传

2023-06-07 上传

有病没病都吃药

- 粉丝: 1

- 资源: 5

最新资源

- JDK 17 Linux版本压缩包解压与安装指南

- C++/Qt飞行模拟器教员控制台系统源码发布

- TensorFlow深度学习实践:CNN在MNIST数据集上的应用

- 鸿蒙驱动HCIA资料整理-培训教材与开发者指南

- 凯撒Java版SaaS OA协同办公软件v2.0特性解析

- AutoCAD二次开发中文指南下载 - C#编程深入解析

- C语言冒泡排序算法实现详解

- Pointofix截屏:轻松实现高效截图体验

- Matlab实现SVM数据分类与预测教程

- 基于JSP+SQL的网站流量统计管理系统设计与实现

- C语言实现删除字符中重复项的方法与技巧

- e-sqlcipher.dll动态链接库的作用与应用

- 浙江工业大学自考网站开发与继续教育官网模板设计

- STM32 103C8T6 OLED 显示程序实现指南

- 高效压缩技术:删除重复字符压缩包

- JSP+SQL智能交通管理系统:违章处理与交通效率提升