斯坦福大学机器学习课程笔记:从线性回归到归一化

需积分: 48 183 浏览量

更新于2024-07-20

收藏 3.99MB PDF 举报

"这是一份详细的斯坦福大学机器学习公开课笔记,由Prof. Andrew Ng教授讲解,由Ryan Cheung整理并提供。这份笔记涵盖了机器学习的基础概念,包括监督学习、非监督学习,以及从单变量到多变量的线性回归,多项式回归,逻辑回归和归一化等主题。"

在机器学习领域,本资源首先介绍了机器学习的基本概念。机器学习是人工智能的一个分支,其目标是使计算机系统能够从数据中学习和改进,而无需明确编程。课程中提到了两种主要的学习方式:监督学习和非监督学习。监督学习是指通过已知的输入-输出对来训练模型,使得模型能够预测未知数据的输出。例如,给定一组房价和它们对应的面积,模型可以学习到房价与面积之间的关系,从而预测新房子的价格。非监督学习则是在没有标签的数据集上进行,如聚类分析,目标是发现数据内部的结构和模式。

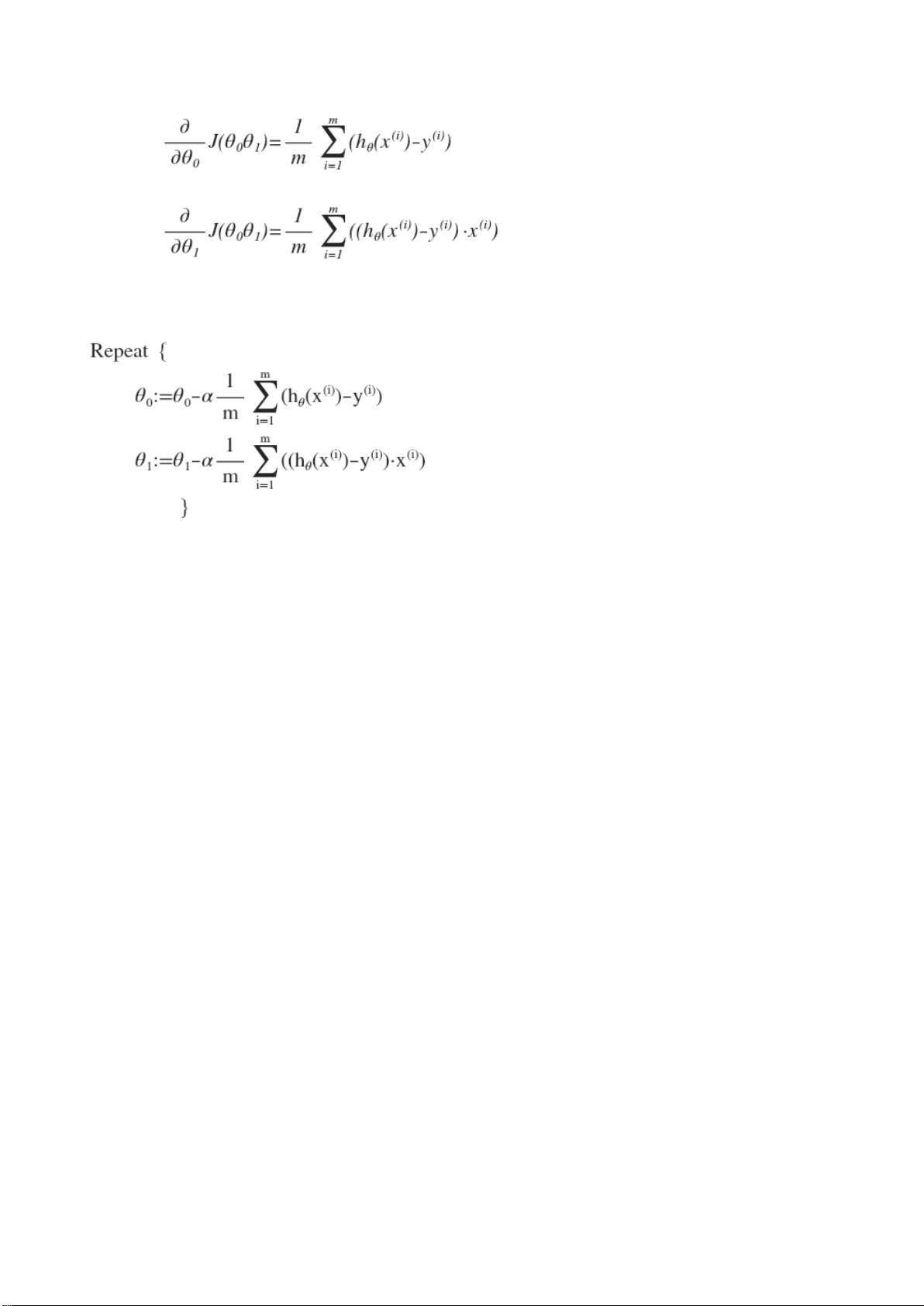

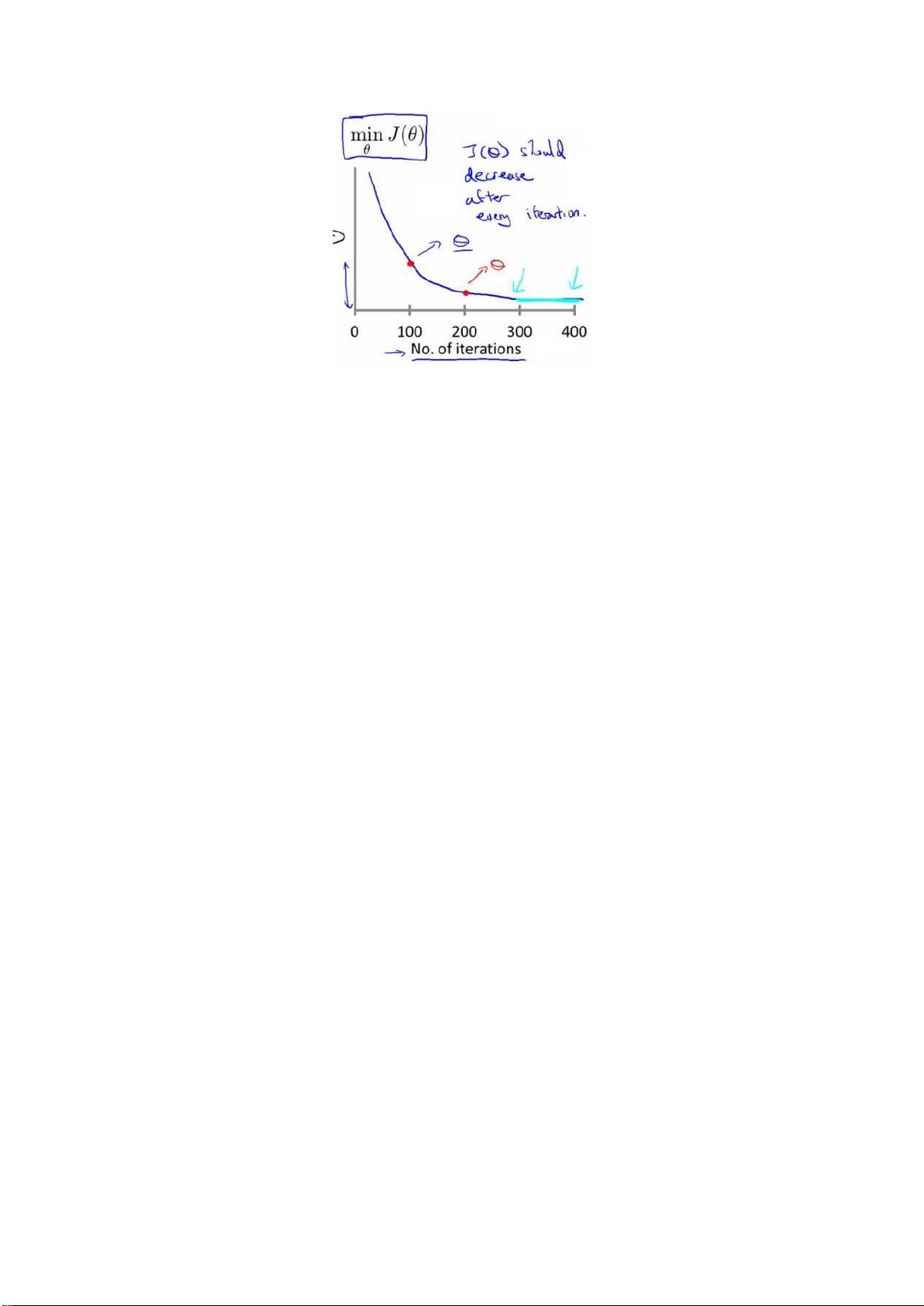

接下来,笔记详细阐述了单变量线性回归,这是最简单的回归模型。模型通过一条直线(在二维空间中)或超平面(在高维空间中)来近似数据点,以最小化预测值与实际值之间的误差。代价函数是衡量模型拟合程度的指标,而梯度下降法是一种优化算法,用于找到最小化代价函数的参数值。

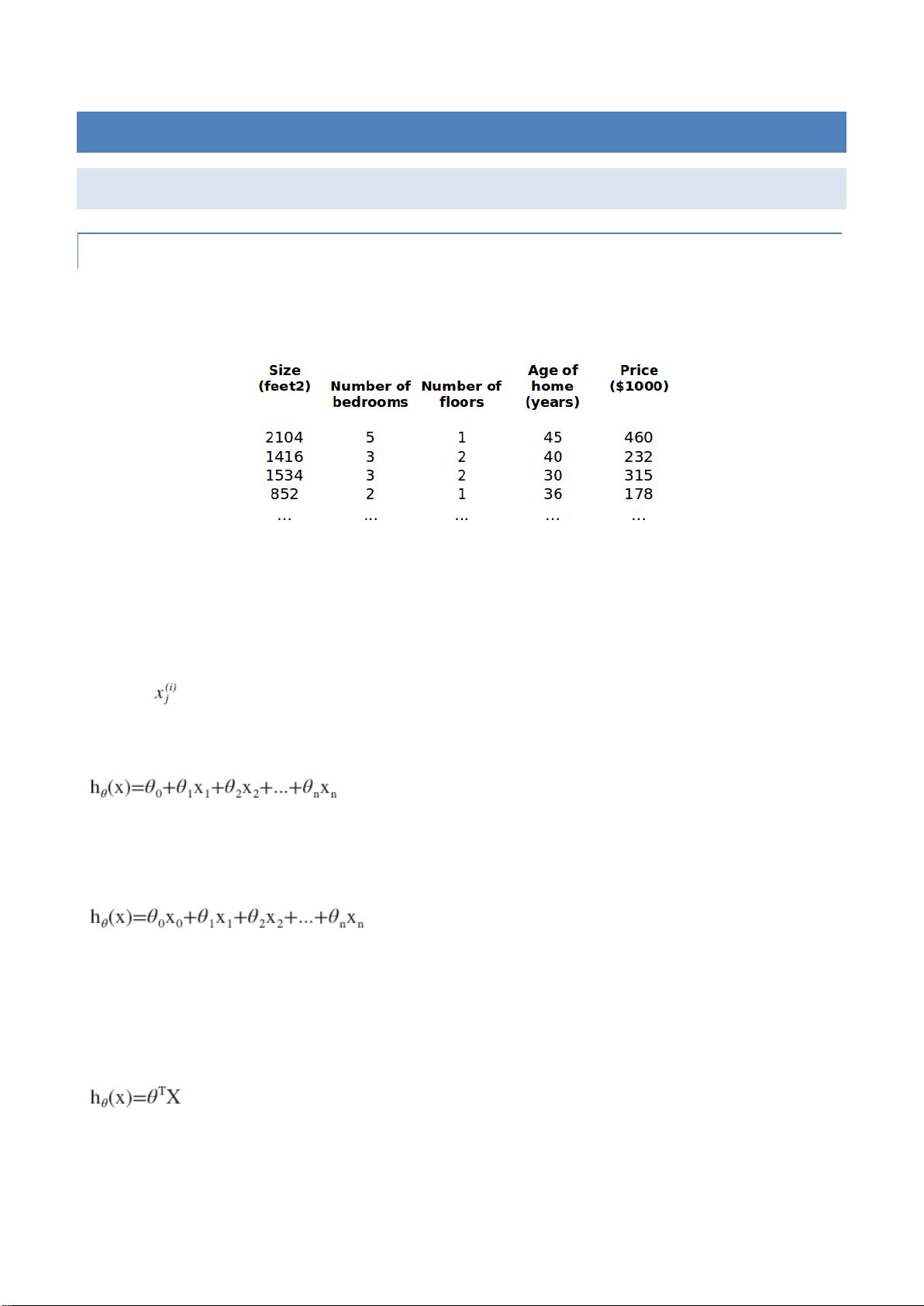

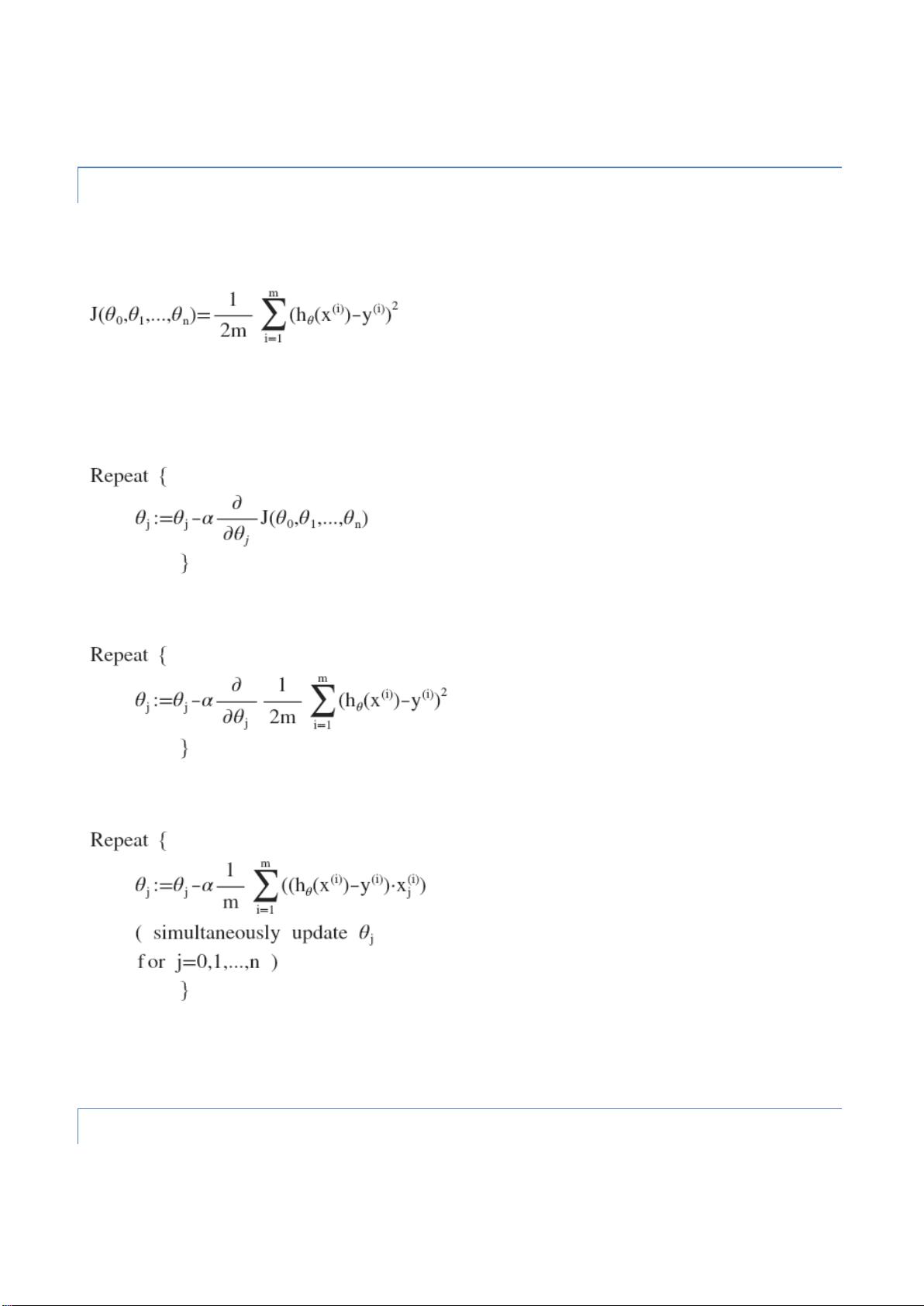

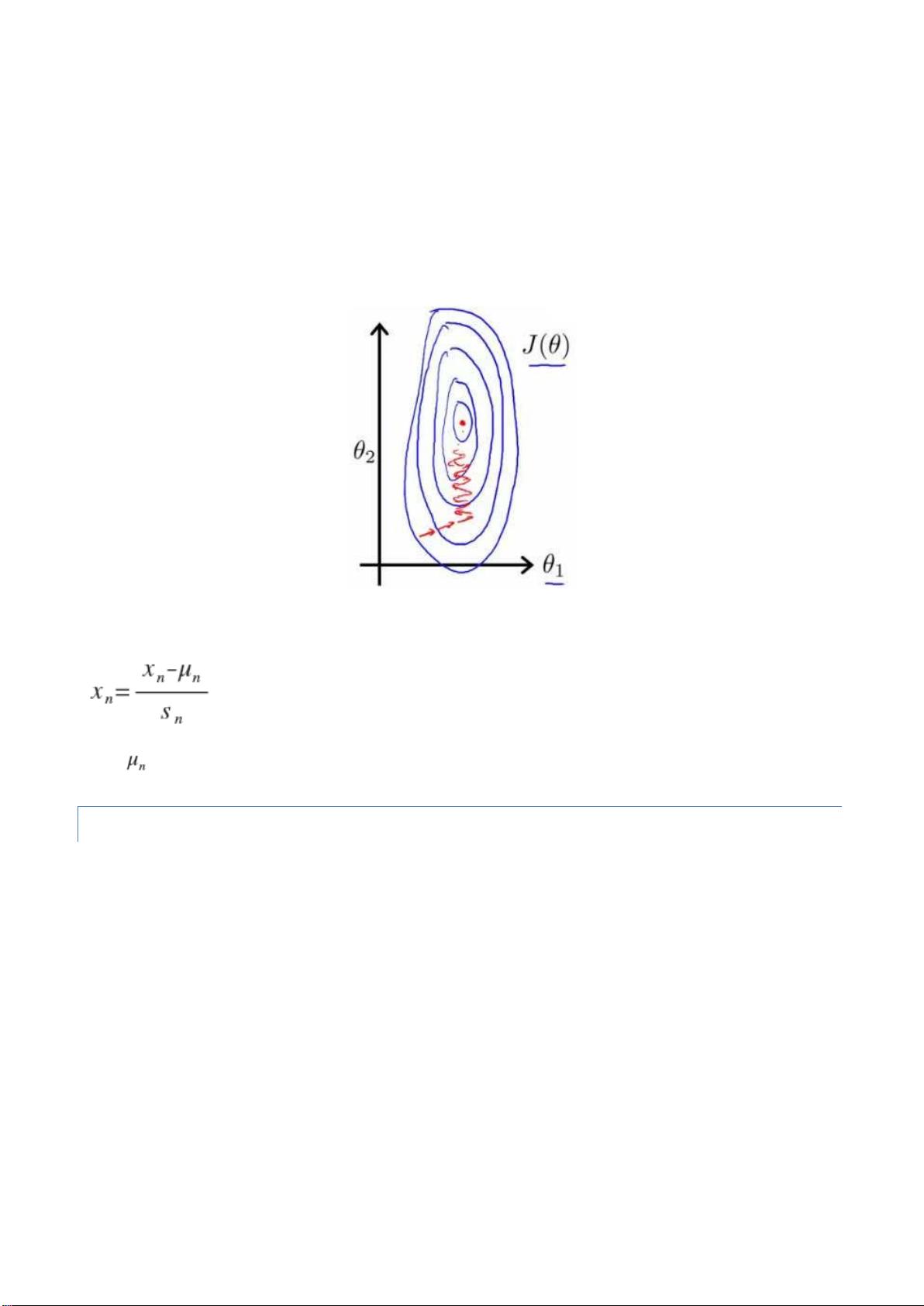

随后,笔记扩展到了多变量线性回归,增加了更多特征以提高预测准确性。这里涉及到特征缩放,即确保所有特征都在同一数量级上,避免某个特征对模型的影响过大。同时,学习率的选择也很关键,它决定了在每次迭代中参数更新的幅度。

课程进一步讨论了多项式回归,通过引入高次项来处理非线性关系。正规方程提供了另一种求解线性回归问题的方法,它直接计算出最小化代价函数的参数,无需迭代。

逻辑回归被介绍为解决分类问题的工具,特别是在二分类问题中。它通过Sigmoid函数将连续的预测值转换为0和1的概率。此外,课程还涵盖了多类分类和判定边界的概念,帮助理解如何用逻辑回归处理复杂分类任务。

最后,笔记深入到归一化,这是一个防止过拟合的重要技术。过拟合指的是模型过度适应训练数据,导致在未见过的数据上表现不佳。通过添加正则化项到代价函数,可以约束模型的复杂度,防止过拟合的发生。归一化线性回归是应用这一思想的具体实例。

这份资源全面介绍了机器学习的基础理论和实践,适合初学者作为入门材料。

344 浏览量

2015-04-01 上传

2024-10-26 上传

255 浏览量

193 浏览量

2024-11-01 上传

188 浏览量

511 浏览量