"第8章:注意力机制与外部记忆1-机器阅读理解任务挑战与解决"

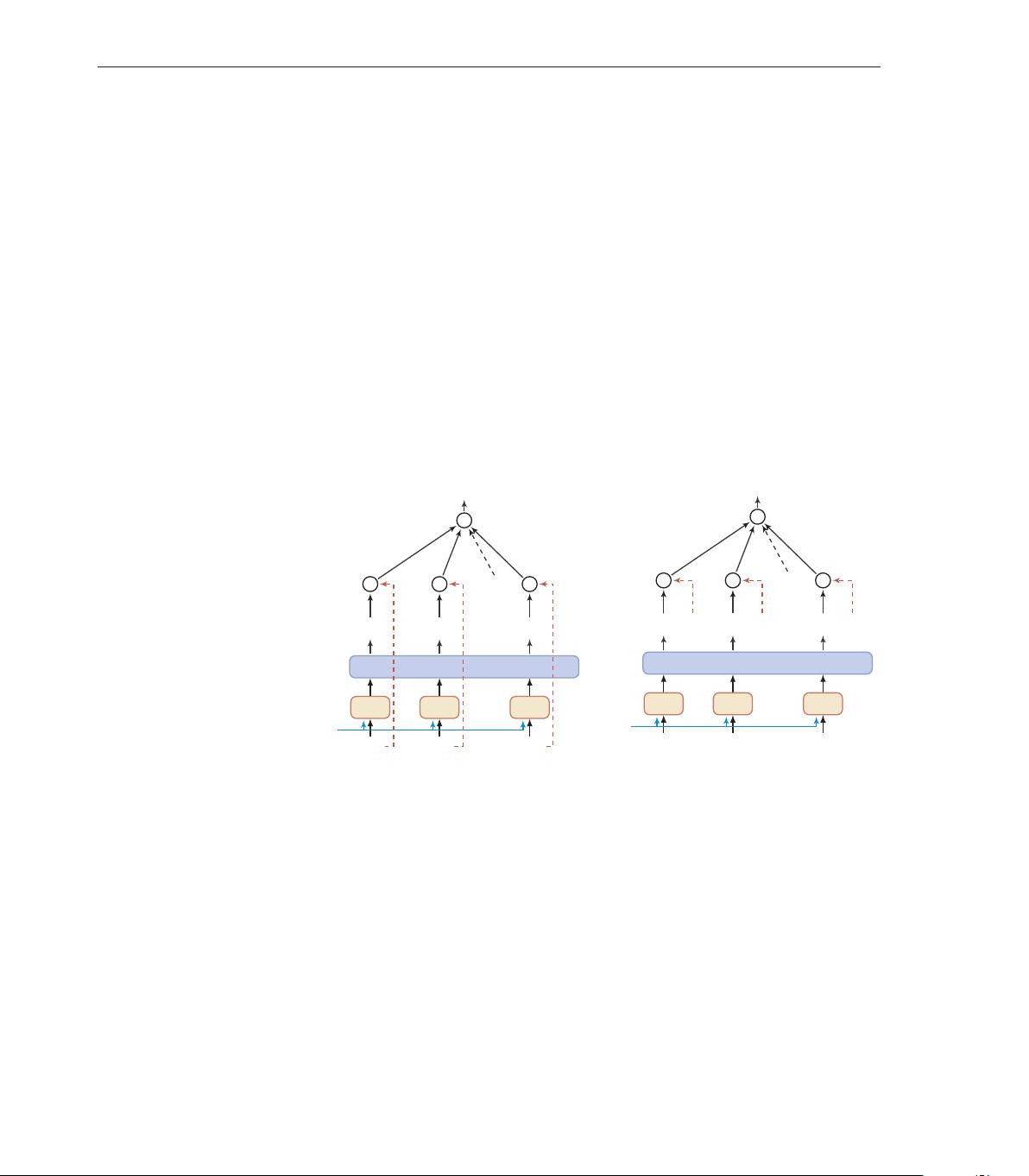

第8章注意力机制与外部记忆讨论了神经网络在处理复杂任务时所面临的挑战以及通过引入局部连接、权重共享和汇聚操作来简化网络结构的方法。在阅读理解任务中,机器需要阅读一篇背景文章并回答相关问题来测试其理解能力。然而,使用循环神经网络将背景文章转换为向量表示时,很难完整反映出文章的所有语义信息。在简单的文本分类任务中,使用一个向量来表示文本语义是可行的,但在阅读理解任务中,这种方法并不适用。因此,本章着重讨论了注意力机制和外部记忆在提高模型表达能力的作用。通过注意力机制,模型可以更好地关注文章中与问题相关的信息,而外部记忆则允许模型动态存储和检索大量的信息,从而提高了理解能力。 根据通用近似定理,前馈网络和循环网络都有很强的能力,但在实际应用中存在着优化算法和计算能力的限制。特别是在处理复杂任务时,如处理大量输入信息或复杂计算流程时,计算机的计算能力仍然是限制神经网络发展的瓶颈。为了解决这一挑战,本章提出了注意力机制和外部记忆的概念。 注意力机制允许模型在处理输入时动态地关注一些重要的部分,并且将注意力集中在与当前任务相关的信息上。与传统的固定权重连接相比,注意力机制可以使模型在不同时间步或不同任务中分配不同的注意力权重,从而更有效地处理复杂任务。 另一方面,外部记忆则扩展了模型的存储容量和处理能力。通过外部记忆,模型可以动态存储大量的信息,并根据需要检索这些信息。这种能力使得模型能够更好地处理长文本或大规模的数据,尤其在阅读理解任务中表现突出。 综合考虑,注意力机制和外部记忆为神经网络带来了新的发展方向,使得模型在处理复杂任务时表现得更加出色。在阅读理解等涉及长文本和大量信息处理的任务中,注意力机制和外部记忆的引入极大地提高了模型的表达能力,使其能够更好地理解和处理文本信息。通过对注意力机制和外部记忆的深入理解,可以为神经网络的发展提供新的思路和方法,促进其在自然语言处理领域的应用和推广。 然后我们要询问一些相关的问题来测试机器是否理解了这篇文章。阅读理解任务中,问句可能会涉及到文章中的不同部分,而注意力机制和外部记忆能够帮助模型更好地从文章中找到答案。通过对这些问题的回答,我们可以进一步评估机器的理解能力和对文章内容的把握程度,从而深入了解模型在自然语言理解任务中的表现和潜力。 在机器理解的实践中,需要不断优化模型的注意力和外部记忆能力,使其能够更好地处理复杂语境和大规模信息。除此之外,还需要更深入地研究注意力机制和外部记忆的结合方式,探索其在不同任务和场景下的适用性和效果,从而进一步提升机器在自然语言理解任务中的表现。只有不断地完善和优化模型,才能更好地应用和推广机器在自然语言理解领域的技术,为人工智能的发展提供更大的助力。

剩余21页未读,继续阅读

信息提交成功

信息提交成功