Kafka是一个强大的分布式消息传递平台,专为大规模、高吞吐量的应用场景设计。本文档将对Kafka的基本概念、配置、系统架构以及实际操作进行简要介绍。

**1. Kafka简介**

Kafka最初由LinkedIn公司开发,后归入Apache项目,其核心特点是高吞吐量、持久化、分布式和可扩展性。Kafka支持每秒生产高达25万条消息(50MB)和处理55万条消息(110MB),这使其非常适合实时数据流处理和批量数据分析。它的消息持久化特性使得数据在发生故障时仍能保持安全,通过将数据复制到多个副本(replication)来防止数据丢失。

**2. Kafka中的关键角色与术语**

- **Producer**: 发布消息的进程,负责将数据发送到Kafka集群。

- **Consumer**: 订阅消息的进程,接收并处理从Kafka中发布的数据。

- **Broker**: Kafka集群中的一个服务实例,负责存储分区(Partition)中的消息,并将消息转发给消费者。

- **Topic**: 消息分类的容器,类似数据库表,不同的主题可以有不同的分区。

- **Partition**: 一个Topic下的逻辑分片,每个分区独立处理消息,增加了系统的并发性和容错性。

**3. Kafka系统架构**

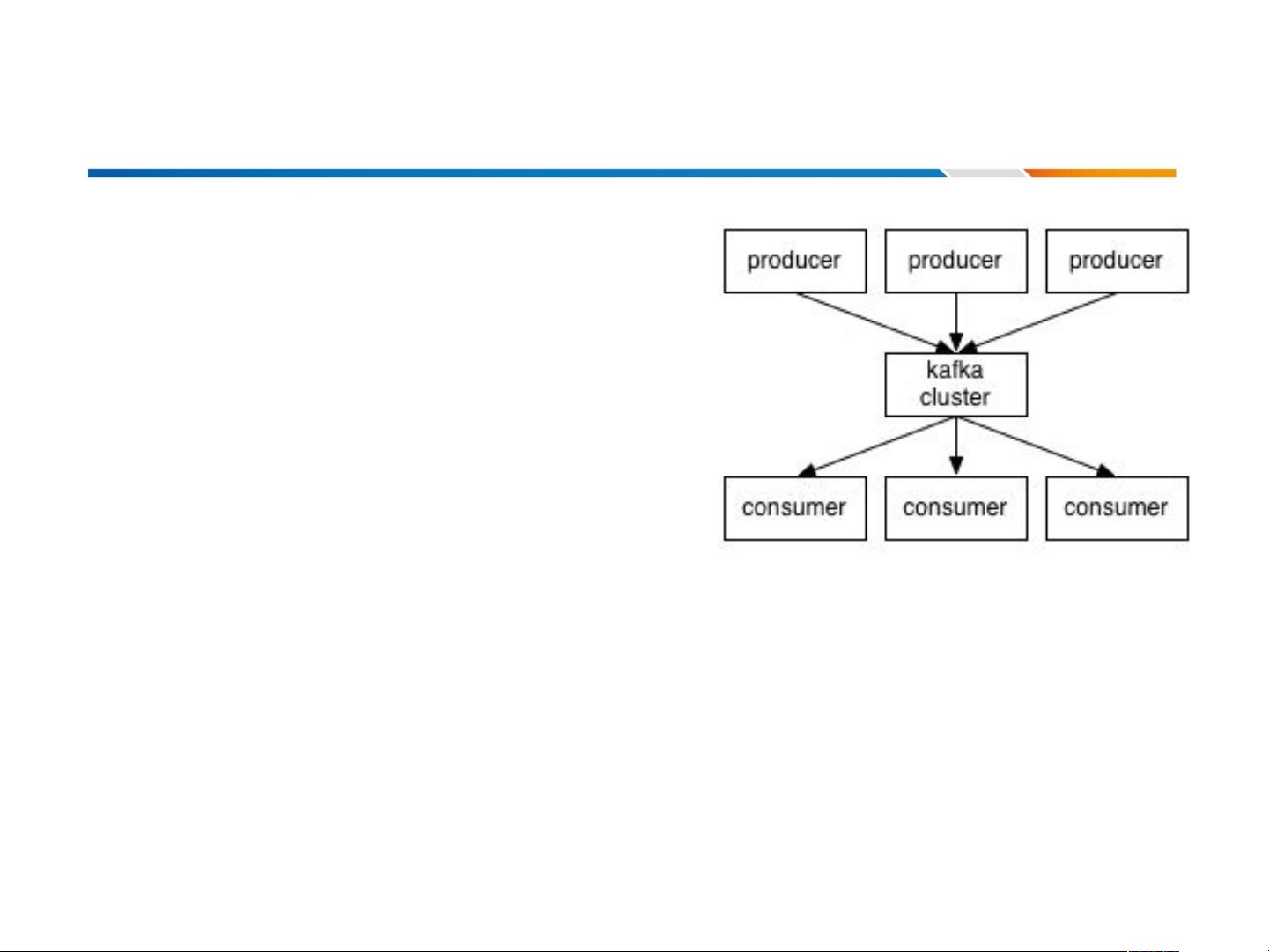

Kafka采用显式的分布式架构,意味着Producer、Broker和Consumer可以有多个实例,以支持水平扩展。它在设计上扮演了数据缓存的角色,连接活跃的数据生产者和需要离线处理的数据消费者。

**4. Kafka单服务演示**

- **启动Zookeeper**: Kafka依赖于Zookeeper进行服务发现和协调,先启动Zookeeper服务器。

- **启动Broker**: 接着启动Kafka Broker,配置文件通常包含server.properties。

- **发布消息**: 使用命令行工具`kafka-console-producer.sh`,指定本地Broker地址,向指定的Topic发送消息。

通过这些步骤,用户可以初步了解如何设置和操作一个简单的Kafka环境,包括启动服务、创建消息流和消费数据。深入使用Kafka时,还需要关注更高级的配置选项,如消息的TTL、消费者组管理、错误处理机制等。同时,Kafka与其他技术(如S3)的集成也是提高整体数据处理效率的关键,尽管本篇内容没有涉及S3,但理解Kafka的灵活性和可扩展性有助于更好地结合不同组件构建复杂的数据处理解决方案。