斯坦福2014机器学习教程笔记:从线性回归到神经网络

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

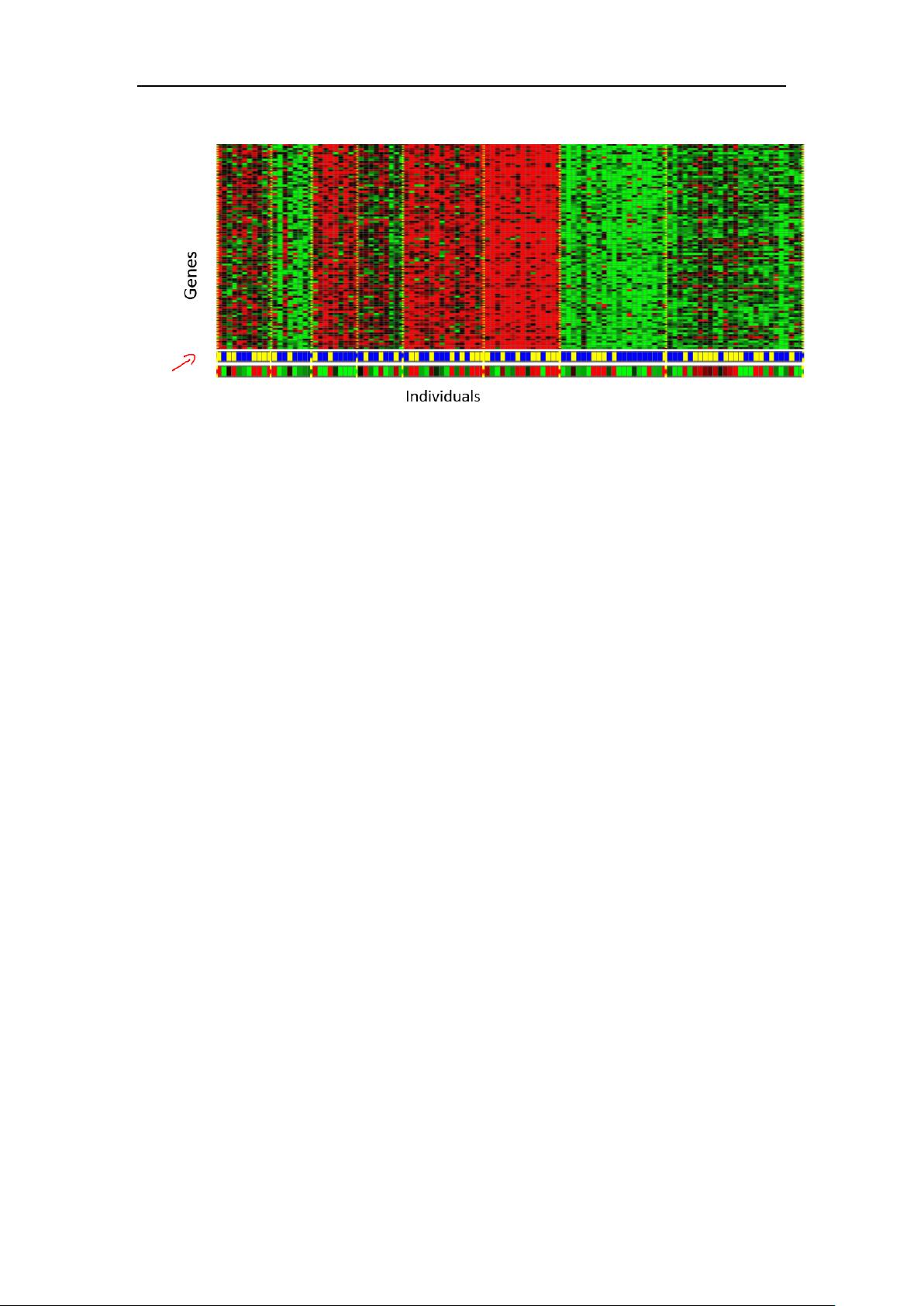

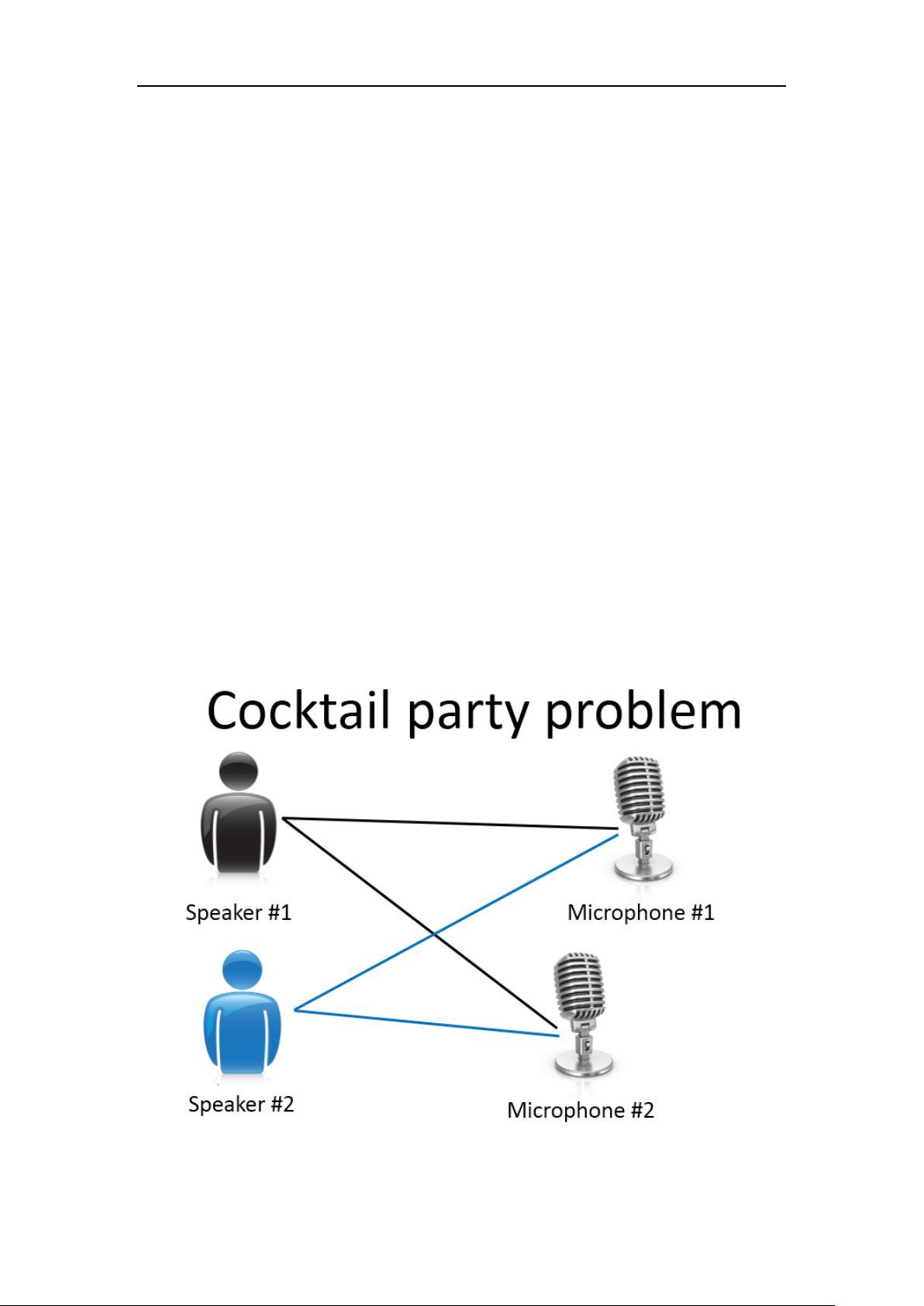

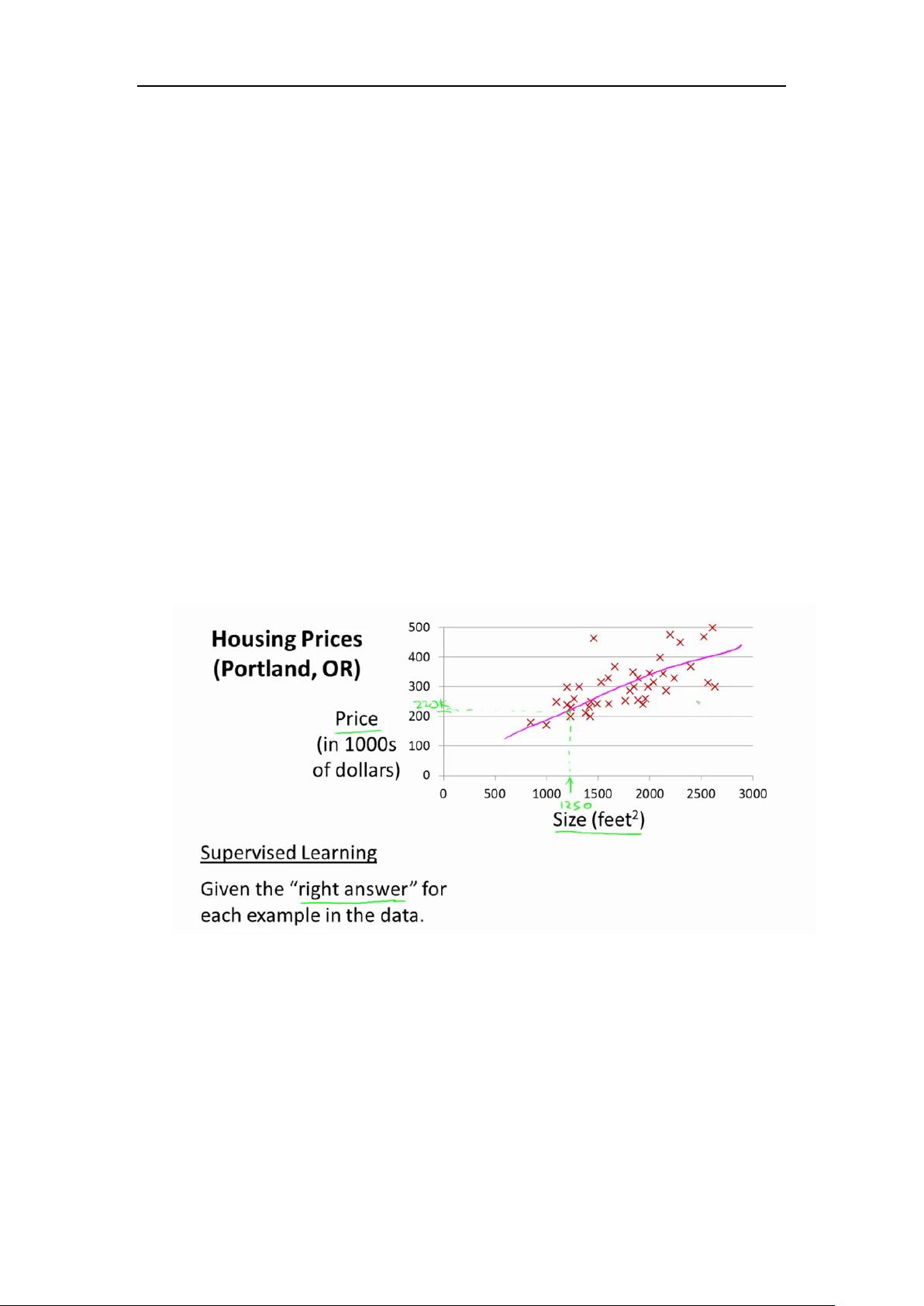

"这是关于斯坦福大学2014年机器学习课程的个人学习笔记,涵盖了从基础的机器学习概念到深入的技术,如线性回归、线性代数回顾、逻辑回归和正则化,以及神经网络的介绍。笔记详细讲解了每个主题,包括模型表示、代价函数、梯度下降等,并提供了Octave编程练习的指导。" 在这些笔记中,我们首先接触到的是机器学习的引言,它向学习者介绍了机器学习的基本概念和分类。引言部分包括对机器学习的欢迎介绍,以及对监督学习和无监督学习的定义和应用的简要概述。监督学习是通过已知的输入-输出对来训练模型,而无监督学习则是在没有标签的数据上进行,旨在发现数据中的模式或结构。 接下来,笔记详细介绍了单变量线性回归,这是机器学习中最基础的预测模型之一。这部分涵盖了模型表示、代价函数及其直观理解,以及梯度下降算法的运用,这是优化模型参数的关键方法。通过梯度下降,我们可以找到最小化代价函数的最优解。 线性代数回顾部分对于理解和应用后续的多变量线性回归至关重要。笔记详细讲解了矩阵和向量的基础知识,包括它们的加法、标量乘法、矩阵向量乘法、矩阵乘法及其性质,以及矩阵的逆和转置。 第二周的内容涉及多变量线性回归,这是单变量线性回归的扩展,适用于处理多个特征。笔记讨论了如何处理多维特征,多变量梯度下降的实现,以及在实际应用中如何进行特征缩放和调整学习率。此外,还介绍了特征工程的一种技术——多项式回归,以及通过正规方程求解线性回归模型的方法。 Octave教程部分为学习者提供了使用这个数值计算环境的实践经验,包括基本操作、数据移动、计算、绘图以及控制语句和向量化编程。 第三周,笔记转向逻辑回归,这是解决分类问题的常用方法。这部分详细解释了分类问题、逻辑回归的假说表示、判定边界、代价函数的构建以及优化技术。同时,还介绍了多类别分类的一对多策略。 正则化章节讨论了过拟合问题,这是一种常见的机器学习挑战,其中模型过于复杂,导致在新数据上的表现不佳。笔记中阐述了正则化如何通过增加惩罚项来防止过拟合,并展示了如何在线性回归和逻辑回归中应用正则化。 最后,笔记开始介绍神经网络,特别是其在表示学习中的作用。这部分探讨了非线性假设的重要性,神经元的生物学灵感,以及神经网络模型的两种表示方式。此外,还讨论了特征和神经网络的直观理解。 这份笔记为学习者提供了一个全面的机器学习入门路径,涵盖了从基础理论到实用技巧的广泛内容,是深入理解并掌握机器学习技术的良好资源。

剩余265页未读,继续阅读

信息提交成功

信息提交成功