矩阵视角下的谱聚类

需积分: 9 175 浏览量

更新于2024-08-01

收藏 928KB PDF 举报

"这篇文档是ICML2005年教程的一部分,由Chris Ding讲解了PCA(主成分分析)和矩阵分解在学习中的应用,特别是关于谱聚类的深入理解。文档介绍了如何从矩阵的角度来看待谱聚类,并且提到了PCA到谱聚类的转换,以及通用特征向量的概念。此外,还涉及到了无符号的聚类指标矩阵和二次聚类框架,以及Kernel K-means聚类与归一化剪切的谱聚类方法。"

在机器学习和数据挖掘领域,谱聚类是一种强大的非监督学习技术,用于发现数据集中的潜在结构和群组。该文档首先引入了PCA,这是一种降维技术,通过找到数据方差最大的方向来压缩高维数据。PCA的主要目标是保留原始数据的主要特征,同时减少数据的复杂性。

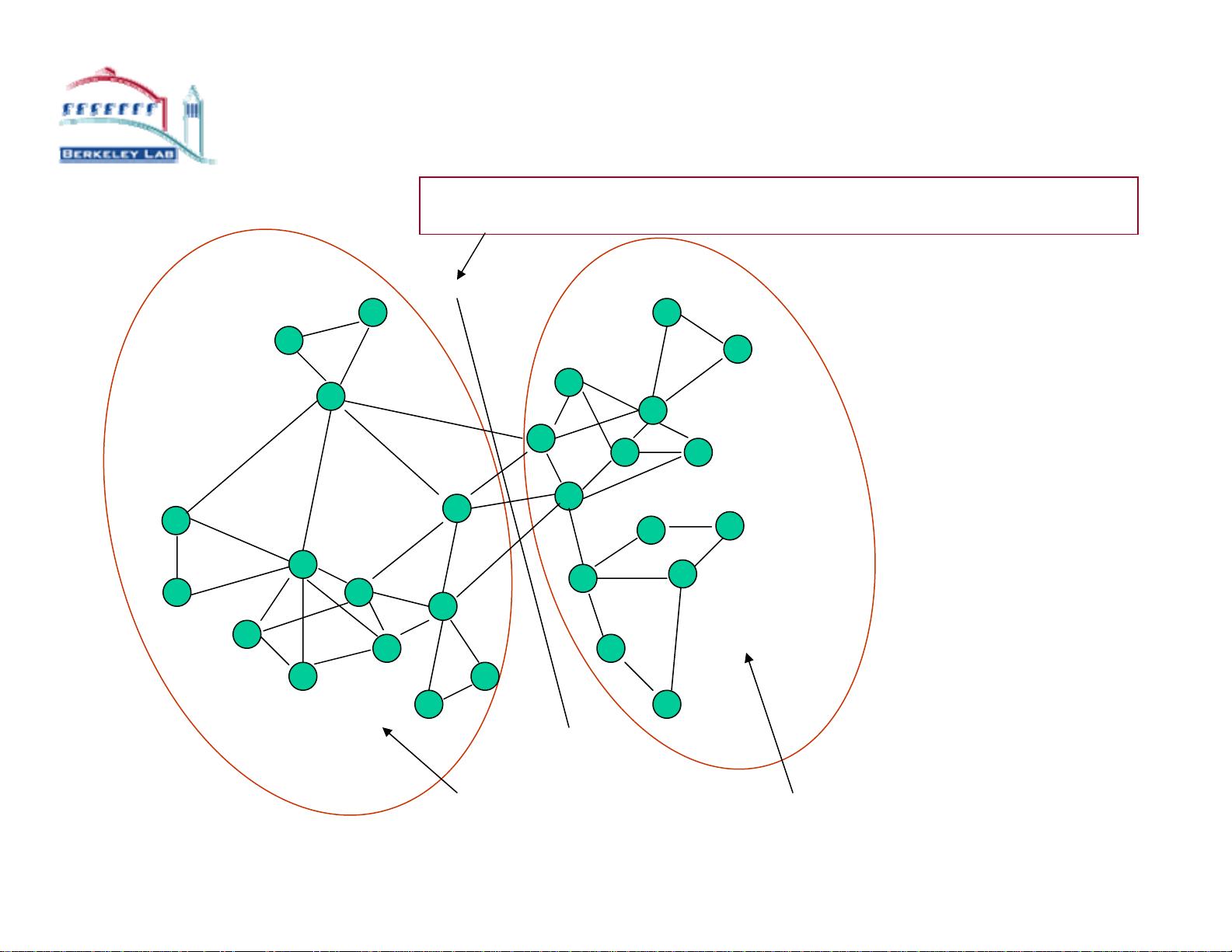

接着,文档讨论了如何从PCA过渡到谱聚类。在传统的PCA中,我们寻找数据协方差矩阵的特征向量,而在谱聚类中,我们处理的是相似性矩阵或权重矩阵W。通过计算权重矩阵的拉普拉斯矩阵L,我们可以找到数据点之间的“谱”,这些谱对应于数据的“频谱”表示。拉普拉斯矩阵L通常定义为D-W,其中D是对角矩阵,其对角线元素是每个节点的度(即其邻接节点的数量)。

文档中提到的通用特征向量的概念,是指在考虑核函数的场景下,数据点被映射到高维空间,使得在该空间中可以更容易地找到聚类结构。通过解决拉普拉斯矩阵的广义特征值问题,我们可以找到一组特征向量,这些向量在降维后可用于聚类。

接下来,文档介绍了一个无符号的聚类指标矩阵H,它是K个聚类的指示器矩阵,用于表示数据点属于哪个聚类。矩阵H的优化目标是最大化类内相似度和最小化类间相似度,这在Kernel K-means和归一化剪切的谱聚类中体现出来。Kernel K-means利用核函数将数据点映射到一个高维空间,以适应非线性可分的情况。

这个教程片段详细阐述了谱聚类的核心概念,包括矩阵观点下的谱聚类、PCA与谱聚类的联系、以及如何使用核方法和二次聚类框架来优化聚类过程。这些知识对于理解和实现谱聚类算法,尤其是在复杂数据集上的应用,是非常有价值的。

2021-09-29 上传

2018-01-30 上传

2022-07-14 上传

2021-10-04 上传

2021-06-01 上传

点击了解资源详情

2023-12-28 上传

2023-06-02 上传

2021-03-26 上传

njyyc

- 粉丝: 0

- 资源: 5

最新资源

- C语言数组操作:高度检查器编程实践

- 基于Swift开发的嘉定单车LBS iOS应用项目解析

- 钗头凤声乐表演的二度创作分析报告

- 分布式数据库特训营全套教程资料

- JavaScript开发者Robert Bindar的博客平台

- MATLAB投影寻踪代码教程及文件解压缩指南

- HTML5拖放实现的RPSLS游戏教程

- HT://Dig引擎接口,Ampoliros开源模块应用

- 全面探测服务器性能与PHP环境的iprober PHP探针v0.024

- 新版提醒应用v2:基于MongoDB的数据存储

- 《我的世界》东方大陆1.12.2材质包深度体验

- Hypercore Promisifier: JavaScript中的回调转换为Promise包装器

- 探索开源项目Artifice:Slyme脚本与技巧游戏

- Matlab机器人学习代码解析与笔记分享

- 查尔默斯大学计算物理作业HP2解析

- GitHub问题管理新工具:GIRA-crx插件介绍