Python3 Requests高级用法:文件上传与Cookies管理

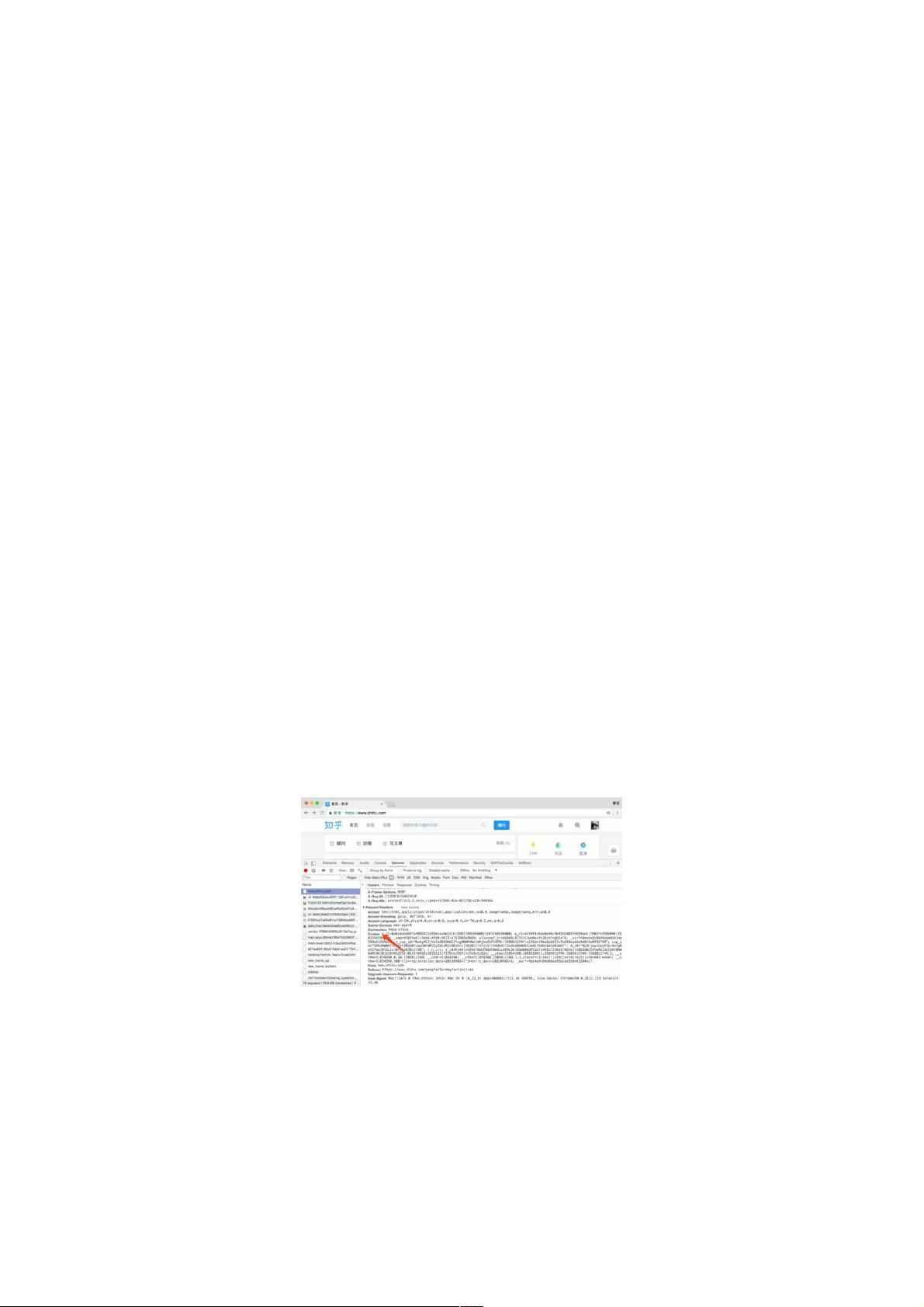

在Python3网络爬虫中,Requests库是一个强大的工具,用于发送HTTP请求并处理响应。本节将深入探讨Requests的一些高级特性,包括文件上传和Cookies的设置,以帮助开发者更高效地进行网络数据抓取。 首先,让我们来看文件上传功能。Requests库内置了方便的文件上传功能,这对于需要处理表单数据,特别是包含文件上传的网站时尤为实用。通过`requests.post()`方法配合`files`参数,可以实现数据的提交。以下是一个示例: ```python import requests # 打开本地文件 files = {'file': open('favicon.ico', 'rb')} # 发送POST请求到http://httpbin.org/post,并附带文件数据 response = requests.post('http://httpbin.org/post', files=files) # 输出服务器返回的文本内容 print(response.text) 在这个例子中,我们首先创建一个包含文件对象的字典,然后将其作为参数传递给`requests.post()`. 请求成功后,返回的`response`对象包含了服务器对文件上传的处理结果,可以看到`data`字段为空,`files`字段包含了上传文件的信息。 其次,Cookies的管理也是网络爬虫中常见的需求。在使用Urllib时,管理Cookies的代码相对繁琐,而在Requests中,操作则更加简洁。你可以使用`cookies`参数来设置或更新Cookie,示例如下: ```python import requests # 假设你有一组Cookie cookies = { 'cookie_name1': 'cookie_value1', 'cookie_name2': 'cookie_value2' } # 使用Requests发送请求,并设置Cookie response = requests.get('http://example.com', cookies=cookies) # 获取响应头中的所有Cookie print(response.cookies) Requests库自动处理了Cookie的持久性和会话管理,使得爬虫在处理多个请求时保持状态一致性,提高了效率。 总结来说,Requests库的高级用法涵盖了文件上传和Cookie管理等实用功能,极大地简化了网络爬虫的工作流程。理解并熟练运用这些技巧,能够帮助你编写出更强大、更高效的网络爬虫脚本。在实际应用中,根据具体需求灵活结合使用,是提高网络数据抓取能力的关键。

下载后可阅读完整内容,剩余4页未读,立即下载

- 粉丝: 10

- 资源: 886

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- C++多态实现机制详解:虚函数与早期绑定

- Java多线程与异常处理详解

- 校园导游系统:无向图实现最短路径探索

- SQL2005彻底删除指南:避免重装失败

- GTD时间管理法:提升效率与组织生活的关键

- Python进制转换全攻略:从10进制到16进制

- 商丘物流业区位优势探究:发展战略与机遇

- C语言实训:简单计算器程序设计

- Oracle SQL命令大全:用户管理、权限操作与查询

- Struts2配置详解与示例

- C#编程规范与最佳实践

- C语言面试常见问题解析

- 超声波测距技术详解:电路与程序设计

- 反激开关电源设计:UC3844与TL431优化稳压

- Cisco路由器配置全攻略

- SQLServer 2005 CTE递归教程:创建员工层级结构

信息提交成功

信息提交成功