Keras深度学习入门:卷积神经网络详解与实践

154 浏览量

更新于2024-08-28

收藏 521KB PDF 举报

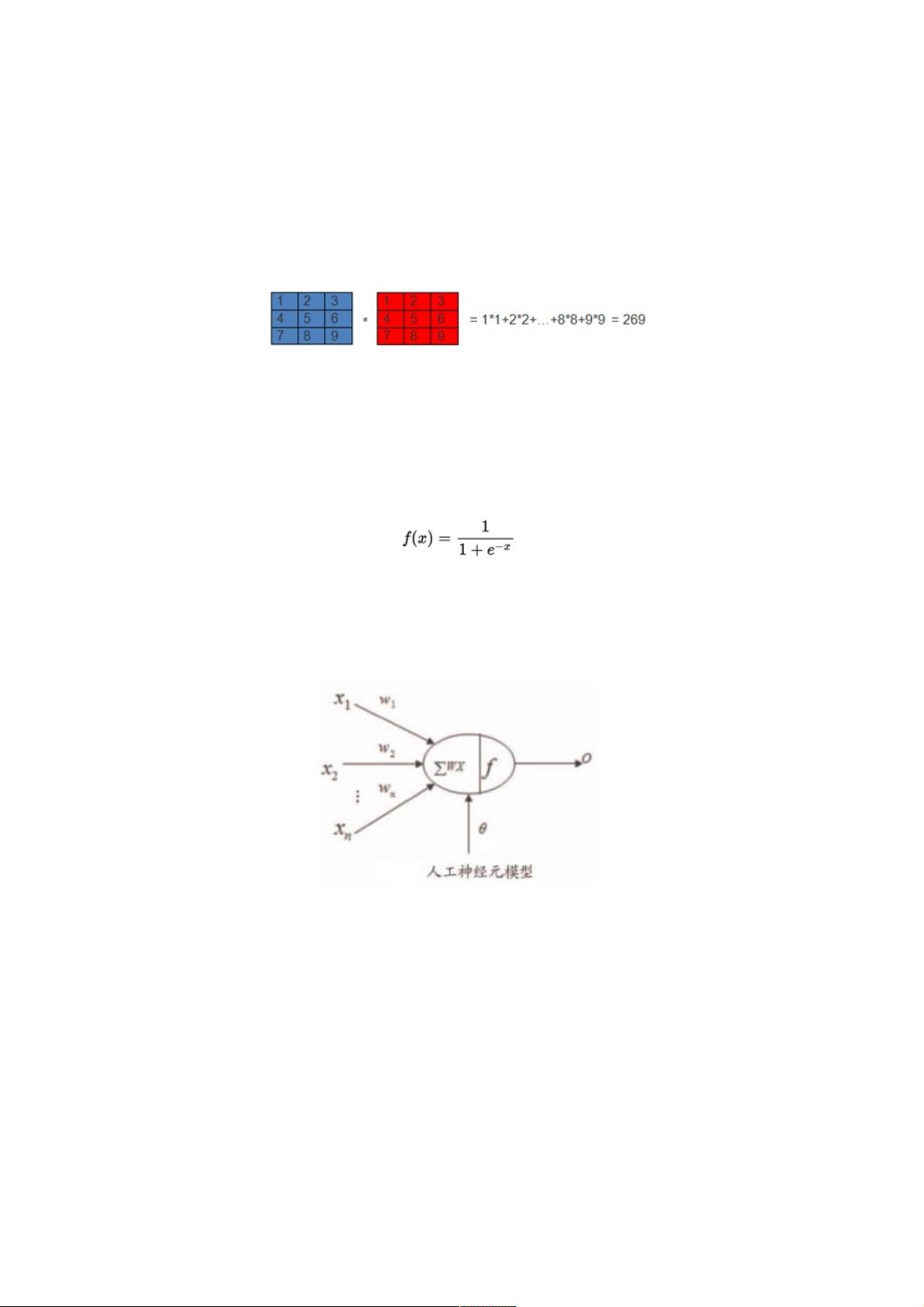

深度学习:Keras入门(二)之卷积神经网络(CNN)是一篇深入浅出的教程,主要讲解了卷积神经网络的基本原理和应用。本文首先从卷积的概念出发,解释它是一种对输入信号进行局部特征检测的操作,通过对对应位置的元素相乘并求和来提取信号的特征。卷积的一个关键优点是可以减少噪音并增强信号的特征表示,这在图像处理中尤为重要。

接着,文章介绍了常用的激活函数sigmoid,例如,当输入计算结果为269时,通过sigmoid函数可以得出输出值为1。这里还详细阐述了神经元的工作机制,包括输入x、权重w、偏置θ、卷积运算∑wx、激活函数f以及最终的输出o。通过一个灰度图片的例子,展示了如何使用sobel算子进行滤波,从而改变原始图像的特性。

在概念梳理之后,文章进入了卷积神经网络的具体内容。它列举了几种常见的卷积神经网络结构,如简单的卷积层(C-层)、子抽样层(S-层)等,并区分了这些结构在网络中的作用,比如C-层负责特征提取,S-层进行下采样或局部平均。图6和图7的不同在于它们是否包含全连接层,全连接层的存在可能需要添加扁平层进行数据转换。

最后,文章提到了ReLU层在卷积神经网络中的角色,它是激活函数的一种,常用于卷积层以引入非线性,与传统的sigmoid或tanh激活函数相比,ReLU在处理深层网络时具有更好的性能。通过对比图2和图10,可以看到神经元在有ReLU层后的完整工作流程,进一步强调了激活函数在模型中的关键作用。

这篇教程帮助读者理解了卷积神经网络的基本构造,包括卷积操作、激活函数选择、神经元结构,以及常见网络结构的设计与选择。这对于深度学习初学者来说,是理解CNN核心原理的重要一步。

104 浏览量

190 浏览量

128 浏览量

点击了解资源详情

101 浏览量

254 浏览量

126 浏览量

142 浏览量

167 浏览量

weixin_38732343

- 粉丝: 5

最新资源

- Premiere Pro CS6视频编辑项目教程微课版教案

- SSM+Lucene+Redis搜索引擎缓存实例解析

- 全栈打字稿应用:演示项目实践与探索

- 仿Windows风格的AJAX无限级树形菜单实现教程

- 乐华2025L驱动板通用升级解决方案

- Java通过jcraft实现SFTP文件上传下载教程

- TTT素材-制造1资源包介绍与记录

- 深入C语言编程技巧与实践指南

- Oracle数据自动导出并转换为Excel工具使用教程

- Ubuntu下Deepin-Wine容器的使用与管理

- C语言网络聊天室功能详解:禁言、踢人与群聊

- AndriodSituationClick事件:详解按钮点击响应机制

- 探索Android-NetworkCue库:高效的网络监听解决方案

- 电子通信毕业设计:简易电感线圈制作方法

- 兼容性数据库Compat DB 4.2.52-5.1版本发布

- Android平台部署GNU Linux的新方案:dogeland体验