标题:微调大语言模型:无需拥有超级计算机的方法

总结:

近年来,大语言模型在自然语言处理领域取得了巨大的成功。然而,微调这些庞大模型以符合特定任务的需求一直是一个挑战,需要庞大的计算资源。本文介绍了一种无需拥有超级计算机的方法,用于微调大语言模型。通过对"微调大语言模型.pptx"和"Fine-tuning a large language model without your own supercomputer"这两个文档进行分析和总结,我们将深入探讨这一方法的关键内容。

本方法的关键主要包括以下几个方面:

1. 数据预处理:为了使大语言模型适应特定任务,首先需要准备专门的训练数据集。这一步骤包括数据的收集、清洗、标注和切分。同时,为了提高训练效果,可以采用数据增强的技术来扩充训练数据。

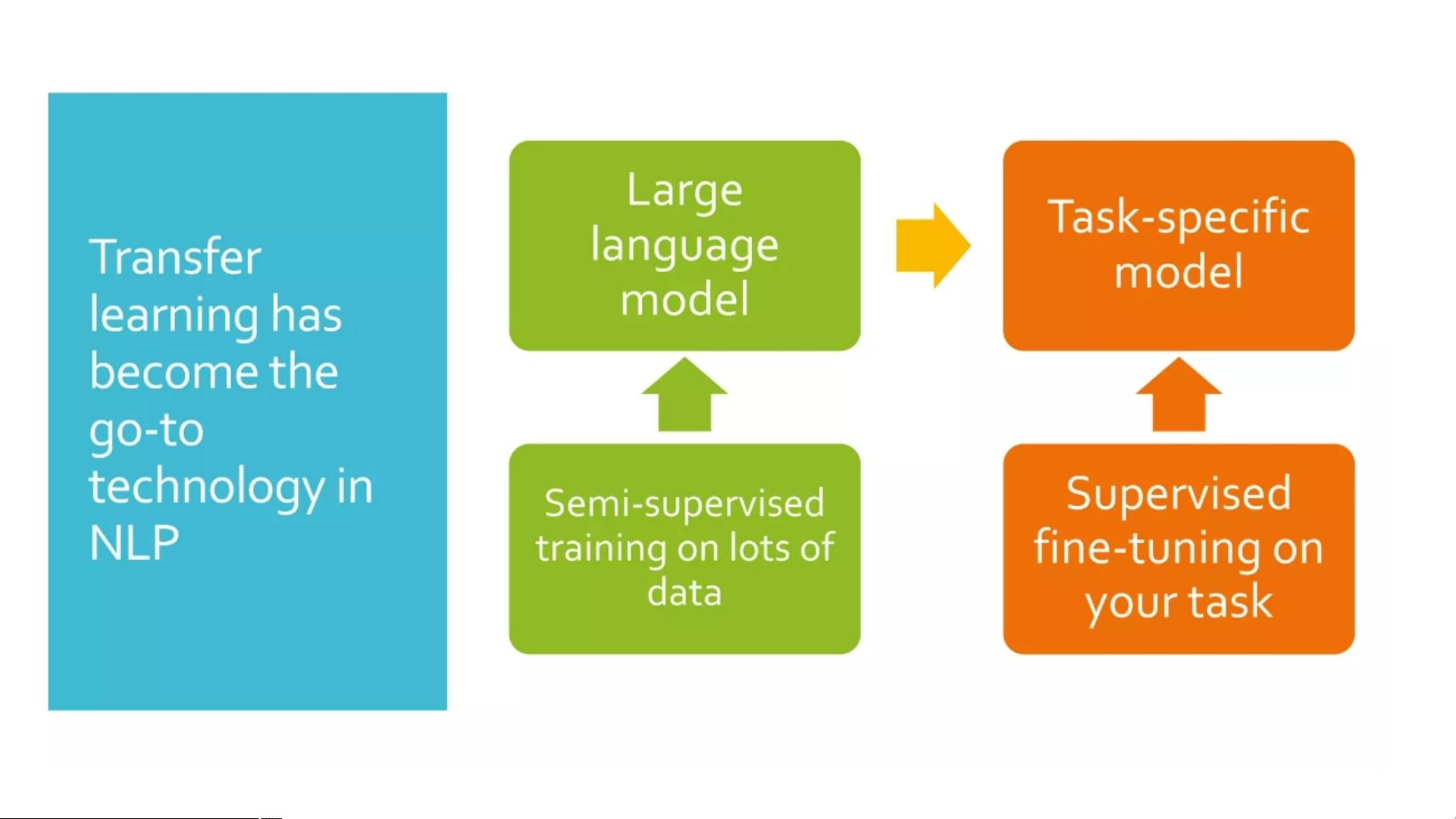

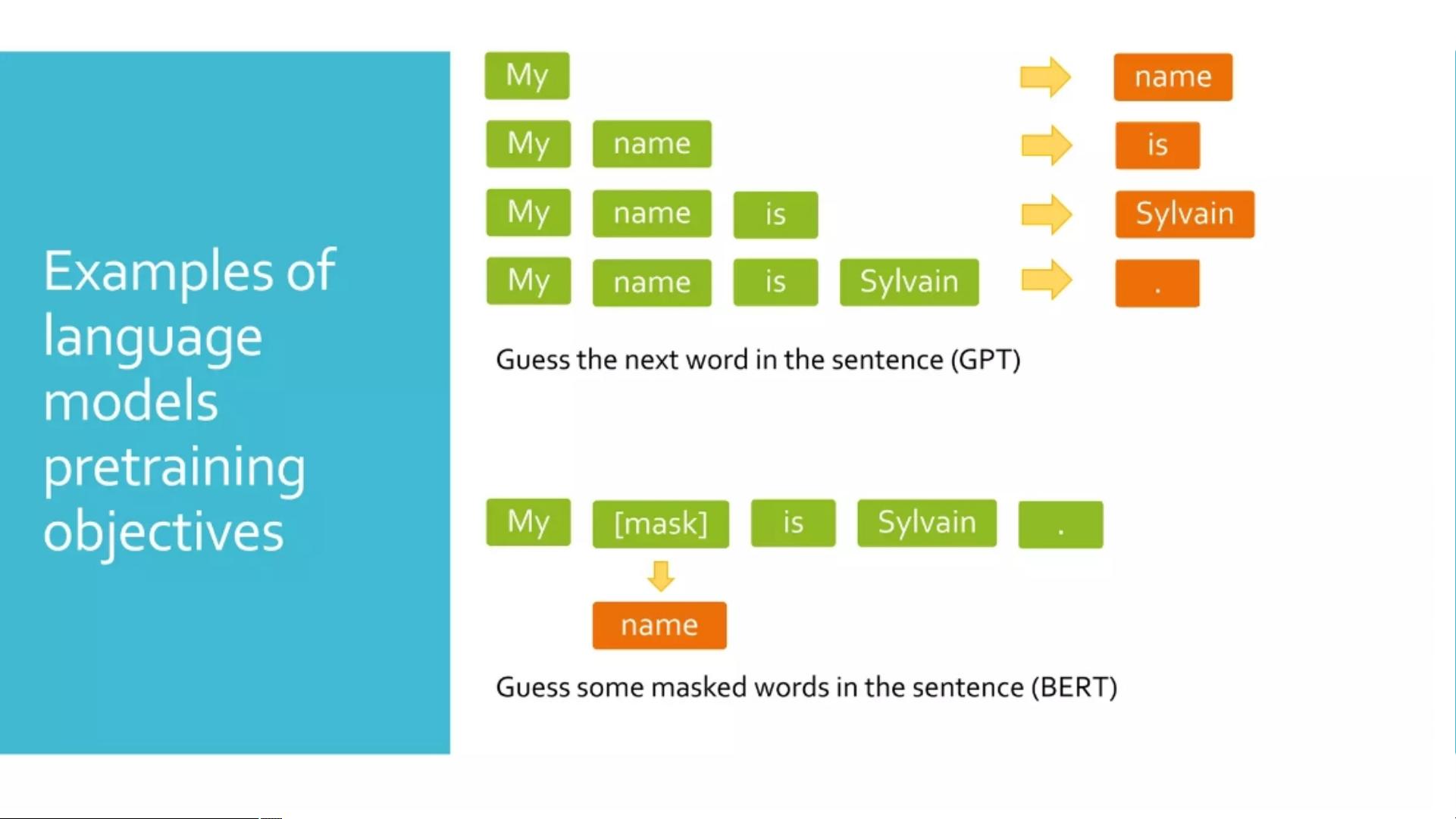

2. 模型选择:本方法建议选择已经在大规模数据上训练过的开源语言模型,如OpenAI的GPT模型。这些模型通常具有强大的语言理解和生成能力,可以在特定任务上进行微调。

3. 微调过程:微调大语言模型需要在训练数据上进行多轮迭代训练。训练过程中,可以采用不同的学习率调整策略和优化器来提高微调效果。此外,还可以利用预训练模型的知识来加速微调过程。

4. 超参数调优:在微调过程中,超参数的选择对最终的模型性能具有重要影响。本方法建议使用自动化的超参数搜索方法,如网格搜索或贝叶斯优化,从而找到最优的超参数组合。

在实际应用中,通过采用上述方法,我们可以在一台普通的计算机上实现微调大语言模型的任务。这种方法的优势在于无需投资昂贵的超级计算机资源,而且具有较高的可扩展性和适用性。

然而,我们也要认识到这种方法存在一些挑战和限制。首先,大语言模型微调需要大量的训练数据,因此数据收集和预处理是一个耗时且困难的任务。其次,微调过程需要较长的时间和计算资源,尤其是在训练数据较大、模型参数较多的情况下。因此,对于一些资源有限的应用场景,这种方法可能不太适用。

综上所述,通过对"微调大语言模型.pptx"和"Fine-tuning a large language model without your own supercomputer"的内容进行分析和总结,我们可以得出结论:无需拥有超级计算机,通过合理的数据预处理、模型选择、微调过程和超参数调优等方法,我们可以在普通计算机上成功微调大语言模型,从而适应各种特定的自然语言处理任务。然而,需要注意的是这种方法在数据量和计算资源方面仍存在一定的限制和挑战,需要根据实际应用情况进行权衡和选择。