上下文驱动的时尚搭配预测提升视觉吸引力

201 浏览量

更新于2025-01-16

收藏 1.11MB PDF 举报

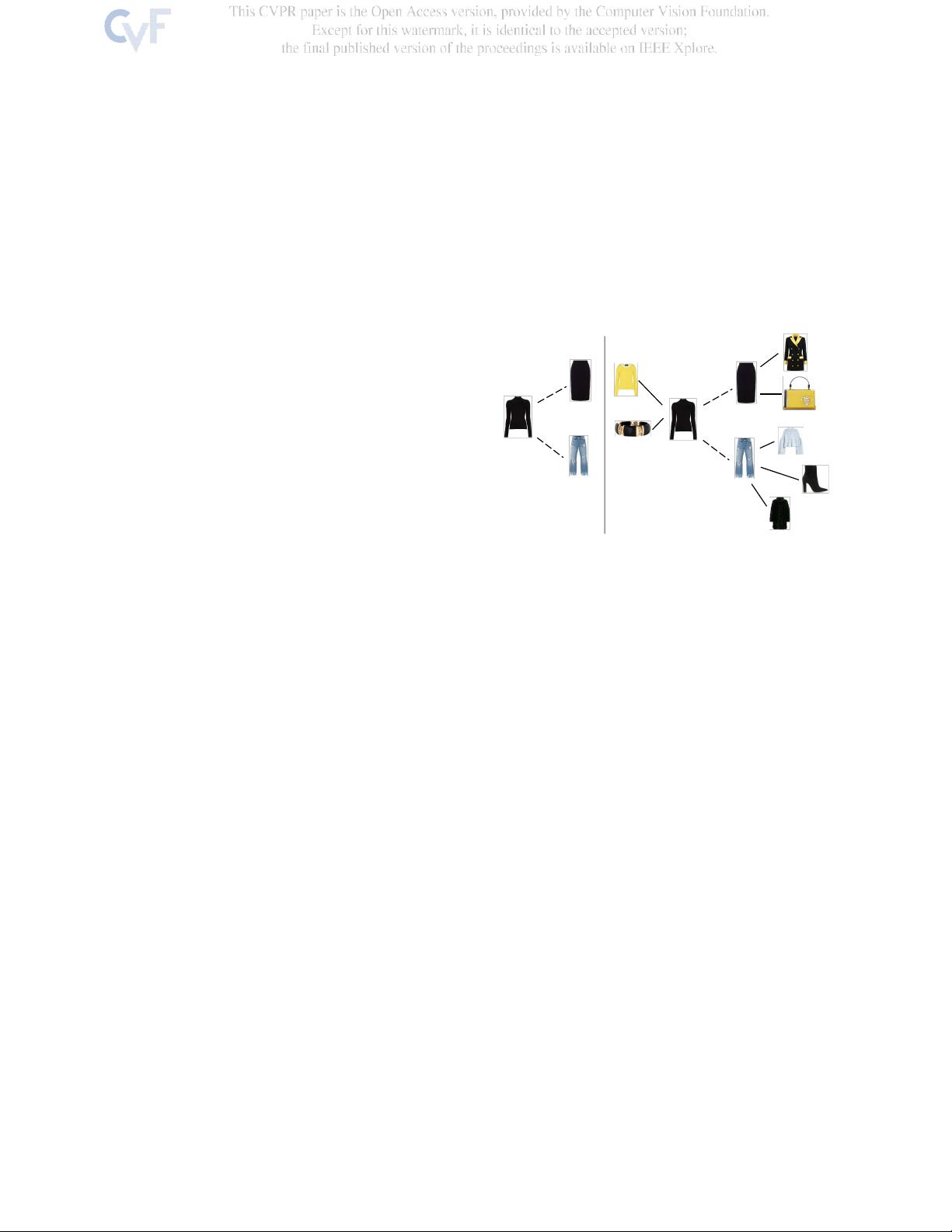

上下文感知的时尚兼容性预测是一项前沿的研究,旨在解决如何准确评估多件服装之间的视觉吸引力和搭配合理性。该研究由Guillem Cucurull、Perouz Taslakian和David Vazquez等人在ElementAI团队开展,他们提出了一个创新的方法,通过图神经网络来解决这一问题。传统的方法主要依赖于单个项目的属性,如图像、类别和描述,进行成对比较,但这忽视了服装之间的上下文关系。

在新的方法中,上下文被定义为与待预测项目相关的已知兼容产品。这意味着模型不再孤立地看待每一对服装,而是考虑它们在整体时尚环境中的位置和相互影响。通过构建一个图形结构,模型能够学习到项目之间的关系,这有助于增强对视觉风格、社会态度和时空因素的理解,从而提升预测的准确性。

研究人员在Polyvore和Fashion-Gen两个时尚数据集,以及Amazon数据集的一个子集上进行了实验,分别测试了填充空缺和服装兼容性两个任务。实验结果显示,当引入上下文信息时,预测性能得到了显著提升,且随着更多上下文的使用,预测能力持续优化。这种方法避免了孤立项目比较可能导致的局限性,使得兼容性预测更加接近人类审美和实际搭配情境。

这项工作的关键贡献在于,它扩展了时尚兼容性预测的视角,从孤立的项目特征转向了更全面的上下文关联,这对于个性化时装设计、服装推荐等实际应用场景具有重要的推动作用。未来的研究可以进一步探索如何更好地捕捉和利用上下文信息,以实现更精准、更具人性化的时尚搭配建议。

909 浏览量

739 浏览量

285 浏览量

232 浏览量

301 浏览量

295 浏览量

375 浏览量

192 浏览量

cpongm

- 粉丝: 6

最新资源

- ITween插件实用教程:路径运动与应用案例

- React三纤维动态渐变背景应用程序开发指南

- 使用Office组件实现WinForm下Word文档合并功能

- RS232串口驱动:Z-TEK转接头兼容性验证

- 昆仑通态MCGS西门子CP443-1以太网驱动详解

- 同步流密码实验研究报告与实现分析

- Android高级应用开发教程与实践案例解析

- 深入解读ISO-26262汽车电子功能安全国标版

- Udemy Rails课程实践:开发财务跟踪器应用

- BIG-IP LTM配置详解及虚拟服务器管理手册

- BB FlashBack Pro 2.7.6软件深度体验分享

- Java版Google Map Api调用样例程序演示

- 探索设计工具与材料弹性特性:模量与泊松比

- JAGS-PHP:一款PHP实现的Gemini协议服务器

- 自定义线性布局WidgetDemo简易教程

- 奥迪A5双门轿跑SolidWorks模型下载