动态皱纹驱动的合成人脸:提升真实感与性能

PDF格式 | 2.62MB |

更新于2025-01-16

| 192 浏览量 | 举报

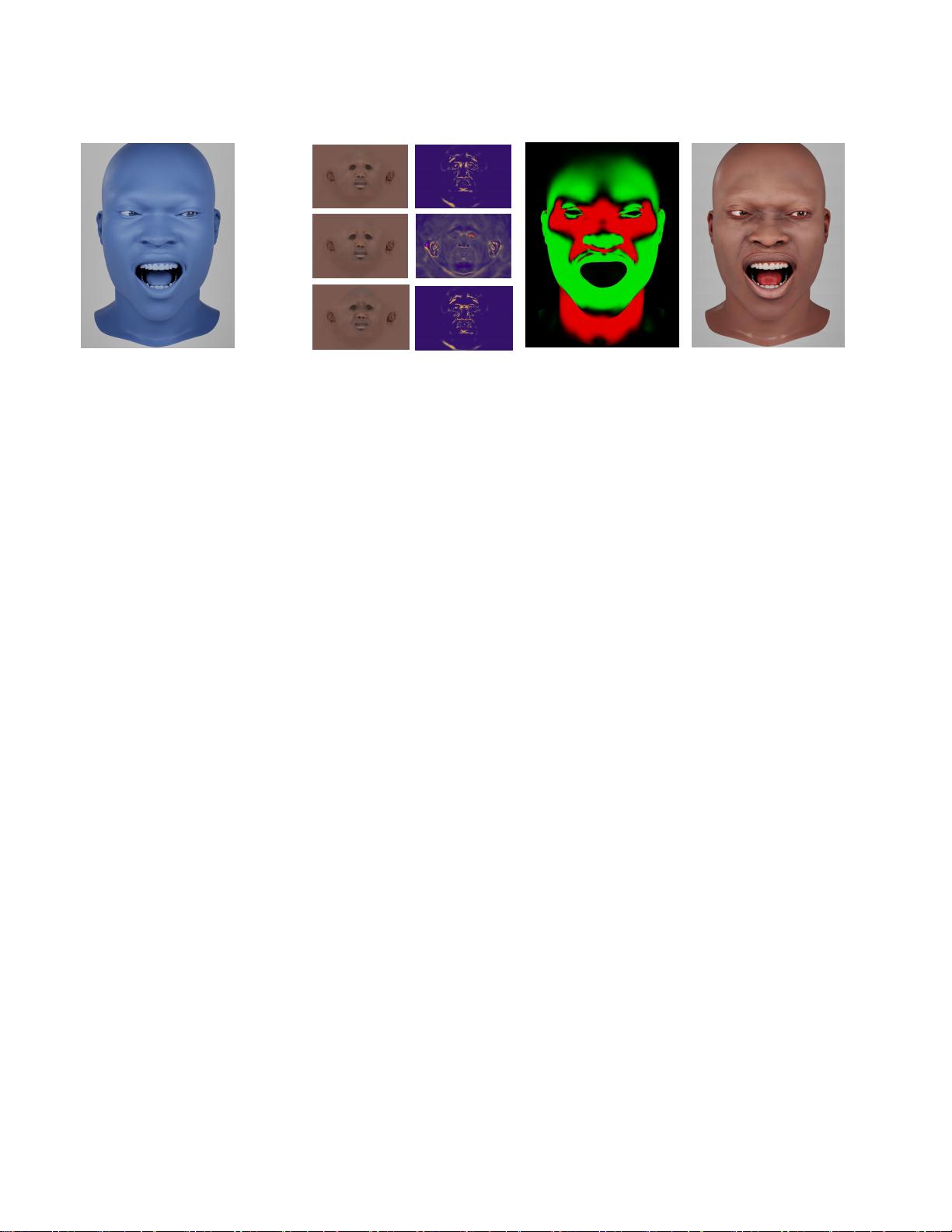

标题:“基于表情的合成面褶皱的网格张力驱动”研究聚焦于提升合成人脸的真实感,通过引入动态皮肤皱纹来回应面部表情,以解决现实主义与过度追求光效之间的平衡问题。研究人员奇拉格拉曼、查理·休伊特、埃罗尔·伍德和塔达斯·巴尔特鲁斯·萨伊蒂斯合作,针对面部合成中的一个重要挑战,即如何高效地生成逼真的皱纹,尤其是那些在原始扫描中未被记录的表情。

该工作的核心贡献是提出了一种网格张力驱动的方法,它能够从高质量的表情扫描中聚合出可能的皱纹,然后将这些皱纹信息应用于纹理映射和位移纹理图中。这种方法不仅允许皱纹的动态变化,还能在缺乏原始数据的情况下,如压缩表情引起的变形,保持合成结果的精确性。以往的方法要么需要大量的艺术家手工调整,以实现跨身份和表情的通用性,要么在细节重现上有所牺牲。

为更准确地评估模型在处理表情变形下的表现,研究者还构建了300W眨眼评估子集和闭眼与眨眼的Pexels数据集。这些辅助数据集帮助衡量模型在不同场景下的稳定性和逼真度,从而推动了合成面部数据在计算机视觉任务中的应用,如人脸识别、手部跟踪和全身分析,尤其是在面部细节捕捉上的进步。

尽管全脸合成的人类头部建模仍然复杂,且依赖于大量艺术家工作,但这项研究朝着更加真实、自动化的方向迈进,有助于减少对真实数据的依赖,促进计算机视觉任务在更广泛的场景下实现更好的性能和泛化能力。通过这种方式,合成数据逐渐接近现实,挑战了传统意义上对真实数据的过分追求,同时填补了真实与合成面部数据之间的差距。

相关推荐

cpongm

- 粉丝: 6

最新资源

- 全面详实的大学生电工实习报告汇总

- 利用极光推送实现App间的消息传递

- 基于JavaScript的节点天气网站开发教程

- 三星贴片机1+1SMT制程方案详细介绍

- PCA与SVM结合的机器学习分类方法

- 钱能版C++课后习题完整答案解析

- 拼音检索ListView:实现快速拼音排序功能

- 手机mp3音量提升神器:mp3Trim使用指南

- 《自动控制原理第二版》习题答案解析

- 广西移动数据库脚本文件详解

- 谭浩强C语言与C++教材PDF版下载

- 汽车电器及电子技术实验操作手册下载

- 2008通信定额概预算教程:快速入门指南

- 流行的表情打分评论特效:实现QQ风格互动

- 使用Winform实现GDI+图像处理与鼠标交互

- Python环境配置教程:安装Tkinter和TTk