聚类量化提升隐式神经网络压缩效果

PDF格式 | 1.15MB |

更新于2025-01-16

| 106 浏览量 | 举报

"该文探讨了隐式神经网络(如神经辐射场(NeRF))的权重聚类量化方法,以提高压缩效率并减少性能损失。传统的固定量化方案在低比特率下可能导致性能下降,因为网络权重分布随训练过程变化。作者提出非均匀量化,特别是聚类量化,可以显著提升重建质量。他们展示了在二维图像和三维辐射场的实验中,聚类量化方法能够实现NeRF的有效压缩,甚至达到16kb以下,同时保持较小的性能损失。此外,文章还强调了量化与网络容量之间的权衡,并指出虽然均匀量化能提供高保真度,但其对网络容量的适应性需要进一步研究。"

在隐式神经网络中,权重的表示和压缩是一个重要的课题,尤其是对于内存和计算效率有严格要求的应用。传统的量化策略通常采用固定、均匀的量化方案,即所有权重被分配到等间距的量化级别。然而,这种方法在训练过程中可能会因权重分布的变化而导致量化误差,从而影响网络的性能。本文指出,由于网络权重分布的动态性,固定量化可能不再适用。

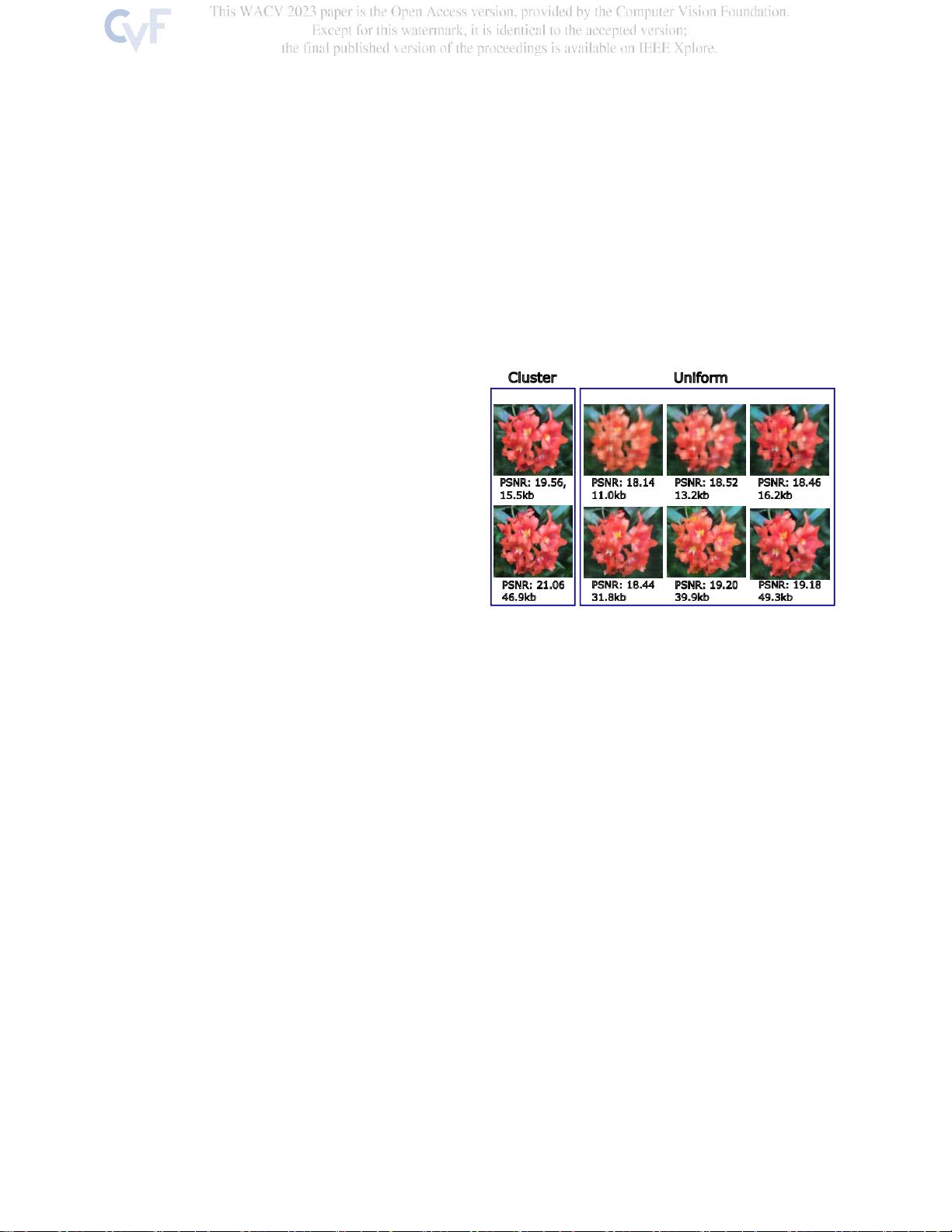

为了解决这个问题,研究人员提出了聚类量化,这是一种非均匀的量化技术,通过将权重分配到最接近的聚类中心来减少与原始分布的差距,从而减少重构误差。文中使用K-means算法进行聚类,展示了在不同的神经网络配置下,聚类量化相对于均匀量化可以带来更高的峰值信噪比(PSNR),证明了其在保持重构质量方面的优势。

此外,文章探讨了量化水平与网络容量之间的关系,这对于理解如何在保持性能的同时压缩神经网络至关重要。虽然均匀量化可以提供良好的信号表示,但它可能不灵活到足以适应不同的网络结构和训练阶段的变化。通过调整量化策略和网络结构,作者表明可以在牺牲极小的性能的前提下,大幅度压缩NeRF模型,例如将其压缩到原始大小的约1/323。

这项工作为理解和优化隐式神经网络的量化提供了新的视角,尤其是聚类量化方法对于提高压缩效率和减少性能损失的潜力。未来的研究可能会进一步探索如何动态适应权重分布变化的量化策略,以及如何更有效地利用网络容量进行量化。

相关推荐

cpongm

- 粉丝: 6

最新资源

- 自动生成CAD模型文件的测试流程

- 掌握JavaScript中的while循环语句

- 宜科高分辨率编码器产品手册解析

- 探索3CDaemon:FTP与TFTP的高效传输解决方案

- 高效文件对比系统:快速定位文件差异

- JavaScript密码生成器的设计与实现

- 比特彗星1.45稳定版发布:低资源占用的BT下载工具

- OpenGL光源与材质实现教程

- Tablesorter 2.0:增强表格用户体验的分页与内容筛选插件

- 设计开发者的色值图谱指南

- UYA-Grupo_8研讨会:在DCU上的培训

- 新唐NUC100芯片下载程序源代码发布

- 厂家惠新版QQ空间访客提取器v1.5发布:轻松获取访客数据

- 《Windows核心编程(第五版)》配套源码解析

- RAIDReconstructor:阵列重组与数据恢复专家

- Amargos项目网站构建与开发指南