首页

KNN算法中英文全称

KNN算法中英文全称

时间: 2024-07-12 07:00:54

浏览: 312

K-Nearest Neighbors (KNN) 算法的中文全称是“K近邻算法”。这是一种基于实例的学习(Instance-based learning)方法,在分类和回归分析中常用,它的基本思想是根据新样本在特征空间中的位置,找出与其最近的K个训练样例(邻居),然后根据这K个邻居的标签或值进行预测。

阅读全文

相关推荐

KNN算法深入解析与实践

KNN算法,全称为K-Nearest Neighbors(K近邻),是一种基于实例的学习方法,属于监督学习中的分类算法。KNN算法的核心思想是:未知类别数据点可以通过其最近邻的已知类别数据点的类别进行预测,即“物以类聚”。在...

KNN算法详解与Java实现

KNN(K-Nearest Neighbors,K最近邻)算法是一种基于实例的学习方法,它在分类任务中扮演着重要角色。其基本思想是假设每个样本都可以被其最近的邻居所代表,通过寻找测试样本的K个最近邻来决定其类别。这里的K通常...

KNN算法在Matlab中的分类预测实践

资源摘要信息:"在本文档中,我们将会详细介绍k近邻算法(K-Nearest Neighbors,简称KNN算法),这是一个在机器学习领域应用广泛的分类预测算法。我们将会探讨其工作原理、优势与局限性,并且重点讲解如何使用MATLAB...

knn.rar_KNN java_KNN算法 java_knn算法_knn算法java实现

KNN,全称为K-最近邻(K-Nearest Neighbors)算法,是一种基于实例的学习方法,也是非参数监督学习算法的一种。它在分类和回归问题中都有应用,尤其在机器学习初学者中非常常见,因为其原理简单,易于理解和实现。 ...

knn.zip_knn_knn算法_knn算法 matlab

KNN,全称为K-最近邻(K-Nearest Neighbors)算法,是机器学习领域中最基础且重要的算法之一。它属于监督学习方法,广泛应用于分类和回归问题。KNN算法的基本思想是:通过查找训练集中与未知类别样本最接近的K个已知...

KNN算法综述综述KNN算法综述

KNN算法综述,详细介绍knn算法的原理与过程

knn.zip_knn_knn算法_实现KNN算法java

KNN(K-Nearest Neighbors)算法,即K近邻算法,是机器学习领域中最基础且重要的算法之一。它基于实例的学习,通过寻找训练集中与新样本最接近的K个邻居,依据邻居的类别进行投票,从而决定新样本的类别。在本篇文章...

《KNN算法Java实现》KNN算法demo

KNN算法详解,查看我的博客关于KNN算法的浅析,博客连接:https://blog.csdn.net/wang_xiaogui/article/details/61413594............

kNN.rar_K._KNN算法 python_knn_knn python_knn算法 python

KNN,k近邻算法,内附测试数据集,机器学习实战源码

KNN-classifier.rar_knn_knn MATLAB_knn算法_knn算法 matlab_matlab kn

用matlab实现KNN算法 用matlab实现KNN算法 用matlab实现KNN算法

knn 算法

knn 算法knn 算法knn 算法knn 算法knn 算法knn 算法

KNN算法中涉及的数据包

我博客中的代码里用到的数据包,此数据来自网上的数据,后期我自己重新整理了一下

knn:knn算法

KNN,全称为K-最近邻(K-Nearest Neighbors),是一种简单而直观的监督学习算法,常用于分类和回归任务。KNN算法的基本思想是:将未知类别的数据点通过计算与已知类别数据点的距离,找到与其最接近的K个邻居,然后...

KNN_knn算法_

在Python中实现KNN算法,通常会用到numpy库进行数值计算,pandas库处理数据,以及matplotlib库进行数据可视化。Prostate_Cancer.csv很可能是一个包含前列腺癌患者数据的数据集,可能有多个特征和一个目标变量,...

knn.rar_KNN 聚类算法_knn MATLAB_knn算法_聚类 音频_聚类 KNN

KNN(K-Nearest Neighbors)算法是数据挖掘领域的一种基础且重要的机器学习方法,尤其在分类和聚类问题中被广泛应用。该算法基于“近朱者赤,近墨者黑”的原则,即一个样本点最有可能属于与其最近的K个邻居最多的...

KNN算法示例

KNN,全称K-Nearest Neighbors,是一种简单而有效的非参数监督学习算法,常用于分类和回归问题。在模式识别领域,KNN因其直观性和实用性,被广泛应用。本示例将通过MATLAB编程语言来阐述KNN算法的工作原理和实现过程...

kNN算法简介

例如,在Java中,可以编写一个简单的kNN算法实现,包括训练集和测试集的划分、距离计算、邻居选择及最终的预测等步骤。具体的Java代码实现细节较为复杂,这里不展开讨论。 #### 七、kNN算法的研究与发展 随着机器...

KNN算法11111

初学打得算法!

KNN算法源码

在KNN中,我们需要将数据集分为特征和对应的标签。例如,假设我们有一个二维特征空间的数据集,每个样本可以表示为(x, y)坐标,而标签可能是0或1,代表不同的类别。数据加载模块会将这些数据结构化,以便于后续的...

knn算法python

按照机器学习实战第二章写的knn算法python版,加了一些个人注释,供需要的朋友参考。

CSDN会员

开通CSDN年卡参与万元壕礼抽奖

海量

VIP免费资源

千本

正版电子书

商城

会员专享价

千门

课程&专栏

全年可省5,000元

立即开通

全年可省5,000元

立即开通

大家在看

公安大数据零信任体系设计要求.pdf

公安大数据零信任体系设计要求,本规范性技术文件规定了零信任体系的整体设计原则、设计目标、总体架构、整体能力要求和安全流程。用以指导公安大数据智能化访问控制体系的规划、设计、建设、实施、应用、运营等工作。 本规范性技术文件适用于参与公安机关大数据智能化访问控制体系建设工作的各级公安机关、相关单位、以及各类技术厂商等单位及其人员。

AUTOSAR-MCAL -CanDriver-UserMAnnual

EB Tresos,CAN驱动用户手册,有助于进行CAN模块配置及配置项研究

MTK_Camera_HAL3架构.doc

适用于MTK HAL3架构,介绍AppStreamMgr , pipelineModel, P1Node,P2StreamingNode等模块

不平衡学习的自适应合成采样方法ADASYN附Matlab代码.zip

1.版本:matlab2014/2019a,内含运行结果,不会运行可私信 2.领域:智能优化算法、神经网络预测、信号处理、元胞自动机、图像处理、路径规划、无人机等多种领域的Matlab仿真,更多内容可点击博主头像 3.内容:标题所示,对于介绍可点击主页搜索博客 4.适合人群:本科,硕士等教研学习使用 5.博客介绍:热爱科研的Matlab仿真开发者,修心和技术同步精进,matlab项目合作可si信

山东大学最优化方法期末整合(多套)

往年期末题

最新推荐

基于python实现KNN分类算法

KNN,全称为K-Nearest Neighbors,是一种非参数监督学习算法,常用于分类和回归问题。在本文中,我们将重点关注KNN在分类问题上的应用,特别是在Python环境下的实现。 KNN算法的核心思想是“近朱者赤,近墨者黑”,...

机器学习之KNN算法原理及Python实现方法详解

KNN算法虽然简单,但在许多实际问题中仍然表现出良好的效果。然而,由于其计算量大,对于大型数据集和实时任务可能不太适用。现代机器学习库如`scikit-learn`提供了优化过的KNN实现,可以更高效地处理这些问题。

机器学习实战 - KNN(K近邻)算法PDF知识点详解 + 代码实现

在Python中,我们可以使用pandas库处理数据,并实现KNN算法。首先创建一个包含电影信息的DataFrame,包括电影名称、打斗镜头数、接吻镜头数和电影类型。接着,计算新电影与训练集中电影的距离,排序并选取K个最近邻...

数据挖掘中的KNN算法详解

KNN,全称为K-Nearest Neighbors,是一种基于实例的学习方法,广泛应用于数据挖掘的分类任务中。KNN算法的核心思想是通过寻找输入数据在训练集中最接近的K个邻居,然后根据这些邻居的类别进行投票,决定输入数据的...

内墙装修涂料行业发展趋势:预计2030年年复合增长率(CAGR)为5.6%(2024-2030)

内墙装修涂料市场:把握5.6%年复合增长率 在追求舒适与美观并重的现代家居生活中,内墙装修涂料扮演着至关重要的角色。它不仅关乎居室的视觉效果,更与居住者的健康息息相关。令人振奋的是,这一数据背后,隐藏着怎样的市场机遇与挑战?让我们一同探索内墙装修涂料的未来之路。 市场概况: 根据QYR(恒州博智)的统计及预测,2023年全球内墙装修涂料市场销售额达到了149亿元,预计2030年将达到213亿元,年复合增长率(CAGR)为5.6%(2024-2030)。这一增长不仅源于消费者对居住环境品质要求的提升,更得益于技术创新和环保理念的深入人心。 技术创新与趋势: 在内墙装修涂料领域,技术创新是推动市场发展的重要力量。随着环保法规的日益严格和消费者环保意识的增强,低VOC(挥发性有机化合物)、无毒、抗菌等环保型涂料逐渐成为市场主流。同时,智能化、个性化等趋势也日益明显,如通过APP控制涂料颜色、质感等,满足消费者多元化的装修需求。咨询服务在此过程中的价值不言而喻,它能帮助企业紧跟市场趋势,把握技术创新方向,从而在竞争中脱颖而出。 应用领域与细分市场: 内墙装修涂料广泛应用于住宅、酒店、学校、医院

HTML挑战:30天技术学习之旅

资源摘要信息: "desafio-30dias" 标题 "desafio-30dias" 暗示这可能是一个与挑战或训练相关的项目,这在编程和学习新技能的上下文中相当常见。标题中的数字“30”很可能表明这个挑战涉及为期30天的时间框架。此外,由于标题是西班牙语,我们可以推测这个项目可能起源于或至少是针对西班牙语使用者的社区。标题本身没有透露技术上的具体内容,但挑战通常涉及一系列任务,旨在提升个人的某项技能或知识水平。 描述 "desafio-30dias" 并没有提供进一步的信息,它重复了标题的内容。因此,我们不能从中获得关于项目具体细节的额外信息。描述通常用于详细说明项目的性质、目标和期望成果,但由于这里没有具体描述,我们只能依靠标题和相关标签进行推测。 标签 "HTML" 表明这个挑战很可能与HTML(超文本标记语言)有关。HTML是构成网页和网页应用基础的标记语言,用于创建和定义内容的结构、格式和语义。由于标签指定了HTML,我们可以合理假设这个30天挑战的目的是学习或提升HTML技能。它可能包含创建网页、实现网页设计、理解HTML5的新特性等方面的任务。 压缩包子文件的文件名称列表 "desafio-30dias-master" 指向了一个可能包含挑战相关材料的压缩文件。文件名中的“master”表明这可能是一个主文件或包含最终版本材料的文件夹。通常,在版本控制系统如Git中,“master”分支代表项目的主分支,用于存放项目的稳定版本。考虑到这个文件名称的格式,它可能是一个包含所有相关文件和资源的ZIP或RAR压缩文件。 结合这些信息,我们可以推测,这个30天挑战可能涉及了一系列的编程任务和练习,旨在通过实践项目来提高对HTML的理解和应用能力。这些任务可能包括设计和开发静态和动态网页,学习如何使用HTML5增强网页的功能和用户体验,以及如何将HTML与CSS(层叠样式表)和JavaScript等其他技术结合,制作出丰富的交互式网站。 综上所述,这个项目可能是一个为期30天的HTML学习计划,设计给希望提升前端开发能力的开发者,尤其是那些对HTML基础和最新标准感兴趣的人。挑战可能包含了理论学习和实践练习,鼓励参与者通过构建实际项目来学习和巩固知识点。通过这样的学习过程,参与者可以提高在现代网页开发环境中的竞争力,为创建更加复杂和引人入胜的网页打下坚实的基础。

【CodeBlocks精通指南】:一步到位安装wxWidgets库(新手必备)

# 摘要 本文旨在为使用CodeBlocks和wxWidgets库的开发者提供详细的安装、配置、实践操作指南和性能优化建议。文章首先介绍了CodeBlocks和wxWidgets库的基本概念和安装流程,然后深入探讨了CodeBlocks的高级功能定制和wxWidgets的架构特性。随后,通过实践操作章节,指导读者如何创建和运行一个wxWidgets项目,包括界面设计、事件

andorid studio 配置ERROR: Cause: unable to find valid certification path to requested target

### 解决 Android Studio SSL 证书验证问题 当遇到 `unable to find valid certification path` 错误时,这通常意味着 Java 运行环境无法识别服务器提供的 SSL 证书。解决方案涉及更新本地的信任库或调整项目中的网络请求设置。 #### 方法一:安装自定义 CA 证书到 JDK 中 对于企业内部使用的私有 CA 颁发的证书,可以将其导入至 JRE 的信任库中: 1. 获取 `.crt` 或者 `.cer` 文件形式的企业根证书; 2. 使用命令行工具 keytool 将其加入 cacerts 文件内: ```

VC++实现文件顺序读写操作的技巧与实践

资源摘要信息:"vc++文件的顺序读写操作" 在计算机编程中,文件的顺序读写操作是最基础的操作之一,尤其在使用C++语言进行开发时,了解和掌握文件的顺序读写操作是十分重要的。在Microsoft的Visual C++(简称VC++)开发环境中,可以通过标准库中的文件操作函数来实现顺序读写功能。 ### 文件顺序读写基础 顺序读写指的是从文件的开始处逐个读取或写入数据,直到文件结束。这与随机读写不同,后者可以任意位置读取或写入数据。顺序读写操作通常用于处理日志文件、文本文件等不需要频繁随机访问的文件。 ### VC++中的文件流类 在VC++中,顺序读写操作主要使用的是C++标准库中的fstream类,包括ifstream(用于从文件中读取数据)和ofstream(用于向文件写入数据)两个类。这两个类都是从fstream类继承而来,提供了基本的文件操作功能。 ### 实现文件顺序读写操作的步骤 1. **包含必要的头文件**:要进行文件操作,首先需要包含fstream头文件。 ```cpp #include <fstream> ``` 2. **创建文件流对象**:创建ifstream或ofstream对象,用于打开文件。 ```cpp ifstream inFile("example.txt"); // 用于读操作 ofstream outFile("example.txt"); // 用于写操作 ``` 3. **打开文件**:使用文件流对象的成员函数open()来打开文件。如果不需要在创建对象时指定文件路径,也可以在对象创建后调用open()。 ```cpp inFile.open("example.txt", std::ios::in); // 以读模式打开 outFile.open("example.txt", std::ios::out); // 以写模式打开 ``` 4. **读写数据**:使用文件流对象的成员函数进行数据的读取或写入。对于读操作,可以使用 >> 运算符、get()、read()等方法;对于写操作,可以使用 << 运算符、write()等方法。 ```cpp // 读取操作示例 char c; while (inFile >> c) { // 处理读取的数据c } // 写入操作示例 const char *text = "Hello, World!"; outFile << text; ``` 5. **关闭文件**:操作完成后,应关闭文件,释放资源。 ```cpp inFile.close(); outFile.close(); ``` ### 文件顺序读写的注意事项 - 在进行文件读写之前,需要确保文件确实存在,且程序有足够的权限对文件进行读写操作。 - 使用文件流进行读写时,应注意文件流的错误状态。例如,在读取完文件后,应检查文件流是否到达文件末尾(failbit)。 - 在写入文件时,如果目标文件不存在,某些open()操作会自动创建文件。如果文件已存在,open()操作则会清空原文件内容,除非使用了追加模式(std::ios::app)。 - 对于大文件的读写,应考虑内存使用情况,避免一次性读取过多数据导致内存溢出。 - 在程序结束前,应该关闭所有打开的文件流。虽然文件流对象的析构函数会自动关闭文件,但显式调用close()是一个好习惯。 ### 常用的文件操作函数 - `open()`:打开文件。 - `close()`:关闭文件。 - `read()`:从文件读取数据到缓冲区。 - `write()`:向文件写入数据。 - `tellg()` 和 `tellp()`:分别返回当前读取位置和写入位置。 - `seekg()` 和 `seekp()`:设置文件流的位置。 ### 总结 在VC++中实现顺序读写操作,是进行文件处理和数据持久化的基础。通过使用C++的标准库中的fstream类,我们可以方便地进行文件读写操作。掌握文件顺序读写不仅可以帮助我们在实际开发中处理数据文件,还可以加深我们对C++语言和文件I/O操作的理解。需要注意的是,在进行文件操作时,合理管理和异常处理是非常重要的,这有助于确保程序的健壮性和数据的安全。

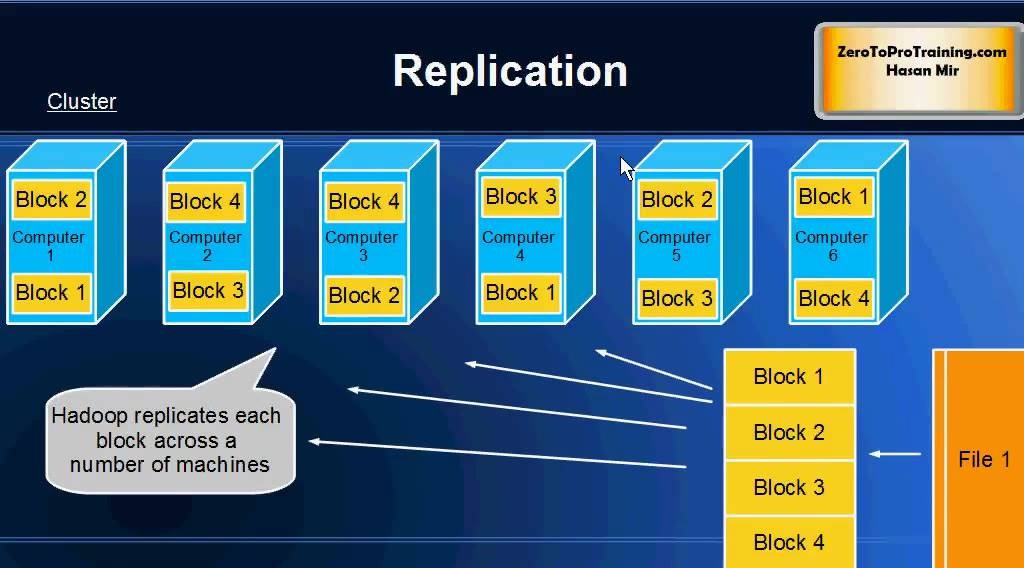

【大数据时代必备:Hadoop框架深度解析】:掌握核心组件,开启数据科学之旅

# 摘要 Hadoop作为一个开源的分布式存储和计算框架,在大数据处理领域发挥着举足轻重的作用。本文首先对Hadoop进行了概述,并介绍了其生态系统中的核心组件。深入分