DeepAR时间序列预测模型:与其他模型的比较与选择,为你量身定制最佳预测方案

发布时间: 2024-08-20 11:31:21 阅读量: 43 订阅数: 25

# 1. 时间序列预测概述

时间序列预测是一种预测未来值的技术,它利用历史数据来识别模式和趋势,并据此对未来的值进行预测。时间序列数据是按时间顺序排列的数据,例如股票价格、销售额或天气数据。时间序列预测在许多领域都有着广泛的应用,包括金融、供应链管理和医疗保健。

时间序列预测模型通常分为两类:传统模型和深度学习模型。传统模型,如 ARIMA 和 SARIMA,基于统计方法,而深度学习模型,如 DeepAR,则利用神经网络来学习时间序列数据中的复杂模式。

# 2. DeepAR模型的理论基础

### 2.1 时间序列分解与预测

时间序列是指按时间顺序排列的一系列数据点,其值随时间变化。时间序列预测的目标是根据历史数据预测未来值。

时间序列分解将原始时间序列分解为多个分量,包括:

- **趋势分量:**反映数据随时间变化的长期趋势。

- **季节分量:**反映数据在特定时间段内的周期性变化,例如每周、每月或每年。

- **残差分量:**包含趋势和季节分量之外的随机噪声。

时间序列预测通常通过对分解后的分量分别建模来实现。趋势分量可以用线性回归或指数平滑等方法预测,季节分量可以用季节性指数平滑或季节性ARIMA模型预测,残差分量可以用ARIMA或GARCH模型预测。

### 2.2 深度学习在时间序列预测中的应用

深度学习是一种机器学习技术,使用多层神经网络来从数据中学习复杂的模式。深度学习模型在时间序列预测中表现出色,原因如下:

- **强大的特征提取能力:**深度学习模型可以自动从时间序列数据中提取特征,而无需人工特征工程。

- **非线性建模能力:**时间序列数据通常具有非线性关系,深度学习模型可以捕捉这些关系。

- **序列依赖性建模能力:**深度学习模型可以考虑时间序列中数据的序列依赖性。

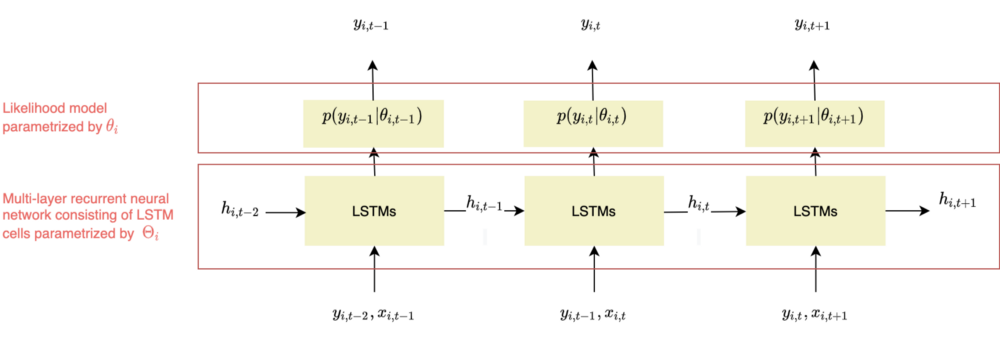

### 2.3 DeepAR模型的架构与原理

DeepAR模型是一种深度学习时间序列预测模型,由Google AI开发。DeepAR模型的架构包括:

- **编码器:**一个卷积神经网络,将输入时间序列转换为固定长度的向量表示。

- **预测器:**一个循环神经网络,对编码后的向量表示进行预测。

- **解码器:**一个全连接层,将预测结果转换为原始时间序列的预测值。

DeepAR模型的原理如下:

1. 将输入时间序列分解为趋势、季节和残差分量。

2. 使用编码器将分解后的分量转换为向量表示。

3. 使用预测器对向量表示进行预测。

4. 使用解码器将预测结果转换为原始时间序列的预测值。

DeepAR模型通过端到端训练,同时学习时间序列分解和预测。该模型可以有效捕捉时间序列中的复杂模式和序列依赖性,从而实现准确的预测。

**代码示例:**

```python

import deepar

# 导入时间序列数据

data = pd.read_csv('time_series_data.csv')

# 创建 DeepAR 模型

model = deepar.DeepARModel()

# 训练模型

model.fit(data)

# 预测未来值

predictions = model.predict(steps=10)

```

**代码逻辑分析:**

- `deepar.DeepARModel()` 创建一个 DeepAR 模型对象。

- `model.fit(data)` 使用训练数据训练模型。

- `model.predict(steps=10)` 根据训练后的模型预测未来 10 个值。

**参数说明:**

- `steps`: 预测的未来步数。

# 3. DeepAR模型的实践应

0

0