【主成分分析(PCA)在R中】: 实现与应用

发布时间: 2024-04-21 08:33:03 阅读量: 9 订阅数: 21

# 1. 主成分分析(PCA)简介

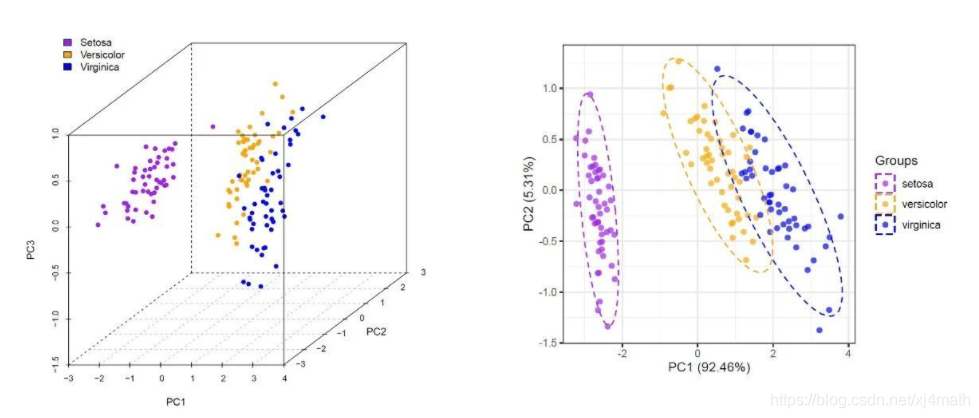

主成分分析(Principal Component Analysis,PCA)是一种常用的数据降维技术,通过将高维数据映射到低维空间,保留数据的主要信息。在实际应用中,PCA可以帮助我们更好地理解数据集的结构和特征之间的关系,同时减少数据集的复杂度。通过主成分分析,我们可以找到数据集中的主要变量,从而实现数据的降维操作。PCA算法具有简单、高效的特点,在机器学习、数据挖掘等领域具有广泛的应用。

# 2.2 PCA算法步骤

主成分分析(Principal Component Analysis, PCA)是一种常用的数据降维技术,通过线性变换将原始数据映射到一个新的特征空间,使得映射后的特征具有最大的方差。接下来我们将深入探讨PCA算法的具体步骤。

### 2.2.1 数据标准化

在实施PCA算法之前,首先要对数据进行标准化处理。数据标准化是指将原始数据按特征进行中心化和缩放,使得数据符合标准正态分布,有助于提升PCA算法的效果。

下面是一个示例代码段,对数据进行标准化处理:

```python

from sklearn.preprocessing import StandardScaler

# 实例化标准化器

scaler = StandardScaler()

# 对数据集进行标准化处理

X_scaled = scaler.fit_transform(X)

```

这里利用`StandardScaler`类对数据集`X`进行标准化处理,得到标准化后的数据`X_scaled`。

### 2.2.2 协方差矩阵计算

PCA算法的核心在于协方差矩阵的计算,协方差矩阵反映了不同特征之间的相关性。通过计算数据集的协方差矩阵,可以得到各特征之间的协方差,从而进一步进行特征的降维处理。

以下代码演示了如何计算数据集的协方差矩阵:

```python

import numpy as np

# 计算协方差矩阵

cov_matrix = np.cov(X_scaled, rowvar=False)

```

这里利用`np.cov`函数计算了标准化后的数据`X_scaled`的协方差矩阵`cov_matrix`。

### 2.2.3 特征值与特征向量计算

在PCA算法中,通过计算协方差矩阵的特征值和特征向量,可以找到数据集中最主要的特征方向,进而实现数据的降维操作。

以下是计算特征值和特征向量的示例代码:

```python

# 计算特征值和特征向量

eigenvalues, eigenvectors = np.linalg.eig(cov_matrix)

```

通过`np.linalg.eig`函数可以得到协方差矩阵`cov_matrix`的特征值`eigenvalues`和对应的特征向量`eigenvectors`。

### 2.2.4 数据降维

最后一步是实现数据的降维操作,即将原始数据投影到特征向量构成的新空间中。通过选取部分特征值较大的特征向量,可以实现数据的降维处理。

下面是降维操作的示例代码:

```python

# 选择主成分个数

n_components = 2

# 取最大的n_components个特征向量

top_eigenvectors = eigenvectors[:, :n_components]

# 数据降维

X_pca = np.dot(X_scaled, top_eigenv

```

0

0