从实践中学习Pygments.lexers:案例分析与应用技巧

发布时间: 2024-10-08 02:26:45 阅读量: 4 订阅数: 8

# 1. Pygments.lexers基础入门

Pygments 是一个非常流行的代码语法高亮库,它支持多种编程语言。在这一章中,我们将介绍 Pygments.lexers 的基础概念,它在 Pygments 中扮演的角色以及如何用于基础的代码高亮处理。

## 1.1 Pygments 和 Pygments.lexers 简介

Pygments 通过将源代码文本分解成标记(token)的方式来实现语法高亮。而 Pygments.lexers 是这个过程中使用的一个组件,它负责对源代码文本进行词法分析,将文本转换成标记的集合。这些标记之后被 Pygments 的样式化模块使用,生成带有颜色和格式的代码展示。

## 1.2 安装 Pygments 及其 lexers

在使用 Pygments.lexers 之前,首先需要安装 Pygments 库。可以使用 Python 的包管理工具 `pip` 来安装:

```shell

pip install Pygments

```

安装后,可以通过 Python 的命令行工具 `pygmentize` 来进行基本的语法高亮:

```shell

pygmentize -f html -O full,style=monokai -o output.html input.py

```

上述命令会将 `input.py` 文件的内容进行语法高亮处理,并输出为 HTML 格式到 `output.html` 文件,同时使用 `monokai` 风格。

## 1.3 Pygments.lexers 的基本使用

在 Python 程序中使用 Pygments.lexers 相对简单。以下是一个基本示例,演示如何通过 Pygments 获取并使用一个 lexer(词法分析器)来高亮显示代码:

```python

from pygments import lexers

from pygments.lexers.web import PhpLexer

from pygments.formatters.html import HtmlFormatter

# 获取 PHP 代码

php_code = open('example.php', 'r').read()

# 使用 PhpLexer 对 PHP 代码进行词法分析

lexer = PhpLexer()

# 为分析出的标记生成 HTML 代码

html_code = pygments.highlight(php_code, lexer, HtmlFormatter())

# 输出高亮后的 HTML

print(html_code)

```

在上述代码中,首先导入了 `Pygments` 库中的 `lexers` 和 `formatters.html` 模块,然后读取了一个 PHP 文件的内容,并使用 `PhpLexer` 分析器进行处理。最后,使用 `HtmlFormatter` 将分析后的标记转换成 HTML 格式并输出。

以上为 Pygments.lexers 的基础入门,它为接下来更深入的探讨与应用打下了基础。在下一章中,我们将深入探究 Pygments.lexers 的工作原理,以及如何实现自定义的词法分析器,进一步优化和配置以满足更复杂的使用场景。

# 2. 深入探究Pygments.lexers机制

### 2.1 Pygments.lexers的工作原理

#### 2.1.1 解析器的结构与组成

Pygments的解析器(lexers)是其核心组件之一,它们负责将源代码文本转换为标记流(tokens),这些标记随后用于生成语法高亮的输出。解析器通常由以下几个部分组成:

- **正则表达式规则**:这些规则定义了如何从源代码中识别特定的语法结构,如关键字、注释、字符串等。

- **状态机**:状态机管理解析过程中的各种状态,以正确识别嵌套和复杂结构。

- **后处理方法**:有时候需要对识别的标记进行进一步处理,例如将连续的字符串标记合并成一个完整的字符串。

下面是关于Pygments.lexers结构的简图:

```mermaid

flowchart LR

A[输入源代码] -->|规则匹配| B[状态机]

B -->|标记生成| C[标记流]

C -->|后处理| D[优化后的标记流]

```

#### 2.1.2 词法分析的过程详解

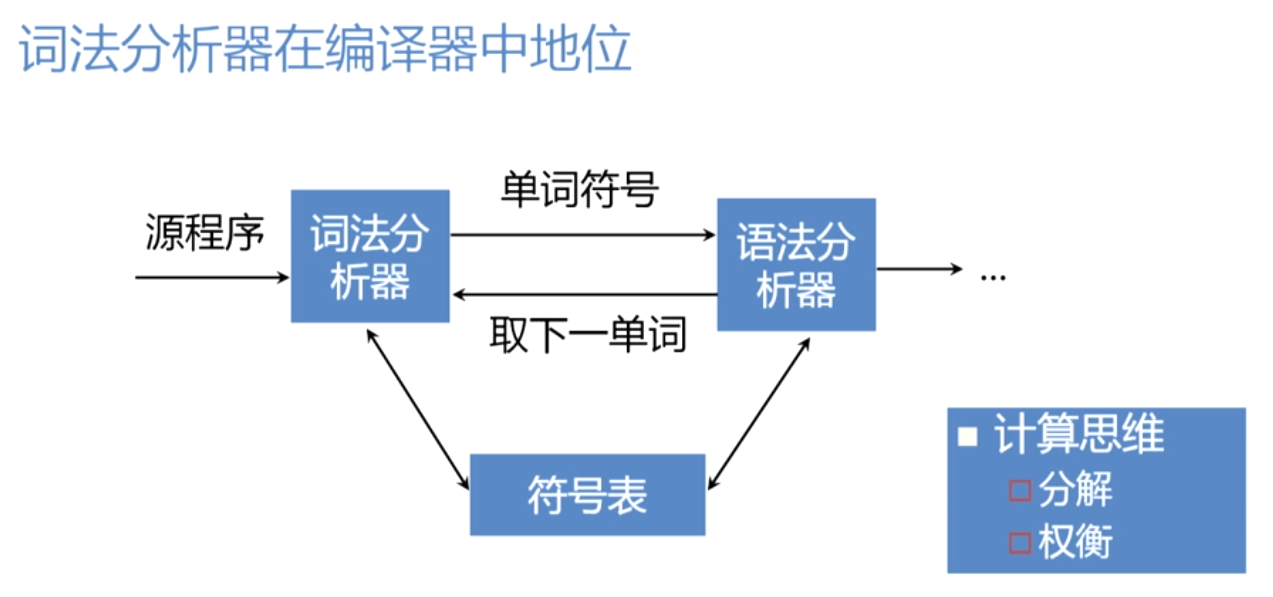

词法分析是编译过程的第一阶段,主要任务是读入源程序的字符序列,将它们转换成有意义的词素序列,并为每个词素生成对应的标记。Pygments的词法分析过程可以分为以下步骤:

1. **初始化状态机**:设置解析器的起始状态。

2. **逐字符扫描**:解析器逐字符读取源代码。

3. **应用正则表达式规则**:每遇到一个字符,解析器就根据当前状态和规则尝试匹配。

4. **状态转换和标记输出**:匹配成功后,解析器会进行状态转换,并输出相应的标记。

5. **错误处理**:如果遇到无法匹配的字符或结构,解析器会尝试错误恢复或报告错误。

```python

from pygments.lexers import PythonLexer

# 示例代码

lexer = PythonLexer()

text = "print('Hello, world!')"

tokens = list(lexer.get_tokens(text))

# 输出标记

for token in tokens:

print(token)

```

### 2.2 Pygments.lexers的自定义实现

#### 2.2.1 创建自定义词法分析器

在某些情况下,Pygments自带的词法分析器可能无法满足特定需求,例如为尚未广泛使用的新兴编程语言提供词法分析,或者为现有语言的特定方言定制分析器。创建自定义词法分析器的过程包括:

1. **继承并扩展基类**:创建一个新的类,继承自`RegexLexer`,并重写初始化方法来定义自己的规则。

2. **定义正则表达式规则**:为新语言的语法结构定义适当的正则表达式。

3. **测试和调试**:编写测试用例并调试,直到解析器能正确处理代码样例。

```python

from pygments.lexers._mapping import LEXERS

from pygments.lexers.text import TextLexer

from pygments.lexers._specials import GenericConsoleLexer

from pygments.lexers._classes import RegexLexer

from pygments.token import *

class CustomLexer(RegexLexer):

name = 'Custom'

aliases = ['custom']

filenames = ['*.cust']

mimetypes = []

tokens = {

'root': [

(r'#.*?$', Comment.Single),

(r'\s+', Text),

# ... 其他自定义规则 ...

]

}

```

#### 2.2.2 扩展现有词法分析器

有时候,对现有的词法分析器只需要进行小幅度的扩展。例如,如果你在使用Python词法分析器,但需要为Python添加对某个新框架的特定语法高亮,可以继承现有的`PythonLexer`类,并添加额外的规则:

```python

from pygments.lexers.python import PythonLexer

class ExtendedPythonLexer(PythonLexer):

name = 'Extended Python'

aliases = ['ext-python']

filenames = ['*.ext-python']

def get_tokens_unprocessed(self, text):

for index, token, value in RegexLexer.get_tokens_unprocessed(self, text):

# 在这里添加额外的逻辑来处理新的语法结构

# ...

yield index, token, value

```

### 2.3 Pygments.lexers的配置与优化

#### 2.3.1 配置选项深入解析

Pygments提供了许多配置选项,允许用户根据需要定制化词法分析器的行为。这些选项包括但不限于:

- **忽略特定类型错误**:在解析时忽略语法错误。

- **启用或禁用特定的高亮特性**:如为特定语言关闭代码折叠。

- **调整标记的样式**:通过CSS为不同的标记类型指定样式。

```python

from pygments import formatters, highlight

from pygments.lexers import PythonLexer

from pygments.styles import get_style_by_name

# 使用特定风格

style = get_style_by_name('friendly')

lexer = PythonLexer()

formatter = formatters.HtmlFormatter(full=True, style=style)

# 高亮代码

highlight(text, lexer, formatter)

```

#### 2.3.2 性能优化与最佳实践

性能优化是任何代码库中不可忽视的部分,尤其对于处理大量文本的任务。优化Pygments.lexers时可以遵循以下最佳实践:

- **使用缓存**:对解析结果进行缓存,避免重复解析相同代码片段。

- **减少正则表达式复杂度**:简化正则表达式可以显著提升解析速度。

- **选择合适的解析器**:针对特定语言选用最优化的解析器。

- **利用并行处理**:在多核处理器上,可以并行化高亮处理任务以提高性能。

```python

import time

from concurrent.futures import ThreadPoolExecutor

def highlight_code(code, lexer, formatter):

return highlight(code, lexer, f

```

0

0