代码问题快速定位:Pygments.lexers的调试与分析秘籍

发布时间: 2024-10-08 01:55:01 阅读量: 18 订阅数: 25

# 1. Pygments.lexers简介与作用

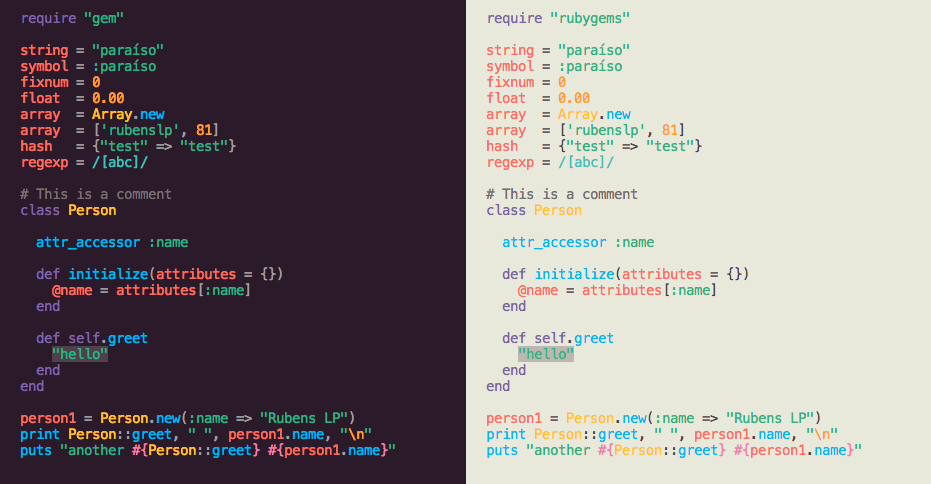

Pygments 是一个广泛使用的 Python 语法高亮库,它为超过 300 种编程语言提供了支持。Pygments 的核心组件之一是 lexers,它们负责解析源代码并输出带有格式的文本。lexers 的主要作用是将源代码转换成 Pygments 可以理解的标记(token),这一步骤是代码高亮显示和进一步语法分析的基础。

本章将深入探讨 Pygments.lexers 的基本概念、作用以及如何在代码处理中应用这些lexer。首先,我们将介绍 lexers 如何在代码高亮显示过程中发挥作用,并展示如何利用 lexers 提升代码编辑器的用户体验。接下来,我们将通过示例展示 lexers 的实际应用,从而帮助读者理解它们在提高开发效率方面的重要性。

```python

from pygments import lexers, highlight

from pygments.formatters import TerminalTrueColorFormatter

from pygments.lexers import PythonLexer

source_code = "print('Hello, World!')"

lexer = PythonLexer()

formatted_code = highlight(source_code, lexer, TerminalTrueColorFormatter())

print(formatted_code)

```

通过上述示例代码,我们可以看到如何使用 PythonLexer 来解析 Python 代码,并利用 TerminalTrueColorFormatter 为终端输出高亮的代码。这仅是 Pygments.lexers 的冰山一角,下一章将进一步深入 lexers 的内部机制。

# 2. Pygments.lexers的内部机制

### 2.1 Pygments.lexers的工作原理

#### 2.1.1 Lexers在代码高亮中的角色

Pygments库中的lexers是代码高亮处理过程中的关键组件。它们的作用是将源代码分解成一系列的Token(标记),每个Token代表了代码中的一个逻辑单元,比如关键字、符号、字符串等。通过这种分解,Pygments可以为不同类型的Token应用不同的样式规则,从而实现高亮显示。Lexers为整个代码高亮处理提供基础,它们决定了代码的哪些部分会被高亮以及如何高亮。

#### 2.1.2 词法分析的流程和方法

词法分析是代码高亮处理的第一步,它将原始代码转换成Token序列。词法分析的主要流程如下:

1. **读取源代码**:词法分析器首先读取源代码文件。

2. **识别Token**:分析器会根据预定义的模式(正则表达式或状态机)识别源代码中的Token。

3. **忽略空白和注释**:通常空白字符和注释会被过滤掉,除非特别定义了要对它们进行高亮。

4. **生成Token序列**:分析器生成一个Token序列,并传递给后续的语法分析器或直接用于渲染高亮显示。

在Pygments中,词法分析的方法是通过正则表达式和状态机。每种lexer都定义了一套规则集,规则集由多个正则表达式组成,每个表达式对应一种Token类型。状态机用于处理更复杂的语法结构,使得lexer可以正确识别嵌套的代码结构,如多行字符串、注释块等。

### 2.2 Pygments.lexers的组成元素

#### 2.2.1 Token的定义和分类

在Pygments的词法分析过程中,Token是构成代码逻辑结构的基本单位。Token可以被分类为不同的类型,例如:

- 关键字(Keywords)

- 符号(Symbols)

- 标识符(Identifiers)

- 字符串(Strings)

- 数字(Numbers)

- 注释(Comments)

- 等等

Token的定义包括类型、内容和位置信息。它们是词法分析器将源代码分解得到的结果,后续的语法分析和渲染步骤将基于这些Token进行操作。

#### 2.2.2 Token与lexer的交互方式

Token与lexer的交互主要体现在Token的生成与消费过程中。当lexer识别出一个Token时,它会根据Token的类型应用相应的样式规则。这些规则可以是简单的样式颜色指定,也可以是更复杂的样式处理,例如字体加粗、斜体等。

Token生成后,通常会通过事件系统传递给消费者。在Pygments中,消费者可以是前端渲染模块,也可以是中间件用于进行其他代码处理任务。Token序列通过这种方式在Pygments的架构中流转,最终实现了代码的高亮显示。

#### 2.2.3 状态机在lexers中的应用

状态机是处理复杂词法分析任务的重要工具。在Pygments中,状态机用于处理诸如字符串的界定、注释的界定以及预处理器指令的识别等复杂情况。每个状态机都包含一组状态,以及在特定状态下如何根据输入字符转换到另一状态或生成Token的规则。

例如,一个多行字符串的分析可能需要一个状态来表示是否已经看到了开始界定符,另一个状态来表示是否已经看到了结束界定符,以及处理字符串内部换行和转义序列的情况。状态机的引入使得lexer可以灵活处理这些复杂的语法结构。

```mermaid

stateDiagram-v2

[*] --> Initial

Initial --> String:Enter String State

String --> Escaped:Detect Escape Sequence

String --> Normal:Detect End of String

Escaped --> String:Reset to String State

Normal --> [*]:Return to Initial State

Escaped --> [*]:Handle Escaped Character

```

在上述流程图中,可以看到状态机的简化表示,其中包含初始状态、字符串状态、转义状态等。状态机在接收到输入时会根据当前状态和输入转换状态或生成Token。

### 2.3 Pygments.lexers的扩展性和定制性

#### 2.3.1 如何创建自定义lexer

创建自定义lexer是Pygments灵活性的一个重要体现。开发自定义lexer的步骤通常如下:

1. **定义lexer类**:继承`RegexLexer`或其他基类,并设置语言名称和别名。

2. **编写规则集**:定义Token类型及其对应的正则表达式。

3. **状态转换**:如果需要,定义状态机及其状态转换规则。

4. **样式定义**:为不同的Token定义样式,例如字体、颜色等。

5. **测试lexer**:确保lexer能正确处理各种输入,并对结果进行样式渲染。

下面是一个简单的自定义lexer示例:

```python

from pygments.lexer import RegexLexer, bygroups

from pygments.token import *

class CustomLexer(RegexLexer):

name = 'CustomLexer'

aliases = ['cst']

filenames = ['*.cst']

tokens = {

'root': [

(r'\s+', Text),

(r'//.*?$', Comment.Single),

(r'/\*.*?\*/', Comment.Multi),

(r'[\[\](){}]', Punctuation),

(r'important\b', Keyword.Reserved, 'important-block'),

],

'important-block': [

(r'\s+', Text),

(r'\w+', Keyword.Reserved),

('', Text,回到了'root'),

],

}

```

#### 2.3.2 继承和修改现有lexer的方法

除了创建全新的lexer外,Pygments还支持从现有的lexer继承并进行修改,这是一种更加高效和便捷的定制方法。通过继承,开发者可以专注于新增或修改特定的Token规则,而不必

0

0