【R语言高级开发】:性能基准测试与调优实战(性能黑客)

发布时间: 2024-11-06 16:40:52 阅读量: 34 订阅数: 44

一个基于Qt Creator(qt,C++)实现中国象棋人机对战

# 1. R语言性能基准测试基础

在使用R语言进行数据处理和分析的过程中,性能成为衡量代码质量的一个重要指标。性能基准测试是优化R语言代码的重要手段,它帮助开发者识别性能瓶颈,了解代码运行效率,进而在数据处理和科学计算中获得更高的效率和更好的用户体验。

基准测试不仅仅是简单地运行一段代码,更重要的是通过科学的方法和工具来测量和比较代码在不同条件下的运行时间、内存消耗等关键性能指标。这样,开发者可以有根据地对代码进行优化,确保在实际应用中的性能表现。

在进行性能基准测试前,了解R语言的运行机制和性能特点是非常有必要的。我们将从R语言的基础性能测试出发,逐步深入到代码优化的理论与实践,探索如何通过基准测试来优化R语言程序的性能。

# 2. R语言代码优化理论

## 2.1 R语言数据结构优化

### 2.1.1 向量化原理与实践

向量化是R语言中一个重要的性能优化策略,它涉及将循环操作替换为向量化的表达式,以此来提高代码的执行效率。向量化操作能够利用R的底层C语言实现,进行批量处理,减少显式循环的开销。

以一个简单的例子来说明向量化的实际应用。假设我们想要计算两个向量的元素之和:

```r

vector1 <- 1:1000

vector2 <- 1001:2000

sum_result <- vector1 + vector2

```

在上面的代码中,我们直接对两个向量进行加法操作。R语言会自动将这个操作向量化,逐元素地进行计算,速度远快于循环中的逐个计算。

通过向量化,R代码中原本需要多次循环迭代的操作,可以转变为单次操作。它不仅简化了代码,还减少了内存访问次数,因为R会一次性加载整个向量到内存中进行操作。

### 2.1.2 矩阵和数组的操作效率

矩阵和数组在R语言中是非常常见的数据结构,尤其在数据分析和统计计算中广泛应用。在这些高维数据结构的操作中,使用专门的函数和操作符进行操作,可以显著提高效率。

矩阵乘法是一个典型的例子,R语言提供了 `%*%` 操作符进行矩阵乘法,它同样是优化过的,可以在后台调用高效的线性代数库,如BLAS或者LAPACK,来完成计算。

下面是一个矩阵乘法的例子:

```r

A <- matrix(1:100, ncol = 10)

B <- matrix(101:200, nrow = 10)

C <- A %*% B

```

在R中,如果试图通过嵌套循环来实现矩阵乘法,将会显著降低性能。而使用 `%*%` 操作符,R会利用其背后的数学库来快速完成这一操作。对于数组操作,`apply` 函数也是一个常用且高效的工具,它可以对数组的维度应用函数,而不需要显式编写循环。

### 2.2 R语言内存管理策略

#### 2.2.1 内存占用的监控方法

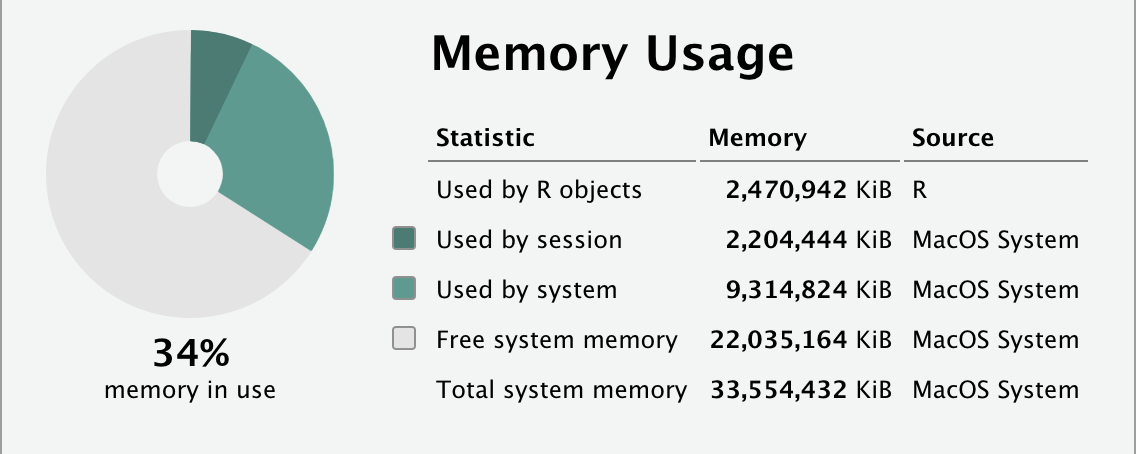

在进行大数据分析时,内存的使用情况是影响性能的关键因素之一。R提供了一些工具和方法来监控和管理内存使用。

我们可以使用`memory.size()`函数来查看当前R进程使用的内存大小,而`gc()`函数(垃圾收集器)可以帮助释放不再使用的内存空间。

```r

memory.size()

gc()

```

除了这些基础函数,R还有一些扩展包可以用于更深入的内存监控,比如`Rprof`和`tracemem`。这些工具可以帮助开发者分析内存使用的热点,追踪内存泄露等问题。

#### 2.2.2 内存优化技巧

要有效管理R中的内存使用,可以遵循一些实践策略。例如:

- 尽量使用向量化操作替代循环。

- 利用R的`data.table`包来处理大数据集,这个包在内存使用和执行效率上都做了优化。

- 避免创建不必要的临时变量。每次赋值操作都会消耗内存。

- 理解函数作用域。在函数内部创建的局部变量在函数执行完毕后会自动被清理,这有助于减少内存占用。

在R中,还可以通过`rm()`函数显式地删除不再需要的对象来释放内存:

```r

rm(list=ls()) # 清除所有对象

gc() # 进行垃圾收集

```

### 2.3 R语言的并行计算能力

#### 2.3.1 并行计算的基本概念

并行计算是提高计算性能的一个重要手段,它通过多个计算单元同时工作来解决同一个问题,从而缩短计算时间。R语言虽然本身是一个单线程的解释型语言,但是它支持通过多种方法实现并行计算。

在R中,可以使用`parallel`包来实现并行计算。该包提供了许多并行操作的函数,如`mclapply`(多核版本的`lapply`)和`parLapply`(并行lapply)等。

#### 2.3.2 R语言并行计算的实现方式

实现R语言并行计算的一个典型例子是使用`parLapply`函数进行并行化操作:

```r

library(parallel)

cl <- makeCluster(2) # 启动两个工作节点

clusterExport(cl, "vector1") # 导出需要的变量到工作节点

result <- parLapply(cl, 1:10, function(i) {

sum(vector1 * i)

})

stopCluster(cl) # 停止工作节点

```

在这个例子中,我们创建了一个包含两个工作节点的集群,然后对一个向量的每个元素执行了并行操作。每个节点都收到了数据的一个子集,并独立地执行了乘法和求和操作。

为了进一步优化并行计算,可以考虑数据分区和负载平衡。这些技术可以帮助在并行任务之间分配工作负载,从而更有效地使用资源。R语言的并行计算还在不断发展中,各种新的包和方法在不断地涌现,提供了更加灵活和强大的并行计算功能。

## 2.2 R语言内存管理策略

### 2.2.1 内存占用的监控方法

R语言提供了简单的内存管理函数,允许用户监控和管理内存使用。在进行复杂的数据分析任务时,内存使用情况可能成为性能瓶颈,因此监控内存的占用对于性能优化至关重要。

R的内存监控可以通过内置的`mem.max()`函数来进行,该函数提供了当前R进程的最大内存占用情况。此外,`gc()`函数(垃圾收集器)可以用来触发内存的自动清理过程,该函数能够帮助开发者识别内存泄漏和优化内存使用。

```r

mem.max() # 获取当前R进程的最大内存使用量

gc() # 调用垃圾收集器

```

### 2.2.2 内存优化技巧

在R语言中,内存优化是提高性能的一个关键步骤。这里有一些内存优化的技巧:

1. **避免在循环中创建大型对象**:每次创建大型对象都会消耗大量内存,而且如果对象频繁创建和删除,还会产生内存碎片。

2. **使用`data.table`包**:`data.table`是R语言中的一个包,用于处理大型数据集,它在内存使用效率上进行了优化,适合大数据的快速处理。

3. **预先分配内存空间**:在循环开始之前,预先为循环中的数据分配好足够的空间,这可以减少内存重新分配的次数,从而提高性能。

4. **优化数据结构**:选择合适的数据结构可以有效减少内存占用,例如使用矩阵或数组而非列表来存储数值型数据。

例如,使用`data.table`可以显著减少内存使用:

```r

library(data.table)

df <- data.frame(x = rnorm(1e6), y = rnorm(1e6))

dt <- data.table(x = rnorm(1e6), y = rnorm(1e6))

object.size(df) # 查看data.frame的内存占用

object.size(dt) # 查看data.table的内存占用

```

通过比较`data.frame`与`data.table`的内存使用情况,可以明显发现`data.table`对于内存的优化效果。这些优化技巧的组合使用,能够使R语言的应用更加高效和稳定。

# 3. R语言性能基准测试工具

性能基准测试是衡量软件性能的一种技术手段,通过精确的测量和分析,可以帮助我们发现代码的瓶颈并进行优化。在R语言中,基准测试工具的使用对于编写高性能的代码尤为重要。

## 3.1 微基准测试

### 3.1.1 微基准测试的必要性

微基准测试是针对程序中非常小的部分进行的性能测试。尽管它不能全面反映整个应用的性能表现,但微基准测试对于优化代码中关键部分的性能至关重要。通过微基准测试,我们可以获得对代码执行时间的精确测量,从而对特定算法或函数调用进行细致的性能评估。

### 3.1.2 微基准测试工具的使用方法

在R语言中,我们可以使用`microbenchmark`包来进行微基准测试。以下是使用`microbenchmark`进行测试的一个基本示例:

```R

# 安装microbenchmark包

if

```

0

0