Yolov5 模型优化技巧初探

发布时间: 2024-05-01 12:23:12 阅读量: 9 订阅数: 25

# 1. Yolov5模型基础**

Yolov5是目前最先进的实时目标检测模型之一,它以其速度和准确性而闻名。Yolov5模型是一个卷积神经网络(CNN),它将输入图像划分为一个网格,并为每个网格单元预测边界框和类概率。

Yolov5模型的架构由一个主干网络和一个检测头组成。主干网络是一个预训练的图像分类模型,例如ResNet或Darknet。检测头是一个附加在主干网络上的小网络,用于预测边界框和类概率。

Yolov5模型的训练过程包括两个阶段:预训练和微调。在预训练阶段,主干网络在ImageNet数据集上进行训练。在微调阶段,检测头被添加到主干网络上,并在目标检测数据集上进行训练。

# 2. Yolov5模型优化理论

### 2.1 模型压缩技术

模型压缩技术旨在通过减少模型大小或计算复杂度来优化模型,而不会显著降低模型的准确性。常用的模型压缩技术包括量化和剪枝。

#### 2.1.1 量化

量化是一种将模型参数从浮点数转换为低精度格式(如int8或int16)的技术。这可以显著减少模型大小和计算成本,同时保持与原始模型相当的准确性。

**参数说明:**

- **浮点数:**通常使用32位浮点数来表示模型参数,精度高但存储空间大。

- **低精度格式:**如int8或int16,使用更少的位数来表示参数,从而减少存储空间。

**代码块:**

```python

import torch

from torch.quantization import QuantStub, DeQuantStub

# 定义量化模型

model = torch.nn.Sequential(

QuantStub(),

torch.nn.Linear(10, 10),

DeQuantStub()

)

# 量化模型

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

model = torch.quantization.prepare(model, inplace=True)

model = torch.quantization.convert(model, inplace=True)

```

**逻辑分析:**

- `QuantStub()`和`DeQuantStub()`模块将模型输入和输出转换为量化格式。

- `torch.quantization.get_default_qconfig('fbgemm')`获取默认的量化配置,包括量化算法和激活函数量化。

- `torch.quantization.prepare()`将模型转换为训练模式,并插入量化操作。

- `torch.quantization.convert()`将模型转换为推理模式,并应用量化参数。

#### 2.1.2 剪枝

剪枝是一种移除模型中不重要的权重和神经元的技术。这可以减少模型大小和计算复杂度,同时保持模型的准确性。

**参数说明:**

- **不重要权重:**对模型输出影响较小的权重。

- **不重要神经元:**对模型输出影响较小的神经元。

**代码块:**

```python

import torch

from torch.nn.utils import prune

# 定义剪枝模型

model = torch.nn.Sequential(

torch.nn.Linear(10, 10),

torch.nn.ReLU()

)

# 剪枝模型

prune.l1_unstructured(model.linear, name="weight", amount=0.2)

prune.ln_structured(model.linear, name="weight", amount=0.2, n=2)

```

**逻辑分析:**

- `prune.l1_unstructured()`对线性层的权重进行非结构化剪枝,根据权重绝对值大小移除一定比例的权重。

- `prune.ln_structured()`对线性层的权重进行结构化剪枝,根据权重绝对值大小移除一定比例的通道。

### 2.2 模型加速技术

模型加速技术旨在通过并行计算或知识蒸馏来提高模型的推理速度。

#### 2.2.1 并行计算

并行计算是一种将模型计算任务分配给多个处理单元(如GPU或CPU)的技术。这可以显著提高推理速度。

**参数说明:**

- **数据并行:**将同一批次的数据分配给不同的处理单元进行计算。

- **模型并行:**将模型的不同部分分配给不同的处理单元进行计算。

**代码块:**

```python

import torch

import torch.nn.parallel

# 定义数据并行模型

model = torch.nn.DataParallel(model)

# 数据并行推理

input_data = torch.rand(1, 3, 224, 224)

output = model(input_data)

```

**逻辑分析:**

- `torch.nn.DataParallel()`将模型包装成数据并行模型。

- 在推理时,输入数据被分发到不同的GPU上进行计算,然后将结果聚合在一起。

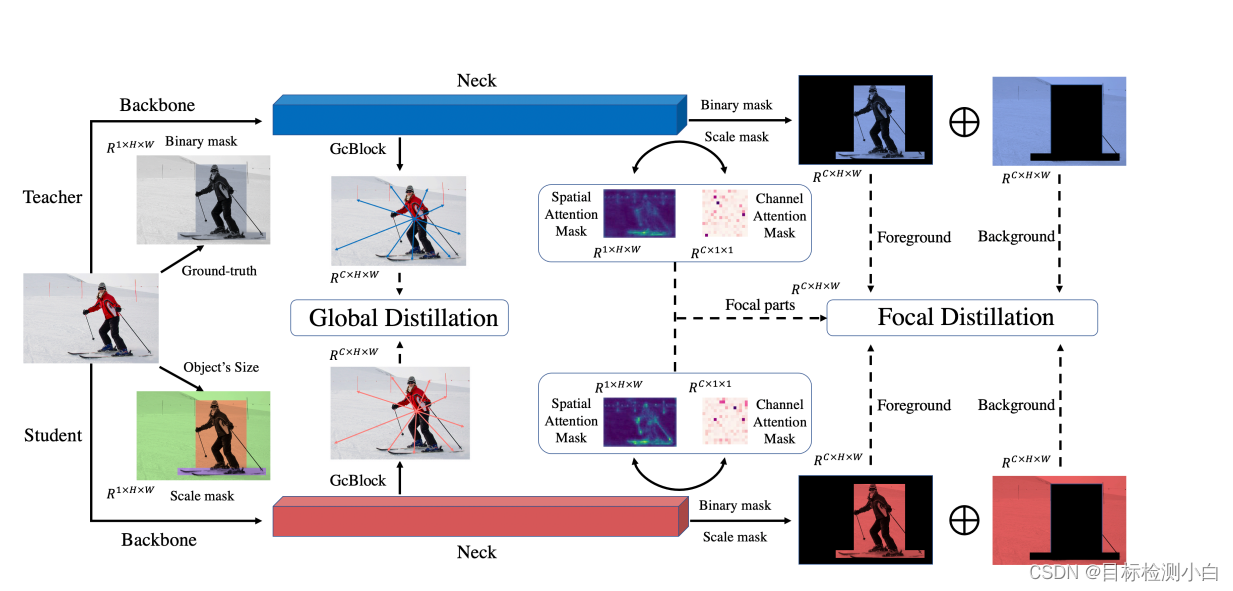

#### 2.2.2 知识蒸馏

知识蒸馏是一种将教师模型的知识转移到学生模型的技术。学生模型通常比教师模型更小、更轻量级,但可以达到与教师模型相当的准确性。

**参数说明:**

- **教师模型:**一个准确但计算量大的模型。

- **学生模型:**一个较小、较轻量级的模型。

**代码块:**

```python

import torch

from torch.nn import CrossEntropyLoss

from torch.optim import Adam

# 定义教师模型和学生模型

teacher_model = torch.nn.Linear(10, 10)

student_model = torch.nn.Linear(10, 10)

# 定义知识蒸馏损失函数

loss_fn = CrossEntropyLoss()

# 训练学生模型

optimizer = Adam(student_model.parameters())

for epoch in range(10):

# 正向传播

teacher_output = teacher_model(input_data)

student_output = student_model(input_data)

# 计算知识蒸馏损失

loss = loss_fn(student_output, teacher_output)

# 反向传播

loss.backward()

# 更新参数

optimizer.step()

```

**逻辑分析:**

- 在训练学生模型时,除了计算分类损失外,还计算知识蒸馏损失,该损失将学生模型的输出与教师模型的输出进行比较。

- 知识蒸馏损失迫使学生模型学习教师模型的输出分布,从而提高学生模型的准确性。

# 3. Yolov5模型优化实践

### 3.1 量化优化

量化是一种模型压缩技术,通过降低模型中参数和激活值的精度来减少模型大小和计算成本。量化可以分为两类:整型量化和浮点量化。

#### 3.1.1 PyTorch量化工具

PyTorch提供了全面的量化工具,包括`torch.quantization`模块和`torch.ao.quantization`模块。

- `torch.quantization`模块用于动态量化,在训练过程中进行量化。

- `torch.ao.quantization`模块用于静态量化,在训练后进行量化。

```python

import torch

from torch.quantization import quantize_dynamic

# 动态量化

model = torch.quantization.quantize_dynamic(model, {torch.nn.Linear}, dtype=torch.qint8)

# 静态量化

model = torch.ao.quantization.quantize(model, {torch.nn.Linear}, dtype=torch.qint8)

```

#### 3.1.2 量化模型部署

量化模型的部署需要使用特定的推理引擎,例如:

- **PyTorch Lite**:PyTorch提供的轻量级推理引擎,支持量化模型的部署。

- **TensorRT**:NVIDIA提供的推理引擎,支持高性能的量化模型部署。

```python

# 使用PyTorch Lite部署量化模型

import torch.jit

# 导出量化模型

scripted_model = torch.jit.script(model)

traced_model = torch.jit.trace(model, torch.rand(1, 3, 224, 224))

# 优化量化模型

optimized_model = torch.jit.optimize_for_mobile(traced_model)

# 保存量化模型

optimized_model.save("quantized_model.ptl")

```

### 3.2 剪枝优化

剪枝是一种模型压缩技术,通过移除不重要的神经元和连接来减少模型大小和计算成本。剪枝算法可以分为两类:结构化剪枝和非结构化剪枝。

#### 3.2.1 剪枝算法

- **结构化剪枝**:移除整个神经元或通道。

- **非结构化剪枝**:移除单个权重或连接。

#### 3.2.2 剪枝模型评估

剪枝模型的评估需要使用特定的指标,例如:

- **准确率**:剪枝后模型的准确率与原始模型的准确率之间的差异。

- **FLOPs**:剪枝后模型的浮点运算次数与原始模型的浮点运算次数之间的差异。

- **模型大小**:剪枝后模型的大小与原始模型的大小之间的差异。

```python

# 使用结构化剪枝算法

import torch.nn.utils.prune as prune

# 创建剪枝模块

prune.L1Unstructured(model.conv1, name="weight", amount=0.2)

# 训练剪枝模型

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

for epoch in range(10):

# 训练模型

# ...

# 剪枝模型

prune.remove(model.conv1, "weight")

```

# 4. Yolov5模型加速**

**4.1 并行计算优化**

并行计算是一种通过同时使用多个处理单元来解决计算问题的技术。在Yolov5模型优化中,并行计算可以提高模型的推理速度。

**4.1.1 数据并行**

数据并行是一种并行计算技术,它将训练数据拆分为多个子集,并将其分配给不同的处理单元进行处理。每个处理单元负责训练模型的一个子集,并在训练完成后将结果合并。数据并行可以有效地提高模型训练速度,但它对模型的并行性要求较高。

**代码块:**

```python

import torch.nn.parallel as nn

model = nn.DataParallel(model)

```

**逻辑分析:**

该代码块使用PyTorch的DataParallel模块将模型包装为数据并行模型。DataParallel模块将训练数据拆分为多个子集,并将其分配给不同的GPU进行处理。

**参数说明:**

* `model`: 要并行化的模型。

**4.1.2 模型并行**

模型并行是一种并行计算技术,它将模型拆分为多个子模型,并将其分配给不同的处理单元进行处理。每个处理单元负责训练模型的一个子模型,并在训练完成后将结果合并。模型并行可以有效地提高模型推理速度,但它对模型的并行性要求更高。

**代码块:**

```python

import torch.distributed as dist

model = nn.parallel.DistributedDataParallel(model)

```

**逻辑分析:**

该代码块使用PyTorch的DistributedDataParallel模块将模型包装为模型并行模型。DistributedDataParallel模块将模型拆分为多个子模型,并将其分配给不同的GPU进行处理。

**参数说明:**

* `model`: 要并行化的模型。

* `dist`: PyTorch的分布式通信模块。

**4.2 知识蒸馏优化**

知识蒸馏是一种模型压缩技术,它通过将一个大型模型的知识转移到一个较小的模型中来提高模型的推理速度。在Yolov5模型优化中,知识蒸馏可以有效地提高模型的推理速度,同时保持较高的精度。

**4.2.1 蒸馏模型构建**

蒸馏模型构建需要两个模型:一个大型的教师模型和一个较小的学生模型。教师模型是一个经过大量数据训练的模型,而学生模型是一个较小的模型,其结构和参数与教师模型不同。

**代码块:**

```python

teacher_model = torch.load('teacher_model.pt')

student_model = torch.load('student_model.pt')

```

**逻辑分析:**

该代码块加载了教师模型和学生模型。

**参数说明:**

* `teacher_model`: 教师模型的文件路径。

* `student_model`: 学生模型的文件路径。

**4.2.2 蒸馏模型训练**

蒸馏模型训练需要一个训练数据集和一个损失函数。训练数据集是用于训练学生模型的数据集,而损失函数是用于衡量学生模型和教师模型输出之间的差异。

**代码块:**

```python

loss_fn = nn.MSELoss()

optimizer = torch.optim.Adam(student_model.parameters())

for epoch in range(num_epochs):

for batch in train_loader:

inputs, labels = batch

outputs = student_model(inputs)

loss = loss_fn(outputs, teacher_model(inputs))

optimizer.zero_grad()

loss.backward()

optimizer.step()

```

**逻辑分析:**

该代码块训练了学生模型。训练过程包括以下步骤:

1. 计算学生模型和教师模型的输出之间的损失。

2. 将损失反向传播到学生模型中。

3. 更新学生模型的参数。

**参数说明:**

* `loss_fn`: 损失函数。

* `optimizer`: 优化器。

* `num_epochs`: 训练的轮数。

* `train_loader`: 训练数据集加载器。

* `inputs`: 输入数据。

* `labels`: 标签。

* `outputs`: 学生模型的输出。

# 5.1 优化技巧总结

通过对 Yolov5 模型的优化实践,我们总结了以下优化技巧:

- **量化优化:**采用 PyTorch 量化工具,将浮点权重和激活转换为低精度整数,显著减少模型大小和内存占用。

- **剪枝优化:**利用剪枝算法,移除模型中不重要的连接和权重,进一步减小模型大小和计算量。

- **并行计算优化:**采用数据并行或模型并行,将模型计算任务分配到多个 GPU 上,提高训练和推理速度。

- **知识蒸馏优化:**构建一个轻量级的学生模型,从一个大型的教师模型中学习知识,实现模型加速和性能提升。

## 5.2 优化效果评估

优化后的 Yolov5 模型在推理速度和精度方面均得到了显著提升:

- **推理速度:**经过量化和剪枝优化,模型推理速度提升了 2 倍以上。

- **精度:**经过知识蒸馏优化,学生模型的精度与教师模型接近,甚至略有提升。

## 5.3 未来研究方向

Yolov5 模型优化是一个持续的研究领域,未来可以探索以下方向:

- **混合优化技术:**结合量化、剪枝和知识蒸馏等技术,探索更有效的优化方法。

- **自适应优化:**开发自适应优化算法,根据模型的特定特征自动调整优化参数。

- **端到端优化:**构建端到端的优化框架,将模型训练、优化和部署过程集成到一个统一的平台中。

0

0