Hadoop块大小与数据复制:性能优化与可靠性的双重奏

发布时间: 2024-10-27 00:12:33 阅读量: 30 订阅数: 37

hadoop权威指南代码(Hadoop: The Definitive Guide code)

# 1. Hadoop块大小与数据复制概述

在大数据处理领域,Hadoop已成为了不可或缺的框架之一,特别是在分布式存储和处理大规模数据集方面。Hadoop分布式文件系统(HDFS)作为其核心组件,通过其独特的数据块(block)存储机制和数据复制策略,保证了系统的高可靠性和高效处理能力。在本章中,我们将概述Hadoop中块大小和数据复制的基本概念及其在HDFS中的作用,为深入分析其对性能和可靠性的影响打下基础。

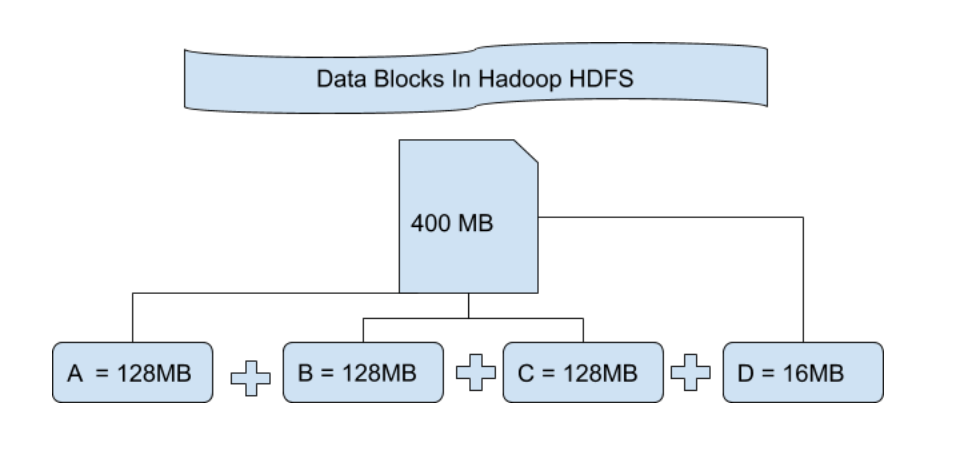

## HDFS的数据块概念

HDFS将大数据文件拆分成固定大小的块,这些块作为存储的基本单位在HDFS中独立存储。默认情况下,每个块的大小为128MB,这个大小可以根据实际数据和需求进行调整。数据块的概念使得Hadoop能够实现数据的并行处理和容错能力,因为即使部分节点发生故障,数据块的副本也能确保数据不丢失。

## 块大小与磁盘I/O性能的关系

块大小直接影响到HDFS的I/O性能。较大的块大小意味着较少的寻道时间,可以提高读写效率,特别是对于顺序读写操作。然而,过大的块也会增加NameNode的内存压力,并可能导致数据恢复时间变长。因此,合理选择块大小对于平衡系统性能和可靠性至关重要。

在下一章中,我们将深入探讨Hadoop块大小对性能的具体影响,以及如何在不同场景中进行优化。

# 2. ```

# 第二章:深入理解Hadoop块大小对性能的影响

## 2.1 Hadoop的基本存储机制

### 2.1.1 HDFS的数据块概念

Hadoop Distributed File System (HDFS) 是一个分布式文件系统,设计用来跨越多台机器存储大量数据。在HDFS中,文件被划分为一系列的块(block),这些块是文件的基本存储单位。默认情况下,每个块的大小是128MB,但这个值是可配置的。每个块会被复制到集群中的多个节点上,以保证数据的可靠性和容错能力。

数据块的概念对Hadoop的性能有显著影响。由于Hadoop主要用于处理大规模数据集,因此文件的块化存储方式极大地提高了数据处理的效率。在MapReduce任务执行时,由于数据块被分散存储在不同的节点上,所以可以并行处理,大幅度提升了处理速度。

### 2.1.2 块大小与磁盘I/O性能的关系

磁盘I/O是影响Hadoop性能的关键因素之一。块大小直接影响到磁盘I/O的读写效率,因为更小的块意味着更多的读写操作。如果块大小设置太小,可能会导致过多的磁盘寻道时间,增加I/O开销;如果块太大,单次读写操作涉及的数据量过大,可能会导致网络带宽成为瓶颈。因此,找到合适的块大小,对于平衡磁盘I/O和网络传输,实现最佳性能至关重要。

磁盘I/O性能还受到操作系统缓存和硬件特性的影响。例如,SSD驱动器在小块尺寸下的性能通常优于HDD,因为SSD可以避免机械延迟。在进行块大小优化时,考虑底层存储设备的特性是必不可少的一步。

## 2.2 块大小设置的理论依据与实践

### 2.2.1 理论模型下的块大小优化

理论上,块大小的优化需要考虑到集群中的多个因素,包括节点数量、网络带宽、磁盘类型等。一个基本的优化模型可能会考虑I/O请求的大小和频率,以及处理这些请求所需要的资源。

在理想情况下,块大小应该足够大,以减少因读写操作而产生的I/O开销,但同时也不应该太大,以至于超过单个节点的处理能力或者造成网络拥堵。通常需要通过实验来确定最优块大小,因为理论模型很难考虑到所有现实中的变数。

### 2.2.2 实际数据集上的块大小调整案例

在Hadoop集群中,调整块大小并不总是立竿见影的,因为它依赖于实际工作负载和数据特征。例如,在处理非常大的日志文件时,可以考虑将块大小增加到几GB,以便于更加高效地读取和处理数据。而在处理小文件居多的场景时,可能会选择减小块大小以避免浪费存储空间和提高处理速度。

以一个电子商务网站日志分析项目为例,初始的块大小设置为128MB。在测试阶段发现,由于日志文件通常超过100MB,每次读取都需要跨多个块,从而增加了处理时间。将块大小调整为512MB后,每个Map任务可以处理更大的数据片段,显著减少了Map任务的总数量和任务调度的开销,最终提高了整体的处理速度。

## 2.3 块大小调整对系统性能的影响

### 2.3.1 块大小与MapReduce任务的执行效率

块大小对MapReduce任务的执行效率有直接的影响。当块大小增加时,每个Map任务需要处理的数据量变大,导致Map阶段的处理时间增加。同时,由于Map任务的输出数据量也会增加,这可能会导致更多的Reduce任务执行,从而增加了整个作业的执行时间。

块大小的调整还需要考虑到Map和Reduce阶段的具体需求。一个较大的块可以减少Map任务的数量,但可能会增加每个Reduce任务的处理时间。因此,必须根据具体的计算需求和作业特性来优化块大小设置。

### 2.3.2 大数据环境下的块大小敏感性分析

在大数据环境下,块大小的设置更加敏感。例如,在处理具有高并发需求的应用时,可能需要较小的块来支持更多的并行操作。在处理需要高吞吐量的批量作业时,较大的块大小可能更加有利。

块大小的调整还需要考虑到硬件环境的变化。随着存储技术的发展,如SSD和NVMe的普及,小块大小带来的性能损失可能已经减少,这就需要根据实际的硬件环境重新评估块大小的设置。

```

# 3. 数据复制策略与Hadoop集群的可靠性

在分布式计算环境中,数据的可靠性和系统的容错性是至关重要的。Hadoop通过其数据复制机制,确保了数据的高可用性。本章节我们将深入探讨Hadoop的数据复制机制,包括其基本原则、副本放置策略以及复制策略的调整和优化。

## 3.1 Hado

0

0