C++编译器优化:优化级别选择,性能的黄金法则

发布时间: 2024-10-21 13:34:20 阅读量: 75 订阅数: 46

免费的防止锁屏小软件,可用于域统一管控下的锁屏机制

# 1. C++编译器优化概述

C++编译器优化是提升程序运行效率的关键步骤,涉及将源代码转换为机器码的过程中,通过各种算法减少执行时间和资源消耗的过程。理解并运用优化技术,对于开发高性能应用程序至关重要。编译器优化包括许多不同的技术,如循环展开、内联函数、死代码消除等,这些技术的应用可以显著提高程序性能。然而,优化也可能引入新的问题,如减少代码的可读性和调试难度,因此开发者需要权衡各种因素,谨慎选择合适的优化级别。在深入讨论具体的优化技术之前,我们先来了解优化级别的基础知识,这将为后续章节的深入分析打下坚实的基础。

# 2. 理解不同的编译优化级别

## 2.1 编译优化级别的基础知识

### 2.1.1 优化级别定义和差异

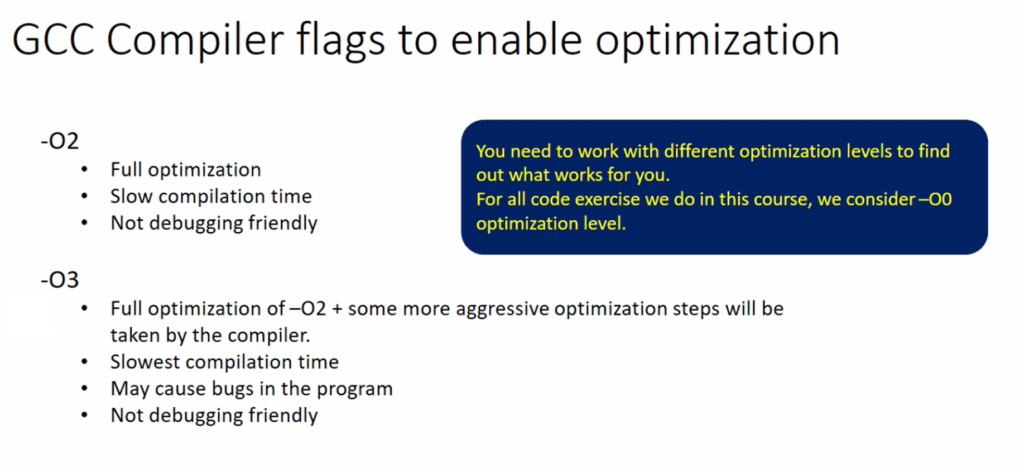

编译优化级别,通常指的是编译器在编译过程中所采取的优化策略和方法的详细程度。在不同的编译器中,优化级别通常有不同的命名和对应的行为,但它们大致可以归类为几个等级。以GCC编译器为例,优化级别从低到高分别为O0(无优化)、O1、O2、O3、Os和Ofast。

- O0:不进行任何优化,这是最基本的优化级别。在此级别下,编译器的目的是尽可能快速地完成编译,而不考虑执行速度或代码大小。

- O1:进行基础的优化,以减少代码大小和执行时间,同时保持较短的编译时间。

- O2:比O1更进一步的优化,它包括O1级别的优化,并添加了一些更高级的优化技术,以提升执行性能。

- O3:最全面的优化级别之一,除了包含O2级别的优化之外,还会添加额外的优化技术,这通常会显著增加编译时间,但能够进一步提高执行速度。

- Os:针对代码大小进行优化,以减少最终生成的可执行文件的大小,可能会牺牲一些性能。

- Ofast:允许使用超出标准的优化手段,例如,它允许使用具有数学函数的快速近似替代。这可能会导致非标准浮点数行为。

### 2.1.2 优化级别对代码的影响

不同优化级别对代码的编译结果影响显著,它们对程序的行为、性能和编译时间都有着直接或间接的影响。

- **性能**:高级别优化往往能够产生更快速的代码,因为它们允许编译器进行更多的分析和转换以改善运行时表现。

- **编译时间**:较高级别的优化需要编译器进行更多的计算,因此会延长编译时间。

- **代码大小**:某些优化级别(如Os)专门针对减小代码大小设计,对于需要在存储空间受限的环境中运行的程序尤为重要。

- **调试难度**:在高级别优化下,由于代码经过了重排和优化,可能会使得源代码和生成的机器码之间的关系变得模糊,这为调试带来了挑战。

## 2.2 低优化级别的实践

### 2.2.1 调试模式下的优化策略

在调试模式下,开发者通常会选用低优化级别(如O0)或特定的调试选项。这样做主要是为了保持源代码与编译后的机器码之间的可追踪性和可读性,方便定位和修复问题。使用低优化级别,编译器不会对代码进行大规模的重排和优化,因此可以期望调试器展示的源码位置与实际的执行流程保持一致。

### 2.2.2 低优化级别下的性能权衡

尽管低优化级别方便了调试,但其以性能为代价。由于编译器没有进行性能增强的转换,生成的程序可能会执行得较慢。通常情况下,低优化级别生成的程序会有以下特点:

- **执行速度较慢**:代码中可能未应用循环展开、函数内联等提高执行效率的技术。

- **更大的代码体积**:编译器没有应用特定的代码大小优化技术,可能会生成较多的中间代码。

- **可能的资源消耗**:由于优化级别的限制,程序可能在运行时消耗更多的处理器时间和内存资源。

## 2.3 高优化级别的实践

### 2.3.1 高优化级别下的代码特性

在高优化级别(如O2、O3)下,编译器会尝试一系列复杂的优化技术,以提高程序运行效率。代码会进行重排、函数内联、循环展开等操作,这通常会导致生成的机器码难以通过源代码直接跟踪。高优化级别下的代码特性如下:

- **运行效率**:代码经过优化,可能在执行速度上有显著的提升。

- **代码体积可能增大**:某些优化技术可能会导致生成的代码体积增大,尤其是在内联函数和循环展开的情况下。

- **难以预测的行为**:由于编译器进行了很多复杂的转换,程序的行为可能不是那么直观。

### 2.3.2 高优化级别与调试的冲突及解决

高优化级别虽然能够提供优秀的性能,但同时也带来了调试上的挑战。调试时,可能会遇到以下问题:

- **调试信息不匹配**:源代码与生成的机器码之间的映射关系可能会变得混乱。

- **断点失效**:优化操作可能改变了原本的代码结构,导致断点设置不准确或失效。

解决这些冲突的一个常用方法是使用专门的调试优化级别(如GCC的-ggdb选项),这样即使在优化级别较高时,编译器也会尽可能生成有助于调试的信息。

```bash

gcc -O2 -ggdb your_program.c -o your_program

```

此命令在进行O2级别优化的同时,保留了足够的调试信息,以便于开发者使用gdb等调试工具。

```bash

gdb ./your_program

```

使用调试工具时,开发者应熟悉相关的调试命令,尤其是那些用于处理优化代码的命令(例如,查看优化后的源代码映射等)。此外,了解编译器如何进行优化,以及优化后代码的行为模式,对于有效调试同样至关重要。

以上就是本章节的核心内容。通过以上详细分析,可以看出不同的编译优化级别为开发者在性能、调试便利性、代码体积和编译时间上提供了多种选择。在实际开发过程中,开发者应根据具体需求选择合适的优化级别,并掌握调试高优化级别代码的相关技巧。接下来的章节将进一步深入探讨编译器优化技术的基本原理及其在实际应用中的表现。

# 3. 编译器优化技术深度分析

## 3.1 优化技术的基本原理

### 3.1.1 循环优化和代码展开

循环是程序中重复执行任务的基本结构,因此循环优化是编译器优化技术中重要的一个部分。循环优化的基本目标是减少循环的开销,提高程序运行效率。

循环展开是一种常见的循环优化技术。它通过减少循环中迭代次数来减少控制开销,例如将`for (int i = 0; i < 4; ++i) { a[i] = b[i] + c; }`展开为`a[0] = b[0] + c; a[1] = b[1] + c; a[2] = b[2] + c; a[3] = b[3] + c;`。这样,循环的管理代码被减少了,而且编译器也更容易发现进一步优化的机会。

代码展开不仅仅减少了循环控制的开销,它还可以增加指令级并行度(ILP),使编译后的代码更加适合现代处理器的流水线和执行单元。

```c++

for (int i = 0; i < 100; i += 4) {

a[i + 0] = b[i + 0] + c;

a[i + 1] = b[i + 1] + c;

a[i + 2] = b[i + 2] + c;

a[i + 3] = b[i + 3] + c;

}

```

在上述代码中,每次循环迭代计算四个数组元素的和。这种展开的循环比每次只计算一个元素的循环能更好地利用CPU的流水线和指令级并行性。

### 3.1.2 内联函数与函数内联

函数内联是另一种常用的编译器优化技术。在内联过程中,函数调用被其函数体所替代。这减少了函数调用的开销,尤其是对于小型函数来说,可以显著提升程序的性能。

例如,考虑以下函数:

```c++

inline int min(int a, int b) {

return (a < b) ? a : b;

}

```

当在程序中多次调用`min`函数时,编译器可能会选择内联这个函数。内联操作减少了函数调用的开销,同时如果函数非常简单,它也允许编译器进行进一步的优化。

尽管函数内联可以提高性能,但过度使用可能会导致代码体积膨胀,影响缓存的利用效率。因此,编译器会根据函数体的大小、函数被调用的频率和上下文等因素,智能化地决定是否进行函数内联。

## 3.2 优化技术的实际应用

### 3.2.1 指令级并行与流水线优化

现代处理器设计了高级的流水线和指令级并行(ILP)来提高性能。编译器必须对代码进行优化,以充分利用这些特性。

为了支持流水线操作,编译器可能会重排指令,以减少停顿和提高指令的执行效率。例如,通过循环展开,编译器可以更有效地填满流水线,减少因等待流水线前一个阶段完成而导致的处理器空闲。

```c++

for (int i = 0; i < N; i += 4) {

a[i + 0] = b[i + 0] + c;

a[i + 1] = b[i + 1] + c;

a[i + 2] = b[i + 2] + c;

a[i + 3] = b[i + 3] + c;

}

```

### 3.2.2 寄存器分配和优化

寄存器分配是编译器在有限的寄存器资源中合理分配变量的过程。好的寄存器分配策略可以显著提升程序性能,因为它减少了内存访问次数。

编译器通过寄存器分配和优化算法,尽可能将频繁访问的变量保留在寄存器中。同时,编译器还会努力避免寄存器溢出到栈,因为栈访问远比寄存器访问慢。

## 3.3 优化技术的副作用和风险

### 3.3.1 优化导致的未定义行为

编译器优化有时会引入一些未定义行为(Undefined Behavior),这是指编程语言标准中未定义程序的行为,编译器可以自由处理这些情况。

例如,如果编译器确定某个表达式的结果在程序中没有被使用,它可能会优化掉这个表达式的计算过程。这可能会导致未定义行为,尤其是当这个表达式

0

0