Python Excel读写数据可视化与分析:洞察数据,做出明智决策

发布时间: 2024-06-23 05:00:21 阅读量: 90 订阅数: 34

# 1. Python Excel读写数据基础**

Python提供了强大的库,如`openpyxl`和`pandas`,用于轻松读取和写入Excel文件。`openpyxl`可用于直接访问Excel单元格,而`pandas`则提供了更高级的结构化数据处理功能。

```python

# 使用openpyxl读取Excel文件

import openpyxl

workbook = openpyxl.load_workbook('data.xlsx')

sheet = workbook.active

cell_value = sheet['A1'].value

# 使用pandas读取Excel文件

import pandas as pd

df = pd.read_excel('data.xlsx')

```

通过使用这些库,可以轻松地将Excel数据导入Python程序中,进行处理和分析。

# 2. Python Excel数据处理与分析

### 2.1 数据清洗与预处理

数据清洗与预处理是数据分析过程中至关重要的一步,它可以确保数据的准确性和完整性,为后续的分析和建模奠定坚实的基础。

#### 2.1.1 缺失值处理

缺失值是数据分析中常见的问题,处理缺失值的方法有多种,包括:

- **删除缺失值:**如果缺失值数量较少,且对分析结果影响不大,可以考虑直接删除缺失值。

- **填充缺失值:**使用其他数据填充缺失值,如平均值、中位数或众数。

- **插补缺失值:**使用插值算法估计缺失值,如线性插值或样条插值。

```python

import pandas as pd

# 删除缺失值

df = df.dropna()

# 填充缺失值(平均值)

df['age'].fillna(df['age'].mean(), inplace=True)

# 插补缺失值(线性插值)

df['age'].interpolate(method='linear', inplace=True)

```

#### 2.1.2 异常值检测与处理

异常值是指与数据集中其他值明显不同的值,它们可能会对分析结果产生误导。异常值检测与处理的方法包括:

- **统计方法:**使用标准差或四分位间距等统计方法检测异常值。

- **机器学习方法:**使用聚类或孤立森林等机器学习算法检测异常值。

```python

import numpy as np

# 统计方法(标准差)

z_score = np.abs(df['age'] - df['age'].mean()) / df['age'].std()

outliers = df[z_score > 3]

# 机器学习方法(孤立森林)

from sklearn.ensemble import IsolationForest

iso = IsolationForest(n_estimators=100)

outliers = iso.fit_predict(df)

```

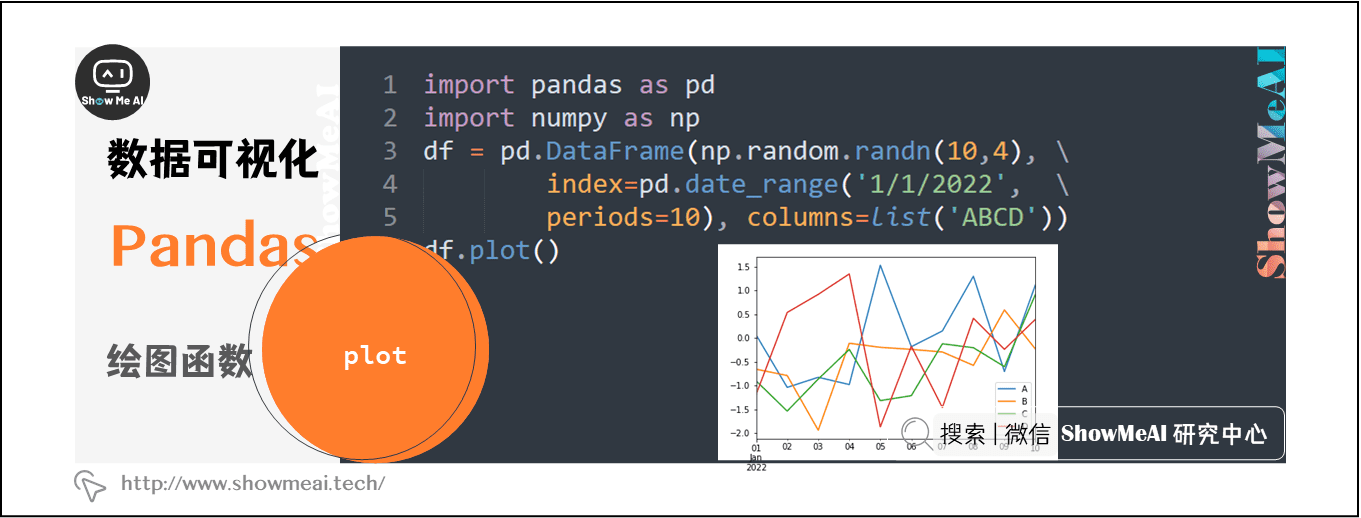

### 2.2 数据分析与可视化

数据分析与可视化是探索和理解数据的有效手段,它可以帮助我们发现数据中的模式、趋势和异常。

#### 2.2.1 数据统计与描述

数据统计与描述可以提供对数据的基本了解,包括:

- **中心趋势:**平均值、中位数、众数

- **离散程度:**标准差、方差、四分位间距

- **分布形状:**正态分布、偏态分布、峰度分布

```python

import pandas as pd

# 中心趋势

print(df['age'].mean())

print(df['age'].median())

print(df['age'].mode())

# 离散程度

print(df['age'].std())

print(df['age'].var())

print(df['age'].iqr())

# 分布形状

print(df['age'].skew())

print(df['age'].kurt())

```

0

0