揭秘OpenCV DNN模块:深度神经网络的终极武器

发布时间: 2024-08-14 19:42:15 阅读量: 78 订阅数: 47

opencv中的dnn模块

# 1. OpenCV DNN模块简介**

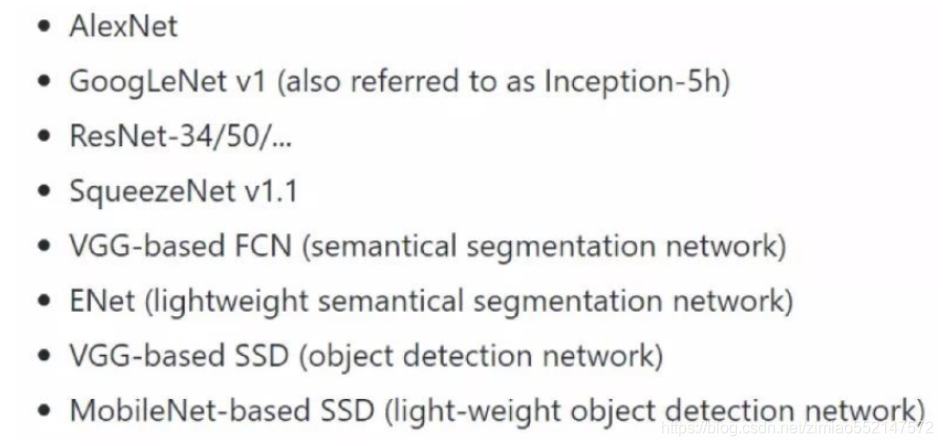

OpenCV DNN模块是一个强大的深度神经网络(DNN)库,用于计算机视觉和机器学习任务。它提供了一套全面的工具和算法,使开发者能够轻松地构建、训练和部署深度学习模型。DNN模块基于Caffe和TensorFlow等流行的深度学习框架,支持各种神经网络架构,包括卷积神经网络(CNN)、循环神经网络(RNN)和生成对抗网络(GAN)。

# 2. DNN模块的理论基础

### 2.1 深度神经网络的架构和原理

深度神经网络(DNN)是一种具有多个隐藏层的神经网络,能够从数据中学习复杂模式。DNN的架构通常由输入层、输出层和多个隐藏层组成。

* **输入层:**接收原始数据,例如图像、文本或音频。

* **隐藏层:**执行特征提取和模式识别,通常由卷积层、池化层和激活函数组成。

* **输出层:**生成最终预测或决策,例如图像分类、目标检测或文本生成。

### 2.2 卷积神经网络(CNN)和循环神经网络(RNN)

**卷积神经网络(CNN):**

CNN是一种专门用于处理网格状数据(如图像)的DNN。它使用卷积操作提取局部特征,并通过池化层减少特征图大小。

**循环神经网络(RNN):**

RNN是一种用于处理序列数据(如文本或时间序列)的DNN。它使用循环连接来记住过去的信息,并根据当前输入和过去状态生成输出。

### 2.3 训练和评估深度神经网络

**训练:**

DNN通过反向传播算法进行训练,该算法使用梯度下降来最小化损失函数。损失函数衡量预测输出与真实标签之间的差异。

**评估:**

训练后,DNN使用测试集进行评估,以测量其性能。常见的评估指标包括准确率、召回率和 F1 分数。

**代码示例:**

```python

import tensorflow as tf

# 创建一个简单的DNN

model = tf.keras.models.Sequential([

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(64, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(x_train, y_train, epochs=10)

# 评估模型

model.evaluate(x_test, y_test)

```

**代码逻辑分析:**

* `tf.keras.models.Sequential` 创建一个顺序模型,其中层按顺序堆叠。

* `tf.keras.layers.Dense` 创建一个全连接层,指定神经元数量和激活函数。

* `model.compile` 编译模型,指定优化器、损失函数和评估指标。

* `model.fit` 训练模型,指定训练数据和训练轮数。

* `model.evaluate` 评估模型,指定测试数据。

**参数说明:**

* `activation`:激活函数,用于引入非线性。

* `optimizer`:优化算法,用于更新模型权重。

* `loss`:损失函数,用于衡量预测与真实标签之间的差异。

* `metrics`:评估指标,用于衡量模型性能。

# 3. DNN模块的实践应用

**3.1 图像分类和识别**

DNN模块在图像分类和识别领域有着广泛的应用。它可以有效地识别图像中的对象、场景和人物。

**原理:**

图像分类和识别任务通常使用卷积神经网络(CNN)来解决。CNN是一种深度神经网络,其架构由卷积层、池化层和全连接层组成。卷积层提取图像中的特征,池化层减少特征图的大小,全连接层将提取的特征分类到特定的类别中。

**应用:**

* **产品识别:**识别图像中的产品,用于电子商务和零售。

* **场景分类:**识别图像中场景的类型,用于图像搜索和社交媒体。

* **人物识别:**识别图像中的人物,用于人脸识别和安全。

**代码示例:**

```python

import cv2

import numpy as np

# 加载预训练的模型

model = cv2.dnn.readNetFromCaffe("deploy.prototxt.txt", "model.caffemodel")

# 准备图像

image = cv2.imread("image.jpg")

blob = cv2.dnn.blobFromImage(image, 0.007843, (224, 224), 127.5)

# 设置输入

model.setInput(blob)

# 前向传播

preds = model.forward()

# 获取预测结果

classes = np.argmax(preds, axis=1)

print(classes)

```

**逻辑分析:**

* `cv2.dnn.readNetFromCaffe()`:加载预训练的Caffe模型。

* `cv2.dnn.blobFromImage()`:将图像转换为深度学习模型所需的blob格式。

* `model.setInput()`:将blob设置为模型的输入。

* `model.forward()`:执行前向传播,计算预测结果。

* `np.argmax()`:获取预测结果中概率最大的类别。

**3.2 目标检测和分割**

DNN模块还可以用于目标检测和分割。目标检测的任务是识别图像中的对象并定位其边界框,而目标分割的任务是将图像中的对象从背景中分割出来。

**原理:**

目标检测和分割通常使用单次检测网络(SSD)或区域建议网络(R-CNN)来解决。SSD是一种轻量级网络,直接从图像中预测边界框和类别。R-CNN是一种两阶段网络,首先生成候选区域,然后对每个区域进行分类和边界框回归。

**应用:**

* **目标检测:**检测图像中的人、车辆、动物等对象。

* **目标分割:**将图像中的对象从背景中分割出来,用于图像编辑和医学影像。

**代码示例:**

```python

import cv2

import numpy as np

# 加载预训练的模型

model = cv2.dnn.readNetFromTensorflow("ssd_mobilenet_v2_coco.pb", "ssd_mobilenet_v2_coco.pbtxt")

# 准备图像

image = cv2.imread("image.jpg")

blob = cv2.dnn.blobFromImage(image, 0.007843, (300, 300), 127.5)

# 设置输入

model.setInput(blob)

# 前向传播

preds = model.forward()

# 获取预测结果

for detection in preds[0, 0]:

score = float(detection[2])

if score > 0.5:

left = int(detection[3] * image.shape[1])

top = int(detection[4] * image.shape[0])

right = int(detection[5] * image.shape[1])

bottom = int(detection[6] * image.shape[0])

label = detection[1]

print(label, score, (left, top, right, bottom))

```

**逻辑分析:**

* `cv2.dnn.readNetFromTensorflow()`:加载预训练的TensorFlow模型。

* `cv2.dnn.blobFromImage()`:将图像转换为深度学习模型所需的blob格式。

* `model.setInput()`:将blob设置为模型的输入。

* `model.forward()`:执行前向传播,计算预测结果。

* 遍历预测结果,获取每个检测的类别、置信度和边界框。

**3.3 人脸检测和识别**

DNN模块在人脸检测和识别领域也有着广泛的应用。它可以检测图像中的人脸并识别其身份。

**原理:**

人脸检测和识别通常使用级联分类器或深度学习模型来解决。级联分类器是一种基于Haar特征的传统方法,而深度学习模型则使用CNN来提取人脸特征。

**应用:**

* **人脸检测:**检测图像中的人脸,用于安全和监控。

* **人脸识别:**识别图像中的人脸并将其与数据库中的已知人脸进行匹配,用于身份验证和访问控制。

**代码示例:**

```python

import cv2

import numpy as np

# 加载预训练的模型

model = cv2.dnn.readNetFromCaffe("deploy.prototxt.txt", "model.caffemodel")

# 准备图像

image = cv2.imread("image.jpg")

blob = cv2.dnn.blobFromImage(image, 1.0, (300, 300), (104.0, 177.0, 123.0))

# 设置输入

model.setInput(blob)

# 前向传播

preds = model.forward()

# 获取预测结果

for detection in preds[0, 0]:

score = float(detection[2])

if score > 0.5:

left = int(detection[3] * image.shape[1])

top = int(detection[4] * image.shape[0])

right = int(detection[5] * image.shape[1])

bottom = int(detection[6] * image.shape[0])

print(score, (left, top, right, bottom))

```

**逻辑分析:**

* `cv2.dnn.readNetFromCaffe()`:加载预训练的Caffe模型。

* `cv2.dnn.blobFromImage()`:将图像转换为深度学习模型所需的blob格式。

* `model.setInput()`:将blob设置为模型的输入。

* `model.forward()`:执行前向传播,计算预测结果。

* 遍历预测结果,获取每个检测的置信度和边界框。

# 4. DNN模块的进阶应用**

**4.1 神经风格迁移和图像生成**

神经风格迁移是一种将一幅图像的风格应用到另一幅图像上的技术。这使得我们可以创建具有特定艺术风格的图像,例如梵高或毕加索的风格。

**4.1.1 神经风格迁移的原理**

神经风格迁移基于这样一个事实:深度神经网络可以学习图像的风格和内容。通过使用预训练的网络,我们可以将一幅图像的内容与另一幅图像的风格相结合。

**4.1.2 神经风格迁移的步骤**

神经风格迁移通常涉及以下步骤:

1. **加载图像:**加载要转换的图像(内容图像)和要应用风格的图像(风格图像)。

2. **预处理图像:**将图像调整为相同的大小并将其转换为适当的格式。

3. **创建神经网络:**使用预训练的网络(例如 VGG19)创建神经网络。

4. **提取特征:**从内容图像和风格图像中提取特征。

5. **计算损失函数:**计算内容损失和风格损失。

6. **优化网络:**使用优化算法(例如 L-BFGS)优化网络,以最小化损失函数。

7. **生成转换后的图像:**使用优化后的网络生成转换后的图像。

**代码示例:**

```python

import cv2

import numpy as np

# 加载图像

content_image = cv2.imread("content.jpg")

style_image = cv2.imread("style.jpg")

# 预处理图像

content_image = cv2.resize(content_image, (512, 512))

style_image = cv2.resize(style_image, (512, 512))

# 创建神经网络

net = cv2.dnn.readNetFromCaffe("deploy.prototxt.txt", "model.caffemodel")

# 提取特征

content_features = net.forward(content_image)

style_features = net.forward(style_image)

# 计算损失函数

content_loss = cv2.dnn.loss.ContentLoss()

style_loss = cv2.dnn.loss.StyleLoss()

# 优化网络

optimizer = cv2.dnn.optim.LBFGSOpt()

optimizer.minimize(net, content_loss, style_loss)

# 生成转换后的图像

stylized_image = net.forward(content_image)

# 保存转换后的图像

cv2.imwrite("stylized.jpg", stylized_image)

```

**4.2 视频分析和动作识别**

DNN模块还可以用于视频分析和动作识别。通过从视频帧中提取特征,我们可以识别视频中的动作和事件。

**4.2.1 视频分析和动作识别的原理**

视频分析和动作识别通常涉及以下步骤:

1. **视频预处理:**将视频分解成帧并对其进行预处理。

2. **特征提取:**从每帧中提取特征。

3. **动作识别:**使用分类器或回归器识别视频中的动作。

**4.2.2 视频分析和动作识别的应用**

视频分析和动作识别在许多领域都有应用,例如:

* **监控:**检测异常行为和安全威胁。

* **体育:**分析运动员的表现并识别动作。

* **医疗:**诊断疾病并监测治疗效果。

**代码示例:**

```python

import cv2

import numpy as np

# 加载视频

cap = cv2.VideoCapture("video.mp4")

# 视频预处理

frame_width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

frame_height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fps = cap.get(cv2.CAP_PROP_FPS)

# 创建动作识别模型

model = cv2.dnn.readNetFromCaffe("deploy.prototxt.txt", "model.caffemodel")

while True:

# 读取帧

ret, frame = cap.read()

if not ret:

break

# 预处理帧

frame = cv2.resize(frame, (224, 224))

frame = np.array(frame) / 255.0

# 提取特征

features = model.forward(frame)

# 识别动作

action = np.argmax(features)

# 显示结果

cv2.putText(frame, str(action), (10, 30), cv2.FONT_HERSHEY_SIMPLEX, 1, (0, 255, 0), 2)

cv2.imshow("Video Analysis", frame)

if cv2.waitKey(1) & 0xFF == ord("q"):

break

cap.release()

cv2.destroyAllWindows()

```

**4.3 自然语言处理**

DNN模块也可以用于自然语言处理(NLP)任务,例如文本分类、语言翻译和语音识别。

**4.3.1 自然语言处理的原理**

NLP任务通常涉及以下步骤:

1. **文本预处理:**对文本进行分词、词干化和词性标注。

2. **特征提取:**从文本中提取特征,例如词嵌入或句法特征。

3. **模型训练:**使用分类器或回归器训练模型。

**4.3.2 自然语言处理的应用**

NLP在许多领域都有应用,例如:

* **搜索引擎:**检索和排名相关文档。

* **机器翻译:**将文本从一种语言翻译成另一种语言。

* **聊天机器人:**与用户进行自然语言交互。

**代码示例:**

```python

import tensorflow as tf

# 加载文本数据

data = tf.keras.datasets.imdb

(train_data, train_labels), (test_data, test_labels) = data.load_data(num_words=10000)

# 预处理文本

train_data = tf.keras.preprocessing.sequence.pad_sequences(train_data, maxlen=256)

test_data = tf.keras.preprocessing.sequence.pad_sequences(test_data, maxlen=256)

# 创建文本分类模型

model = tf.keras.Sequential([

tf.keras.layers.Embedding(10000, 128),

tf.keras.layers.LSTM(128),

tf.keras.layers.Dense(1, activation="sigmoid")

])

# 编译模型

model.compile(optimizer="adam", loss="binary_crossentropy", metrics=["accuracy"])

# 训练模型

model.fit(train_data, train_labels, epochs=10)

# 评估模型

model.evaluate(test_data, test_labels)

```

# 5. DNN模块的性能优化

### 5.1 模型压缩和量化

深度神经网络模型通常非常庞大,这会给存储和计算带来挑战。模型压缩和量化技术可以减少模型的大小和计算成本,同时保持其准确性。

**模型压缩**

模型压缩技术通过去除冗余信息和优化模型结构来减少模型大小。常用的方法包括:

- **剪枝:**移除对模型性能影响较小的权重和神经元。

- **蒸馏:**将大型模型的知识转移到较小的模型中。

- **量化:**将浮点权重和激活值转换为低精度格式,例如int8或int16。

**代码示例:**

```python

import tensorflow as tf

# 创建一个浮点模型

model = tf.keras.models.Sequential([

tf.keras.layers.Dense(100, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 量化模型

quantized_model = tf.keras.models.quantization.quantize_model(model)

# 评估量化模型的准确性

loss, accuracy = quantized_model.evaluate(x_test, y_test)

print('量化模型的准确性:', accuracy)

```

### 5.2 并行化和分布式训练

对于大型数据集和复杂模型,训练深度神经网络可能需要大量时间。并行化和分布式训练技术可以加速训练过程。

**并行化**

并行化是指在多核CPU或GPU上并行执行训练任务。常用的方法包括:

- **数据并行化:**将训练数据分成多个批次,并在不同的设备上并行处理。

- **模型并行化:**将模型的不同层或部分分配到不同的设备上并行训练。

**分布式训练**

分布式训练是指在多台机器上并行执行训练任务。常用的方法包括:

- **数据并行化:**与并行化相同,但将训练数据分布在多台机器上。

- **模型并行化:**与并行化相同,但将模型分布在多台机器上。

- **混合并行化:**结合数据并行化和模型并行化。

**代码示例:**

```python

import tensorflow as tf

# 创建一个分布式策略

strategy = tf.distribute.MirroredStrategy()

# 在分布式策略中创建模型

with strategy.scope():

model = tf.keras.models.Sequential([

tf.keras.layers.Dense(100, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 分布式训练模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(x_train, y_train, epochs=10)

```

### 5.3 硬件加速

深度神经网络的训练和推理需要大量的计算能力。硬件加速技术可以利用专用硬件(例如GPU、TPU)来提高性能。

**GPU**

图形处理单元(GPU)是专门用于并行处理图形数据的硬件。GPU可以显著加速深度神经网络的训练和推理。

**TPU**

张量处理单元(TPU)是谷歌开发的专用硬件,专门用于加速机器学习任务。TPU比GPU更适合处理大规模并行计算。

**代码示例:**

```python

import tensorflow as tf

# 使用GPU训练模型

with tf.device('/GPU:0'):

model = tf.keras.models.Sequential([

tf.keras.layers.Dense(100, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(x_train, y_train, epochs=10)

```

# 6. DNN模块的未来展望

### 6.1 新兴的深度学习算法和架构

深度学习领域正在不断发展,新的算法和架构不断涌现。这些新技术有望进一步提高DNN模型的性能和效率。

**Transformer 架构:**Transformer 架构是一种基于注意力机制的深度学习模型,它在自然语言处理和计算机视觉等任务中表现出色。与传统的卷积神经网络相比,Transformer 架构能够处理更长的序列数据,并捕捉更复杂的依赖关系。

**生成式对抗网络(GAN):**GAN 是一种生成式深度学习模型,它可以生成逼真的图像、文本和音乐。GAN 由两个神经网络组成:生成器网络和判别器网络。生成器网络生成数据,而判别器网络尝试区分生成的数据和真实数据。通过对抗训练,GAN 可以生成高度逼真的数据。

### 6.2 DNN模块在计算机视觉和人工智能领域的应用

DNN模块在计算机视觉和人工智能领域有着广泛的应用,包括:

**医学图像分析:**DNN模块可用于分析医学图像,例如 X 射线和 MRI,以检测疾病和辅助诊断。

**自动驾驶:**DNN模块是自动驾驶汽车的关键组件,用于感知周围环境、检测物体和做出驾驶决策。

**机器人技术:**DNN模块使机器人能够学习和执行复杂的任务,例如物体识别、导航和操纵。

### 6.3 DNN模块的挑战和机遇

尽管 DNN 模块取得了重大进展,但仍面临着一些挑战:

**模型复杂性:**DNN 模型通常非常复杂,需要大量的数据和计算资源进行训练。

**可解释性:**DNN 模型的黑盒性质使其难以解释模型的决策过程。

**偏见:**DNN 模型可能受到训练数据中偏见的影響,导致模型在某些群体上表现不佳。

尽管存在这些挑战,DNN 模块仍具有巨大的潜力。随着新算法和架构的不断涌现,DNN 模块有望在未来几年内继续推动计算机视觉和人工智能领域的变革。

0

0