揭秘YOLOv5算法:原理、实现与机制,助力物体检测算法理解

发布时间: 2024-08-14 08:38:54 阅读量: 194 订阅数: 34

# 1. YOLOv5算法概述

YOLOv5(You Only Look Once version 5)是一种单阶段目标检测算法,以其速度快、精度高而闻名。它将目标检测问题建模为一个回归问题,直接预测目标的边界框和类别。YOLOv5是YOLO系列算法的最新版本,在精度和速度方面都取得了显著的改进。

YOLOv5算法采用了一种新的网络架构,称为CSPDarknet53,它比之前的YOLO版本更轻量化、更高效。此外,YOLOv5还引入了新的损失函数和优化器,进一步提高了算法的性能。

# 2. YOLOv5算法原理

### 2.1 目标检测算法演进

目标检测算法经历了从传统算法到深度学习算法的演变。传统算法,如滑动窗口和选择性搜索,计算复杂度高,检测精度较低。深度学习算法的出现,特别是卷积神经网络(CNN)的应用,极大地提高了目标检测的精度和速度。

### 2.2 YOLOv5算法架构

YOLOv5算法是一种单阶段目标检测算法,其架构主要包括以下几个部分:

- **主干网络:**YOLOv5使用改进的Cross Stage Partial Darknet(CSPDarknet)作为主干网络,该网络具有较强的特征提取能力和较快的推理速度。

- **Neck网络:**Neck网络负责将不同尺度的特征图融合起来,以获得更丰富的特征信息。YOLOv5使用Path Aggregation Network(PANet)作为Neck网络,该网络可以有效地融合不同尺度的特征图,增强模型的检测能力。

- **检测头:**检测头负责将融合后的特征图转换为目标检测结果。YOLOv5使用YOLO Head作为检测头,该检测头可以同时预测目标的类别和边界框。

### 2.3 损失函数和优化器

YOLOv5算法使用复合损失函数,该损失函数包含以下几个部分:

- **边界框损失:**衡量预测边界框与真实边界框之间的差异。

- **类别损失:**衡量预测类别与真实类别的差异。

- **置信度损失:**衡量目标检测器的置信度预测的准确性。

YOLOv5算法使用Adam优化器,该优化器具有较快的收敛速度和较好的泛化能力。

#### 代码块:YOLOv5损失函数

```python

import torch

from torch.nn import MSELoss, CrossEntropyLoss, BCEWithLogitsLoss

def yolo_loss(preds, targets):

# 边界框损失

bbox_loss = MSELoss()(preds[:, :4], targets[:, :4])

# 类别损失

cls_loss = CrossEntropyLoss()(preds[:, 5:-1], targets[:, 5:-1])

# 置信度损失

obj_loss = BCEWithLogitsLoss()(preds[:, 4], targets[:, 4])

# 复合损失

loss = bbox_loss + cls_loss + obj_loss

return loss

```

#### 代码逻辑分析:

该代码实现了YOLOv5算法的复合损失函数。

- `bbox_loss`计算边界框损失,使用均方误差损失函数衡量预测边界框与真实边界框之间的差异。

- `cls_loss`计算类别损失,使用交叉熵损失函数衡量预测类别与真实类别的差异。

- `obj_loss`计算置信度损失,使用二元交叉熵损失函数衡量目标检测器的置信度预测的准确性。

- `loss`将边界框损失、类别损失和置信度损失相加,得到复合损失。

# 3.1 数据集准备和预处理

#### 数据集选择

选择合适的数据集是训练 YOLOv5 模型的关键步骤。数据集应包含足够数量和多样性的图像,以涵盖目标检测任务中遇到的各种场景和对象。一些常用的数据集包括:

- COCO(通用目标检测、分割和关键点检测数据集)

- Pascal VOC(视觉对象类数据集)

- ImageNet(大规模图像数据库)

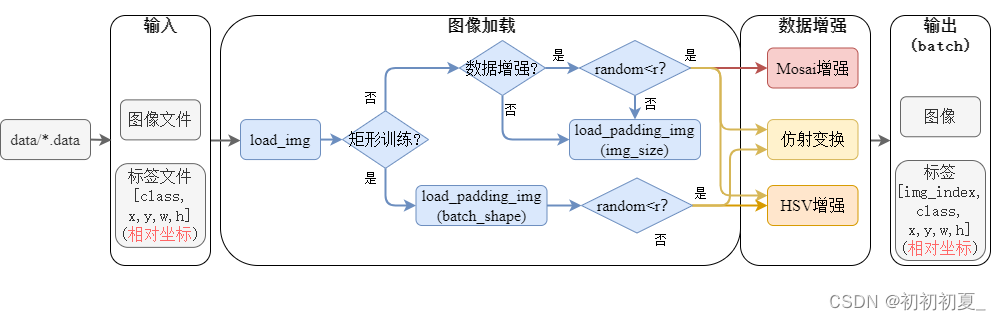

#### 数据预处理

数据预处理涉及对图像进行一系列操作,以使其适合训练 YOLOv5 模型。这些操作通常包括:

- **图像调整大小:**将图像调整为模型输入大小,通常为 640x640。

- **颜色标准化:**将图像像素值归一化到 [0, 1] 范围内,以减少照明和对比度变化的影响。

- **数据增强:**应用随机变换(例如翻转、旋转、缩放)以增加数据集的多样性,防止模型过拟合。

### 3.2 模型训练和评估

#### 模型训练

训练 YOLOv5 模型涉及以下步骤:

1. **初始化模型:**从预训练权重或随机权重初始化模型。

2. **定义损失函数:**使用复合损失函数,包括分类损失、定位损失和置信度损失。

3. **优化器选择:**使用 Adam 或 SGD 等优化器更新模型权重。

4. **训练循环:**迭代遍历训练数据,更新模型权重以最小化损失函数。

#### 模型评估

训练完成后,需要评估模型的性能。评估指标包括:

- **平均精度(mAP):**衡量模型在不同置信度阈值下检测所有类别的平均精度。

- **框平均精度(BAP):**衡量模型在不同置信度阈值下检测单个类的平均精度。

- **帧率(FPS):**衡量模型在特定硬件上的推理速度。

### 3.3 模型部署和推理

#### 模型部署

训练好的 YOLOv5 模型可以部署到各种平台,包括:

- **服务器:**使用 Flask 或 FastAPI 等框架部署模型以提供 REST API。

- **移动设备:**使用 Core ML 或 TensorFlow Lite 等框架部署模型以进行移动推理。

- **嵌入式设备:**使用微控制器或 FPGA 部署模型以进行实时推理。

#### 模型推理

模型部署后,可以使用以下步骤进行推理:

1. **加载模型:**将训练好的模型加载到推理环境中。

2. **预处理图像:**对输入图像进行预处理,如调整大小和颜色标准化。

3. **推理:**将预处理后的图像输入模型,获得检测结果。

4. **后处理:**对检测结果进行后处理,例如过滤低置信度检测和应用非最大抑制。

# 4. YOLOv5算法机制

### 4.1 Anchor Box机制

Anchor Box是目标检测算法中用于生成候选框的一种机制。在YOLOv5中,Anchor Box被用于预测目标的中心点和大小。

**生成Anchor Box**

YOLOv5使用k-means聚类算法在训练集上生成一组预定义的Anchor Box。这些Anchor Box的形状和大小不同,以适应不同大小和形状的目标。

**预测Anchor Box偏移量**

在训练过程中,YOLOv5模型学习预测每个Anchor Box相对于其真实目标的偏移量。这些偏移量包括中心点偏移量和大小偏移量。

**计算目标得分**

对于每个Anchor Box,YOLOv5模型计算目标得分,表示该Anchor Box包含真实目标的概率。目标得分是基于Anchor Box与真实目标的重叠率计算的。

### 4.2 Non-Maximum Suppression机制

Non-Maximum Suppression (NMS)是一种后处理机制,用于从一组重叠的候选框中选择最合适的候选框。

**NMS算法**

NMS算法的工作原理如下:

1. 对候选框按目标得分从高到低排序。

2. 选择目标得分最高的候选框。

3. 计算其他候选框与已选候选框的重叠率。

4. 如果重叠率超过阈值,则丢弃其他候选框。

5. 重复步骤2-4,直到所有候选框都被处理。

**NMS在YOLOv5中的应用**

在YOLOv5中,NMS用于从每个网格单元预测的多个候选框中选择最终的检测结果。通过NMS,可以消除重叠的检测结果,并确保每个目标只被检测一次。

### 4.3 特征金字塔网络机制

特征金字塔网络(FPN)是一种用于在不同尺度上提取特征的网络结构。在YOLOv5中,FPN用于融合来自不同卷积层的特征,以增强模型对不同大小目标的检测能力。

**FPN结构**

FPN结构由以下组件组成:

* **自顶向下路径:**从高层特征图到低层特征图的一系列卷积层。

* **自底向上路径:**从低层特征图到高层特征图的一系列上采样层。

* **横向连接:**在不同层之间进行特征融合的连接层。

**FPN在YOLOv5中的应用**

在YOLOv5中,FPN用于融合来自不同卷积层的特征,以生成具有不同尺度的特征金字塔。这使得模型能够同时检测大目标和小目标,并提高了模型的整体检测精度。

# 5. YOLOv5算法应用

### 5.1 目标检测应用场景

YOLOv5算法在目标检测领域有着广泛的应用,包括:

- **图像分类:**将图像中的物体分类为预定义的类别。

- **对象检测:**识别和定位图像中的对象,并对其进行分类。

- **视频分析:**分析视频流中的对象,并对其进行跟踪和识别。

- **无人驾驶:**检测道路上的行人、车辆和其他物体,以实现安全驾驶。

- **医疗成像:**检测和分类医学图像中的病变,以辅助诊断。

### 5.2 YOLOv5算法的优势和局限性

**优势:**

- **速度快:**YOLOv5算法采用单次前向传播即可完成目标检测,速度极快。

- **精度高:**YOLOv5算法在COCO数据集上取得了较高的精度,达到了46.0%的AP。

- **鲁棒性强:**YOLOv5算法对图像的旋转、缩放和遮挡具有较强的鲁棒性。

- **易于部署:**YOLOv5算法提供了预训练模型和部署工具,易于在各种平台上部署。

**局限性:**

- **小目标检测:**YOLOv5算法在检测小目标时,精度可能会下降。

- **计算资源消耗:**YOLOv5算法需要较大的计算资源,在低功耗设备上部署可能会受到限制。

- **泛化能力:**YOLOv5算法在新的数据集上泛化能力可能较差,需要进行微调或重新训练。

### 5.3 YOLOv5算法的未来发展

YOLOv5算法仍在不断发展中,未来可能会在以下几个方面进行改进:

- **小目标检测:**通过改进特征提取器和损失函数,提升小目标检测精度。

- **泛化能力:**通过使用迁移学习和数据增强技术,提高算法在不同数据集上的泛化能力。

- **效率优化:**通过优化模型结构和推理算法,进一步提升算法的推理速度。

- **多任务学习:**将目标检测与其他任务(如语义分割、实例分割)结合,实现多任务学习。

0

0