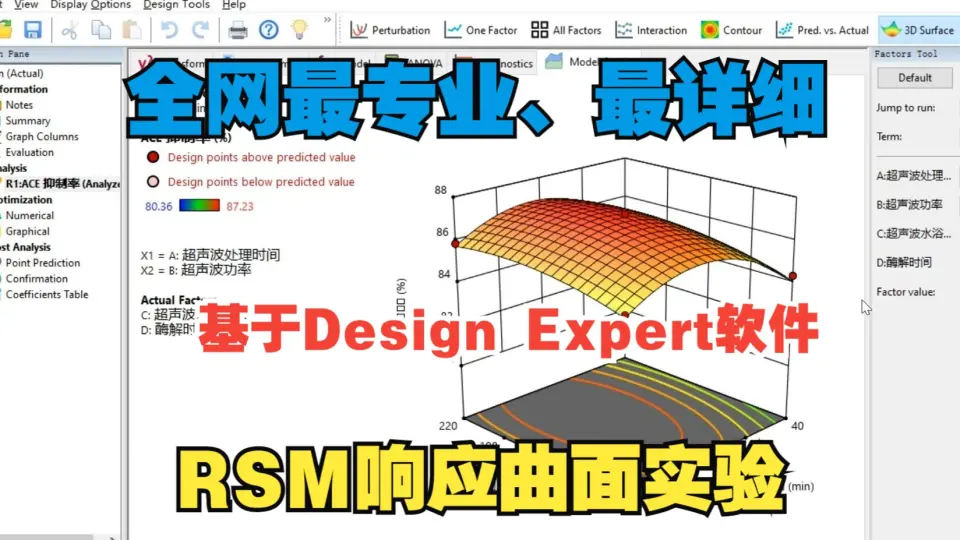

【模型诊断与优化策略】:高级响应曲面分析技术的深度解析

发布时间: 2025-01-09 14:35:36 阅读量: 19 订阅数: 15

响应面分析之python方法(二)二阶曲面分析

# 摘要

响应曲面方法(RSM)是一种统计技术,用于分析影响过程或产品的因素,并优化这些因素以提高性能。本文介绍了RSM的基础概念和模型诊断方法论,包括模型拟合的评估、模型假设检验以及交互作用和曲线关系的识别。第三章探讨了响应优化和实验设计优化的方法与技术,包括最优化理论和不同实验设计方案的优缺点。随后,第四章通过工业过程优化和产品设计优化案例展示了RSM的实际应用。最后,本文探讨了RSM技术面临的未来趋势与挑战,如高维数据分析和跨领域应用,以及技术整合与创新应用的可能性。RSM作为一种强大的分析工具,其在多个领域的应用前景广阔,并可能通过与其他技术,如大数据和人工智能的结合,带来新的发展方向。

# 关键字

响应曲面方法;模型诊断;优化策略;实验设计;数据分析;人工智能

参考资源链接:[Design-Expert响应曲面分析教程:Box-Behnken设计详解](https://wenku.csdn.net/doc/3ew3dgk40j?spm=1055.2635.3001.10343)

# 1. 响应曲面方法(RSM)的基础

## 1.1 RSM的基本概念

响应曲面方法(Response Surface Methodology,RSM)是一种统计技术,用于确定影响某个响应变量的因素之间的关系,并在此基础上优化设计。RSM通过实验设计收集数据,并使用多元回归分析构建一个或多个响应变量与一个或多个自变量之间的关系模型。RSM特别适用于那些难以用精确理论模型表达的系统,它通过设计的实验来了解复杂的输入和输出关系。

## 1.2 RSM的应用领域

RSM的应用领域广泛,涉及化学工程、制药科学、工业生产、质量控制以及在最近的发展中也适用于一些软件和工程领域的性能优化。在这些领域中,RSM能够帮助研究人员和工程师建立精确的模型,从而对产品和过程进行有效的优化。

## 1.3 RSM的基本步骤

RSM的基本步骤包括实验设计、数据收集、模型拟合、响应优化和模型验证。首先,选择恰当的实验设计来获取实验数据;然后,运用统计方法拟合一个模型;接着,通过响应优化找到最佳操作条件;最后,验证优化模型的有效性。这个过程循环迭代,直至获得最优解。

```mermaid

graph LR

A[开始] --> B[实验设计]

B --> C[数据收集]

C --> D[模型拟合]

D --> E[响应优化]

E --> F[模型验证]

F --> G[结束]

```

在下一章节中,我们将详细探讨RSM在模型诊断中的方法论,进一步深入理解这一技术的细节和应用。

# 2. ```

# 第二章:模型诊断的方法论

在统计学与数据分析领域,模型诊断是确保分析结果准确性和模型泛化能力的关键步骤。模型诊断能够揭示数据中可能存在的模式,以及模型在预测和解释变量关系时的表现。在响应曲面方法(RSM)中,模型诊断同样扮演着不可或缺的角色。本章将从评估指标、假设检验以及交互作用和曲线关系的识别等方面,探讨模型诊断的方法论。

## 2.1 模型拟合的评估指标

### 2.1.1 决定系数和调整决定系数

决定系数(R²)是衡量模型拟合优度的常用指标之一。它表示了模型可以解释的变异性占总变异性的比例。然而,当模型中包含较多自变量时,R²往往会随着变量数目的增加而增大,即使这些变量并不真正对模型有贡献。为此,调整决定系数(Adjusted R²)应运而生。Adjusted R²能够对模型中的自由度进行调整,从而对加入更多变量而可能带来的模型过度拟合提供了惩罚。这一指标在模型选择和比较时显得尤为重要。

```python

import numpy as np

from sklearn.metrics import r2_score

# 假设 y 是真实值,y_pred 是模型预测值

y = np.array([1, 2, 3, 4, 5])

y_pred = np.array([1.1, 1.9, 3.1, 4.2, 4.9])

# 计算 R²

r_squared = r2_score(y, y_pred)

print("R Squared:", r_squared)

# 计算 Adjusted R²

n = len(y) # 样本数量

p = 1 # 自变量数量

adj_r_squared = 1 - (1 - r_squared) * (n - 1) / (n - p - 1)

print("Adjusted R Squared:", adj_r_squared)

```

代码解释:该Python代码块展示了如何使用 `sklearn` 库中的 `r2_score` 函数来计算R²和Adjusted R²。首先,通过比较真实值 `y` 和预测值 `y_pred` 来评估模型的拟合情况。然后,通过公式计算得到Adjusted R²的值,从而对模型的复杂性和预测能力进行更为合理的评估。

### 2.1.2 残差分析和异常值检测

残差分析是检查回归模型假设是否满足的重要手段。残差即为观测值与模型预测值之间的差异。理想情况下,残差应该呈现出随机分布的特点,没有明显的模式或趋势。如果残差存在明显的模式,这表明模型可能存在某些问题,如不正确的模型形式、缺失的变量或异常值的存在。

```python

import matplotlib.pyplot as plt

# 假设 residuals 是计算得到的残差

residuals = y - y_pred

# 残差散点图

plt.scatter(range(len(y)), residuals)

plt.axhline(y=0, color='red', linestyle='--')

plt.xlabel('Observation')

plt.ylabel('Residual')

plt.title('Residual Plot')

plt.show()

```

代码解释:此代码块通过 `matplotlib` 库绘制了残差散点图。通过该图,可以直观地查看残差是否围绕着零线随机分布。如果发现残差存在某种模式,如呈曲线形状或存在某些异常点,则表明模型可能需要进一步调整。

## 2.2 模型假设的检验

### 2.2.1 独立性检验

在回归分析中,一个关键的假设是观测值之间相互独立。在时间序列数据或空间数据中,这种独立性假设可能会被违背。独立性检验可以采用Durbin-Watson统计量来检查残差是否具有自相关性。如果Durbin-Watson值接近于2,则表明残差之间不存在显著的自相关性。

### 2.2.2 正态性和同方差性检验

正态性假设表明残差应近似地服从正态分布,这对于许多统计检验是必要的前提。Shapiro-Wilk检验用于检验残差的正态性。同方差性假设意味着在自变量的所有水平下,观测值的误差项具有相同的方差。如果违反了这一假设,模型可能会导致参数估计和预测的不准确。可以采用Breusch-Pagan检验、White检验或Goldfeld-Quandt检验来检查同方差性。

### 2.2.3 多重共线性检验

多重共线性是指模型中的自变量之间高度相关的情况。这可能导致回归系数估计的不准确和不稳定性。方差膨胀因子(VIF)是检验多重共线性的一个常用方法。VIF值大于10通常表明存在严重的共线性问题。

```python

from statsmodels.stats.outliers_influence import variance_inflation_factor

# 假设 X 是自变量的数据矩阵

X = np.array([[1, 0], [0, 1], [1, 0.9], [1, 1.1]])

# 计算 VIF

vif_data = pd.DataFrame()

vif_data["feature"] = X.columns

vif_data["VIF"] = [variance_inflation_f

0

0