【数据清洗】:深入***请求验证和数据清洗机制

发布时间: 2024-10-23 08:28:29 阅读量: 33 订阅数: 27

连接数据宝库:API数据收集的实战指南

# 1. 数据清洗与请求验证的基础概念

在信息技术领域,数据清洗和请求验证是确保数据质量和系统安全的重要环节。它们帮助开发者和数据工程师维护数据完整性,提升用户体验,并确保系统运行的稳健性。

数据清洗是识别并修正数据集中的错误和不一致的过程,它涵盖了从纠正拼写错误到处理重复记录等多个方面。数据清洗的关键在于确保数据的准确性和一致性,这是任何数据分析和应用开发活动的前提条件。

请求验证则是确保进入系统的数据请求是有效且安全的过程。通过对数据请求进行检查,可以预防恶意攻击,比如防止SQL注入、跨站脚本攻击等,同时也可以确保数据的正确性和完整性。在本章中,我们将探索数据清洗与请求验证的基础概念,为后续章节的深入分析打下坚实的基础。

# 2. 数据清洗的理论框架

## 2.1 数据清洗的必要性与目标

### 2.1.1 数据质量问题的分类

在数据的生命周期中,数据质量问题无处不在,它们可能源于数据的录入、处理、存储、传输等各个环节。数据质量问题主要可以分为以下几类:

1. **完整性问题**:数据字段可能未被填写,或者存在缺失值。这可能是由于数据采集时的失误,或者数据收集和输入过程中的人为错误所致。

2. **一致性问题**:数据在不同时间或不同系统间存在不一致的情况。例如,同一个客户在不同系统中的名称、地址或联系方式可能不同。

3. **准确性问题**:数据与实际情况不符,通常是由于输入错误、数据过时或错误的数据解释和转换。

4. **重复性问题**:同一信息被重复存储,导致数据冗余。

5. **规范性问题**:数据不符合预定义的格式或标准,如日期格式不统一、文本大小写不规范等。

### 2.1.2 数据清洗的目标与效果

数据清洗的目标是确保数据的质量,以提高数据的可用性和可靠性。具体效果包括:

1. **提高数据质量**:通过纠正数据错误和不一致性,提高整体的数据质量。

2. **提升数据一致性**:确保数据在不同时间、不同系统间保持一致性,以便于跨部门或跨平台的数据整合和分析。

3. **减少数据分析的复杂度**:通过清除冗余和不相关数据,简化后续的数据分析和挖掘过程。

4. **提高数据处理效率**:干净的数据集需要更少的处理时间,从而提高数据处理的效率。

5. **降低存储成本**:去除重复数据可以节省存储空间,降低数据存储和维护成本。

## 2.2 数据清洗的技术与方法

### 2.2.1 数据预处理技术

在数据清洗之前,通常需要进行预处理,以确保数据格式统一、格式正确,便于后续处理。数据预处理技术包括:

- **数据标准化**:确保数据以统一的格式存储,例如日期和时间的格式统一,文本字段的大小写规范等。

- **数据归一化**:将数据调整到某一特定的范围或分布,以便于处理和分析。

- **数据转换**:根据业务需求对数据进行转换,例如从原始数据中计算新的属性或维度。

### 2.2.2 数据清洗的关键步骤

数据清洗的关键步骤通常包括以下几个阶段:

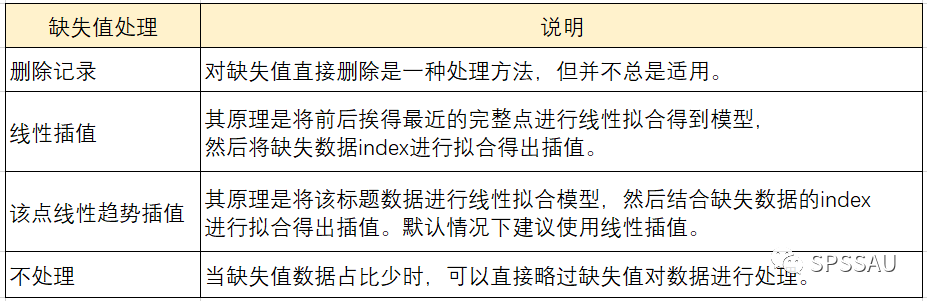

1. **识别错误和缺失值**:使用各种规则和模式匹配来检测数据中的错误或缺失值。

2. **纠正错误和填充缺失值**:根据数据的上下文和业务规则进行错误修正和缺失值的填充。

3. **数据转换**:进行必要的数据类型转换,例如将字符串转换为日期格式。

4. **消除重复记录**:通过比较关键字段的值来识别和合并重复的数据记录。

5. **数据一致性检查**:确保数据在各个系统和应用中保持一致性。

### 2.2.3 清洗数据的评估标准

清洗后的数据是否达到了预期的标准,需要通过一系列的评估来确认。评估标准包括:

- **完整性**:数据集是否完整,所有必要的字段是否都被正确填写。

- **一致性**:数据是否在整个数据集中保持一致。

- **准确性**:数据是否真实反映了现实世界的情况。

- **唯一性**:数据集中是否没有重复记录。

## 2.3 数据清洗工具与平台

### 2.3.1 开源数据清洗工具介绍

许多开源工具提供了丰富的数据清洗功能,其中包括:

- **OpenRefine**:一个功能强大的工具,用于处理结构化数据,尤其是具有数据转换和分组功能。

- **Talend**:提供一系列的开源和商业数据集成解决方案,适合进行大规模数据清洗。

- **Pandas**:Python的一个数据分析库,提供了大量的数据清洗功能,适合数据科学家进行数据预处理。

### 2.3.2 商业数据清洗平台分析

商业数据清洗平台因其功能全面和易用性而受到企业的青睐,例如:

- **Informatica**:一个企业级的数据集成和数据质量解决方案提供商,支持复杂的数据清洗任务。

- **Trifacta**:提供可视化数据清洗工具,支持数据探索、清洗和准备,以进行后续分析和机器学习。

- **DataStage**:IBM的一个企业级数据集成平台,能够进行大规模数据清洗和转换。

以上章节内容从数据清洗的必要性与目标、技术与方法,到工具与平台进行了全面的介绍,旨在为读者提供一个数据清洗的理论框架,以及对相关技术和工具的深入了解。在接下来的章节中,我们将进一步探讨数据清洗在Web请求处理中的应用。

# 3. 请求验证的理论与实践

请求验证是确保数据完整性和系统安全的关键步骤,它涉及到从请求发起开始到数据处理结束的整个过程。本章节将详细探讨请求验证的定义、类型、重要性以及在实际应用中如何实现和优化请求验证流程。

## 3.1 请求验证的定义和作用

### 3.1.1 请求验证的类型与重要性

请求验证是在数据输入到系统前,对数据进行格式、范围和逻辑的检查以确保数据的正确性和安全性。类型可以分为前端验证、后端验证以及服务器端验证,它们各自扮演不同的角色。

前端验证通常发生在用户输入数据之后,浏览器端就立即进行,以快速响应用户,改善用户体验。后端验证在数据到达服务器之后,业务逻辑处理之前进行,检查数据是否符合业务规则。服务器端验证通常涉及更复杂的逻辑,例如利用服务器端脚本进行安全性校验。

请求验证的重要性体现在多个层面。首先,它能防止恶意用户进行注入攻击,保护系统不受数据污染。其次,它确保数据的准确性,避免了错误的数据导致的业务逻辑错误或计算错误。最后,通过验证提升用户体验,减少了无效的请求和不必要的数据回传,加速了交互过程。

## 3.2 请求验证的技术实现

### 3.2.1 校验机制的基本原理

请求验证的校验机制包括了一系列预设的规则,这些规则能够检测数据是否符合预期格式、是否在可接受的范围内,以及是否符合相关的业务逻辑。基本原理是通过一系列的验证函数和规则引擎来实现。

例如,正则表达式是一种常见的数据格式验证方式,用于检测数据是否符合特定的模式,如电子邮件地址、电话号码等。逻辑规则引擎则可以用来执行更为复杂的验证,比如检查两个字段之间的依赖关系是否合理。

### 3.2.2 实现请求验证的算法与方法

实现请求验证的算法和方法通常包括:

- **模式匹配**:使用正则表达式检查数据格式。

- **范围检查**:检查数据是否在预定义的最小值和最大值之间。

- **依赖验证**:验证一个字段的值是否取决于另一个字段的值。

- **列表校验**:检查数据是否在一个预先定义好的集合之中。

- **完整性验证**

0

0