concureent.futures性能优化攻略:提升Python并发程序效率的秘诀

发布时间: 2024-10-02 06:42:48 阅读量: 22 订阅数: 22

# 1. concurrent.futures模块概述

Python作为一门广泛使用的编程语言,在处理并发编程时,开发者往往需要处理复杂的多线程或多进程编程逻辑。随着编程需求的日益增长,Python在标准库中引入了`concurrent.futures`模块,它为开发者提供了执行异步调用和并行任务的高级接口。本章将详细介绍这个模块的基本概念和优势,并探讨它与传统并发编程方式相比所带来的改进。

## 1.1 模块设计理念与优势

`concurrent.futures`模块的设计理念是简化并发编程模型,同时提高代码的可读性和可维护性。模块内置的`ThreadPoolExecutor`和`ProcessPoolExecutor`抽象了线程和进程的创建和管理过程,开发者只需关注任务本身即可。模块的优势在于:

- **简洁性**:通过高级接口隐藏了线程和进程管理的复杂性。

- **可扩展性**:易于添加其他并发执行策略和执行器。

- **复用性**:支持任务的重复执行以及结果的管理。

## 1.2 模块与旧式并发工具的对比

与旧式的`threading`和`multiprocessing`模块相比,`concurrent.futures`提供了更高级的抽象和更简洁的API。开发者不再需要手动管理线程或进程的生命周期,也不用担心诸如线程同步和通信这类复杂问题。它通过`Future`对象来表示异步执行的操作,这为并行任务的执行和结果的获取带来了便利。与旧式工具相比,`concurrent.futures`使用更加直观且易于上手。

在后续章节中,我们将详细探讨如何使用这个模块,并通过实例演示其强大的功能。

# 2. 理解并发与并行

理解并发与并行是掌握concurrent.futures模块乃至整个并发编程领域至关重要的第一步。在本章节中,我们将深入探讨并发与并行的基本概念,并分析Python中的并发模型。同时,我们将探讨concurrent.futures模块如何在现代并发编程中扮演其角色。

## 2.1 并发和并行的基本概念

### 2.1.1 理解多任务和并发

多任务是指在同一时间内执行多个任务的能力。在计算机科学中,这通常通过并发来实现。并发(Concurrency)是指从宏观上看多个任务似乎是在同时进行,但实际在微观的时间线上,这些任务可能是在交替执行。这与并行(Parallelism)不同,后者指的是多个任务真正的同时执行,这通常需要多核处理器或者分布式系统。

并发在单核处理器上的实现依赖于操作系统的线程调度和上下文切换。每个线程在执行时占用CPU时间片,通过快速切换,给人一种多个任务同时运行的错觉。

### 2.1.2 并行计算的原理和重要性

并行计算是通过多处理器同时执行多个计算任务。并行计算的核心在于提高执行效率,缩短任务执行时间。它对于处理大规模数据集和需要高性能计算的场景尤为关键。

并行计算的原理在于将问题分解为可并行处理的子问题,然后在不同的处理单元上独立求解。并行程序设计需要考虑数据分配、负载均衡、通信开销和同步等多方面因素。

并行计算的重要性表现在以下几个方面:

- **性能提升**:当有足够多的独立任务时,能够显著提高程序的执行速度。

- **资源优化**:能够更有效地利用硬件资源,尤其是多核处理器。

- **解决大规模问题**:对于科学计算、大数据处理等领域,不使用并行计算可能根本无法完成任务。

## 2.2 Python中的并发模型

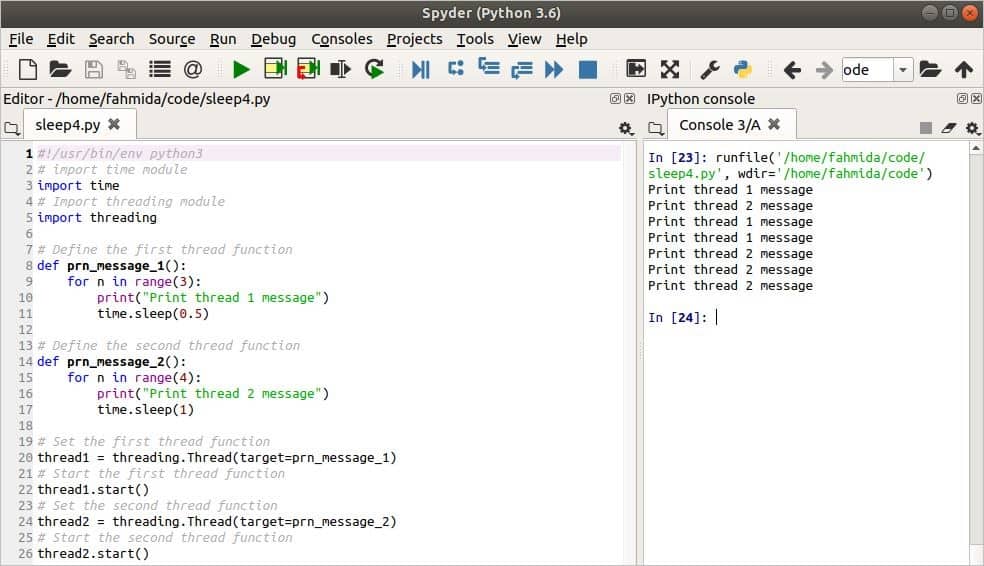

### 2.2.1 多线程编程模型

Python提供了多种并发编程模型,其中多线程是最直观的一种。Python的多线程基于操作系统级别的线程实现。多线程模型允许程序在单个进程内同时运行多个线程。

Python标准库中的`threading`模块提供了创建和管理线程的工具。然而,由于全局解释器锁(GIL)的存在,Python的多线程在执行CPU密集型任务时可能不会带来预期的性能提升。

### 2.2.2 多进程编程模型

为了绕开GIL对多线程的限制,Python中的多进程模型通过`multiprocessing`模块提供。它允许在不同的进程中运行任务,每个进程都有自己的Python解释器和内存空间,因此不存在GIL的限制。

多进程编程在CPU密集型任务中能更好地利用多核处理器的计算资源,但需要更复杂的进程间通信机制。

## 2.3 concurrent.futures模块的角色

### 2.3.1 模块设计理念与优势

`concurrent.futures`模块是在Python 3.2中引入的,旨在简化多线程或多进程的使用,提供统一的异步执行接口。模块通过`ThreadPoolExecutor`和`ProcessPoolExecutor`类来实现线程池和进程池。

该模块的设计理念在于:

- **简化并发编程**:隐藏底层线程或进程管理的复杂性。

- **提高代码的可读性**:通过高层次的API,使得并发编程更加直观。

- **提升性能**:合理地管理和调度任务,减少资源浪费。

### 2.3.2 模块与旧式并发工具的对比

与传统的`threading`和`multiprocessing`模块相比,`concurrent.futures`提供了更加高级和简洁的抽象层。它减少了编码时的手动线程或进程管理,让开发者能够更专注于业务逻辑。

例如,使用`concurrent.futures`时,无需手动创建线程或进程对象,也无需直接管理它们的生命周期。开发者只需要实现任务函数,然后将任务提交给`Executor`对象,等待结果即可。

模块还提供了`Future`对象来代表异步执行的操作,这使得查询任务状态、获取结果或取消任务变得轻而易举。

总结来说,`concurrent.futures`模块的优势在于其提供的高级抽象和简洁的API,这不仅能够提高开发效率,还有助于编写出更加健壮和易于维护的并发代码。

# 3. concurrent.futures模块实践

## 3.1 使用ThreadPoolExecutor进行线程并发

### 3.1.1 线程池的创建和使用

Python的`concurrent.futures`模块提供了一个非常便捷的方式来创建线程池:`ThreadPoolExecutor`。线程池可以管理一组可重用的线程,以执行调用提交给它的任务,而无需为每个任务都创建和销毁新的线程,从而提高了程序的性能和资源利用率。

使用`ThreadPoolExecutor`的基本步骤如下:

1. 导入`ThreadPoolExecutor`类

2. 创建`ThreadPoolExecutor`实例

3. 通过`executor.map`或`executor.submit`方法提交任务

4. 关闭线程池以防止进一步提交任务

5. 等待所有任务完成

下面是简单的代码示例:

```python

from concurrent.futures import ThreadPoolExecutor

# 定义一个要执行的任务函数

def my_task(n):

return n * n

# 创建一个ThreadPoolExecutor实例

executor = ThreadPoolExecutor(max_workers=5)

# 使用executor.map提交任务并处理结果

for result in executor.map(my_task, range(10)):

print(result)

# 关闭线程池,不再接受新的任务

executor.shutdown()

```

### 3.1.2 线程池的参数配置和性能影响

在使用`ThreadPoolExecutor`时,我们可以通过不同的参数来自定义线程池的行为,以获得最佳的性能。主要的参数有:

- `max_workers`:线程池中最大线程数,默认为处理器核心数的5倍。需要注意的是,并不是线程数越多越好,因为过度的线程切换也会导致性能下降。

- `initializer`和`initargs`:如果提供了这两个参数,每个工作线程在首次使用前会调用`initializer(*initargs)`进行初始化。

- `thread_name_prefix`:为工作线程设置名称前缀,有助于调试和日志记录。

合理配置线程池的参数,可以提升任务处理效率。过高的`max_workers`可能会导致资源竞争和上下文切换开销,而过低则可能无法充分利用多核处理器的优势。

在实际应用中,可以通过压力测试来确定最佳的`max_workers`值。通常,对于CPU密集型任务,将线程数设置为CPU核心数或稍高一点是一个好的起点;而对于I/O密集型任务,可以设置更高的线程数,因为这些任务更多地被阻塞在等待I/O操作上。

下面是一个使用`max_workers`参数配置线程池的示例:

```python

from concurrent.futures import ThreadPoolExecutor

# 定义一个I/O密集型任务函数

def my_io_task(n):

# 模拟I/O操作

import time

time.sleep(1)

return n * n

# 创建一个ThreadPoolExecutor实例,设置线程池大小为10

executor = ThreadPoolExecutor(max_workers=10)

# 使用executor.map提交任务并处理结果

for result in executor.map(my_io_task, range(10)):

print(result)

# 关闭线程池

executor.shutdown()

```

## 3.2 使用ProcessPoolExecutor进行进程并发

### 3.2.1 进程池的创建和使用

`ProcessPoolExecutor`是`concurrent.futures`模块中用于进程间并发的类。它与`ThreadPoolExecutor`类似,但它是用来创建进程池而不是线程池。由于Python的全局解释器锁(GIL)的限制,使用进程池可以绕过GIL,从而利用多核CPU的优势来提高程序的性能。

进程池的创建和使用步骤类似于线程池:

1. 导入`ProcessPoolExecutor`类

2. 创建`ProcessPoolExecutor`实例

3. 使用`executor.map`或`executor.submit`方法提交任务

4. 关闭进程池以防止进一步提交任务

5. 等待所有任务完成

下面是一个进程池的基本使用示例:

```python

from concurrent.futu

```

0

0