【Python数据库连接进阶】:探索并发处理与异步I_O的神秘力量

发布时间: 2024-10-16 16:03:14 阅读量: 21 订阅数: 14

Python高級编程_python进阶_python高级编程_

# 1. Python数据库连接基础

## 1.1 数据库连接概述

在Python中,数据库连接是通过各种数据库驱动实现的,这些驱动通常遵循Python数据库API规范(DB-API)。DB-API定义了一组标准对象和接口,用于与数据库进行交互,从而保证了不同数据库之间的可移植性和一致性。

## 1.2 安装数据库驱动

要连接到数据库,首先需要安装与目标数据库相对应的Python驱动。例如,连接MySQL数据库,可以使用`mysql-connector-python`包,而连接PostgreSQL数据库,则可以使用`psycopg2`包。

### 示例代码安装MySQL驱动:

```bash

pip install mysql-connector-python

```

## 1.3 建立连接与执行查询

通过数据库驱动建立连接后,可以创建游标对象来执行SQL语句。游标允许执行查询、获取数据,并处理可能出现的异常。

### 示例代码执行连接和查询:

```python

import mysql.connector

# 建立连接

conn = mysql.connector.connect(user='username', password='password', host='localhost', database='mydb')

# 创建游标

cursor = conn.cursor()

# 执行查询

cursor.execute("SELECT * FROM mytable")

# 获取查询结果

for (col1, col2, ...) in cursor.fetchall():

print(col1, col2, ...)

# 关闭连接

cursor.close()

conn.close()

```

在本章中,我们将深入探讨如何在Python中建立和管理数据库连接,以及如何执行基本的数据库操作。这为后续章节中更高级的并发处理和异步I/O操作打下了坚实的基础。

# 2. 并发处理的艺术

在本章节中,我们将深入探讨并发处理的艺术,这是提升数据库操作效率的关键技术之一。我们将从基本概念开始,逐步深入到并发数据库操作的实践案例,以及如何构建高效的并发数据库应用。

## 2.1 并发处理的基本概念

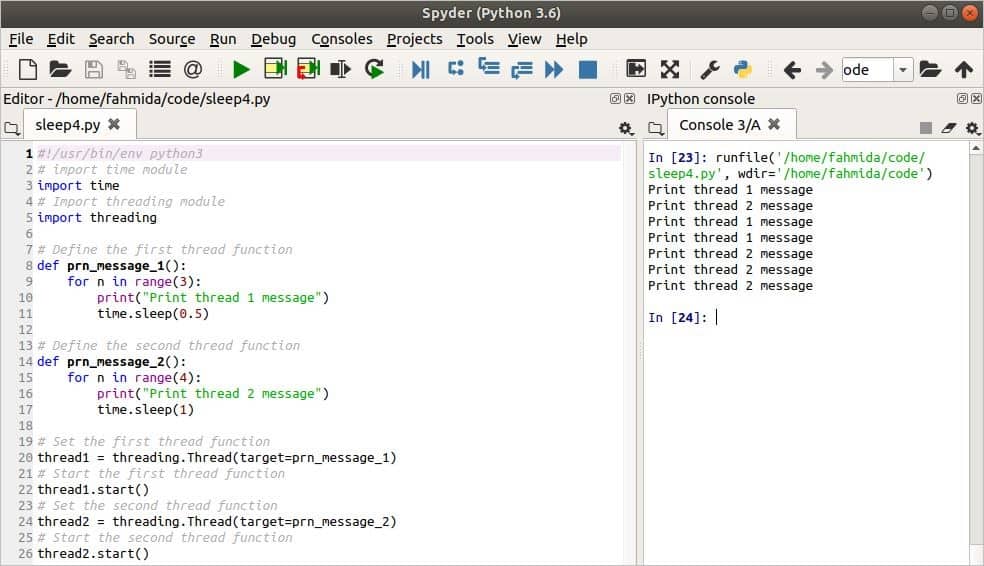

### 2.1.1 多线程基础

多线程是并发处理的一种基础形式,它允许程序同时执行多个线程来完成不同的任务。在Python中,线程是通过`threading`模块来实现的。

```python

import threading

def print_numbers():

for i in range(1, 6):

print(i)

# 创建线程

thread = threading.Thread(target=print_numbers)

# 启动线程

thread.start()

```

在这个简单的例子中,我们定义了一个`print_numbers`函数,然后创建了一个线程来执行这个函数。线程启动后,主线程和新线程会并发执行。

#### 逻辑分析:

- `threading.Thread(target=print_numbers)`创建了一个新的线程对象,指定了要执行的函数`print_numbers`。

- `thread.start()`方法启动了线程的执行。

### 2.1.2 多进程基础

多进程与多线程类似,但它是在不同的进程间进行并发处理。在Python中,可以使用`multiprocessing`模块来实现多进程。

```python

import multiprocessing

def print_numbers():

for i in range(1, 6):

print(i)

# 创建进程

process = multiprocessing.Process(target=print_numbers)

# 启动进程

process.start()

```

#### 逻辑分析:

- `multiprocessing.Process(target=print_numbers)`创建了一个新的进程对象,同样指定了要执行的函数`print_numbers`。

- `process.start()`方法启动了进程的执行。

## 2.2 并发数据库操作

### 2.2.1 线程安全与数据库连接

在多线程环境下,多个线程可能会同时访问同一个数据库连接,这可能会导致数据不一致或者竞态条件。因此,我们需要确保线程安全。

```python

import threading

import queue

# 创建一个线程安全的队列

task_queue = queue.Queue()

def worker():

while True:

# 从队列中获取任务

task = task_queue.get()

if task is None:

break

# 执行任务

print(f"Processing task: {task}")

# 通知队列任务已完成

task_queue.task_done()

# 创建多个工作线程

for _ in range(5):

t = threading.Thread(target=worker)

t.daemon = True

t.start()

# 提交任务到队列

for i in range(10):

task_queue.put(i)

# 等待所有任务完成

task_queue.join()

# 停止工作线程

for _ in range(5):

task_queue.put(None)

```

#### 逻辑分析:

- 使用`queue.Queue`创建了一个线程安全的队列,工作线程将从队列中获取任务。

- 每个工作线程会检查队列中的任务,执行完毕后通知队列任务已完成。

- 通过`task_queue.join()`等待所有任务完成。

### 2.2.2 进程间数据库通信机制

在多进程环境下,由于每个进程都有自己独立的内存空间,进程间的通信就变得尤为重要。我们可以使用`multiprocessing`模块提供的`Pipe`或者`Queue`来实现。

```python

import multiprocessing

def worker(pipe):

while True:

# 从管道中接收数据

data = pipe.recv()

if data is None:

break

# 处理数据

result = f"Processed {data}"

# 发送处理结果

pipe.send(result)

pipe.close()

# 创建管道

parent_conn, child_conn = multiprocessing.Pipe()

# 创建工作进程

p = multiprocessing.Process(target=worker, args=(child_conn,))

p.daemon = True

p.start()

# 向工作进程发送数据

for i in range(5):

parent_conn.send(i)

print(f"Parent received: {parent_conn.recv()}")

# 发送结束信号

parent_conn.send(None)

# 等待工作进程结束

p.join()

```

#### 逻辑分析:

- 使用`multiprocessing.Pipe()`创建了一个管道,用于进程间的通信。

- 工作进程会从管道中接收数据,处理后发送回管道。

- 主进程通过管道发送数据给工作进程,并接收处理结果。

## 2.3 实践案例:构建并发数据库应用

### 2.3.1 并发数据库应用设计

在设计并发数据库应用时,我们需要考虑以下几个方面:

1. **资源管理**:确保对数据库资源的访问不会冲突。

2. **线程/进程安全**:确保线程或进程安全地访问和修改数据。

3. **性能优化**:优化数据库操作,减少不必要的开销。

### 2.3.2 并发处理性能优化

性能优化是并发数据库应用的关键。以下是一些常见的优化策略:

1. **使用连接池**:连接池可以重用数据库连接,减少连接开销。

2. **减少锁的使用**:锁的使用会降低并发性能,应尽量减少。

3. **优化查询语句**:优化SQL语句,减少查询时间。

在本章节中,我们介绍了并发处理的基本概念,包括多线程和多进程的基础知识,以及线程安全和进程间通信的机制。此外,我们还探讨了如何设计和优化并发数据库应用。这些知识将为我们深入探讨异步I/O和进阶案例分析打下坚实的基础。

# 3. 异步I/O的魔法

#### 3.1 异步I/O的基本原理

在本章节中,我们将深入探讨异步I/O的基本原理。异步I/O是一种编程技术,它允许程序在等待一个长时间的操作(如磁盘I/O或网络I/O)完成时,继续执行其他任务,从而提高程序的执行效率。

##### 3.1.1 同步、异步、阻塞、非阻塞

首先,我们需要理解同步与异步、阻塞与非阻塞之间的区别:

- **同步**:指的是程序的执行顺序与代码的书写顺序一致,每个操作必须等待前一个操作完成后才能开始。

- **异步**:指的是程序的执行顺序与代码的书写顺序不一致,可以不等待前一个操作完成就执行下一个操作。

- **阻塞**:指的是当前操作未完成时,后续操作必须等待,不能继续执行。

- **非阻塞**:指的是当前操作未完成时,后续操作可以继续执行,不强制等待。

在异步编程中,我们可以使用异步I/O操作来避免程序在等待I/O操作完成时停滞不前,从而提高程序的整体效率。

0

0