【音频处理实战】:Wave库在音频合成与时间伸缩中的独特应用

发布时间: 2024-10-05 12:10:29 阅读量: 14 订阅数: 20

# 1. 音频处理基础与Wave库概览

音频处理是数字信号处理的一个重要分支,广泛应用于娱乐、通信以及语音识别等领域。了解音频处理的基础知识是掌握音频库应用的前提。在本章中,我们将带领读者首先对音频信号处理有一个初步的认识,再对Python中的Wave库进行概览性介绍。

## 1.1 音频信号处理简介

音频信号是一种模拟信号,其包含声波的频率、振幅等信息,可被转换为数字信号进行处理。数字音频信号处理主要涉及采样、量化、编码等步骤。通过对这些步骤的优化与算法的应用,我们可以实现各种音频效果的处理,如去噪、混音、回声等。

## 1.2 Wave库简介

Wave库是Python的一个标准库,用于读取和写入WAV文件。WAV是一种常见的音频文件格式,它保存的是未压缩的原始音频数据。Wave库提供了一系列简单易用的API,使得开发者可以轻松地对WAV文件进行操作。例如,它可以读取WAV文件中的音频数据、修改音频帧的某些属性,或者生成新的音频数据。

```python

import wave

# 打开一个WAV文件

with wave.open('example.wav', 'r') as wav_***

* 获取文件参数

params = wav_file.getparams()

nchannels, sampwidth, framerate, nframes = params[:4]

str_data = wav_file.readframes(nframes)

```

在上述代码中,我们使用`wave`模块打开了一个名为`example.wav`的音频文件,并获取了它的基本参数,如通道数、样本宽度、帧率和帧数。此外,还读取了文件中的音频帧数据。

接下来的章节,我们将详细介绍音频合成、时间伸缩、高级音频处理技巧以及音频处理项目的构建与部署。

# 2. 音频合成的理论与实践

## 2.1 音频合成的基本概念

音频合成是将两个或多个声音波形混合在一起形成一个新声音的过程。这种技术在音乐制作、影视后期制作以及电子声音生成等领域有着广泛的应用。要理解音频合成,首先需要对音频信号有一个基础的认识。

### 2.1.1 音频信号的基础

音频信号是一种模拟信号,表示声音随时间变化的物理量。音频信号的基本参数包括频率、振幅、相位和波形。这些参数决定了声音的音高、音量、音色等基本属性。在数字音频处理中,音频信号经过采样和量化后变成了一系列的离散值,存储在计算机中。因此,数字音频信号的表示需要关注采样率和采样深度。

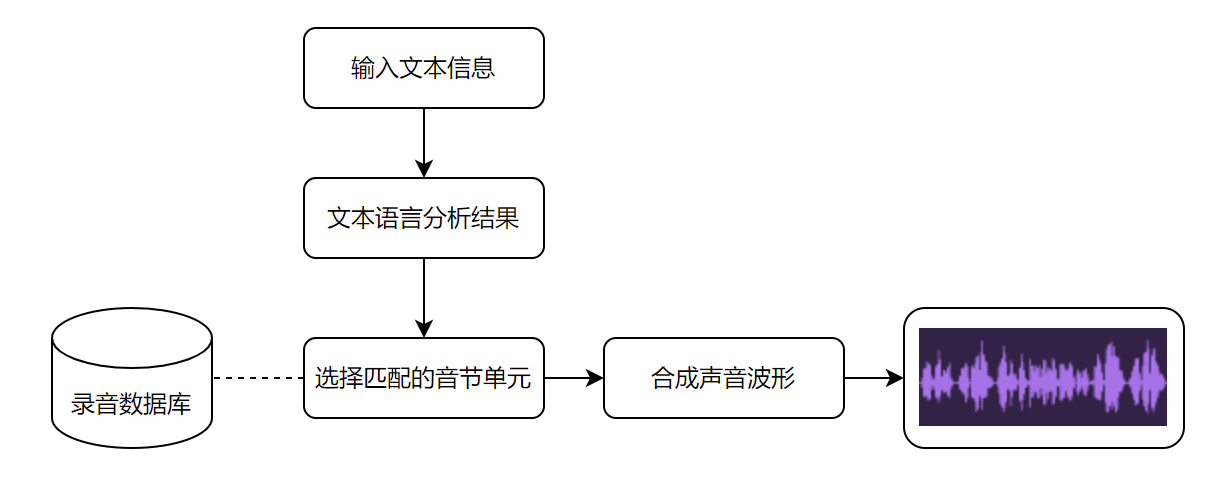

### 2.1.2 合成技术的分类与原理

音频合成技术可以分为两大类:物理模型合成和波表合成。物理模型合成是基于声音的物理产生原理,通过算法模拟乐器或声源的声学特性,产生声音。波表合成则是利用预先录制的声波样本(波表)来合成声音。它涉及的关键技术包括FM(调频)合成、加法合成、减法合成等。

## 2.2 Wave库在音频合成中的应用

Wave库是一个在许多编程语言中通用的音频处理库,它提供了许多处理音频文件和音频流的功能。本节将介绍Wave库的基本操作和如何利用Wave库进行音频片段的拼接。

### 2.2.1 Wave库的基本操作

Wave库允许用户以一种简单的方式读取和写入音频文件。基本操作包括读取WAV文件头部信息、加载音频样本数据、保存音频样本等。以Python的wave库为例,以下是一个基本的代码示例:

```python

import wave

# 打开一个WAV文件

with wave.open('example.wav', 'r') as wav_***

* 获取音频参数

params = wav_file.getparams()

nchannels, sampwidth, framerate, nframes = params[:4]

# 读取音频样本数据

frames = wav_file.readframes(nframes)

# 关闭文件

wav_file.close()

# 由于wave模块是处理WAV文件的,通常没有直接写入音频样本数据的函数。

# 通常需要将音频样本数据转换为字节数据后写入。

```

### 2.2.2 利用Wave库进行音频片段的拼接

音频拼接是将两个或多个音频文件合并为一个连续音频流的过程。下面的代码片段展示了如何利用Wave库实现音频片段的拼接:

```python

import wave

def splice_audio(files, output_file):

# 打开第一个音频文件

with wave.open(files[0], 'r') as f1, wave.open(output_file, 'w') as f_out:

# 复制第一个文件的头部信息到输出文件

f_out.setparams(f1.getparams())

while True:

data = f1.readframes(4096) # 读取4096帧数据

if not data:

break

f_out.writeframes(data)

# 从第二个音频文件开始拼接

for i in range(1, len(files)):

with wave.open(files[i], 'r') as f_next:

f_out.setnchannels(f_next.getnchannels())

f_out.setsampwidth(f_next.getsampwidth())

f_out.setframerate(f_next.getframerate())

while True:

data = f_next.readframes(4096)

if not data:

break

f_out.writeframes(data)

# 调用函数进行音频拼接

splice_audio(['audio1.wav', 'audio2.wav', 'audio3.wav'], 'spliced_audio.wav')

```

在上述代码中,首先打开第一个音频文件并复制其头部信息到输出文件。然后不断读取当前文件的音频样本数据,并写入输出文件。对于第二个及之后的音频文件,需要在开始拼接前设置输出文件的声道数、样本宽度和帧率,以确保音频数据的一致性。

## 2.3 实战演练:创建多轨合成器

多轨合成器是指可以同时处理多个音频轨道的合成器。在本节中,将设计多轨合成器的逻辑结构,并给出编码实现及调试的方法。

### 2.3.1 设计多轨合成器的逻辑结构

设计一个多轨合成器首先需要定义音频轨道的数据结构,每个轨道应该包括音频数据、音量控制等。然后需要定义一个管理器来负责各个轨道之间的音频混合。以下是一个可能的多轨合成器设计逻辑:

1. 定义音频轨道类(AudioTrack),包含音频数据和音量属性。

2. 定义合成器类(AudioSynthesizer),用于添加、移除轨道,以及控制轨道的播放。

3. 在合成器类中实现混音方法,将不同轨道的音频信号混合在一起。

### 2.3.2 编码实现及调试

编码实现多轨合成器涉及到多个音频信号的同步处理,需要考虑到音轨之间的同步问题。以下是一段简化的代码实现:

```python

class AudioTrack:

def __init__(self, data):

self.data = data # 音频样本数据

self.volume = 1.0 #

```

0

0