人工智能的未来:揭秘10大技术挑战与突破机遇

发布时间: 2024-09-02 05:33:03 阅读量: 129 订阅数: 82

# 1. 人工智能的现状与发展趋势

## 1.1 人工智能的演进历程

人工智能(AI)自20世纪中叶诞生以来,经历了多次技术浪潮的洗礼。从早期的规则驱动专家系统,到现在的深度学习,每一次技术革新都极大地推动了AI的发展。AI的演进不仅体现了计算能力的提升,也反映了理论算法的突破和应用需求的不断变化。

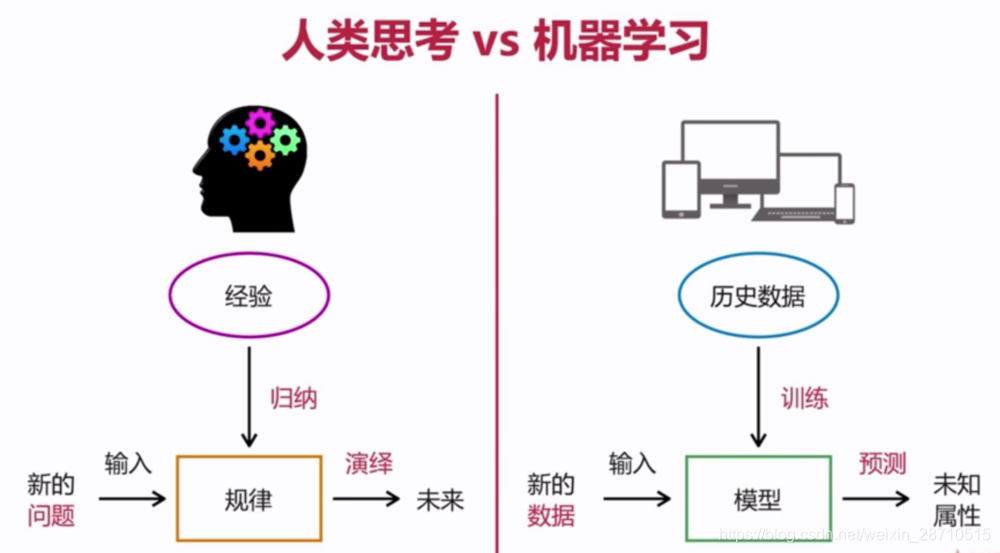

## 1.2 当前AI的主要技术路线

目前,AI领域的主要技术路线包括机器学习、深度学习、强化学习等。机器学习侧重于从数据中学习规律,深度学习则以复杂神经网络模拟人脑结构,强化学习则侧重于如何通过与环境的交互来学习最优策略。这些技术在语音识别、图像处理、推荐系统等多个领域取得了显著的应用成果。

## 1.3 未来AI的发展趋势

展望未来,AI的发展趋势主要集中在算法优化、跨界融合以及伦理法规的建立上。随着算力的不断增强和数据量的日益增长,AI模型将变得更加精准和智能。同时,AI将与更多行业相结合,推动社会整体进步,但这也对AI的伦理与隐私保护提出了更高要求。

在本章中,我们将探讨AI在当前技术背景下的发展现状,分析推动AI发展的主要技术路线,并对AI未来的发展趋势进行预测。通过深入了解AI的过去与未来,可以帮助我们更好地认识AI,并在AI时代中占据一席之地。

# 2. 深度学习的理论与实践

### 2.1 深度学习基础理论

深度学习是一种基于人工神经网络的学习方法,其灵感来源于人类大脑的工作机制。深度学习模型通过多层的神经元进行信息处理,每一层都对输入的数据进行一次更加复杂的变换,以此来学习数据的高级特征。

#### 2.1.1 神经网络的构成与工作原理

神经网络由输入层、隐藏层和输出层构成。每个层由多个神经元组成,神经元间通过权重连接。在前馈网络中,数据从输入层开始,逐层传递,最终通过输出层得到结果。这个过程中,每个神经元的输出是其输入的加权和经过一个非线性激活函数的变换。常见的激活函数包括sigmoid、tanh和ReLU等。

```python

import numpy as np

# Sigmoid 激活函数

def sigmoid(x):

return 1 / (1 + np.exp(-x))

# ReLU 激活函数

def relu(x):

return np.maximum(0, x)

```

在这段代码中,`sigmoid` 函数将任意输入值映射到 (0,1) 区间,`relu` 函数则将所有负值置为0,保留正值不变,这些非线性函数使得网络能够学习复杂的模式。

#### 2.1.2 反向传播算法详解

反向传播算法是训练深度神经网络的核心,其目的是通过梯度下降法最小化损失函数。该算法首先前向传播输入数据,计算网络输出和实际标签之间的误差。然后反向传播误差信号,根据链式法则计算每个权重对损失函数的贡献(即梯度),最后更新权重以减小误差。

```python

def backpropagation(X, y, weights):

# 前向传播

output = forward_propagation(X, weights)

error = y - output

# 反向传播

dW = np.dot(X.T, error)

# 梯度下降权重更新

alpha = 0.01 # 学习率

weights += alpha * dW

return weights

def forward_propagation(X, weights):

return np.dot(X, weights)

```

在上述代码中,`backpropagation` 函数实现了基本的反向传播算法。这里假设一个简单的线性模型作为演示,实际上深度学习中的反向传播涉及更多的层和非线性激活函数。

### 2.2 深度学习模型的构建与训练

#### 2.2.1 模型选择与设计的考量因素

在构建深度学习模型时,需要考虑多个因素,包括网络结构、层数、神经元数量、激活函数类型等。通常,这些选择会根据问题的复杂性和数据的特性来确定。例如,对于图像数据,卷积神经网络(CNN)是最佳选择;而对于序列数据,则通常选择循环神经网络(RNN)或长短时记忆网络(LSTM)。

#### 2.2.2 训练过程中的优化策略

训练深度学习模型需要大量的计算资源和时间。为了加速训练过程,研究者们提出了许多优化策略,例如权重初始化方法(如He初始化、Xavier初始化)、批量归一化(Batch Normalization)、残差连接(Residual Connections)等。这些策略有助于缓解梯度消失或爆炸的问题,提高模型训练效率。

```python

# He 初始化函数

def he_initialization(shape):

return np.random.randn(shape[0], shape[1]) * np.sqrt(2. / shape[1])

# 批量归一化层

def batch_normalization(X, gamma, beta, epsilon):

mu = np.mean(X, axis=0)

var = np.var(X, axis=0)

X_norm = (X - mu) / np.sqrt(var + epsilon)

return gamma * X_norm + beta

```

这段代码中的 `he_initialization` 函数按照He初始化方法对权重进行初始化,有助于加速深层网络的训练。`batch_normalization` 函数执行批量归一化,可以帮助稳定学习过程。

#### 2.2.3 过拟合与欠拟合的识别与解决

深度学习模型在训练过程中可能会出现过拟合或欠拟合现象。过拟合是指模型在训练数据上表现很好,但在测试数据上表现较差,这通常是由于模型过于复杂,学习到了训练数据中的噪声。欠拟合则是指模型太简单,无法捕捉数据中的模式。解决过拟合可以使用正则化方法(如L1、L2正则化), Dropout策略等。而解决欠拟合通常需要增加模型复杂度,提供更多的训练数据。

### 2.3 深度学习的实际应用案例

#### 2.3.1 图像识别技术的应用

深度学习在图像识别技术中的应用非常广泛,从简单的目标检测到复杂场景理解,深度学习模型已展现出卓越的性能。典型的深度学习模型包括AlexNet、VGG、ResNet等,这些模型通过学习大量图像数据,提取高层特征用于分类、定位等任务。

#### 2.3.2 自然语言处理的最新进展

自然语言处理(NLP)领域也受益于深度学习的最新进展。从词嵌入模型(Word2Vec、GloVe)到序列模型(RNN、LSTM、Transformer),深度学习推动了机器翻译、情感分析、问答系统等应用的发展。特

0

0