【YOLO模型版本对比分析】:选择最适合检测抽烟行为的最佳版本

发布时间: 2024-11-15 05:49:06 阅读量: 33 订阅数: 27

YOLOv5算法吸烟行为检测模型,包含1000多张左右YOLO算法吸烟行为检测数据集

# 1. YOLO模型概述与应用背景

YOLO(You Only Look Once)模型是计算机视觉领域中用于目标检测的一类实时对象识别系统。它被广泛应用于安全监控、自动驾驶、医学影像分析等多个领域中,具有高效率和高准确性的特点。本章将介绍YOLO模型的起源、基本概念和其在不同行业中的应用背景,从而为读者提供一个全局视角。在详细分析YOLO模型架构及其演变之前,首先需要了解YOLO的初步设计思路和其在现实世界中的应用需求。这不仅能够帮助读者理解模型背后的设计动机,还能够加深对其实际应用价值的认识。

接下来,我们将详细介绍YOLO模型的演变过程,包括从YOLOv1到最新版本YOLOv5的改进与创新。通过深入了解YOLO模型,读者将能够掌握其核心原理和关键技术,为后续章节中对YOLO模型在行为检测中应用的深入研究打下坚实的基础。

# 2. YOLO模型架构演变

## 2.1 YOLO模型的基本原理

### 2.1.1 YOLO的初始设计思路

YOLO(You Only Look Once)是实时目标检测系统中的一个里程碑式的工作,它将目标检测视为一个回归问题,直接从图像像素到边界框坐标和类概率的单一神经网络。这一设计理念极大地提高了目标检测的速度和效率。

**YOLO的初始设计思路**可以概括为以下几点:

- **一次性处理**:与其它目标检测方法不同,YOLO将整个图像作为网络的输入,并在单个神经网络中直接预测边界框和类概率。

- **划分网格**:YOLO将输入图像划分为SxS个格子(grid)。如果一个对象的中心落在一个格子内,那么该格子负责预测该对象。

- **边界框预测**:每个格子预测B个边界框和这些框的置信度(confidence)。置信度反映了边界框包含对象的可能性以及预测准确性。

- **类概率**:每个格子还会预测C个类概率,这些概率是在给定对象存在的情况下的条件概率。

- **损失函数**:YOLO使用一个复合损失函数来训练,包括预测误差和置信度误差。

与传统的目标检测方法相比,如R-CNN系列,YOLO减少了计算量,因为它仅将目标检测作为一个单一的回归问题来解决。这种方法避免了滑动窗口、区域建议和多种类型的分类器,大大提高了检测的速度。

### 2.1.2 检测流程和关键技术

YOLO的检测流程可以分为以下几个关键技术步骤:

1. **图像划分**:YOLO首先将输入图像划分为SxS的网格。每个网格负责预测中心位于该网格内的目标。

2. **边界框预测**:每个网格预测B个边界框,每个边界框包括5个预测值:x, y, w, h 和置信度(confidence)。x, y是边界框中心相对于网格单元格的坐标,w和h是边界框的宽度和高度,置信度反映了边界框预测的准确性。

3. **类别概率预测**:每个网格单元格还预测C个条件类别概率,这些概率是在给定网格内存在对象的条件下,对象属于每个类别的概率。这些概率乘以相应边界框的置信度,以给出每个类别的最终概率。

4. **非极大值抑制(NMS)**:在所有预测之后,会有许多重叠的边界框预测。非极大值抑制用于去除冗余的边界框,只保留最有可能包含目标的边界框。

5. **损失函数**:YOLO使用一个损失函数来训练,它结合了预测误差和置信度误差,保证了模型的优化不仅仅依赖于分类准确性,还包括定位准确性。

YOLO模型的设计考虑了速度和准确性的平衡。它快速,能够在实时视频流中运行,但牺牲了一些准确度。与基于区域的检测器相比,它在检测速度上有很大的提升,但对小目标和密集目标的检测性能有所下降。

YOLO的这一系列技术设计是深度学习目标检测领域的重要进步,为后续的检测算法(例如SSD、YOLOv2等)的发展奠定了基础。

## 2.2 YOLOv1到YOLOv3的发展

### 2.2.1 YOLOv1的局限与改进

尽管YOLOv1在实时目标检测领域取得了显著的成功,但它仍然有一些局限性。这些局限性在后续版本中得到了改进。

YOLOv1的主要局限包括:

- **定位准确性**:YOLOv1在处理小目标时准确性较差,这是因为它将边界框预测集中在较大的网格上。

- **对上下文信息的缺乏**:YOLOv1的网格单元格可能无法捕获足够的上下文信息,这影响了它对复杂场景的理解。

- **泛化能力不足**:虽然训练集很大,但YOLOv1在不同的数据集上泛化能力表现不佳。

为了解决这些问题,后续版本对YOLO进行了改进。

### 2.2.2 YOLOv2与YOLOv3的关键提升

**YOLOv2**引入了几个重要的改进来解决YOLOv1的一些不足:

- **高分辨率分类器**:使用更高质量的图像进行预训练,以提高模型的泛化能力。

- **使用锚点(Anchors)**:引入预定义的锚框来改善定位准确性,尤其是对于小目标的检测。

- **更细粒度的特征提取**:通过使用更高分辨率的特征图来增加特征的精细度,从而提高对小目标的检测能力。

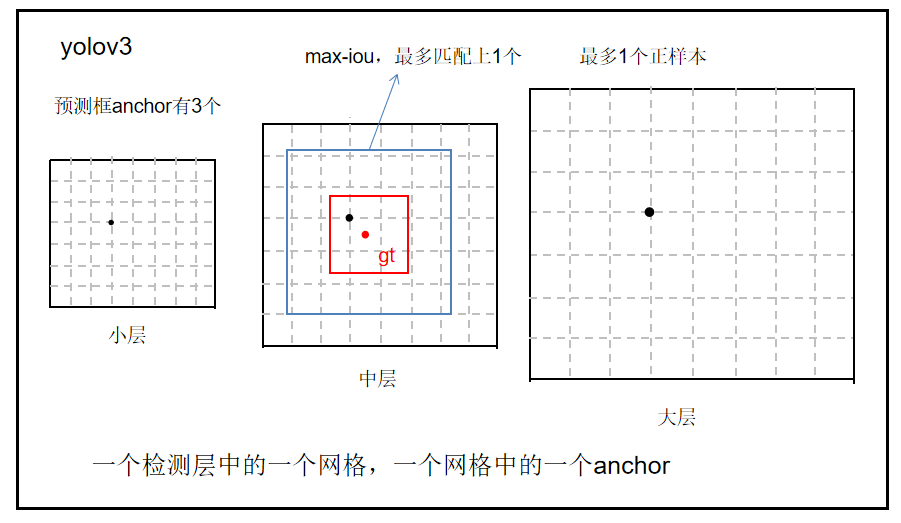

**YOLOv3**则进一步优化,引入了更多的改进:

- **多尺度预测**:在不同的尺度上进行特征提取和预测,更好地处理各种大小的目标。

- **逻辑回归分类器**:使用逻辑回归替代softmax,以改进多标签分类和提高性能。

- **残差网络结构**:使用Darknet-19作为特征提取器的一部分,提高了模型的准确性和训练的稳定性。

YOLOv3的这些改进不仅提高了对小目标的检测能力,而且改善了对复杂场景的理解和泛化能力。这一系列的提升使得YOLOv3在许多基准测试中表现优异,成为实时目标检测中的一个强有力的竞争者。

## 2.3 YOLOv4与YOLOv5的新特性

### 2.3.1 YOLOv4的创新点

YOLOv4在YOLOv3的基础上进一步增强,引入了一系列新方法和技术,以提高模型性能。以下是YOLOv4的一些关键创新点:

- **引入CSPNet结构**:YOLOv4采用CSPNet(Cross Stage Partial Network)架构,以减少计算量并提高性能。

- **Mish激活函数**:引入Mish激活函数,以增加网络的非线性,同时避免梯度消失问题。

- **自对抗训练(SAT)**:使用自对抗训练,这是一种正则化技术,可以提高模型的泛化能力。

- **Bag of Freebies和Bag of Specials**:结合不同的技术,如数据增强和锚点框调整策略,以提高模型的检测精度。

这些改进结合在一起,使得YOLOv4在保持较高检测速度的同时,还能在多个基准测试中达到非常高的精度。

### 2.3.2 YOLOv5的优化与简化

YOLOv5继续沿用YOLOv4的许多优点,同时对模型进行了优化和简化。YOLOv5的主要改进包括:

- **模型轻量化**:使用更轻量级的网络结构,以使模型更加适合边缘设备和移动设备。

-

0

0