【YOLO抽烟行为识别快速入门】:建立并标注您的首个目标检测数据集

发布时间: 2024-11-15 04:54:24 阅读量: 67 订阅数: 45

# 1. YOLO抽烟行为识别概述

## 1.1 YOLO抽烟行为识别的意义

在计算机视觉领域,行为识别是一个日益增长的研究方向,尤其是涉及安全与健康监管的场景。YOLO(You Only Look Once)算法因其快速且准确的检测能力,被广泛应用于实时监控和行为分析中。对于抽烟行为的实时识别,不仅可以提升公共区域的安全监控,还能帮助卫生组织对公共场所的吸烟行为进行监管和控制。

## 1.2 YOLO抽烟行为识别的技术挑战

尽管YOLO算法以其速度和准确性被众多研究者和开发者所青睐,但要实现抽烟行为的准确识别,仍面临着诸多挑战。其中,抽烟行为的动态性和复杂性要求算法具备更高的识别精度和鲁棒性。此外,如何处理不同光照条件、遮挡以及抽烟者姿态的多样性,都是提高算法性能的关键问题。

## 1.3 面向未来的展望

随着深度学习技术的不断进步,未来的YOLO抽烟行为识别系统将更加智能化和精细化。我们期待通过更高级的神经网络结构、更丰富多样的训练数据集和更加优化的算法,来进一步提高模型对复杂场景中抽烟行为的识别能力,为公共安全与健康管理提供强有力的技术支持。

# 2. 目标检测基础理论

目标检测是计算机视觉领域的核心技术之一,它能够识别出图像或视频中各类物体的位置和类别,是物体识别、图像分割、行为分析等后续处理工作的基础。本章节将详细介绍目标检测的定义、重要性以及YOLO算法的核心原理,并与其他目标检测算法进行比较,揭示YOLO在行业中的优势和局限性。

### 2.1 目标检测的概念与重要性

#### 2.1.1 目标检测在计算机视觉中的地位

目标检测是计算机视觉领域的一块基石,与图像分类、语义分割等其他任务密切相关,但又有所区别。目标检测不仅要求识别出图像中的所有物体,还要求精确定位它们的位置。例如,一辆车的图像,不仅要识别出车辆,还需要定位出车辆在图像中的准确位置。这使得目标检测在自动驾驶、安全监控、医疗图像分析、视频内容分析等领域有极其广泛的应用。

#### 2.1.2 YOLO算法的提出与发展

"You Only Look Once"(YOLO)算法是一种先进的目标检测算法,由Joseph Redmon等人在2015年提出。YOLO将目标检测看作是一个单一的回归问题,直接在图像中预测边界框和概率。它的首次提出就以高速度和准确性革新了实时目标检测领域。YOLOv1的出现,将目标检测的速度提升了近一倍,而准确性也处于领先地位。后续,YOLOv2(YOLO9000)和YOLOv3等版本的迭代,进一步增强了模型在更复杂场景下的性能。

### 2.2 YOLO算法核心原理

#### 2.2.1 YOLO的基本工作流程

YOLO算法将目标检测问题转化为一个单一的回归问题,将图像分割成一个S×S的网格,如果物体的中心落在了某个网格中,那么这个网格就负责检测这个物体。每个网格同时预测B个边界框和这些边界框的置信度(confidence score),以及C个类别概率。置信度反应了边界框包含物体的概率以及预测准确性。边界框的置信度计算公式为P(Object)×IOU(pred, truth),其中P(Object)是是否含有物体的概率,IOU是预测框与真实框的交并比。最后,将所有预测结果进行非极大值抑制(Non-Maximum Suppression,NMS),去除冗余的重叠框,得到最终的检测结果。

```python

# 伪代码示例,展示YOLO检测流程

def detect_objects_with_yolo(image, yolo_model):

# 将图片输入YOLO模型进行预测

predictions = yolo_model.predict(image)

# 对预测结果进行非极大值抑制(NMS)

detections = nms(predictions)

return detections

```

#### 2.2.2 YOLO的版本演进与改进

自YOLOv1发布以来,YOLO算法经历了多次重大的版本更新,每个新版本的出现都是对前一个版本的改进。例如,YOLOv2引入了Darknet-19这一新的网络结构,使用锚点机制(anchor boxes)提升了定位的准确性,并且提出了多尺度训练和使用高分辨率分类器的方法。YOLOv3则更进一步,提高了对小型物体的检测能力,并且增加了网络的深度和宽度。YOLOv4和YOLOv5在速度和准确性上继续提升,特别是在特定硬件上的部署优化。

### 2.3 YOLO与其他目标检测算法的比较

#### 2.3.1 YOLO与其他算法的性能对比

在与SSD、Faster R-CNN等其他主流目标检测算法对比中,YOLO在速度上具备明显优势。YOLO模型可以达到实时检测的帧率,这对于需要快速响应的应用场景来说至关重要。然而,YOLO在检测小物体方面的能力通常不如Faster R-CNN等两阶段检测器。Faster R-CNN在准确度上有很好的表现,但是其处理速度相对较慢。

#### 2.3.2 YOLO的优势和局限性

YOLO的优势在于其速度和准确性之间的优秀平衡。它能够快速地给出检测结果,对于实时性要求较高的应用场景,如视频监控,YOLO能提供非常好的用户体验。然而,YOLO的局限性也十分明显,尤其是在处理复杂场景和小物体时,YOLO的性能不如一些其他算法。为了解决这些问题,研究人员和工程师们在不断地对YOLO模型进行优化和改进。

通过第二章的介绍,我们了解了目标检测的基本概念、YOLO算法的发展历程以及与其他算法的比较。接下来,我们将深入了解如何建立用于YOLO模型训练的数据集,以及如何进行数据标注和质量控制。这些是训练准确的目标检测模型不可或缺的步骤。

# 3. 建立数据集的步骤与技巧

### 3.1 数据收集与初步处理

#### 3.1.1 收集抽烟行为相关的视频或图片

为了构建一个用于训练YOLO模型的数据集,第一步是收集抽烟行为相关的视频或图片资料。这些资料可以来源于公开的视频网站、社交平台、自定义拍摄的场景等。在选择数据时,应当注意以下几点:

- **数据的多样性:** 确保数据涵盖了各种环境、光照条件、抽烟者姿态和场景背景,以提高模型的泛化能力。

- **数据的真实性和相关性:** 收集的数据应真实反映抽烟行为,避免使用无关图片或视频。

- **版权合规:** 使用公开数据时,确保遵循版权法规,或对数据进行适当处理,以保护隐私和版权。

#### 3.1.2 图像预处理技术

在收集到原始数据后,需要进行图像预处理,以提高数据质量并加速训练过程。预处理通常包括以下几个步骤:

- **调整图像尺寸:** 统一图片或视频帧的大小,以适应模型输入层的要求。

- **归一化:** 将图片像素值标准化到0-1范围内,或减去均值、除以标准差,以减少输入数据的尺度和范围差异。

- **数据增强:** 应用旋转、翻转、缩放、色彩变换等手段增加数据多样性,防止模型过拟合。

```python

import cv2

def preprocess_image(image_path, target_size=(416, 416)):

# 读取图片

image = cv2.imread(image_path)

# 调整图片大小

resized_image = cv2.resize(image, target_size)

# 归一化处理(这里省略了减去均值、除以标准差的步骤)

normalized_image = resized_image / 255.0

return normalized_image

# 示例代码:对单张图片进行预处理

preprocessed_image = preprocess_image("path_to_image.jpg")

```

### 3.2 数据标注工具与流程

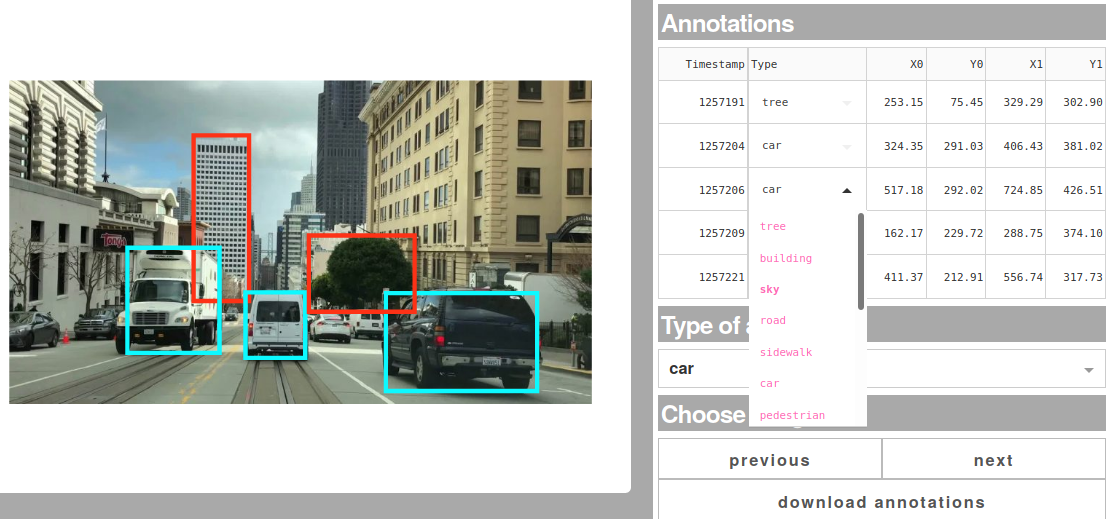

#### 3.2.1 选择合适的标注工具

数据标注是将图片中的目标标注出来,并为每个目标指定边界框和类别标签的过程。选择合适的标注工具对于提高标注效率和质量至关重要。常见的标注工具有:

- **LabelImg:** 轻量级的开源工具,适合快速开始标注任务。

- **CVAT:** 功能更全面,支持复杂标注任务,支持在线和离线模式。

- ***:** 面向初学者的易于使用的工具,支持自动化标签建议。

#### 3.2.2 标注过程中的注意事项

在进行标注时,以下事项需要注意:

- **边界框的准确性:** 确保标注的目标边界框准确对应目标的真实位置。

- **一致性:** 所有标注者应使用统一标准和流程,以减少标注误差。

- **重复检查:** 为了提高标注质量,对一些标注结果进行交叉验证和重复检查。

### 3.3 数据集的质量控制

#### 3.3.1 数据集多样性的保证

为了保证模型的泛化能力,需要确保数据集包含足够的多样性。这可以通过以下方法实现:

- **不同场景:** 包括室内、室外、不同时间段等。

- **不同人群:** 不同年龄、性别、种族的人群。

- **多种行为模式:** 不同的抽烟姿势和行为变化。

#### 3.3.2 数据不平衡问题的处理方法

数据不平衡是目标检测中常见的问题,即某些类别样本数量远多于其他类别。这可能导致模型倾向于预测更多样本的类别。解决数据不平衡的策略包括:

- **重采样:** 对类别不平衡的数据进行过采样或欠采样。

- **权重分配:** 在损失函数中对不同的类别分配不同的权重。

- **合成新样本:** 使用数据增强技术合成新的样本,提高少数类别的样本数量。

```python

# 示例代码:计算类别权重并应用到损失函数中

class_counts = {'smoking': 1000, 'non-smoking': 5000}

total_samples = sum(class_counts.values())

class_weights = {cls: total_samples / (len(class_counts) * count) for cls, count in class_counts.items()}

# 在训练过程中应用类权重

for cls, weight in class_weights.items():

loss += weight * loss_for_class[cls]

```

通过上述步骤和技巧,我们可以构建一个高质量的数据集,为YOLO模型的训练打下坚实的基础。在下一章中,我们将深入探讨如何使用这些数据集进行模型的配置、训练和优化。

# 4. 标注与训练YOLO模型

## 4.1 YOLO模型的配置与训练准备

### 4.1.1 配置YOLO训练环境

为了训练YOLO模型,我们需要配置一个合适的训练环境。这通常包括以下几个步骤:

1. **安装操作系统和依赖库**:YOLO可以在多种操作系统上运行,如Linux、Windows和macOS。在Linux系统中,我们需要安装依赖库,比如CUDA(如果使用GPU加速)、cuDNN、OpenCV等。

2. **获取YOLO源代码**:可以通过git clone的方式从YOLO的GitHub仓库获取源代码。

```bash

git clone ***

***

```

3. **修改Makefile**:根据是否安装CUDA和cuDNN,修改Makefile文件以启用GPU加速。

```makefile

GPU=1

CUDNN=1

OPENCV=1

```

4. **编译Darknet**:使用make命令编译YOLO的框架Darknet,确保编译没有错误。

```bash

make

```

5. **准备数据集和配置文件**:将制作好的数据集放在指定目录,并编写或修改YOLO的配置文件以匹配数据集的类别数。

6. **下载预训练权重**:可以选择下载预训练权重进行微调,这样可以加快训练速度并提高模型的准确性。

```bash

wget ***

```

### 4.1.2 数据集转换与格式化

数据集格式化是训练YOLO模型前的另一个重要步骤。YOLO需要特定格式的数据集和标签文件:

1. **数据集格式**:通常需要准备一个文本文件,列出所有图片的路径,一个用于存放图片,另一个用于存放对应的标注文件(.txt格式)。

2. **标注文件格式**:每个标注文件对应一张图片,其中包含所有的对象边界框信息,格式为:`<object-class> <x_center> <y_center> <width> <height>`。

3. **创建训练配置文件**:需要编写一个配置文件,说明类别数、训练集、验证集、网络结构等信息。

4. **划分数据集**:通常将数据集划分为训练集和验证集,确保模型的泛化能力。

## 4.2 YOLO模型训练过程详解

### 4.2.1 训练参数的设置与调整

训练YOLO模型之前,需要仔细设置一些关键的训练参数。这些参数主要包括学习率、批次大小、训练轮次等。

1. **学习率(Learning Rate)**:学习率决定了权重更新的步长。设置得太高可能会导致模型震荡,太低则训练过程会非常缓慢。通常在训练初期使用较大值,随着训练的进行逐渐减小。

2. **批次大小(Batch Size)**:批次大小决定了每次迭代更新权重时使用的样本数量。太大的批次可能导致内存溢出,太小则可能导致学习过程缓慢。

3. **训练轮次(Epochs)**:训练轮次指的是数据集完整地通过一次训练过程的次数。轮次过多可能导致过拟合,而轮次太少则可能导致模型未能充分学习。

### 4.2.2 训练过程监控与日志分析

在模型训练过程中,监控和日志分析是不可或缺的步骤,它们帮助我们及时了解训练的进展和模型的表现。

1. **监控训练损失**:通过查看训练过程中的损失值,我们可以判断模型是否正在学习。损失值应该随着时间的推移而下降。

```bash

./darknet detector train cfg/coco.data cfg/yolov3.cfg darknet53.conv.74

```

2. **可视化验证结果**:在训练过程中,每过一定的轮次,我们可以使用验证集来评估模型性能。根据性能指标,调整参数或策略。

3. **保存和加载权重**:模型训练过程中可以周期性地保存权重,以便于后续的测试或在训练失败时能够继续训练。

```bash

./darknet detector save cfg/yolov3.cfg darknet53.conv.74 backup/yolov3.backup

```

## 4.3 模型评估与优化

### 4.3.1 使用各种指标评估模型性能

模型训练完成后,需要对其性能进行评估。通常使用以下指标:

1. **准确度(Accuracy)**:模型对数据集的整体预测准确性。

2. **精确度(Precision)**:模型预测为正的样本中实际为正的比例。

3. **召回率(Recall)**:实际为正的样本中模型预测为正的比例。

4. **mAP(mean Average Precision)**:是检测任务中一个重要的性能指标,表示各个类别的AP(Average Precision)的平均值。

### 4.3.2 模型的微调与优化策略

在模型评估后,往往需要根据评估结果对模型进行微调或优化:

1. **数据增强(Data Augmentation)**:通过旋转、缩放、翻转等方法增加数据集的多样性,提高模型的泛化能力。

2. **学习率调整**:通过学习率预热、学习率衰减等策略,让模型在训练初期快速学习,在训练后期逐步收敛。

3. **使用预训练权重**:利用在大型数据集上预训练的模型权重,作为新模型训练的起点,可以加快收敛速度并提升性能。

4. **模型剪枝和量化**:对于需要部署到资源受限设备上的模型,可以通过剪枝和量化技术减少模型大小和加速推理。

以上步骤都需要进行细致的操作和参数调整,以达到最佳的训练效果和模型性能。

# 5. 抽烟行为识别的实践应用

## 5.1 部署YOLO模型到实际环境

### 5.1.1 模型的转换与优化

在模型部署之前,通常需要对模型进行优化和转换以适配特定的应用场景。这一阶段的操作包括模型轻量化、转换模型文件格式以兼容特定的硬件或软件平台。

#### 模型轻量化

对于YOLO等复杂的神经网络模型,模型的大小和计算复杂度往往较高,这会直接影响到模型的运行速度和部署难度。轻量化技术可以在不显著降低模型准确率的前提下,减少模型的复杂度。常用的方法包括剪枝、量化和知识蒸馏。

- **剪枝(Pruning)**:通过移除网络中不重要的连接或神经元,降低模型的复杂度。

- **量化(Quantization)**:减少模型权重和激活值的存储精度,从而减小模型体积和提高运算速度。

- **知识蒸馏(Knowledge Distillation)**:将一个大型、复杂的模型的知识转移到一个小型、简单的模型中。

#### 转换模型文件格式

为了使模型可以在不同的框架或设备上运行,需要将模型转换为兼容的格式。例如,使用ONNX(Open Neural Network Exchange)格式可以实现跨框架的兼容性。

以下是一个将训练好的YOLO模型转换为ONNX格式的示例代码:

```python

import torch

import torchvision

from models import Darknet # 假设已经导入了YOLO的模型结构

# 加载预训练模型权重

model = Darknet('cfg/yolov3.cfg')

model.load_state_dict(torch.load('yolov3.weights'))

# 将模型转换为评估模式

model.eval()

# 输入数据的示例,需要根据实际模型输入进行调整

dummy_input = torch.randn(1, 3, 608, 608)

# 导出ONNX模型

torch.onnx.export(model, dummy_input, "yolov3.onnx", verbose=True)

```

### 5.1.2 应用于视频流的实时识别

部署模型到实际环境中,通常是通过将模型集成到应用程序中,以实时处理视频流。在这一环节,开发者需要考虑模型加载、视频帧捕获、图像预处理、模型推理和结果后处理等多个步骤。

#### 视频流处理

视频流处理主要负责获取实时的视频帧,并将这些帧送入模型进行推理。以下是一个使用OpenCV进行视频流处理的简单示例:

```python

import cv2

import torch

# 加载模型

model = torch.load('yolov3.onnx')

model.eval()

# 打开视频流或摄像头

cap = cv2.VideoCapture(0) # 0 代表默认摄像头

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# 对帧进行预处理以适配模型输入

# 这里需要根据YOLO模型的输入要求进行处理,可能包括缩放、归一化等步骤

# 推理

predictions = model(frame)

# 后处理,比如非极大值抑制(NMS)等

# 显示结果

cv2.imshow('Video Stream', frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放资源

cap.release()

cv2.destroyAllWindows()

```

## 5.2 面临的挑战与未来发展方向

### 5.2.1 实际部署中的问题与解决

在实际部署中,除了模型的性能问题外,还有可能遇到硬件限制、环境变化等问题。例如,在不同的光照条件下,模型的识别能力可能会受到影响。解决这些问题的方法包括但不限于:

- **环境适应性**:通过数据增强、域适应等技术提高模型对新环境的适应能力。

- **硬件优化**:针对特定硬件平台优化模型,例如使用TensorRT进行GPU加速。

### 5.2.2 技术的未来趋势和创新点

随着深度学习技术的发展,目标检测算法也在不断进步。未来的趋势可能包括:

- **模型压缩技术**:通过更高效的网络架构设计或模型剪枝技术,使得模型更加轻量。

- **联邦学习**:通过联邦学习框架,在保护用户隐私的同时,实现模型的持续优化。

YOLO算法作为目标检测领域的重要技术,其未来的发展仍然值得期待。随着算法的不断优化和应用领域的拓展,YOLO及其衍生模型将继续推动计算机视觉技术的革新。

0

0