【数据分析实战】:使用arules包剖析大型数据集关联规则

发布时间: 2024-11-02 11:37:55 阅读量: 45 订阅数: 35

数据分析实战:利用python对心脏病数据集进行分析

# 1. 关联规则分析简介

关联规则分析是一种在大型数据集中寻找物品之间有趣关系的方法,常用于市场篮子分析、推荐系统、生物信息学等领域。它主要挖掘数据项之间的频繁模式、关联、相关性或因果结构,从而发现数据项间的强相关性。本章将为您介绍关联规则分析的基本概念,以及它在数据分析领域中的重要性和应用场景。

## 1.1 关联规则分析的定义

关联规则分析的目标是识别在同一个事务中同时出现的不同项之间的关联性。这种关联性通常被量化为支持度、置信度和提升度等指标。例如,在购物篮分析中,关联规则可以发现顾客同时购买牛奶和面包的概率,从而帮助商家进行商品摆放优化和促销策略制定。

## 1.2 关联规则分析的重要性

关联规则分析对于任何需要从大量交易数据中发现隐藏模式的业务都是至关重要的。它可以帮助企业了解产品之间的关系,预测消费者行为,优化库存管理和提高销售额。此外,关联规则分析在生物信息学领域可以帮助识别基因间复杂的相互作用。

## 1.3 关联规则分析的应用场景

在零售业中,关联规则分析可以用来揭示产品间的购买模式,为交叉销售和向上销售提供支持。在医疗领域,关联规则可以用来发现特定疾病与患者生活方式之间的关联。而在网络流量分析中,关联规则可以帮助检测和预防恶意网络活动。

通过关联规则分析,我们可以更好地理解和利用数据中的隐含信息,为决策提供科学依据。接下来的章节将深入介绍arules包在R语言中的实现及其在实际应用中的操作方法。

# 2. arules包的理论基础

### 2.1 关联规则分析的理论框架

#### 2.1.1 支持度、置信度和提升度的定义

关联规则分析是一种在大型数据集中寻找项目间有趣关系的方法。为了评估这些关系,定义了三个关键指标:支持度、置信度和提升度。

- **支持度 (Support)**:某项规则中所有项在数据集中的出现频率。例如,如果在100个交易中有10个交易包含了面包和牛奶,那么“面包 -> 牛奶”的规则的支持度为10%。支持度反映了规则的普遍性。

- **置信度 (Confidence)**:在规则前件出现的条件下,规则后件出现的条件概率。用上面的例子来说,如果在所有包含面包的15个交易中,有10个同时包含牛奶,那么置信度就是 10/15 或大约 66.67%。这反映了规则的强度或可靠性。

- **提升度 (Lift)**:度量了规则前件和后件之间的相关性。提升度大于1表示前件和后件正相关,小于1表示负相关,等于1则表示前件和后件独立。对于“面包 -> 牛奶”的规则,如果牛奶在全部交易中出现的概率是30%,那么提升度是 0.1 / 0.3 约等于 0.333,表明面包和牛奶是负相关的。

理解这些指标是使用arules包进行关联规则分析的基础。

#### 2.1.2 关联规则的生成过程

关联规则的生成过程通常包括以下几个步骤:

1. **数据准备**:收集数据并转换成适合的格式,通常是二元表示,即每个事务都是项的集合。

2. **频繁项集生成**:使用诸如Apriori、FP-growth等算法找出数据中出现频率超过用户定义最小支持度阈值的项集。这些项集被称为频繁项集。

3. **规则生成**:对于每个频繁项集,产生所有可能的关联规则。

4. **规则评估**:利用置信度、提升度等指标评估这些规则的有效性。

5. **筛选**:根据预定义的阈值筛选出最终的关联规则。

在R语言中,arules包内置了这些算法的实现,可以方便地进行关联规则的分析。

### 2.2 arules包的关键功能和组件

#### 2.2.1 数据结构和格式要求

arules包定义了特定的数据结构来存储交易数据和关联规则,主要包括:

- **事务数据(Transaction)**:arules包使用事务数据集(transactions)对象存储,其内包含了数据集中的每一笔交易。

- **规则(Rules)**:规则对象存储了关联规则的定义,包括前件(LHS)、后件(RHS)、支持度、置信度和提升度等。

arules包中的数据格式要求如下:

- **数据类型**:需要是逻辑型数据,即0和1,或TRUE和FALSE表示项是否存在于事务中。

- **数据组织**:每一行代表一个事务,每一列代表一个不同的项目,数据通常以文本文件或者数据框(data.frame)的形式被导入到R中。

#### 2.2.2 算法实现和性能考量

arules包实现了多种关联规则挖掘算法,其中最著名的包括Apriori和FP-growth算法。这些算法的实现考虑到了性能优化,以便于处理大规模数据集。

- **Apriori算法**:基于迭代搜索频繁项集的算法,其核心思想是先找出所有频繁1-项集,然后是频繁2-项集,以此类推,直到不能生成更频繁的项集为止。

- **FP-growth算法**:不需要产生候选项集,其使用了一种称为FP-tree(频繁模式树)的数据结构来压缩数据集,并通过递归地将数据集划分为一组条件数据库,对每个数据库进行频繁项集的搜索。

arules包针对不同的数据大小和特征,提供了相应参数来优化算法性能。例如,可以调整最小支持度和最小置信度阈值以控制搜索空间,或选择适合数据特征的算法来提高挖掘效率。

# 3. ```

# 第三章:arules包的基本使用

## 3.1 安装和配置arules包

### 3.1.1 如何在不同平台上安装arules包

安装arules包,我们可以使用R语言的包管理器`install.packages()`函数。对于常见的操作系统,比如Windows,MacOS或Linux,安装流程基本一致。首先打开R控制台,然后输入以下命令:

```R

install.packages("arules")

```

这将会自动从CRAN仓库下载并安装arules包。如果系统中没有设置好R语言的镜像源,可能需要先配置镜像源。在R语言中,可以通过以下命令更改镜像源:

```R

chooseCRANmirror(graphics = FALSE)

```

安装完成后,需要加载arules包才能使用它提供的函数和数据集。

```R

library(arules)

```

### 3.1.2 配置arules包的环境

为了验证arules包是否正确安装并配置,我们可以使用`arules::`加上包中的一些函数来测试。例如,我们可以在R控制台输入`arules::transactions()`,如果系统能够调用函数并返回函数帮助文档,那么arules包已经成功安装并配置完毕。

此外,arules包依赖于一些底层的C++库,对于需要编译安装的情况,用户可能需要安装Rtools(Windows平台)或Xcode(MacOS平台)。在Linux平台上,可能需要安装依赖的开发工具包。

## 3.2 arules包的数据预处理

### 3.2.1 数据集的导入和转换

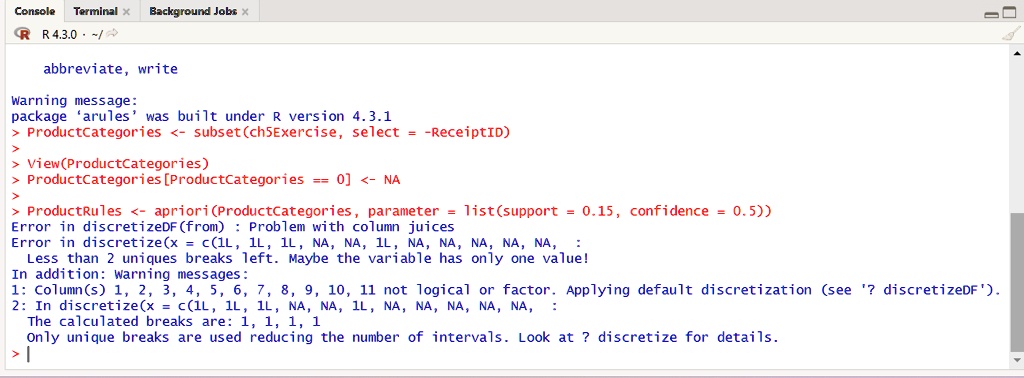

在使用arules包进行关联规则挖掘之前,需要将数据集转换为arules包能够识别的事务数据格式。在R语言中,事务数据通常被表示为`transactions`对象。假定我们有一个CSV格式的购物篮数据集,我们可以使用`read.csv()`函数将其导入,并通过`as()`函数转换为`transactions`对象:

```R

# 假设文件路径为 'basket_data.csv'

ba

0

0