【HDFS小文件问题探讨】:小文件挑战及HDFS解决方案

发布时间: 2024-10-29 00:04:06 阅读量: 34 订阅数: 28

# 1. HDFS小文件问题概述

## Hadoop分布式文件系统(HDFS)作为大数据存储的核心组件,其处理能力对现代数据密集型应用场景至关重要。然而,HDFS处理大量小文件时却存在明显不足,这被称为HDFS小文件问题。小文件是指那些数据量远小于HDFS默认块大小(通常为128MB或256MB)的文件。虽然单个小文件占用磁盘空间不大,但大量小文件会导致NameNode内存消耗增加,降低系统的扩展性和性能。这种情况尤其在数据采集、日志文件、半结构化数据处理等场景中十分常见,使得HDFS在面对这些数据时效率大打折扣。

HDFS小文件问题不仅影响了系统的整体性能,还增加了对存储资源的管理难度。在小文件过多的情况下,HDFS NameNode需要管理更多的文件元数据,这导致内存占用飙升,进而引发内存溢出和性能瓶颈。因此,理解并解决HDFS小文件问题,对提高大数据平台的运行效率和扩展性具有重要意义。接下来的章节,我们将深入探讨小文件问题的成因、影响以及优化策略。

# 2. HDFS小文件的理论基础

### 2.1 Hadoop分布式文件系统的架构

Hadoop分布式文件系统(HDFS)是Hadoop项目的核心组件之一,它负责存储大量数据,并提供高吞吐量的数据访问。理解HDFS的架构对于掌握小文件问题至关重要。

#### 2.1.1 HDFS的核心组件和工作原理

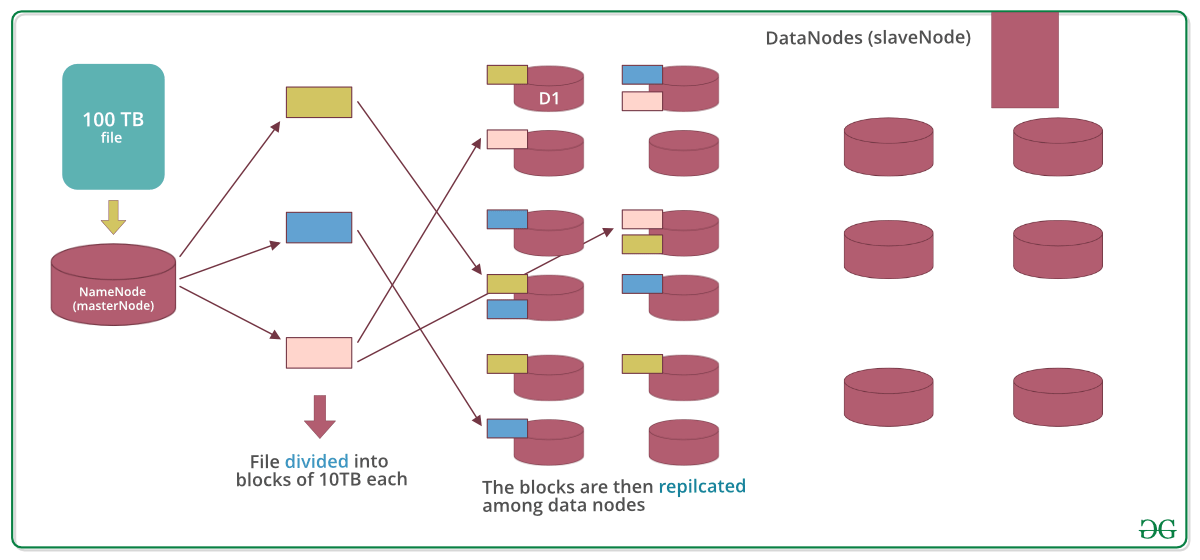

HDFS采用了主从(Master/Slave)架构,其关键组件包括命名节点(NameNode)和多个数据节点(DataNode)。命名节点负责管理文件系统的命名空间,维护文件系统的元数据。数据节点负责存储实际的数据块,执行数据的创建、删除和复制等操作。

- **命名节点(NameNode):** 维护了文件系统的元数据,包括文件和目录的命名空间树、文件属性以及每个文件的块列表和块的位置等。需要注意的是,命名节点并不存储实际的数据块。

- **数据节点(DataNode):** 在系统中分布在网络的不同节点上,负责存储实际的数据块。它们执行读写操作,并向命名节点发送数据块的健康状态报告。

HDFS通过将大文件切分成固定大小的块(默认为128MB),并分别存储在多个数据节点上来实现数据的高吞吐量访问。它通过冗余存储确保了数据的可靠性和容错性,每个数据块通常有三个副本分布在不同的数据节点上。

#### 2.1.2 HDFS的命名节点和数据节点

- **命名节点的高可用性(HA):** HDFS的一个主要挑战是命名节点的单点故障问题。为此,Hadoop社区引入了HA机制,允许系统中存在多个活动的和热备用的命名节点。

- **数据节点的扩展性:** HDFS设计时考虑到了扩展性,可以轻易增加新的数据节点来增加存储容量。

HDFS的工作原理简单而有效,但它在设计时考虑的是大规模数据存储,并不特别针对小文件进行优化。事实上,小文件存储在HDFS中会引起一系列的问题。

### 2.2 小文件在HDFS中的影响

小文件问题主要是由于HDFS的设计假设是存储和处理大文件,而小文件的存储和访问效率明显低于大文件。

#### 2.2.1 小文件对性能的影响分析

小文件在HDFS中的存储和处理会带来显著的性能下降,具体表现在以下几个方面:

- **命名节点的内存消耗:** 小文件数量的增加会导致命名节点中存储的文件元数据大量增加,从而消耗更多的内存资源。

- **检索效率下降:** 在读取小文件时,需要检索更多的元数据,而元数据的检索速度远低于数据块的读取速度。

- **网络和磁盘I/O压力增大:** 每个小文件都是一个独立的任务,大量小文件会导致NameNode需要频繁地进行任务调度和管理,给网络和磁盘造成额外的I/O压力。

#### 2.2.2 小文件对存储空间的利用分析

小文件存储还会导致存储空间的利用率降低:

- **空间碎片化:** 由于数据块需要对齐到HDFS的数据块大小(默认为128MB),小文件在HDFS中会占用比实际内容更多的存储空间。

- **存储资源浪费:** 小文件的读写操作通常更加频繁,这不仅增加了存储设备的磨损,还可能导致资源的过度消耗。

### 2.3 小文件问题的成因与挑战

理解小文件问题的成因和所面临的挑战是解决这一问题的关键。

#### 2.3.1 业务场景对小文件的依赖

在一些特定的业务场景中,小文件的使用是不可避免的:

- **日志文件:** 很多系统会定期生成日志文件,这些文件通常很小,但数量庞大。

- **网页爬虫:** 网页爬虫抓取的网页数据通常以网页文件形式存储,每个网页大小不一,常常是小文件。

这些场景导致了小文件在HDFS中的广泛应用,同时也带来了性能和存储效率的挑战。

#### 2.3.2 现有技术限制和挑战

目前,HDFS面临着一些技术限制,这些限制加剧了小文件问题:

- **HDFS设计初衷:** HDFS的设计初衷是优化大文件的存储和读写,而不是小文件。

- **工具缺乏:** Hadoop生态系统内缺乏高效的工具来处理小文件问题。

以上因素共同构成了小文件问题的复杂性,使得小文件在HDFS中的存储和处理成为了一个值得深入探讨的话题。

# 3. HDFS小文件的优化实践

## 3.1 避免产生小文件的策略

### 3.1.1 数据整合和预处理方法

当处理大规模数据集时,小文件的生成通常源自于数据预处理阶段,其中数据整合和预处理是关键步骤。为了减少小文件的产生,应首先从数据的收集和整合入手。这包括合并多个小的数据集、使用文本编辑器的追加模式(如使用cat命令或重定向操作),以及利用编程语言(比如Python中的文件写入操作)将多个数据源整合成较大的文件块。此外,在预处理阶段,可使用脚本自动化合并数据,从而避免手动操作中可能引入的文件碎片。

```python

# 示例:使用Python脚本合并多个文本文件

import os

# 合并目录下的所有.txt文件

def merge_files(directory):

with open('merged_file.txt', 'w') as out***

***

***'.txt'):

with open(os.path.join(directory, filename), 'r') as in***

***

***'\n') # 添加换行符以分隔文件内容

# 调用函数

merge_files('/path/to/directory')

```

在这个例子中,我们定义了一个函数`merge_files`,它接受一个目录路径作为参数,并将该目录下所有的.txt文件合并成一个名为`merged_file.txt`的文件。这个过程可以通过设置定时任务来周期性执行,以保证数据的实时整合。代码逻辑的逐行解读分析表明,该段代码首先定义了合并文件的函数,然后通过循环读取指定目录下的所有.txt文件,并将它们的内容追加到一个统一的输出文件中。文件内容之间插入了换行符以保持清晰的结构。

### 3.1.2 优化MapReduce任务设计

MapReduce是Hadoop处理大数据的关键技术,其任务设计直接关系到HDFS小文件的产生。在编写MapReduce程序时,可以采取一些策略来减少生成的小文件数量。一种方法是增加Map任务输出的文件大小限制。Map任务产生的中间数据通常存储在HDFS上的临时文件中,可以通过配置参数`***press`和`***press.type`来控制输出文件的压缩和类型,从而避免生成大量小文件。

```java

// 示例:Hadoop MapReduce配置优化

Configuration conf = getConf();

Job job = Job.getInstance(conf, "MapReduce Job");

// 设置M

```

0

0