MATLAB信号处理:信号分析与处理的实用指南

发布时间: 2024-06-15 12:51:16 阅读量: 81 订阅数: 37

信号处理-matlab使用指南

# 1. MATLAB信号处理概述**

MATLAB是一种强大的技术计算语言,广泛用于信号处理领域。它提供了广泛的函数和工具箱,使工程师和研究人员能够有效地分析、处理和可视化信号。

MATLAB信号处理模块包含各种功能,包括:

* 信号采样和量化

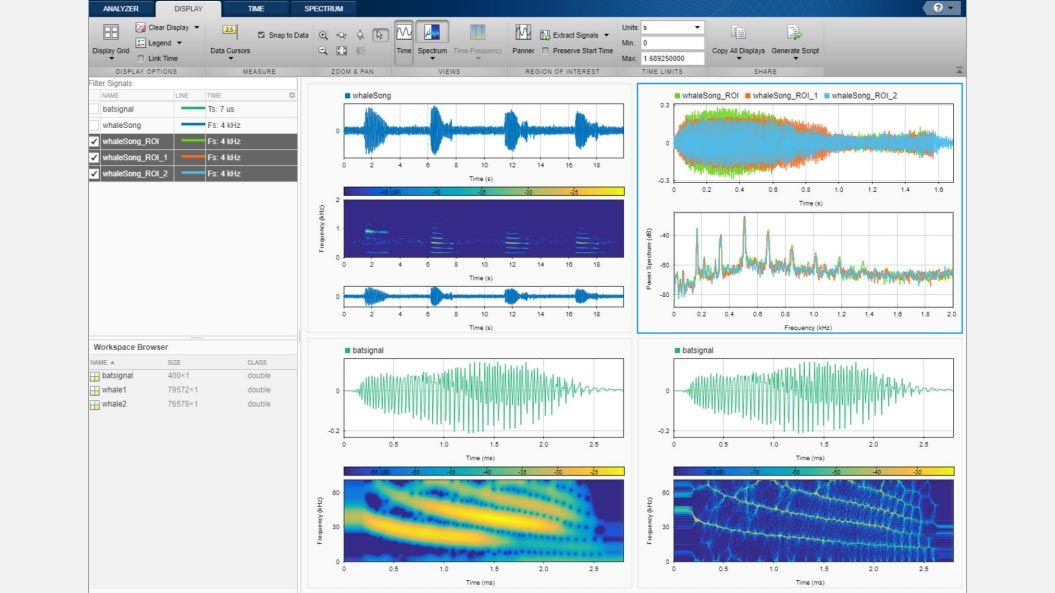

* 时域和频域分析

* 滤波器设计

* 信号增强

* 统计分析

MATLAB的直观语法和丰富的文档使初学者和经验丰富的从业者都可以轻松上手。通过结合强大的计算能力和用户友好的界面,MATLAB成为信号处理任务的理想平台。

# 2.1 信号的时域和频域分析

### 2.1.1 时域分析:采样、量化和离散化

#### 采样

采样是将连续时间信号转换为离散时间信号的过程。它涉及以一定的时间间隔从连续信号中提取样本。采样率是指每秒采样的次数,单位为赫兹 (Hz)。采样定理指出,采样率必须至少是信号中最高频率分量的两倍,以避免混叠。

#### 量化

量化是将连续幅值的样本转换为有限范围的离散值的过程。这通常通过将样本舍入到最近的允许值来实现。量化误差是量化过程中引入的误差。

#### 离散化

离散化是将采样和量化的信号表示为数字序列的过程。这通常使用二进制表示来完成,其中每个样本用一组位来表示。离散化后的信号称为数字信号。

### 2.1.2 频域分析:傅里叶变换和频谱图

#### 傅里叶变换

傅里叶变换是一种数学工具,用于将时域信号分解为其频率分量的总和。它将时域信号转换为频域表示,其中信号的幅度和相位随频率变化。

#### 频谱图

频谱图是傅里叶变换结果的图形表示。它显示了信号中不同频率分量的幅度或功率。频谱图可用于识别信号中的模式、特征和噪声。

**代码块:**

```

% 采样信号

fs = 1000; % 采样率

t = 0:1/fs:1; % 时间向量

x = sin(2*pi*100*t) + sin(2*pi*200*t); % 信号

% 计算傅里叶变换

X = fft(x);

% 计算频谱图

N = length(X);

f = (0:N-1)*(fs/N); % 频率向量

P = abs(X/N); % 幅度谱

% 绘制频谱图

figure;

plot(f, P);

xlabel('频率 (Hz)');

ylabel('幅度');

title('频谱图');

```

**逻辑分析:**

此代码段演示了信号的采样、傅里叶变换和频谱图绘制。

* `fft` 函数执行傅里叶变换。

* `abs` 函数计算复数幅度。

* `N/N` 归一化幅度谱,以获得单位功率。

* `plot` 函数绘制频谱图,其中 x 轴表示频率,y 轴表示幅度。

# 3.1 滤波器设计

#### 3.1.1 滤波器类型

滤波器是一种信号处理技术,用于从信号中提取或抑制特定频率成分。根据其频率响应特性,滤波器可以分为以下类型:

- **低通滤波器:**允许低频信号通过,而衰减高频信号。

- **高通滤波器:**允许高频信号通过,而衰减低频信号。

- **带通滤波器:**允许特定频率范围内的信号通过,而衰减其他频率的信号。

- **带阻滤波器:**允许特定频率范围外的信号通过,而衰减该范围内的信号。

#### 3.1.2 滤波器设计方法

滤波器可以采用多

0

0