YOLO和CNN的联姻:卷积神经网络赋能目标检测,实现实时精准识别

发布时间: 2024-08-17 08:35:01 阅读量: 27 订阅数: 45

基于深度卷积神经网络的遥感影像目标检测技术研究及应用

# 1. 卷积神经网络(CNN)基础**

卷积神经网络(CNN)是一种深度学习模型,专门设计用于处理具有网格状结构的数据,例如图像。CNN由一系列卷积层组成,这些层提取数据中的局部特征。通过堆叠多个卷积层,CNN可以学习复杂的高级特征表示。

CNN的卷积操作涉及将卷积核(一个权重矩阵)与输入数据滑动,从而产生特征图。卷积核中的权重用于提取特定模式或特征,例如边缘、纹理或形状。通过使用多个卷积核,CNN可以检测各种特征,并逐渐构建对输入数据的高级理解。

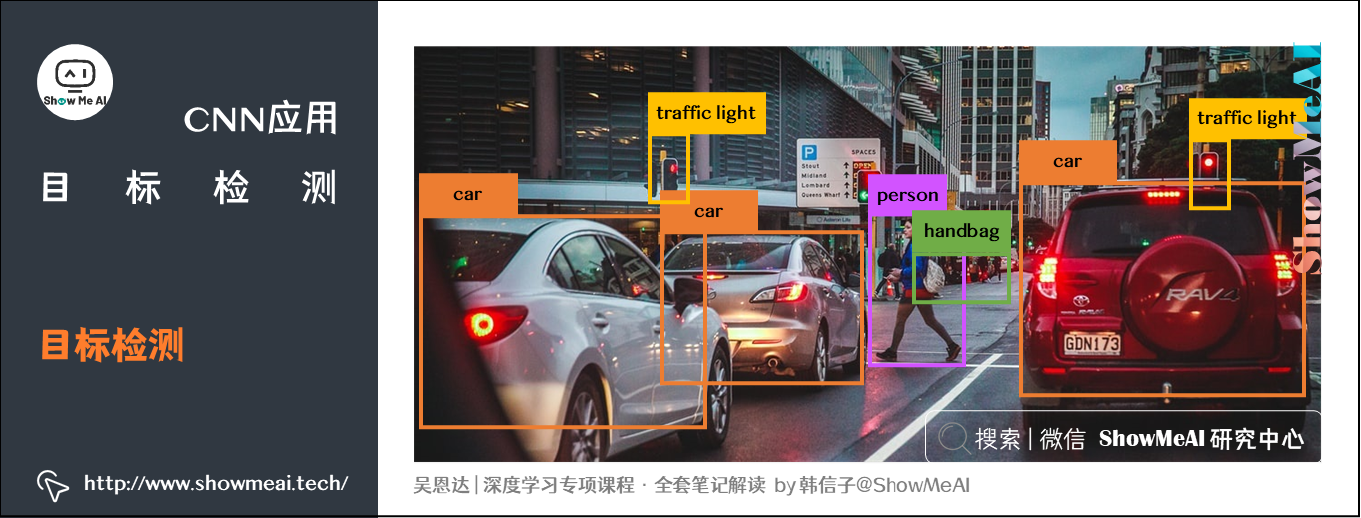

# 2. 目标检测中的CNN应用**

**2.1 YOLO算法原理**

**2.1.1 单次卷积检测**

YOLO(You Only Look Once)算法是一种单次卷积神经网络,可以一次性预测图像中的所有目标。与传统的目标检测算法不同,YOLO不使用滑动窗口或区域建议网络,而是将整个图像输入到卷积神经网络中,并输出一个包含目标位置和类别的预测张量。

**2.1.2 Bounding Box回归**

YOLO算法使用边界框回归来预测目标的精确位置。边界框回归是一个回归任务,它将预测的边界框与真实边界框之间的偏移量作为输出。通过使用边界框回归,YOLO可以预测与真实边界框非常接近的边界框。

**代码块:**

```python

def yolo_loss(y_true, y_pred):

"""

计算YOLO损失函数。

参数:

y_true: 真实目标边界框和类别标签。

y_pred: 预测的目标边界框和类别标签。

返回:

损失值。

"""

# 解析真实目标边界框和类别标签

true_boxes = y_true[:, :, :, 0:4]

true_classes = y_true[:, :, :, 4:]

# 解析预测的目标边界框和类别标签

pred_boxes = y_pred[:, :, :, 0:4]

pred_classes = y_pred[:, :, :, 4:]

# 计算边界框回归损失

bbox_loss = tf.keras.losses.MeanSquaredError()(true_boxes, pred_boxes)

# 计算分类损失

class_loss = tf.keras.losses.CategoricalCrossentropy()(true_classes, pred_classes)

# 返回总损失

return bbox_loss + class_loss

```

**逻辑分析:**

该代码块定义了YOLO损失函数,用于计算预测的目标边界框和类别标签与真实目标边界框和类别标签之间的损失。损失函数包括边界框回归损失和分类损失。

**2.2 YOLOv3和YOLOv4的改进**

YOLOv3和YOLOv4是YOLO算法的后续版本,它们在准确性和速度方面进行了改进。YOLOv3引入了新的特征提取器Darknet-53,并使用了残差连接来提高网络的深度。YOLOv4进一步改进了YOLOv3,引入了新的CSPDarknet53特征提取器和Mish激活函数。

**表格:**

| YOLO版本 | 特征提取器 | 速度 (FPS) | 准确度 (mAP) |

|---|---|---|---|

| YOLOv2 | Darknet-19 | 67 | 78.6 |

| YOLOv3 | Darknet-53 | 51 | 82.1 |

| YOLOv4 | CSPDarknet53 | 65 | 85.0 |

**mermaid流程图:**

```mermaid

graph LR

subgraph YOLOv2

A[Darknet-19] --> B[Detection]

end

subgraph YOLOv3

A[Darkne

```

0

0