时间序列分析的新动力:决策树算法的角色与影响

发布时间: 2024-09-03 17:44:09 阅读量: 112 订阅数: 61

实时通讯_PubNub_Python_SDK_开发工具_1741399528.zip

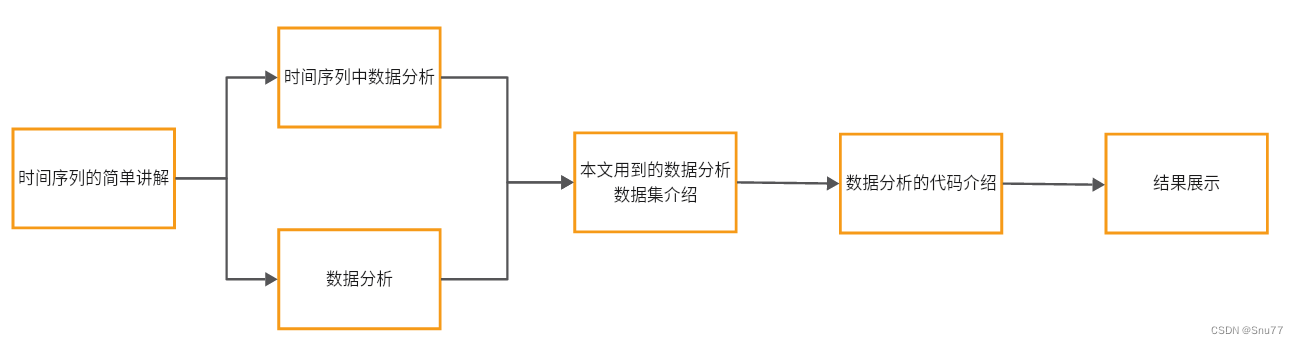

# 1. 时间序列分析与决策树算法概述

时间序列分析是研究按时间顺序排列的一系列数据点,以识别其中的模式、趋势和周期性。它在经济学、金融、气象学、信号处理等多个领域有广泛的应用。决策树算法是一种基本的机器学习技术,通过递归地划分数据,建立起一个树形结构的分类或回归模型。在时间序列分析中,决策树可以预测未来的数据点,或者识别出数据中的特殊模式和异常。决策树因其易于理解和实现而受到青睐,但在处理高维数据时可能会遇到过拟合的风险。

时间序列预测与决策树算法的结合,提供了一种新颖且有效的方式来解决复杂的数据分析问题。本章旨在对时间序列分析和决策树算法进行基础性的介绍,并为后续章节奠定理论基础。

# 2. 决策树算法在时间序列预测中的应用基础

### 2.1 决策树算法的工作原理

#### 2.1.1 算法结构与信息增益

决策树是一种监督学习方法,它从数据集创建一种模型,以预测目标变量的值。其核心是递归地选择最优特征,并根据该特征对训练数据进行分割,构建一个树状结构。在每个节点上,算法会尝试使用不同的特征,并基于特征的不同取值将数据分为子集。信息增益是决策树算法划分数据的一个关键概念,它是对数据集划分前后熵的差值进行衡量,通过最大化信息增益来确定最佳的分割特征。

```python

from sklearn.tree import DecisionTreeClassifier

# 构造一个简单的决策树模型用于说明

X = [[1, 2], [2, 4], [3, 6], [4, 8]]

y = [0, 0, 1, 1]

clf = DecisionTreeClassifier()

clf = clf.fit(X, y)

```

以上代码块展示了一个决策树模型的构建过程,使用`sklearn`库中的`DecisionTreeClassifier`。模型在简单的二维数据上进行训练,`X`是输入数据集,`y`是目标变量。

#### 2.1.2 常见的决策树算法及其比较

目前,存在多种决策树算法,包括ID3、C4.5、CART等。ID3算法利用信息增益作为分割标准,但其不能处理连续特征。C4.5是ID3的改进版,可以处理连续特征,但不适用于大数据集。CART(分类与回归树)算法则同时适用于分类和回归问题,通过二分递归分割连续和离散特征。在选择算法时需要根据实际问题和数据特性进行决策。

### 2.2 时间序列数据的预处理

#### 2.2.1 数据清洗和规范化方法

时间序列数据往往包含噪声、缺失值或异常值,因此预处理是至关重要的一步。数据清洗通常包括填补缺失值、去除或修正异常值。规范化方法如标准化和归一化,可以帮助减少数据量纲差异和数值范围的差别,从而提高模型的性能。

```python

from sklearn.preprocessing import StandardScaler

import numpy as np

# 假设data是一个包含时间序列数据的numpy数组

data = np.array([1, 2, 3, np.nan, 5])

# 填补缺失值

data = np.where(np.isnan(data), np.mean(data), data)

# 标准化处理

scaler = StandardScaler()

data_scaled = scaler.fit_transform(data.reshape(-1, 1))

```

上述代码片段中,首先用均值填补了缺失值,随后利用`StandardScaler`进行了标准化处理。

#### 2.2.2 特征工程的重要性与方法

特征工程是指从原始数据中通过转换产生更有信息量的新特征的过程。在时间序列预测中,常见的特征工程方法包括时间差分、滑动窗口统计量、滞后特征等。特征工程可以显著提升模型的性能,因为优秀的特征直接决定了模型学习的有效信息。

```python

# 生成滞后特征

def create_lag_features(data, lags=3):

df_lagged = data.shift(lags)

df_lagged.columns = [f"lag_{i}" for i in range(1, lags+1)]

data_lagged = pd.concat([data, df_lagged], axis=1)

return data_lagged

data_lagged = create_lag_features(data_scaled, lags=3)

```

在这个代码片段中,我们创建了滞后特征,用于捕捉时间序列数据的历史信息。`shift`函数用于将数据向下移动指定的滞后数`lags`,这样每一个时间点的数据都会有之前`lags`个时间点的数据作为特征。

### 2.3 决策树在时间序列中的训练与评估

#### 2.3.1 训练决策树模型的步骤

训练决策树模型大致包含以下步骤:数据准备、特征选择、模型初始化、模型训练、参数调优。通过选择合适的特征,并用这些特征来训练模型,我们可以获得一个基础的决策树模型。参数调优则可以通过交叉验证等技术进行,以达到更高的预测性能。

```python

from sklearn.model_selection import train_test_split

# 假设X和y已经准备好,并且特征工程已经完成

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 决策树模型训练

clf.fit(X_train, y_train)

```

通过分割数据集,我们可以将数据分为训练集和测试集。训练集用于模型的训练,测试集用于后续的性能评估。

#### 2.3.2 评估模型性能的指标

在时间序列预测中,我们通常用均方误差(MSE)、均方根误差(RMSE)或者平均绝对误差(MAE)等指标来评估模型的性能。这些指标能够帮助我们判断模型对时间序列数据的预测能力。

```python

from sklearn.metrics import mean_squared_error

# 预测和性能评估

y_pred = clf.predict(X_test)

mse = mean_squared_error(y_test, y_pred)

print(f"模型的均方误差(MSE)为: {mse}")

```

在这段代码中,我们使用了`mean_squared_error`函数来计算模型的MSE,以评估其预测性能。更小的MSE值通常意味着更好的预测准确性。

> 以上代码块的内容仅为示例,实际应用中需要依据具体问题和数据进行调整。

# 3. ```

# 第三章:决策树算法的实践应用与案例分析

## 3.1 实现决策树模型的编程实践

### 3.1.1 Python中决策树模型的搭建

在Python中,我们可以使用多个库来搭建决策树模型,例如`scikit-learn`库。决策树算法的实现基于一种称为ID3(Iterative Dichoto

```

0

0