【数据安全双保险】Hadoop复制策略与Checkpoint的紧密协作

发布时间: 2024-10-26 22:42:19 阅读量: 21 订阅数: 46

# 1. 数据安全的基本概念与重要性

随着技术的飞速发展,数据安全已成为IT行业一个至关重要的议题。数据安全不仅仅涉及防止未经授权的访问,更关键的是确保数据的完整性、保密性与可用性。本章将介绍数据安全的基本概念,包括数据隐私、数据泄露、数据完整性和数据备份等重要术语,并阐述数据安全对于组织运营的重要性。我们将深入分析数据泄露的潜在后果,例如财务损失、信誉损害及法律风险。此外,本章也将探讨数据安全在保障用户隐私和遵守法律法规方面所扮演的关键角色。通过这些内容,我们将为读者建立起一个数据安全的基础知识框架,并强调在当今数字化时代实施数据安全措施的必要性。

# 2. Hadoop复制策略的理论与实践

## 2.1 Hadoop复制机制概述

### 2.1.1 HDFS数据复制的原理

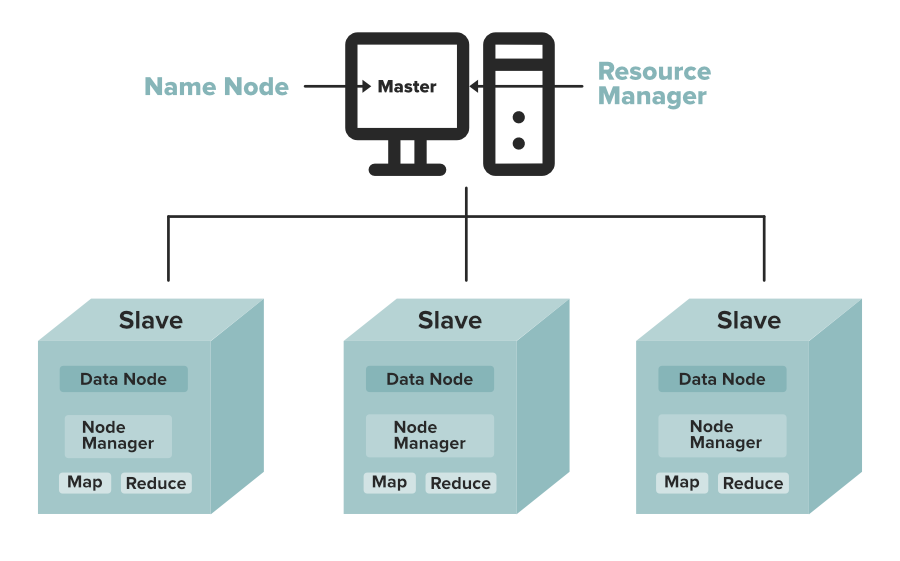

在分布式存储系统Hadoop中,HDFS(Hadoop Distributed File System)承担着存储大量数据的责任。为了确保数据的高可用性与容错性,HDFS使用了一种数据复制机制。数据复制的基本原理涉及将数据分割成块(blocks),每个块默认大小为128MB(Hadoop 3.x版本开始,默认为256MB),然后在多个数据节点(DataNodes)上存储多个副本。

这一机制的核心优势在于:

- **冗余存储**:通过保留多个数据副本,HDFS能在部分节点失效时,保证数据不会丢失,并且能够继续提供服务。

- **负载均衡**:数据副本的分布在多个节点上,可以实现存储的负载均衡。

- **高可用性**:多个副本的存在使得即使在节点故障的情况下,系统仍能保证数据的读写操作不受影响。

数据的复制是通过NameNode来控制的,它负责管理和调度数据块的复制工作。在写入操作中,客户端向NameNode发起写请求,NameNode根据数据块的大小和配置的复制策略,指导DataNode进行数据复制。

### 2.1.2 复制级别对性能的影响

复制级别是指每个数据块在不同数据节点上存储的副本数量。Hadoop提供了对复制级别的配置选项,允许用户根据自己的需要设置副本数量。默认情况下,Hadoop的复制因子是3,意味着每个数据块会有3个副本。

设置复制级别对系统性能有着重要影响:

- **读取性能**:较高的复制级别意味着可以在更多的节点上并行读取数据,从而提高读取性能。

- **写入性能**:写入操作会增加,因为需要在多个节点上写入相同的数据块。

- **存储开销**:复制级别越高,存储所需的空间就越大,这意味着需要更多的硬件资源。

- **容错能力**:增加复制级别可以提高系统的容错能力,减少数据丢失的风险。

对于存储密集型和可靠性要求较高的应用,较高的复制级别是必要的。而对于存储成本敏感的应用,可能需要设置较低的复制级别,以平衡性能与成本。

## 2.2 Hadoop复制策略的配置与管理

### 2.2.1 自动复制的配置方法

在Hadoop中,自动复制是通过配置文件来实现的。用户可以在`hdfs-site.xml`配置文件中设置`dfs.replication`参数,来定义默认的复制级别。

例如:

```xml

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>

```

如果需要为特定目录设置不同的复制级别,则可以使用`hadoop fs -setrep`命令来进行设置。例如,为目录`/user/hadoop/data`设置复制级别为5:

```shell

hadoop fs -setrep -w 5 /user/hadoop/data

```

此命令会为`/user/hadoop/data`目录下的所有文件设置复制级别为5,并且会等待复制操作完成。

### 2.2.2 手动复制和副本放置策略

Hadoop还支持手动复制数据,即使用`hadoop fs -cp`命令来复制文件到目标路径。手动复制允许用户更细致地控制数据的副本放置策略。

例如,将`/user/hadoop/input/data.txt`复制到`/user/hadoop/output/data.txt`:

```shell

hadoop fs -cp /user/hadoop/input/data.txt /user/hadoop/output/data.txt

```

副本放置策略是指数据写入时副本位置的安排。Hadoop默认使用机架感知(rack-awareness)副本放置策略,它会将副本分散到不同的机架上,从而在机架故障的情况下保证数据的可用性。

### 2.2.3 监控与故障诊断

监控Hadoop集群中的复制状态对于及时发现问题和进行故障诊断至关重要。Hadoop提供了许多工具用于监控复制状态和健康状况,如`hdfs dfsadmin -report`命令,它可以提供有关每个文件系统的详细报告。

```shell

hdfs dfsadmin -report

```

此外,Hadoop的Web界面也提供了一个直观的视图来监控集群状态。通过Web界面,管理员可以查看每个文件的副本信息,如副本数、副本所在节点、副本状态等。

当系统发生故障时,故障诊断是关键的恢复步骤。Hadoop的日志系统提供了详尽的错误信息和警告,是故障诊断的第一手资源。管理员可以通过查看DataNode和NameNode的日志,以及使用`hdfs fsck`命令来检查文件系统的一致性,从而确定是否存在丢失或损坏的数据块。

## 2.3 Hadoop复制策略的优化技巧

### 2.3.1 读写性能优化策略

在Hadoop中,读写性能的优化可以通过调整复制策略来实现。这里有几个提升性能的关键点:

- **副本数量的调整**:根据集群的工作负载调整默认的复制级别。对于读操作频繁的数据,提高副本数量可以提高读取性能;对于写操作频繁的数据,减少副本数量可以降低写入成本。

- **机架感知副本放置**:确保数据副本跨不同的机架分布,以减少机架故障对数据可用性的影响。

- **负载均衡**:定期运行`hadoop balancer`命令,以确保数据副本在集群中的均匀分布,避免因数据倾斜导致的

0

0