Hadoop NameNode故障转移:Checkpoint的决定性作用

发布时间: 2024-10-26 22:25:10 阅读量: 3 订阅数: 8

# 1. Hadoop NameNode概述

Hadoop NameNode是Hadoop分布式文件系统(HDFS)中的核心组件,它负责存储文件系统的元数据,如目录树和文件块的位置信息。NameNode的设计理念和实现机制是整个Hadoop系统稳定性和扩展性的关键。在这一章中,我们会详细探讨NameNode的工作原理、元数据管理方式以及它在HDFS中所扮演的核心角色。此外,我们还将介绍NameNode的高可用性解决方案,为理解后续章节关于故障转移和Checkpoint的内容打下基础。通过这一章节,读者将对Hadoop NameNode有一个全面的认识,为进一步深入学习Hadoop的架构设计提供坚实的知识基础。

# 2. NameNode的故障转移机制

## 2.1 NameNode高可用性架构

高可用性架构对于分布式存储系统至关重要,尤其是对于管理着整个文件系统的NameNode。Hadoop通过一系列设计和配置确保了即使在关键组件出现故障的情况下也能保证服务的持续可用性。

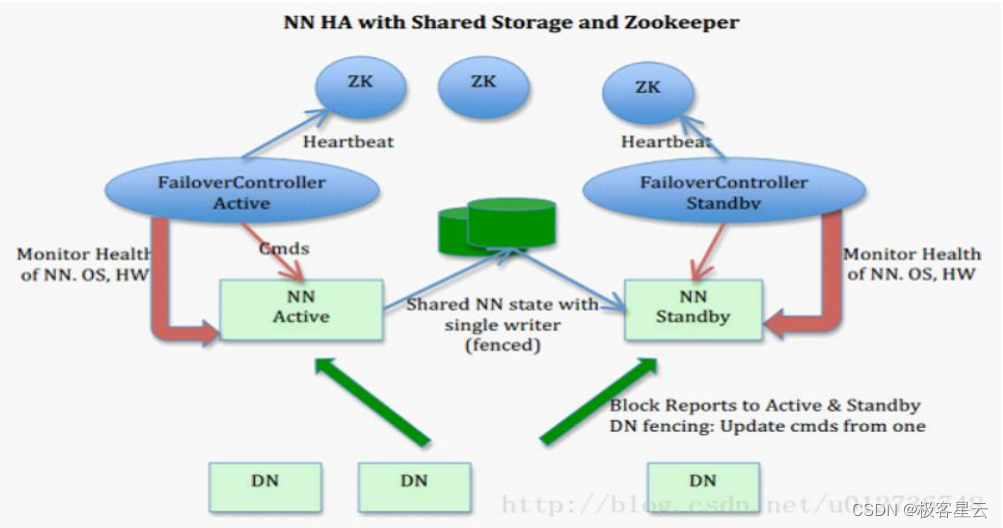

### 2.1.1 冗余设计原则

冗余是提高系统可用性的关键所在,它意味着有额外的资源或组件可以立即接管在正常情况下执行的任务。在Hadoop集群中,NameNode的冗余设计通过在不同的主机上运行多个NameNode实例来实现。每个实例都被称为角色(role),通常一个NameNode作为主角色(Active),另一个作为备角色(Standby)。这样,如果Active NameNode出现故障,Standby NameNode可以快速地切换角色,接管故障节点的工作。

### 2.1.2 主备NameNode的角色和职责

在高可用性架构中,主备NameNode各自承担着不同的角色和职责。Active NameNode负责处理所有客户端的文件系统操作请求,包括读取和写入文件数据,同时维护文件系统的命名空间以及文件到数据块的映射。

Standby NameNode则负责保持与Active NameNode状态的一致性。Standby通过一个称为"状态同步"(State-Synchronization)的机制从Active NameNode获取文件系统的命名空间和文件到数据块的映射信息,确保在必要时可以迅速切换角色。

## 2.2 故障转移触发条件

故障转移机制确保在发生故障时,系统能够自动、平滑地切换到备用节点,继续提供服务。这是通过事先设定的一系列触发条件来实现的。

### 2.2.1 故障检测机制

故障检测通常依赖于心跳机制(Heartbeat)。Active NameNode会定期向集群中的其他节点发送心跳信号,如果超过预定的阈值时间没有收到心跳信号,则认为该节点发生故障。此外,集群管理系统还会监视NameNode的健康状况,包括磁盘空间、内存使用情况以及处理能力等。一旦检测到异常,系统会考虑进行故障转移。

### 2.2.2 自动与手动故障转移

Hadoop提供了自动故障转移和手动故障转移两种机制。在自动故障转移模式下,一旦检测到Active NameNode出现故障,系统会自动启动故障转移流程,Standby NameNode将接管其角色。在手动模式下,管理员可以决定何时以及如何进行故障转移,这允许管理员在故障转移之前进行更多的故障诊断或数据备份操作。

## 2.3 故障转移过程中的Checkpoint

Checkpoint是故障转移过程中的一个重要环节。它确保在故障发生时,Standby NameNode可以快速地同步到故障发生前的状态,从而无缝接管服务。

### 2.3.1 Checkpoint的作用和重要性

Checkpoint是将NameNode内存中的文件系统命名空间元数据持久化到磁盘的过程。这一过程对于保持Active和Standby NameNode间元数据的一致性至关重要。它确保了即使在Active NameNode发生故障时,Standby NameNode也能拥有最新的元数据信息,从而实现故障转移。

### 2.3.2 Checkpoint的生成机制

Checkpoint的生成通常由Standby NameNode负责。它会周期性地从Active NameNode同步命名空间状态,并在本地生成FsImage文件。这个过程中,Standby NameNode会结合从Active NameNode接收到的EditLog,应用这些编辑操作到本地的文件系统命名空间状态,然后生成一个新的FsImage文件。一旦Standby NameNode完成Checkpoint,它就会等待成为新的Active NameNode。

接下来的章节会详细介绍Checkpoint的理论基础与实现。

# 3. Checkpoint的理论基础与实现

## 3.1 HDFS的持久化存储

### 3.1.1 EditLog的作用与管理

EditLog是Hadoop分布式文件系统(HDFS)中NameNode用来记录所有文件系统元数据操作的变更日志。每当客户端对文件系统进行操作(如创建文件、删除文件等),这些操作都会被封装成一个事务,并写入到EditLog中。

在HDFS中,EditLog的管理至关重要,因为它记录了HDFS状态的变更历史,是系统能够恢复到最后一致状态的关键。如果EditLog丢失或损坏,将会导致整个文件系统的元数据丢失。

EditLog通常存放在磁盘上,为了防止磁盘故障导致的数据丢失,可以配置为在多个物理位置进行复制。此外,定期滚动EditLog文件,即创建新的日志文件,以防止单个文件过大影响性能,同时可以通过配置编辑日志的大小限制来触发滚动。

```bash

# 示例:滚动EditLog的命令

hdfs --daemon logroll NameNode

```

在上述命令中,`logroll`操作会关闭当前正在使用的EditLog文件,并开始写入新的日志文件。这样可以限制每个EditLog文件的大小,便于管理和避免因文件过大而导致的恢复时间过长。

### 3.1.2 FsImage文件的结构与内容

FsImage文件是HDFS中NameNode的元数据镜像,它包含了文件系统的命名空间和块信息。FsImage是一种静态的文件格式,记录了在特定时间点文件系统内的所有目录和文件信息,包括:

- 文件的访问权限

- 文件的修改时间

- 块的ID和位置信息

- 副本的数量等

每个FsImage都保存了文件系统的快照。当NameNode启动时,它首先会加载FsImage文件,然后应用EditLog中记录的所有变更,以达到文件系统当前的状态。

FsImage文件是分层存储的,使用Protocol Buffers(一种轻量级的序列化协议)进行序列化和反序列化,以提高性能和减少内存占用。当需要读取FsImage时,NameNode使用专门的库来解析Protocol Buffers格式,读取文件系统的信息。

```protobuf

# 示例:FsImage文件中的一个条目结构

message FileStatus {

required string name = 1; // 文件名或目录名

required bool isdir = 2; // 是否为目录

required int64 mtime = 3; // 最后修改时间

required int64 length = 4; // 文件长度

required int32 replication = 5; // 副本数量

// ... 其他信息

}

```

上述代码定义了FsImage中一个文件或目录的条目结构,展示了FsImage文件所包含的信息的种类。在实际的FsImage文件中,会有许多类似的条目,它们一起组成了文件系统的完整视图。

## 3.2 Checkpoint的理论计算模型

### 3.2.1 Checkpoint触发时机的优化

Checkpoint是HDFS维护文件系统元数据一致性的关键机制。它的工作包括合并EditLog和FsImage,生成新的FsImage文件,并将变更应用到NameNode的内存中,以此来更新元数据状态。

Checkpoint的触发时机对系统性能有显著影响。过于频繁的Checkpoint操作会消耗大量的I/O和CPU资源,而过于稀疏的Checkpoint可能会在系统发生故障时需要回放更多的EditLog来恢复状态,这会导致系统恢复时间的增加。

为了优化Checkpoint的触发时机,可以采用以下策略:

- 根据系统的负载情况动态调整触发时机。例如,在低负载时增加Checkpoint的频率,而在高负载时减少频率。

- 利用机器学习方法对过去的操作日志进行分析,预测最优的Checkpoint时机。

- 考虑硬件的I/O性能,合理配置Checkpoint的I/O资源,避免与NameNode的日常操作发生I/O竞争。

### 3.2.2 理论模型对性能的影响分析

Checkpoint理论模型通过对系统行为的分析和预测,为优化Checkpoint操作提供了理论基础。此模型帮助我们理解在不同工作负载和配置下,Checkpoint对系统性能的影响。

理论模型可以用来评估不同Checkpoint频率、大小限制、I/O策略等配置对性能的影响。例如,通过构建一个模拟环境,可以预测在特定配置下Checkpoint操作可能耗时,以及对NameNode响应时间的影响。

性能影响的分析还可以结合实际的Hadoop集群运行数据,通过统计分析和机器学习来提升模型的准确性。这有助于制定出适合特定环境的Checkpoint策略,确保既能满足系统的恢复需求,又能保持良好的系统性能。

## 3.3 Checkpoint的实践操作

### 3.3.1 Checkpoint的执行过程

Checkpoint操作通常由Secondary NameNode、Standby NameNode或者CheckpointNode(如果配置了的话)执行。以下是一个简化的Checkpoint执行过程:

1. Secondary NameNode(或者CheckpointNode)通过HTTP GET请求从Active NameNode获取当前最新的EditLog和FsImage文件。

2. Secondary NameNode将下载的EditLog应用到本地的FsImage副本上,这个过程称为“编辑日志的合并”。

3. 合并后的FsImage(也称为“检查点”)会被压缩并上传回Active NameNode。

4. Active NameNode接收到新的FsImage后,会用它来替换旧的FsImage,并开始新的EditLog文件的写入。

```mermaid

graph LR

A[Secondary NameNode] --> B(获取EditLog和FsImage)

B --> C(应用EditLog到FsImage副本)

C --> D(压缩合并后的FsImage)

D --> E(上传新的FsImage到Active NameNode)

E --> F(Active NameNode替换旧的FsImage并开始新的EditLog)

```

在上述的mermaid流程图中,描述了Checkpoint操作的整个流程,以及各个步骤之间如何相互协作。

### 3.3.2 Checkpoint操作的监控与日志

监控Checkpoint操作对于确保HDFS的健康和性能至关重要。监控工具可以收集关于Checkpoint进度的信息,帮助管理员了解操作的状态,及时发现并解决问题。

一个常用的监控实践是通过日志分析来追踪Checkpoint的状态。Hadoop提供了多种日志级别,可以通过配置日志级别来显示更多的Checkpoint相关日志信息。

在实际操作中,可以通过设置日志级别为INFO或DEBUG级别来获取Checkpoint相关的信息,例如:

```shell

# 示例:设置日志级别为INFO

hadoop --daemon loglevel SecondaryNameNode -setlevel INFO

```

通过以上命令,Secondary NameNode的日志输出将包括Checkpoint的相关信息,这对于进行问题诊断和性能优化非常有帮助。日志中通常会记录Checkpoint开始、合并EditLog、上传FsImage等各个阶段的时间戳和状态,通过这些信息可以有效地监控Checkpoint操作的进度。

```plaintext

INFO fs.FSImage.format(FSImage.java:149) - Saving image file /hadoop/dfs/namesecondary/current/fsimage.ckpt_***_*** to /hadoop/dfs/dfsimage/dfsimage.ckpt_***_***

INFO common.HadoopFsck(SecondaryNameNode.java:281) - Number of files: 59

INFO common.HadoopFsck(SecondaryNameNode.java:285) - Number of files under construction: 0

INFO common.HadoopFsck(SecondaryNameNode.java:289) - Total size: *** (121 MB)

INFO common.HadoopFsck(SecondaryNameNode.java:293) - Total blocks (validated): 49 (49)

INFO common.HadoopFsck(SecondaryNameNode.java:297) - Minimally replicated blocks: 49 (100.0 %)

INFO common.HadoopFsck(SecondaryNameNode.java:301) - Over-replicated blocks: 0 (0.0 %)

INFO common.HadoopFsck(SecondaryNameNode.java:305) - Under-replicated blocks: 0 (0.0 %)

INFO common.HadoopFsck(SecondaryNameNode.java:309) - Mis-replicated blocks: 0 (0.0 %)

INFO common.HadoopFsck(SecondaryNameNode.java:313) - Default replication factor: 3

INFO common.HadoopFsck(SecondaryNameNode.java:317) - Average block replication: 3.0

INFO common.HadoopFsck(SecondaryNameNode.java:321) - Corrupt blocks: 0

INFO common.HadoopFsck(SecondaryNameNode.java:325) - Missing replicas: 0 (0.0 %)

INFO common.HadoopFsck(SecondaryNameNode.java:329) - Number of data-nodes: 3

INFO common.HadoopFsck(SecondaryNameNode.java:333) - Number of racks: 1

```

以上日志片段显示了Checkpoint完成后,通过HadoopFsck工具检查文件系统的输出结果。这些信息可以帮助管理员判断文件系统的健康状况以及Checkpoint操作是否成功完成。

# 4. Checkpoint在故障转移中的应用案例

### 4.1 故障转移案例分析

#### 4.1.1 真实环境下的故障转移实例

在大数据环境中,Hadoop集群的稳定性至关重要。故障转移(Failover)是确保Hadoop集群高可用的关键机制之一。在实际部署中,NameNode的故障转移过程是自动化的,但在某些情况下,需要手动介入以确保数据的一致性和服务的连续性。

假设有一个运行中的Hadoop集群,包含一个活跃的NameNode(Active NN)和一个处于热备用状态的Standby NN。某日,由于系统更新或硬件故障,Active NN突然停止服务。此时,集群会自动检测到主节点的故障,并启动故障转移过程,目的是将Standby NN提升为新的Active NN。

故障转移启动后,Standby NN接管所有NameNode的职责。它首先会读取最新的FsImage和EditLog文件,以构建最新的命名空间状态。然后,Standby NN利用从故障转移点开始的EditLog条目,将文件系统的状态更新到最新的状态。这一过程往往需要一些时间,因为需要重放自最后一次Checkpoint以来所有的命名空间更新操作。

#### 4.1.2 Checkpoint在案例中的角色

Checkpoint是整个故障转移流程的核心。在上述故障转移案例中,如果没有最新的Checkpoint,Standby NN就无法快速地同步文件系统状态。这就要求Checkpoint过程不仅需要定期执行,还需要高效可靠。

在故障转移过程中,Checkpoint文件是Standby NN重建文件系统状态的基石。如果Checkpoint太旧,那么Standby NN需要重放大量的EditLog,这会增加故障转移的时间,并且在此期间,集群对外提供服务的能力会受到影响。因此,在实际操作中,我们需要定期执行Checkpoint,以及合理配置EditLog的滚动阈值,以减少故障转移时需要重放的日志条目数量。

### 4.2 性能优化与故障分析

#### 4.2.1 提升Checkpoint性能的策略

为了优化Checkpoint性能,我们可以采取以下策略:

1. **调整Checkpoint的频率**:提高Checkpoint的执行频率可以减少故障转移时需要重放的日志条目数量,但是过于频繁的Checkpoint也会占用过多的计算和I/O资源。因此,需要根据实际业务负载来合理配置Checkpoint的频率。

2. **使用并行处理**:在执行Checkpoint时,可以通过分布式环境,将FsImage文件的生成过程分散到多个节点上进行,以提高生成效率。

3. **优化EditLog的管理**:合理设置EditLog的滚动阈值,避免因单个文件过大而导致的读写性能瓶颈。可以考虑对旧的EditLog文件进行压缩,以节省磁盘空间和加快读取速度。

#### 4.2.2 故障案例中的Checkpoint问题诊断

在故障案例分析中,Checkpoint的问题主要集中在两个方面:Checkpoint执行失败和Checkpoint效率低下。

- **Checkpoint执行失败**:通常由磁盘空间不足、文件系统损坏或权限问题导致。检查磁盘空间、文件系统健康状况和相关权限设置,是诊断此类问题的第一步。

- **Checkpoint效率低下**:可能是由于I/O瓶颈、CPU资源受限或者Checkpoint过程中的配置参数不当。可以通过监控工具分析资源使用情况,并通过调整参数或优化代码来提升性能。

### 4.3 最佳实践与注意事项

#### 4.3.1 Checkpoint配置的最佳实践

为了确保Checkpoint的高效执行,以下是一些最佳实践:

1. **定期备份FsImage和EditLog**:在Checkpoint之外,还应该定期备份FsImage和EditLog,以防止数据丢失。

2. **合理配置FsCheckpointDir和EditLogDir**:这两个目录应该放在不同的磁盘或存储系统上,以避免I/O竞争和潜在的单点故障。

3. **监控Checkpoint进程**:实时监控Checkpoint进程的状态和性能指标,确保Checkpoint的顺利执行。

#### 4.3.2 避免Checkpoint相关故障的策略

为了防止Checkpoint相关故障,以下策略必须被遵循:

1. **定期进行模拟故障转移测试**:通过定期模拟故障转移,可以及时发现并解决Checkpoint过程中可能出现的问题。

2. **避免人为干预的必要性**:配置自动的故障检测和转移机制,减少人为干预的需求,降低操作错误的可能性。

3. **维护足够的空余资源**:确保在Checkpoint执行期间,集群有足够的资源可供使用,避免资源竞争导致的性能下降。

通过以上实践和策略的实施,可以显著提升Hadoop集群的稳定性和故障转移的效率。在实际部署中,应该根据业务需求和资源情况,灵活调整Checkpoint的配置参数和策略。

# 5. 未来展望与研究方向

随着大数据技术的不断演进,Hadoop NameNode作为整个Hadoop分布式文件系统(HDFS)的核心组件,其性能优化和可靠性提升一直是研究的热点。Checkpoint机制作为保障HDFS数据一致性和容错性的重要组成部分,同样面临着新的挑战和改进机遇。在这一章节中,我们将探讨NameNode及其Checkpoint机制的未来发展趋向和研究方向,以及可能的研究深度拓展。

## 5.1 Hadoop NameNode的发展趋势

### 5.1.1 NameNode架构的可能演进

随着数据规模的日益增长,单点故障问题越来越成为限制HDFS性能和稳定性的瓶颈。因此,NameNode架构的演进方向将集中在以下几个方面:

- **横向扩展能力**:研究如何通过集群分布式架构,实现NameNode的负载均衡和状态同步,从而提升整个文件系统的横向扩展能力。

- **元数据管理优化**:探索更高效的元数据存储和访问机制,如使用内存数据库技术,来减少对磁盘I/O的依赖,提高处理速度。

- **轻量级NameNode**:研究轻量级NameNode或者元数据缓存节点的实现,以减轻主NameNode的压力,提高系统的整体吞吐量。

### 5.1.2 Checkpoint机制的潜在改进

Checkpoint机制是保障HDFS数据安全的重要手段,但其在性能上仍有提升空间:

- **增量Checkpoint**:目前Checkpoint机制主要进行全量备份,这在数据量大时,会导致明显的性能下降。未来可能会实现增量Checkpoint,仅备份最近发生变化的元数据。

- **Checkpoint的并行处理**:研究如何并行化Checkpoint的过程,利用多线程或分布式处理来加速备份操作,从而降低对系统性能的影响。

## 5.2 研究的深度拓展

### 5.2.1 分布式存储系统中Checkpoint的研究

Checkpoint不仅仅局限于HDFS,其在其他分布式存储系统中的应用也是一片蓝海:

- **跨系统Checkpoint的标准化**:探索并标准化不同分布式存储系统的Checkpoint机制,以支持异构存储环境间的兼容性和数据迁移。

- **实时数据一致性保证**:研究如何结合事务处理和实时分析,实现数据的实时一致性保证,这对于需要低延迟处理的场景尤为重要。

### 5.2.2 Checkpoint在大数据生态中的应用前景

Checkpoint机制在大数据生态系统中有着广泛的应用前景:

- **数据仓库和数据湖的整合**:Checkpoint可以作为一种数据一致性保证机制,用于支持数据仓库和数据湖之间的数据集成。

- **云环境下的数据持久化**:随着越来越多的应用迁移到云端,如何在云环境中高效地进行Checkpoint处理,保证数据持久性和一致性,将成为研究的重点。

通过上述分析,我们可以看到,NameNode及其Checkpoint机制的未来发展前景广阔,不仅在Hadoop生态系统内部有改进和优化的空间,而且在更广泛的分布式存储和大数据领域,Checkpoint同样具有重大的研究价值和应用潜力。随着技术的进步和需求的变化,未来对于Checkpoint的深入研究和应用拓展将不断推进,以满足更为复杂和多样化的业务场景需求。

0

0