超参数优化指南:让MATLAB卷积神经网络性能更上一层楼

发布时间: 2024-06-09 18:34:20 阅读量: 237 订阅数: 45

人工智能-matlab-基于Matlab的卷积神经网络手写体识别

# 1. 卷积神经网络简介

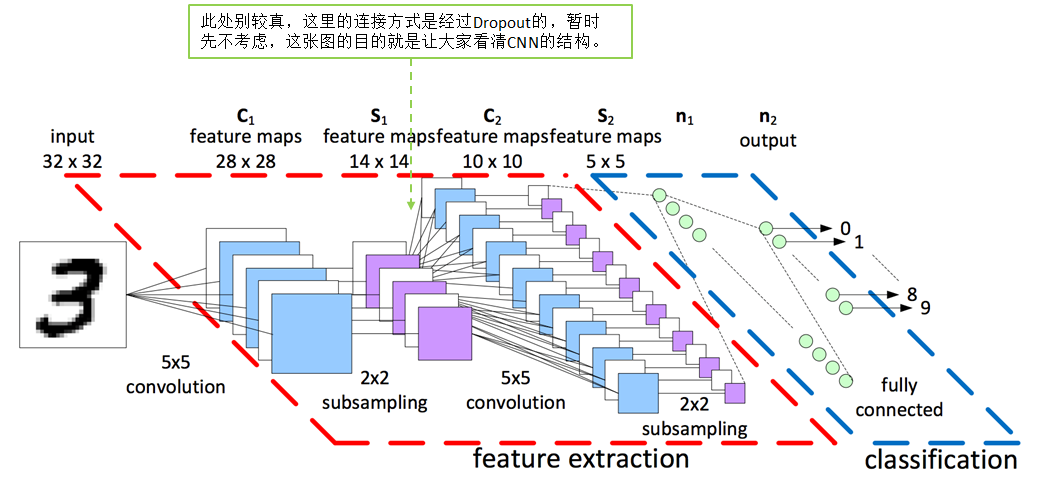

卷积神经网络(CNN)是一种深度学习模型,它在图像识别、自然语言处理和语音识别等领域取得了显著的成功。CNN 的核心思想是利用卷积操作来提取数据的局部特征,并通过多层卷积和池化操作构建层次化的特征表示。

CNN 的基本结构包括:

- **卷积层:**应用卷积核在输入数据上滑动,提取局部特征。

- **池化层:**对卷积层的输出进行降采样,减少特征图的大小并增强鲁棒性。

- **全连接层:**将卷积层的输出展平并连接到全连接层,进行分类或回归任务。

# 2. 超参数优化理论

### 2.1 超参数的概念和重要性

超参数是机器学习模型中不可训练的参数,它们控制着模型的结构和训练过程。与模型权重不同,超参数在训练前就需要设定,并且在训练过程中保持不变。

超参数优化对于卷积神经网络 (CNN) 性能至关重要,因为它可以帮助我们找到最佳的超参数组合,从而提高模型的精度、泛化能力和训练效率。

### 2.2 超参数优化方法

#### 2.2.1 网格搜索

网格搜索是一种简单但有效的超参数优化方法。它通过遍历超参数空间中的所有可能组合来找到最佳超参数。网格搜索的优点是简单易懂,缺点是计算成本高,尤其是对于超参数空间较大的模型。

```

% 定义超参数空间

hyperparameters = {

'LearningRate', [0.001, 0.005, 0.01],

'Momentum', [0.5, 0.7, 0.9],

'BatchSize', [16, 32, 64]

};

% 执行网格搜索

[best_hyperparameters, best_accuracy] = gridSearch(hyperparameters, trainingData);

% 输出最佳超参数和精度

disp(['最佳超参数:', best_hyperparameters]);

disp(['最佳精度:', best_accuracy]);

```

#### 2.2.2 随机搜索

随机搜索是一种更有效率的超参数优化方法。它通过随机采样超参数空间来找到最佳超参数。随机搜索的优点是计算成本较低,缺点是可能错过一些较好的超参数组合。

```

% 定义超参数空间

hyperparameters = {

'LearningRate', [0.001, 0.005, 0.01],

'Momentum', [0.5, 0.7, 0.9],

'BatchSize', [16, 32, 64]

};

% 执行随机搜索

[best_hyperparameters, best_accuracy] = randomSearch(hyperparameters, trainingData);

% 输出最佳超参数和精度

disp(['最佳超参数:', best_hyperparameters]);

disp(['最佳精度:', best_accuracy]);

```

#### 2.2.3 贝叶斯优化

贝叶斯优化是一种基于贝叶斯统计的超参数优化方法。它通过构建超参数空间的概率分布来找到最佳超参数。贝叶斯优化的优点是效率高,缺点是计算成本较高。

```

% 定义超参数空间

hyperparameters = {

'LearningRate', [0.001, 0.005, 0.01],

'Momentum', [0.5, 0.7, 0.9],

'BatchSize', [16, 32, 64]

};

% 执行贝叶斯优化

[best_hyperparameters, best_accuracy] = bayesianOptimization(hyperparameters, trainingData);

% 输出最佳超参数和精度

disp(['最佳超参数:', best_hyperparameters]);

disp(['最佳精度:', best_accuracy]);

```

# 3. MATLAB 中的超参数优化实践

### 3.1 使用 MATLAB 进行超参数优化

MATLAB

0

0