C++内存碎片:5招巧妙应对与解决方案

发布时间: 2024-10-20 16:03:33 阅读量: 40 订阅数: 28

# 1. C++内存碎片问题概述

内存碎片问题是每个C++开发者在软件开发过程中都可能会遇到的一个棘手问题。简单地说,它指的是系统在分配和回收内存的过程中,未使用的内存碎片化,导致无法有效利用,最终影响程序性能,降低系统稳定性。随着应用程序运行时间的增加,内存碎片化问题会变得越来越严重。因此,理解内存碎片的成因和影响对于开发高性能、稳定的软件至关重要。

## 1.1 内存碎片的概念

在深入探讨内存碎片问题之前,我们首先要理解什么是内存碎片。内存碎片是指在动态内存分配过程中,系统虽然还有足够的总内存,但由于内存块小而分散,无法满足一个大块内存的分配请求,造成无法分配的情况。

## 1.2 内存碎片的影响

内存碎片对程序性能的影响表现在增加程序运行时的内存分配延迟和降低内存使用效率上。此外,内存碎片还可能影响系统的稳定性,因为分配失败可能导致程序异常退出或内存访问错误等问题。

接下来的文章将详细探讨内存碎片的理论基础,包括内存管理机制、内存碎片的成因和分类以及它对程序性能和系统稳定性的影响。了解这些基础知识,将为后续的检测、预防和解决内存碎片问题奠定坚实的理论基础。

# 2. 内存碎片的理论基础

### 2.1 内存管理机制

#### 2.1.1 动态内存分配原理

动态内存分配是程序运行时,根据需要从堆(heap)中分配或释放内存的过程。与静态内存分配(例如全局变量和静态变量)不同,动态分配的内存大小可以在编译时未知,并且可以在程序运行时确定。

```c

// 示例代码:动态内存分配与释放

void* ptr = malloc(size); // 在堆上分配内存

// 使用内存...

free(ptr); // 释放内存,防止内存泄漏

```

在 C/C++ 程序中,动态内存分配通常使用 `malloc`、`calloc`、`realloc` 和 `free` 这些函数。`malloc` 用于分配指定大小的内存块,返回指向它的指针。`free` 函数释放之前分配的内存。

动态内存分配的问题在于,如果没有正确管理,很容易引起内存泄漏或者内存碎片。内存泄漏是由于指针丢失,无法释放已分配的内存;内存碎片则是由于频繁分配和释放内存,导致堆内存变得零散,难以利用。

#### 2.1.2 堆与栈的区别和联系

在内存管理机制中,堆(heap)和栈(stack)是两个重要的概念。它们在内存中具有不同的用途、布局和管理方式。

- **栈(Stack):**

栈是一种后进先出(LIFO)的数据结构,用于存储局部变量、函数参数和返回地址等。栈内存通常由编译器自动管理,大小在程序编译时确定,并且在程序运行时不变。栈的分配和释放速度非常快,但其容量有限,并且不适用于存储动态大小的数据。

- **堆(Heap):**

堆是用于动态内存分配的内存区域,由程序员通过代码显式管理。堆不具有栈那样的自动管理机制,因此需要程序员负责分配和释放内存。

```c

// 示例代码:栈与堆分配的区别

void func() {

int stackVar = 10; // 栈内存分配

int* heapVar = (int*)malloc(sizeof(int)); // 堆内存分配

// 使用变量...

free(heapVar); // 释放堆内存

}

int main() {

func();

return 0;

}

```

在实践中,合理区分栈内存和堆内存的使用可以有效减少内存碎片的发生。一般情况下,对于生命周期短且大小固定的对象,推荐使用栈内存。而对于生命周期长、大小可变或全局需要的对象,则应使用堆内存。

### 2.2 内存碎片的成因与分类

#### 2.2.1 内部碎片与外部碎片

内存碎片可以分为两种类型:内部碎片和外部碎片。

- **内部碎片(Internal Fragmentation):**

指的是在分配给某个进程的内存块中,未被使用的部分。例如,一个进程请求分配 100 字节,但系统只能按 104 字节(4 的倍数)分配,则多出的 4 字节就形成了内部碎片。

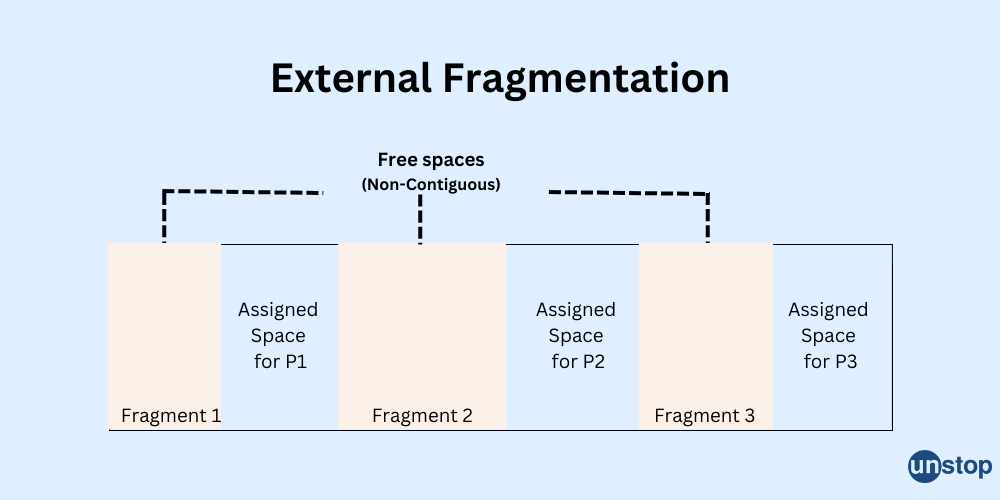

- **外部碎片(External Fragmentation):**

是指堆内存中未被使用的内存区域,但这些区域太小而无法满足程序后续的内存请求。外部碎片发生在连续分配和释放之后,导致可用内存被切割成小块,无法有效利用。

#### 2.2.2 碎片产生的条件和影响因素

内存碎片产生的主要条件包括:

- **内存分配请求的大小和频率:**

频繁的小块内存分配和释放容易产生碎片。

- **内存分配策略:**

如果分配器不能有效地合并相邻的空闲内存块,那么碎片会更严重。

- **程序的内存使用模式:**

不规则的内存使用模式可能导致内存碎片。

影响因素包括:

- **操作系统的设计:**

操作系统使用的内存管理策略和算法。

- **硬件架构:**

硬件对内存访问速度的影响。

- **程序设计:**

程序设计中对内存的使用方式。

### 2.3 内存碎片的影响分析

#### 2.3.1 对程序性能的影响

内存碎片对程序性能的影响主要体现在以下几个方面:

- **分配延迟:**

随着内存碎片的累积,程序在请求大块内存时可能会遭遇延迟,因为系统需要搜索足够的空闲内存空间。

- **内存使用效率下降:**

由于无法有效利用碎片内存,系统可能会频繁进行内存分配和释放操作,这会增加程序的开销。

- **垃圾回收开销增加:**

在具有垃圾回收机制的环境中,大量内存碎片可能导致垃圾回收器频繁运行,增加系统负担。

#### 2.3.2 对系统稳定性的影响

内存碎片还可能影响系统的稳定性:

- **内存不足:**

碎片导致内存无法满足大型内存请求,可能导致程序崩溃或系统异常。

- **性能波动:**

系统在高负载时可能出现性能波动,因为碎片化内存的分配和回收过程增加了不确定性。

- **维护成本上升:**

为了解决碎片问题,系统管理员可能需要定期重启服务或进行资源调整,增加了维护成本。

# 3. 内存碎片的检测与分析

在现代软件开发中,内存碎片问题越来越引起开发者的关注。由于内存碎片化会导致应用程序性能下降,甚至系统崩溃,因此能够检测并分析内存碎片成为了软件优化过程中必不可少的一步。本章将详细介绍内存碎片检测工具,内存使用模式的分析,以及内存碎片量化的各种方法。

## 3.1 内存碎片检测工具介绍

内存碎片检测工具是诊断内存碎片问题的重要手段,它们通常提供了一套完整的解决方案,帮助开发者识别内存使用中的问题。了解和使用这些工具对于管理内存碎片至关重要。

### 3.1.1 Valgrind工具集

Valgrind是一个强大的内存调试和分析工具集,它支持对程序进行内存泄漏检测、内存分配错误检测、性能分析等功能。Valgrind中的一个核心工具是Memcheck,它能够检测以下几种常见的内存问题:

- 内存泄漏:

0

0