MATLAB深度学习实战:神经网络、卷积神经网络和循环神经网络

发布时间: 2024-07-04 14:23:51 阅读量: 3 订阅数: 8

# 1. MATLAB深度学习简介

MATLAB深度学习是一个强大的工具箱,它使研究人员和工程师能够轻松地构建、训练和部署深度学习模型。它提供了广泛的神经网络架构、训练算法和预训练模型,使开发人员能够快速有效地解决复杂的问题。

MATLAB深度学习工具箱建立在MATLAB强大而直观的编程环境之上,该环境以其易用性和广泛的工具集而闻名。这使得开发人员可以轻松地集成深度学习模型到现有的应用程序和工作流程中,从而简化了从原型设计到部署的整个过程。

# 2. 神经网络基础理论与实践

神经网络作为深度学习的核心,其概念、结构、训练和优化是理解深度学习的关键。本章将深入浅出地介绍神经网络的基础理论与实践,为后续章节的学习奠定坚实的基础。

### 2.1 神经网络的概念和结构

#### 2.1.1 人工神经元模型

神经网络的最小单元是人工神经元,其结构和功能与生物神经元类似。人工神经元接收多个输入信号,经过加权求和和激活函数处理,输出一个新的信号。

```

% 定义输入信号

x = [1, 2, 3];

% 定义权重

w = [0.1, 0.2, 0.3];

% 加权求和

net = dot(x, w);

% 激活函数(Sigmoid 函数)

output = 1 / (1 + exp(-net));

% 输出结果

disp(output);

```

**参数说明:**

* `x`:输入信号向量

* `w`:权重向量

* `net`:加权求和结果

* `output`:激活函数输出

**逻辑分析:**

* 加权求和操作将输入信号与权重相乘并求和,计算出神经元的总输入。

* 激活函数对总输入进行非线性变换,产生神经元的输出。Sigmoid 函数将总输入映射到 0 到 1 之间的范围,模拟生物神经元的激活过程。

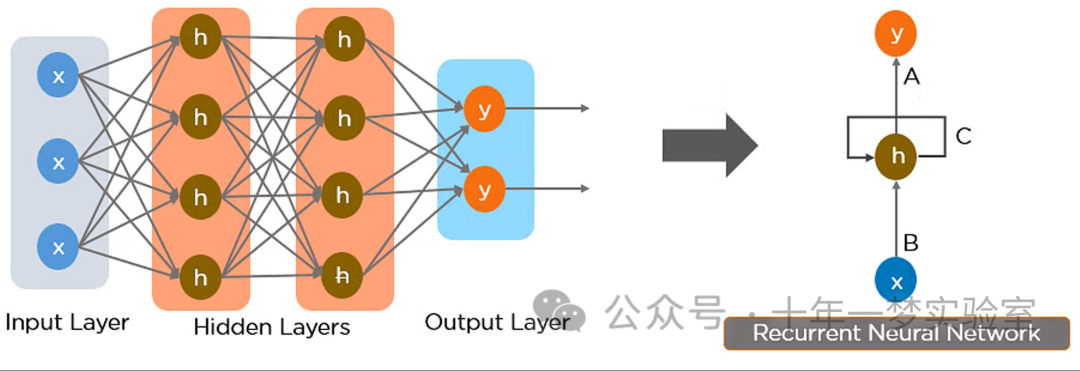

#### 2.1.2 神经网络的层级结构

神经网络通常由多个神经元层级叠构成。每一层的神经元接收上一层神经元的输出作为自己的输入,并通过加权求和和激活函数处理,产生新的输出。

```

% 定义输入层

input_layer = [1, 2, 3];

% 定义隐藏层

hidden_layer = [0.1, 0.2, 0.3] * input_layer;

hidden_layer = 1 / (1 + exp(-hidden_layer));

% 定义输出层

output_layer = [0.4, 0.5, 0.6] * hidden_layer;

output_layer = 1 / (1 + exp(-output_layer));

% 输出结果

disp(output_layer);

```

**参数说明:**

* `input_layer`:输入层

* `hidden_layer`:隐藏层

* `output_layer`:输出层

**逻辑分析:**

* 输入层接收原始数据。

* 隐藏层对输入层进行非线性变换,提取特征。

* 输出层对隐藏层的输出进行最终的分类或回归。

### 2.2 神经网络的训练和优化

神经网络的训练过程旨在调整权重和偏置,以最小化损失函数,提高模型的预测准确性。

#### 2.2.1 梯度下降算法

梯度下降算法是神经网络训练中常用的优化算法。其基本思想是沿损失函数的负梯度方向更新权重和偏置,从而逐步减小损失函数值。

```

% 定义损失函数

loss_function = @(w) sum((y - w * x).^2);

% 定义梯度下降算法

gradient_descent = @(w, learning_rate) w - learning_rate * gradient(loss_function, w);

% 初始化权重

w = 0.5;

% 训练迭代

for i = 1:1000

w = gradient_descent(w, 0.01);

end

% 输出训练后的权重

disp(w);

```

**参数说明:**

* `loss_function`:损失函数

* `gradient_descent`:梯度下降算法

* `w`:权重

* `learning_rate`:学习率

**逻辑分析:**

* 损失函数衡量模型预测与真实值之间的差异。

* 梯度下降算法计算损失函数对权重的偏导数(梯度),并沿负梯度方向更新权重。

* 学习率控制权重更新的步长。

#### 2.2.2 反向传播算法

反向传播算法是一种高效的梯度计算方法,用于训练多层神经网络。其基本原理是通过链式法则,将损失函数对输出层的梯度反向传播到输入层,从而计算所有权重和偏置的梯度。

```

% 定义神经网络

net = feedforwardnet([10, 10]);

% 训练神经网络

net = train(net, input_data, target_data);

% 获取权重和偏置

weights = net.IW;

biases = net.b;

```

**参数说明:**

* `net`:神经网络对象

* `input_data`:输入数据

* `target_data`:目标数据

* `weights`:权重

* `biases`:偏置

**逻辑分析:**

* `feedforwardnet` 函数创建多层前馈神经网络。

* `train` 函数使用反向传播算法训练神经网络。

* 训练完成后,可以获取训练好的权重和偏置。

#### 2.2.3 激活函数的选择

激活函数在神经网络中起着至关重要的作用,它决定了神经元的输出与输入之间的非线性关系。常用的激活函数包括 Sigmoid 函数、ReLU 函数和 Tanh 函数。

```

% 定义 Sigmoid 函数

sigmoid = @(x) 1 / (1 + exp(-x));

% 定义 ReLU 函数

relu = @(x) max(0, x);

% 定义 Tanh 函数

tanh = @(x) (exp(x) - exp(-x)) / (exp(x) + exp(-x));

% 绘制激活函数曲线

x = linspace(-10, 10, 100);

figure;

plot(x, sigmoid(x), 'b', x, relu(x), 'r', x, tanh(x), 'g');

legend('Sigmoid', 'ReLU', 'Tanh');

``

```

0

0