K折交叉验证在时间序列分析中的应用:预测模型评估利器

发布时间: 2024-08-21 22:28:41 阅读量: 90 订阅数: 30

基于万能逼近原理的自适应模糊控制算法在多自由度AUV运动控制中的应用与抗干扰补偿Simulink仿真研究,自适应模糊控制算法的万能逼近原理与多自由度AUV运动控制的抗干扰补偿技术-基于Simulin

# 1. K折交叉验证的基本原理和应用

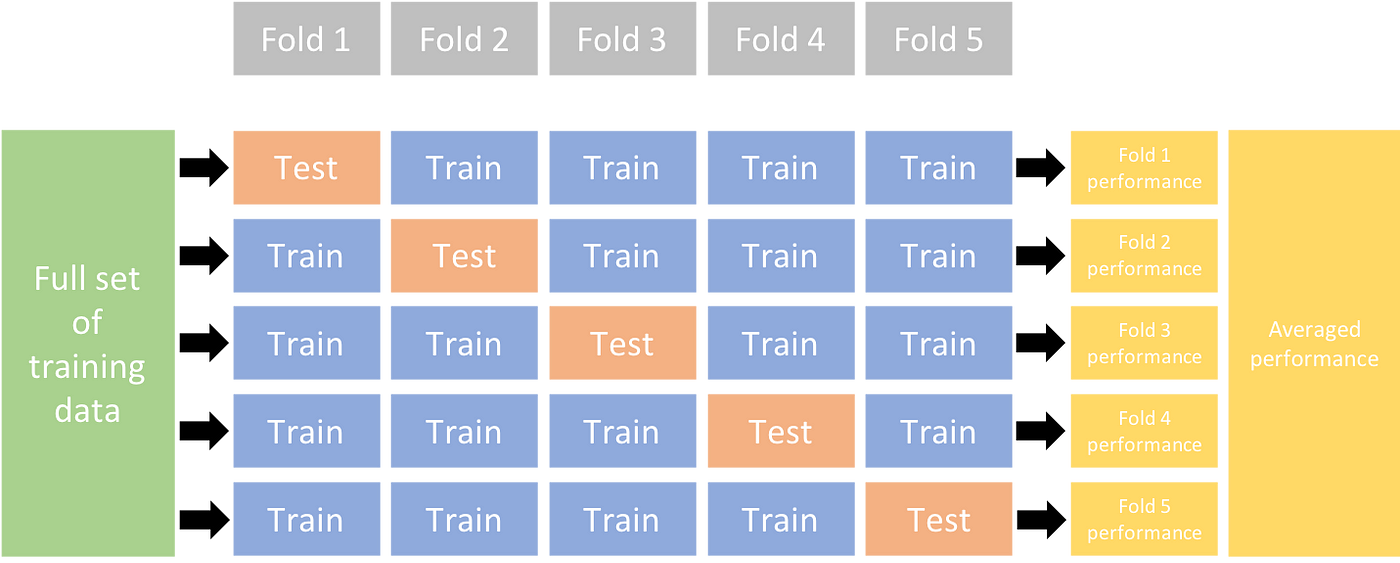

K折交叉验证是一种广泛应用于机器学习和数据分析中的验证技术。其基本原理是将数据集随机划分为K个大小相等的子集(折),依次将每个子集作为验证集,其余K-1个子集作为训练集,对模型进行训练和评估。

通过多次迭代,K折交叉验证可以有效减少过拟合,提高模型的泛化能力。此外,它还可以充分利用有限的数据,避免因数据划分不当而导致的偏差。

# 2. K折交叉验证在时间序列分析中的优势和局限

### 2.1 K折交叉验证的优势

#### 2.1.1 减少过拟合和提高泛化能力

过拟合是机器学习模型在训练数据集上表现良好,但在新数据上表现不佳的现象。K折交叉验证通过将数据集划分为多个子集,并使用不同的子集进行训练和评估,可以有效减少过拟合。

具体来说,在K折交叉验证中,数据集被划分为K个子集(称为折)。每个折被依次用作测试集,而其余K-1个折被用作训练集。通过这种方式,每个数据点都被用作测试集一次,从而提供了模型在不同数据子集上的平均性能估计。

#### 2.1.2 充分利用有限的数据

时间序列数据通常具有较小的样本量,这使得模型训练和评估变得具有挑战性。K折交叉验证通过重复使用数据,可以充分利用有限的数据,提高模型的泛化能力。

### 2.2 K折交叉验证的局限

#### 2.2.1 计算开销较大

K折交叉验证的计算开销较大,尤其是在数据集较大或模型训练时间较长的情况下。这是因为K折交叉验证需要多次训练和评估模型,这会增加计算时间。

#### 2.2.2 对数据分布敏感

K折交叉验证对数据分布敏感。如果数据分布不均匀,则不同的折可能会包含不同比例的类或特征,这可能会影响模型的性能评估。

**代码块:**

```python

import numpy as np

from sklearn.model_selection import KFold

# 划分数据集

kf = KFold(n_splits=5, shuffle=True, random_state=42)

for train_index, test_index in kf.split(X, y):

# 使用 train_index 和 test_index 划分数据集

X_train, X_test = X[train_index], X[test_index]

y_train, y_test = y[train_index], y[test_index]

# 训练和评估模型

model.fit(X_train, y_train)

score = model.score(X_t

```

0

0