HDFS文件读取缓存机制揭秘:2个缓存策略优化性能

发布时间: 2024-10-28 01:16:06 阅读量: 36 订阅数: 40

Scratch图形化编程语言入门与进阶指南

# 1. HDFS文件系统概述

在当今的大数据时代,分布式文件存储成为了处理海量数据的基础架构。Hadoop分布式文件系统(HDFS)作为其中的佼佼者,已经成为了许多大数据解决方案的核心组件。HDFS以其高容错性、高吞吐量和简单的API等特点,为存储和处理大规模数据集提供了强大的支持。

## 1.1 HDFS的架构原理

HDFS采用主/从(Master/Slave)架构,由一个NameNode(主节点)和多个DataNode(数据节点)组成。NameNode负责管理文件系统的元数据,如文件目录结构、文件属性等,而DataNode则负责实际的数据存储。这种设计使得HDFS能够在廉价的硬件上运行,并通过数据的副本机制保证了数据的高可用性。

## 1.2 HDFS的应用场景

HDFS被广泛应用于批处理领域,尤其是适合于那些对数据读取性能要求不是很高,但是需要处理大量数据的场景。例如,HDFS在日志分析、数据仓库以及机器学习等领域中,作为底层的数据存储平台发挥着重要作用。

通过了解HDFS的基本概念和架构,我们可以为深入学习其缓存机制打下坚实的基础。接下来,我们将逐步探索HDFS的缓存机制,了解它是如何优化数据访问的。

# 2. HDFS的缓存机制基础

## 2.1 HDFS文件读取流程解析

### 2.1.1 HDFS的基本架构和组件

Hadoop Distributed File System(HDFS)是Hadoop项目的核心组件之一,专为存储大量数据而设计,它具有高容错性,适用于运行在通用硬件上的分布式系统。HDFS基于主/从架构,其中包含两类主要的节点:NameNode和DataNode。

- **NameNode**:负责管理文件系统的命名空间,记录文件中各个块所在的DataNode节点信息,并通过心跳机制和DataNode保持通信,以监控文件系统健康状态。它并不存储数据本身,但拥有元数据信息,比如文件系统的目录结构、文件属性以及每个文件的块列表等。

- **DataNode**:在集群中的每个节点上运行,负责存储实际的数据块。DataNode会周期性地向NameNode发送心跳信号,报告自己的状态,同时响应来自NameNode的数据块操作请求。

HDFS将大文件分割成固定大小的数据块(block),通常为128MB,每个数据块由多个副本在集群中的DataNode节点上分布式存储,以便于提高系统的可靠性和容错性。

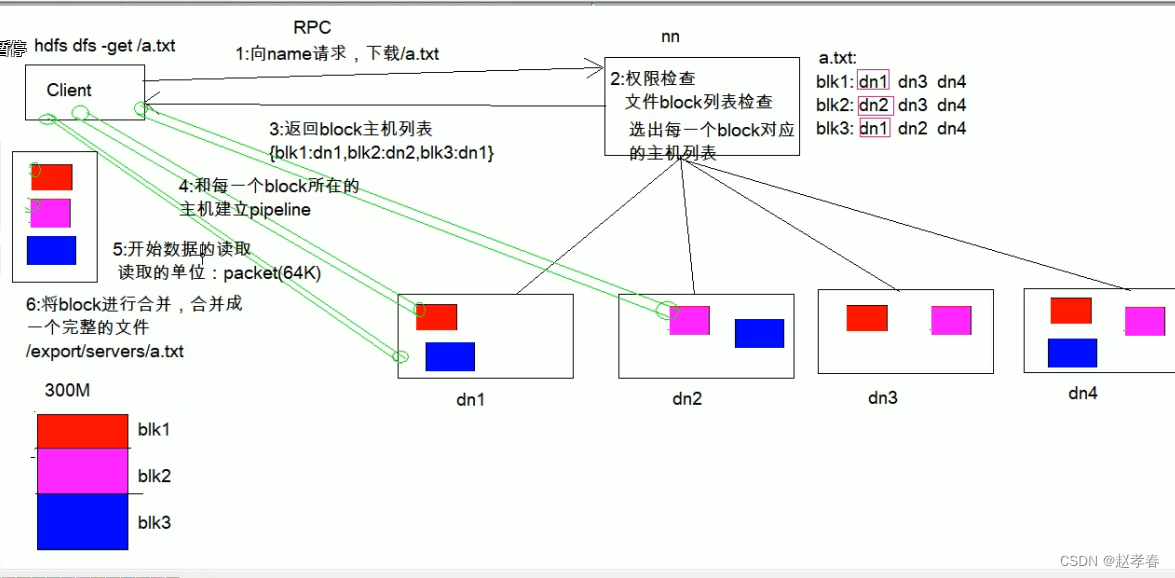

### 2.1.2 数据读取的节点和流程

在HDFS中,客户端读取数据时,它首先会通过NameNode确定数据块所在的具体DataNode。然后,客户端直接与存储数据块的DataNode进行通信,以获取所需的数据。

1. **用户发起读取请求**:客户端通过文件路径发起读取请求。

2. **定位数据块位置**:NameNode根据文件路径和元数据找到文件对应的各个数据块及其副本所在的DataNode列表。

3. **数据传输**:客户端根据列表中的DataNode地址,选择最近的节点读取数据块。这个选择通常是基于网络拓扑结构,优先选择位于同一数据中心,网络延迟较低的节点。

4. **数据读取和验证**:客户端读取数据块的同时,会通过校验和(checksum)对数据进行校验,确保数据的完整性。

5. **数据合并**:多个数据块顺序读取完毕后,客户端对它们进行合并,还原成完整的文件流输出。

## 2.2 HDFS缓存机制的原理

### 2.2.1 缓存与数据本地化的概念

HDFS的缓存机制是指将访问频率高的数据块临时从磁盘复制到内存中,以实现快速读取。这种机制的目的是优化对热数据的访问性能。

- **数据本地化**:HDFS中的数据本地化有两层含义。第一层是指数据尽量存储在离用户计算进程近的地方,减少数据传输距离,减少网络I/O的压力;第二层是指数据尽可能地存储在它被请求的节点上。数据本地化的好处在于减少了网络传输的时间,提高数据读写效率。

### 2.2.2 缓存如何提升读取性能

缓存是提升文件系统性能的关键技术之一。在HDFS中,缓存机制的应用主要表现在以下几点:

- **减少磁盘I/O操作**:将热点数据块加载到内存中,可以有效减少对磁盘的I/O操作,降低延迟。

- **提升读取速度**:内存的读取速度远远高于磁盘,缓存热点数据块可以显著加快数据的读取速度。

- **均衡负载**:通过缓存可以将数据尽量均衡地分布在各个节点上,避免某一节点成为瓶颈。

在实际操作中,通过命令行工具 `hadoop cacheadmin` 可以将数据设置为缓存,并利用HDFS提供的监控工具观察缓存效果。缓存数据的替换策略一般是基于LRU(Least Recently Used)算法,即当缓存空间不足时,会优先淘汰长时间未被访问的数据块。

### 2.2.3 缓存机制的实现原理

HDFS缓存机制的实现依赖于几个关键组件,包括:

- **CacheManager**:管理HDFS的缓存空间,负责缓存数据块的加载、清除等操作。

- **BlockPlacementPolicy**:定义了数据块的缓存策略,例如,优先缓存在请求节点或选择负载较低的节点。

- **CacheDirective**:定义了哪些文件或文件块需要被缓存,包括缓存的超时时间、优先级等。

缓存机制的流程可以概括为:

1. **缓存指令提交**:用户通过 `hadoop cacheadmin` 命令提交缓存指令,指示HDFS系统哪些文件或文件块需要被缓存。

2. **文件块加载**:根据缓存指令,CacheManager将指定的文件块从磁盘加载到DataNode的内存中。

3. **数据访问**:当数据被访问时,由于数据已被缓存,客户端可以直接从内存中读取,而无需经过磁盘I/O。

4. **缓存维护**:CacheManager根据策略定期检查缓存的数据块,清除不再需要的缓存数据,确保缓存空间有效利用。

通过这样的流程,HDFS缓存机制可以有效提高热数据访问速度,提升整体文件系统的性能表现。

### 2.2.4 缓存与数据本地化的关系

HDFS的缓存机制与数据本地化密切相关,缓存机制的引入能够进一步优化数据本地化策略。

- **缓存与本地读取**:当缓存的数据块被命中时,即使数据原本不在本地节点,读取操作也能够在本地节点完成,极大地减少了数据传输的开销。

- **缓存与数据放置策略**:缓存机制可以配合数据放置策略,将数据块尽可能放置在可能会读取该数据的节点上,提升数据访问效率。

由此可见,缓存机制是数据本地化策略的一个重要补充。通过缓存机制,HDFS可以更高效地满足业务场景中对热数据的高频率访问需求,进一步提高数据访问的吞吐量和响应速度。

## 总结

本章节中,我们详细探讨了HDFS的缓存机制基础。首先,了解了HDFS的基本架构和组件,这为理解缓存机制打下了基础。接着,深入解析了数据读取流程,包括请求如何被处理,数据如何被定位并最终传输给客户端。进一步地,我们分析了缓存机制的原理,包括缓存与数据本地化的概念,以及缓存如何显著提升数据读取性能。通过对缓存策略的实现原理进行解析,我们认识到,HDFS通过一系列组件和策略,使得数据能够在内存中被快速访问,进一步优化了数据的访问效率。这些讨论为我们深入理解HDFS缓存机制提供了坚实的基础,并为下一章节的缓存策略详解奠定了基础。

# 3. HDFS缓存策略详解

Hadoop Distributed File System (HDFS) 的缓存策略是确保数据处理速度和效率的关键组成部分。理解并掌握缓存策略是优化HDFS性能的重要步骤。

## 3.1 基础缓存策略

### 3.1.1

0

0