HDFS文件读取监控与报警:实时性能分析与故障预防

发布时间: 2024-10-28 01:55:53 阅读量: 38 订阅数: 28

# 1. HDFS文件系统概述与监控必要性

## 1.1 HDFS的定义和应用范围

HDFS(Hadoop Distributed File System)是一个高度容错性的系统,适合在廉价硬件上运行。它提供了高吞吐量的数据访问,非常适合大规模数据集的应用。HDFS广泛应用于互联网搜索引擎的后台存储系统中,并逐渐成为大数据分析的关键基础组件。

## 1.2 HDFS监控的必要性

随着数据量的不断增加,对于存储系统的实时监控变得越来越重要。HDFS监控不仅能够帮助系统管理员了解系统运行状态,还能够及时发现并解决潜在问题。通过监控性能指标,优化集群性能,提升数据处理速度,并保证数据的高可用性和容错性。

## 1.3 监控数据的价值

监控数据不仅可以用于故障诊断,还能帮助我们理解系统行为,评估系统性能,以及指导未来的系统优化和扩展。通过分析历史监控数据,可以为系统配置和资源分配提供科学依据,从而实现系统的自适应调整和优化。

# 2. HDFS性能监控的基础理论

### 2.1 HDFS架构原理

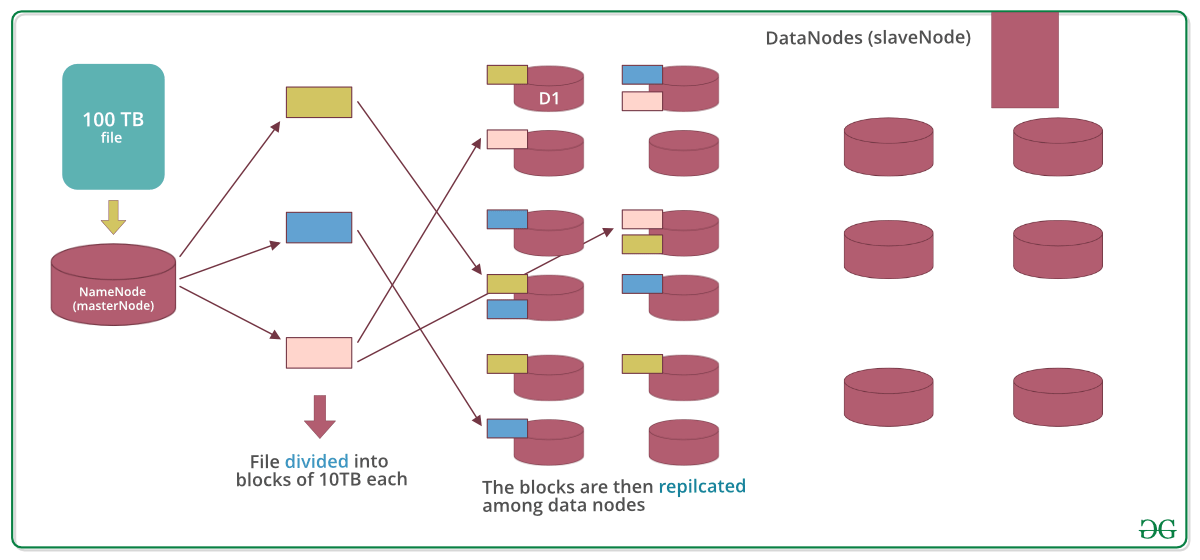

HDFS(Hadoop Distributed File System)是Hadoop项目的子项目,主要用于存储大容量数据。HDFS的设计目标是支持在廉价的硬件上运行并提供高吞吐量的数据访问。HDFS的核心由两部分构成:NameNode和DataNode。

#### 2.1.1 NameNode和DataNode的角色

- **NameNode**: 这是HDFS集群的主节点,负责维护文件系统树及整个文件系统的元数据。元数据中记录了文件和目录的信息,如文件名、权限、文件属性以及每个文件的数据块的位置等。NameNode不存储实际的数据,仅存储这些元数据。

- **DataNode**: 这些是工作节点,负责存储实际的数据。每个DataNode负责存储数据块(block),并通过网络连接到其他DataNode和NameNode。在客户端进行数据读写操作时,NameNode会告诉客户端具体哪个DataNode上有数据块。

HDFS通过这样的分布式设计,实现了高可靠性。即便个别DataNode出现故障,也不会影响到整个系统的运行。

#### 2.1.2 HDFS的读写流程

在HDFS中进行数据读写时的流程也分别有其特点:

- **读取过程**:首先,客户端向NameNode请求获取数据文件的元数据。接着,NameNode提供文件的块位置信息给客户端。然后,客户端直接从各个DataNode读取数据块。

- **写入过程**:在数据写入时,客户端先向NameNode申请一个新的文件。NameNode在确认文件不存在后,会分配一些DataNode作为该文件的数据块存储位置。之后,客户端会将数据分成多个块并分发到指定的DataNode上进行存储。

### 2.2 监控指标的选择与意义

HDFS监控是确保分布式存储环境稳定运行的关键。监控指标的选择非常关键,它们能帮助系统管理员了解系统的状态并及时发现潜在问题。

#### 2.2.1 关键性能指标(KPI)

关键性能指标(Key Performance Indicators)是评估HDFS性能的重要工具。它们通常包括:

- **吞吐量**:表示数据写入和读取的速度,通常以每秒操作数(OPS)来衡量。

- **延迟**:从发起请求到数据完全读取或写入的等待时间。

- **集群利用率**:存储空间和处理能力的使用情况。

#### 2.2.2 监控指标与系统性能关系

监控指标与系统性能之间存在着紧密的关系。正确选择和跟踪这些指标可以帮助我们:

- 预测系统的扩展能力,从而合理规划硬件资源。

- 识别性能瓶颈,例如,高延迟可能意味着网络或I/O带宽的瓶颈。

- 为运维决策提供数据支持,如数据再平衡和硬件升级。

### 2.3 实时监控工具介绍

为了有效地监控HDFS的性能,我们需要使用一些实时监控工具。这些工具能够实时收集和展示性能指标,帮助管理员作出快速响应。

#### 2.3.1 Ambari与Cloudera Manager

Ambari和Cloudera Manager都是管理Hadoop集群的工具,它们提供了用户友好的界面来进行监控和管理:

- **Ambari**:提供了集群安装、监控、预警和维护等全方位的服务。它通过收集集群数据并展示在仪表盘上,使得对集群状态的了解变得容易。

- **Cloudera Manager**:是Cloudera发行版中的监控工具,它具有比Ambari更加丰富的功能,包括自动化故障转移、备份恢复、以及更详细的性能分析等。

#### 2.3.2 自定义监控解决方案

对于特定的业务需求或高级用户,可能需要定制监控解决方案。这些解决方案通常包含在企业级监控软件中,它们可以通过插件或API集成到Hadoop生态系统中。自定义监控解决方案的优势在于能够更贴近业务逻辑,提供更精准的监控指标。

在自定义监控解决方案中,用户可以编写脚本来收集特定的指标,并使用通知系统将异常情况传递给相关人员。这样,企业可以根据其独特的业务需求和环境,实现更加灵活和深入的监控。

通过综合上述监控工具的介绍,我们可以了解HDFS性能监控的重要性、关键指标以及实现方法。在接下来的章节中,我们将具体探讨HDFS文件读取的监控实践以及性能分析和故障预防策略,进一步深入理解如何有效地监控和优化HDFS性能。

# 3. HDFS文件读取监控实践

## 3.1 监控脚本的编写与执行

### 3.1.1 选择合适的编程语言和框架

在监控脚本的编写与执行过程中,选择合适的编程语言和框架是至关重要的。对于HDFS文件系统而言,Python语言由于其丰富的库支持、简洁的语法和强大的数据处理能力,成为开发监控脚本的首选。Python的标准库中包含了多个模块,如`os`, `subprocess`, `threading`, `time`等,这些模块能够轻松地与HDFS进行交互,并实现多线程监控。

除此之外,像Ansible、Puppet和Chef这类配置管理工具,也可以在监控HDFS系统中发挥作用。这些工具支持自动化部署和配置,可以在节点上安装和配置监控软件,并管理监控系统的日志。

### 3.1.2 实现监控逻辑

下面给出一个简单的Python脚本示例,用于检查HDFS文件系统的健康状况,并报告NameNode和DataNode的状态:

```python

import subprocess

import json

# 执行HDFS命令获取状态

hdfs_status = subprocess.check_output(['hdfs', 'dfsadmin', '-report'])

# 将命令输出转换为JSON格式

try:

report_json = json.loads(hdfs_status.decode('utf-8').split('\n', 1)[1])

except ValueError as e:

print("Failed to parse HDFS report:", e)

exit(1)

# 解析JSON数据并提取监控信息

if 'Live Nodes' in report_json:

live_nodes = report_json['Live Nodes']

# 其他解析逻辑...

print(f"HDFS is healthy with {live_nodes} live nodes.")

else:

print("Unable

```

0

0