【MapReduce编程高手】:Reduce阶段的高级功能与编程模式

1. MapReduce编程模型概述

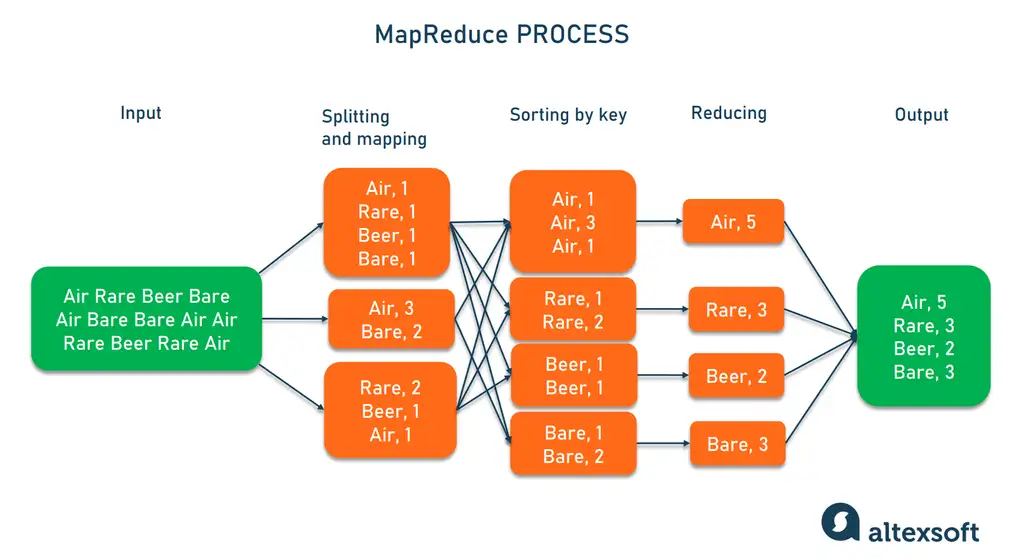

MapReduce是一种分布式计算框架,旨在处理大量数据的并行运算。该模型将复杂的并行计算过程抽象为两个阶段:Map(映射)阶段和Reduce(规约)阶段。

Map阶段主要负责数据的过滤、排序和组合,它读取输入数据并生成一系列中间键值对。Reduce阶段则对这些中间结果进行汇总和合并,得到最终的计算结果。

MapReduce模型的编程简单易懂,它通过一系列的API调用,使得开发者可以不必关注底层的分布式计算细节,专注于业务逻辑的实现。这一模型非常适合需要处理大量数据的场景,如日志分析、数据统计和搜索引擎索引等。

2. 深入理解Reduce阶段的功能

2.1 Reduce阶段的原理与机制

2.1.1 Reduce任务的执行流程

Reduce任务在MapReduce框架中扮演着整合和输出最终结果的角色。一个典型的Reduce任务包含如下步骤:

- 分区(Partitioning):Map阶段的输出会被分区器划分为若干个分片,每个分片将被一个Reduce任务处理。

- 排序(Sorting):每个分片内的数据根据key进行排序,确保相同key的数据被连续处理。

- Shuffle:将排序后的数据从Map节点传输到Reduce节点。

- 合并(Merging):在Reduce节点,Shuffle过来的数据可能会合并,以便于高效处理。

- Reduce函数:对合并后的数据执行用户定义的Reduce函数,以生成最终输出。

在Shuffle过程中,每个Reduce任务会从所有Map任务中拉取其负责处理的数据分片。数据分片在传输前会经历序列化和网络传输,之后在Reduce任务中被反序列化。为了提高处理效率,系统会对拉取到的数据进行合并和归并排序,保证相同key的数据可以连续处理。

2.1.2 数据分区与排序过程

Map任务完成后,数据需要根据key被分配到不同的分区中,以便于后续的Reduce任务进行处理。这个过程称为数据分区。数据分区主要依据key的哈希值来决定数据应该去哪个分区。

排序是在数据到达Reduce任务之后立即执行的。由于数据在Map阶段已经被排序,Shuffle过程保证了相同key的数据连续传输,所以Reduce任务只需要对不同key的数据进行二次排序,以便于进行后续的归并操作。

在MapReduce中,排序分为两个阶段:

- Map端排序:在Map任务输出数据之前,会首先对数据进行局部排序。

- Reduce端归并排序:在Reduce任务开始处理数据前,先从各个Map任务拉取排序后的数据,然后将这些数据进行归并排序,最终形成一个全局有序的数据集。

为了提高排序效率,MapReduce采用的是外部排序策略,即利用磁盘来辅助排序过程,以处理超过内存限制的大量数据。

2.2 Reduce阶段的关键操作

2.2.1 Shuffle过程详解

Shuffle是MapReduce中最为关键和复杂的过程之一,它包括了数据的传输、分区、排序和归并等多个步骤。Shuffle过程的详细步骤可以概括为:

- 数据分区:根据分区策略将Map输出的数据分到不同的Reduce任务。

- 数据传输:Map输出的数据会被序列化后传输到相应的Reduce任务节点。

- 数据缓冲与排序:在Reduce节点,拉取到的数据首先被写入到内存缓冲区,当达到阈值后,会被溢写到磁盘,并进行排序。

- 归并排序:所有Map输出的数据到达后,Reduce节点对这些数据进行归并排序,形成有序的数据集供Reduce函数处理。

Shuffle过程对性能的影响非常大,因为它是整个MapReduce作业中网络传输和磁盘I/O最密集的阶段。因此,优化Shuffle过程对提高MapReduce作业的性能至关重要。

2.2.2 Reduce函数的作用域与局限

Reduce函数是MapReduce中处理数据的核心,它定义了如何将Map阶段的中间输出转换为最终结果。Reduce函数的作用域通常受限于它接收到的key-value列表的范围。

在实际应用中,Reduce函数处理的数据来自同一个key的所有value集合。这限制了Reduce函数的能力,因为其不能执行跨key的数据聚合。此外,Reduce函数的设计必须考虑到数据量的规模,以避免在内存中堆积过多数据而引发内存溢出错误。

由于Reduce函数的这些局限性,开发者需要通过优化Shuffle和合理设计Reduce逻辑来确保作业的高效执行和正确性。

2.3 Reduce阶段优化策略

2.3.1 内存管理与性能优化

在MapReduce作业中,内存管理是影响性能和稳定性的重要因素。合理利用内存资源可以显著提升Reduce任务的处理速度。优化内存管理的一些方法包括:

- 调整缓冲区大小:通过

mapreduce.reduce.shuffle.input.buffer.percent和mapreduce.reduce.shuffle.memory.limit百分比参数调整内存缓冲区的大小。 - 使用Combiner:Combiner函数可以在Map阶段后对数据进行局部归并,减少网络传输的数据量。

- 优化Java堆设置:合理分配

-Xmx和-Xms参数,调整JVM堆内存大小,减少频繁的垃圾回收。

通过这些内存优化策略,可以有效减少Reduce任务的执行时间,提高作业的执行效率。

2.3.2 Reduce任务并发度调整

在MapReduce作业中,Reduce任务的数量(即并发度)对作业性能有直接影响。调整Reduce任务的并发度需要根据作业特性和集群资源进行权衡:

- 增加并发度:通过增加Reduce任务的数量,可以使得数据处理更加并行化,缩短作业总体时间。但并发度太高可能导致资源竞争加剧,影响性能。

- 减少并发度:降低Reduce任务的数量可以减少管理开销,避免资源竞争。但并发度太低会导致数据处理不够并行化,增加作业完成时间。

使用mapreduce.job.reduces参数可以设置Reduce任务的并发度。此外,调整Map任务的并发度也可以间接影响到Reduce阶段的性能。

在实际生产环境中,优化Reduce阶段的并发度需要综合考虑数据量、集群配置和作业特性。通过监控作业执行过程中的资源利用率,调整并发度参数可以使得作业运行在最佳状态。

3. Reduce阶段的高级功能

在Hadoop生态系统中,MapReduce编程模型作为数据处理的核心,其Reduce阶段扮演着至关重要的角色。本章将深入探讨Reduce阶段的高级功能,不仅介绍自定义分区器和排序器的实现与应用,还将介绍如何优化副本合并和输出格式,以适应更复杂的数据处理场景。

3.1 自定义分区器的实现与应用

3.1.1 分区器的作用与分类

在MapReduce中,分区器负责将Map任务的输出按键值合理地分配给不同的Reduce任务。默认情况下,Hadoop使用HashPartitioner来处理数据分区。然而,当面对非均匀分布的数据时,我们可以实现自定义分区器来优化数据的分配,从而提高处理效率。

分区器的分类主要包括:

- 默认分区器:按照键的哈希值进行分区。

- 范围分区器:将键的范围映射到特定的Reducer。

- 自定义分区器:根据特定的逻辑将数据分配给Reducer。

3.1.2 自定义分区器的设计与实践

实现一个自定义分区器,你需要继承org.apache.hadoop.mapreduce.Partitioner类,并重写getPartition方法。下面是一个简单的自定义分区器示例代码:

- import org.apache.hadoop.io.Text;

- import org.apache.hadoop.mapreduce.Partitioner;

- public class CustomPartitioner extends Partitioner<Text, Text> {

- @Override

- public int getPartition(Text key, Text value, int numPartitions) {

- // 假设key是用户ID,我们将其哈希值与Reducer数量取模,以确定分区

- return (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

- }

- }

自定义分区器的设计应该考虑数据分布的均匀性和计算负载的平衡性。在实践中,我们应通过测试和监控来验证分区器的效果。

3.2 自定义排序与GroupingComparator

3.2.1 自定义排序的原理与优势

MapReduc