【深度学习框架深度解析】:专家揭秘Python框架的五大选择标准

发布时间: 2024-08-31 08:15:39 阅读量: 656 订阅数: 79

# 1. 深度学习框架概述

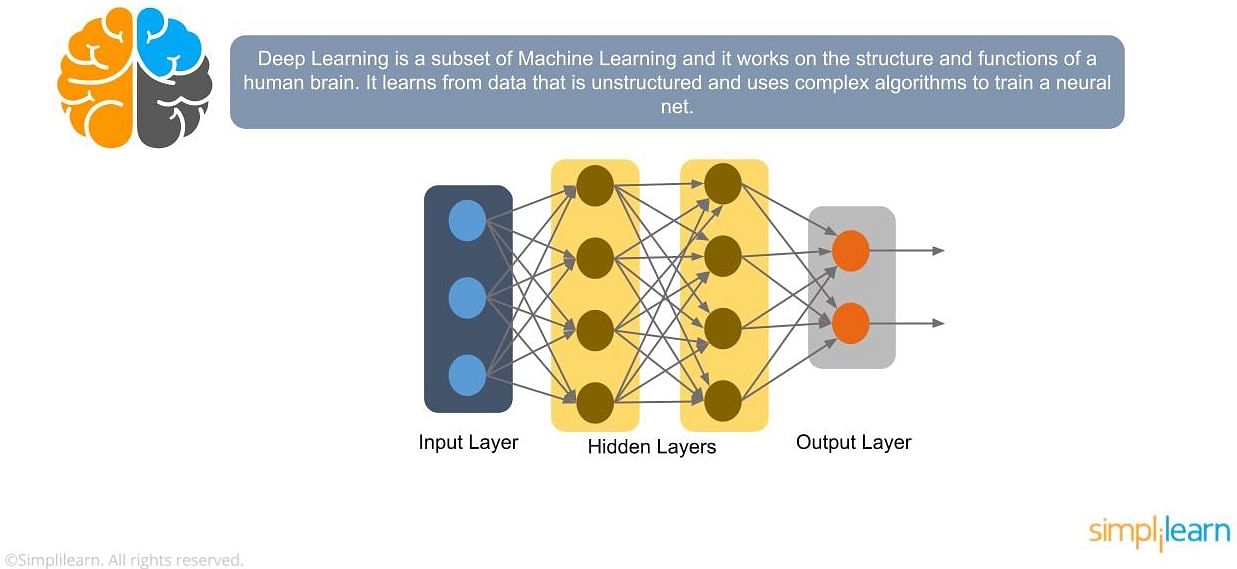

## 1.1 框架的定义与重要性

深度学习框架是为了解决复杂的神经网络编程问题而设计的高级API,它们简化了深度学习模型的开发流程。从初步的研究到生产环境的部署,深度学习框架提供了高效的工具集,加速了从数据准备、模型设计到训练、优化和推理的全流程。框架的重要性在于它极大地降低了学习和实践深度学习的门槛,使得更多的研究人员、工程师和爱好者可以将时间和精力集中在模型创新和应用探索上,而不是底层的数学和计算细节。

## 1.2 常见深度学习框架

目前市面上主流的深度学习框架包括TensorFlow、PyTorch、Keras等。TensorFlow由Google开发,提供了强大的计算图功能和可扩展性;PyTorch由Facebook推出,以动态计算图和易用性著称;而Keras则更关注快速实验和易上手性,经常被当作高层API与其他后端框架共同使用。每个框架都有其特定的应用场景和优势,选择合适的框架对于项目的成功至关重要。

## 1.3 框架在深度学习中的角色

深度学习框架作为连接算法研究与实际应用的桥梁,扮演着至关重要的角色。它不仅为研究者提供了实现和测试新算法的平台,还为开发者提供了构建商业级应用的工具。框架的优化、易用性和跨平台能力直接影响到模型的训练速度、部署便捷性和运行效率,从而对最终的产品质量、开发周期和成本产生重大影响。了解和掌握这些框架的特性,对于AI技术的推广和应用至关重要。

# 2. 深度学习框架选择标准

## 2.1 性能与效率

### 2.1.1 框架性能基准测试

深度学习框架的性能是选择时的一个重要考量因素,它直接关联到模型训练和推理的速度。基准测试是评估框架性能的一种有效方法,通过对不同框架执行一系列标准化任务,可以得到关于性能的直接和量化的数据。

常见的性能基准测试包括:模型训练时间、推理时间、吞吐量等。其中,模型训练时间关注的是在特定硬件上训练特定模型需要的时间;推理时间指的是模型对单个数据样本做出预测所需的时间;吞吐量则是指单位时间内能够处理的数据量。

为了公平比较不同框架的性能,基准测试通常需要在一个标准的测试平台上执行,该平台应该具有标准化的硬件配置,并且安装有相同版本的操作系统和依赖库。使用基准测试框架如DeepBench可以提供针对不同深度学习操作(如卷积、矩阵乘法等)的性能数据。

### 2.1.2 资源优化与内存管理

深度学习模型通常需要大量的计算资源和内存,因此资源优化和内存管理是提升框架效率的重要方面。资源优化涉及到硬件资源(如CPU、GPU)的合理分配和使用,以及计算任务的并行化和分布式计算。

内存管理通常包括内存分配策略、内存复用和内存泄漏检测等。一些先进的深度学习框架采用了动态内存分配机制,能够根据模型的需要动态地分配和回收内存资源,从而有效减少内存浪费和提高内存使用效率。

## 2.2 易用性与学习曲线

### 2.2.1 API设计与文档支持

深度学习框架的易用性对于快速开发和部署模型至关重要。API设计的直观性、一致性和文档支持是评估框架易用性的关键指标。

优秀的API设计应该让用户能够轻松理解和实现常见的操作。例如,很多框架都遵循类似于NumPy的数组操作习惯,这减少了用户学习新框架的成本。文档支持需要详尽且易于理解,包括但不限于API参考、教程、示例代码和常见问题解答。此外,良好的交互式文档(例如Jupyter Notebook集成)可以提供即时的反馈和实验环境,进一步降低学习曲线。

### 2.2.2 社区支持和资源丰富度

深度学习社区的支持同样重要,一个活跃的社区可以提供丰富的学习资源、问题解答和改进意见。社区成员可能包括框架的开发者、研究者以及普通用户,他们共同构成了框架的支持网络。资源丰富度可以体现在论坛、问答网站(如Stack Overflow)、博客文章、课程和图书等多个方面。社区的活跃度可以从问答的更新频率、社区成员的贡献以及各种线上线下活动的举办情况中窥见一斑。

## 2.3 社区活跃度与生态

### 2.3.1 开源社区的贡献和更新速度

开源社区的贡献是衡量深度学习框架活跃度的重要指标。开源项目的贡献者数量、贡献频率和贡献质量直接反映了项目的活力和未来的可持续性。

更新速度也很重要,它代表了框架能够多快地接纳新特性、修复bug和响应安全威胁。通常,开源项目会有一个定期发布的更新日程表,以及一个维护者或者核心团队来管理这些更新。

### 2.3.2 生态系统中的工具和库

深度学习框架的生态系统包含了大量的工具和库,这些工具和库可以与主框架协同工作,形成一个强大的生态系统。这些工具和库可以是数据预处理工具、模型可视化工具、模型转换工具、特定硬件加速库等。

例如,TensorFlow拥有TensorBoard用于可视化模型和监控训练过程,Keras提供了一个高级API简化了模型的构建和训练。一个健全且活跃的生态系统可以大大提升开发效率和产品的质量。

## 2.4 部署与跨平台能力

### 2.4.1 模型部署的简易性

部署是将训练好的模型部署到生产环境的过程,模型部署的简易性是影响框架选择的重要因素。一个易于部署的框架通常具备以下特点:支持多种硬件平台(CPU、GPU、FPGA等)、拥有清晰的部署指南和API、支持模型转换到不同格式、具有高效的模型压缩和优化技术。

此外,易于集成到现有的应用程序和系统中也是重要的,比如支持RESTful API或gRPC等服务化接口,使得模型可以作为一个服务被调用。

### 2.4.2 跨平台兼容性分析

跨平台兼容性指的是框架能在不同操作系统和硬件平台上运行的能力。一个具有良好跨平台兼容性的框架可以减少开发者的重复工作,使得开发者能够专注于模型本身,而不是平台特定的问题。

跨平台兼容性分析可以基于框架的API一致性、支持的操作系统和硬件类型、以及社区提供的针对特定平台的部署案例进行。

## 2.5 扩展性与未来发展

### 2.5.1 自定义层和插件机制

深度学习框架的扩展性允许开发者根据自己的需求增加新的功能。框架通过自定义层和插件机制来支持这种扩展性。自定义层允许开发者实现新的神经网络层或者功能模块,而插件机制则允许框架接纳第三方库和工具。

为了实现这些扩展,框架需要提供清晰的接口和文档,并确保这些扩展能够在不同的环境和硬件上正常工作。TensorFlow的Keras API和PyTorch的nn.Module都提供了很好的自定义层实现方式。

### 2.5.2 框架的持续发展与维护

框架的持续发展与维护是确保长期项目成功的关键。一个活跃的维护团队可以保证框架的稳定性和安全性,同时提供新特性的实现和旧问题的修复。

框架维护的稳定性可以从发布频率和发布时间表、维护者对用户反馈的响应、以及社区对关键问题的解决能力等方面进行评估。一个有前景的框架会有一个清晰的未来发展规划,包括版本更新计划、新特性的预览以及长期的路线图。

为了使读者对深度学习框架选择标准有一个直观的认识,下面是一个简化的示例表格,总结了一些主流框架的相关特性。

| 特性 | TensorFlow | PyTorch | Keras | MXNet |

| --- | --- | --- | --- | --- |

| 性能基准 | 高 | 高 | 中 | 高 |

| 易用性 | 中 | 高 | 高 | 中 |

| 社区活跃度 | 高 | 高 | 中 | 高 |

| 跨平台能力 | 高 | 中 | 中 | 高 |

| 扩展性 | 高 | 高 | 中 | 高 |

| 维护团队 | 大型团队 | 中小型团队 | 社区 | 中小型团队 |

通过上述分析,可以得出结论:选择深度学习框架时,需要综合考虑性能、易用性、社区支持、跨平台能力、扩展性及维护等因素。开发者应根据具体需求和项目目标来选择最合适的框架。

在接下来的章节中,我们将进一步探讨深度学习框架的实践应用,包括安装与配置、数据处理、模型训练、部署与优化等操作性内容。

# 3. 深度学习框架实践应用

实践是检验真理的唯一标准,对于深度学习框架而言,能否在实际应用中发挥高效能,直接影响着深度学习项目的成败。本章节我们将深入探讨深度学习框架在实际应用中的一些关键实践,从安装与配置环境开始,到数据处理与模型训练,再到模型部署与优化,让读者通过具体的步骤和方法,体验深度学习框架的强大功能。

## 3.1 框架安装与环境配置

安装深度学习框架是进行深度学习研究和开发的第一步。不同的深度学习框架有不同的安装方法,而合理的环境配置则是保证模型训练和部署顺利进行的关键。本小节将详细讲解在不同平台如何安装深度学习框架,以及在环境配置中需要注意的最佳实践。

### 3.1.1 不同平台的安装方法

根据目标平台的不同,深度学习框架的安装方法也会有所差异。以TensorFlow和PyTorch为例,我们可以看到其安装方法在不同的操作系统上的区别。

#### 在Ubuntu系统中安装TensorFlow

Ubuntu是深度学习开发者常用的操作系统之一。安装TensorFlow通常可以通过以下步骤完成:

```bash

# 安装依赖

sudo apt-get install python3-pip python-dev libatlas-base-dev

# 安装TensorFlow

pip install --upgrade tensorflow

```

#### 在Windows系统中安装PyTorch

Windows用户可以使用以下方式通过`conda`命令安装PyTorch:

```bash

# 安装Anaconda或Miniconda(如果尚未安装)

# 创建新的conda环境

conda create --name pytorch python=3.7

# 激活conda环境

conda activate pytorch

# 安装PyTorch

conda install pytorch torchvision torchaudio cpuonly -c pytorch

```

#### 在MacOS中安装深度学习框架

在MacOS上安装PyTorch或TensorFlow,首先需要安装Homebrew,然后使用`pip`或`conda`安装所需的包。

```bash

# 安装Homebrew(如果尚未安装)

/bin/bash -c "$(curl -fsSL ***"

# 使用pip安装TensorFlow或PyTorch(取决于你的选择)

pip install tensorflow

```

### 3.1.2 环境配置的最佳实践

在安装框架后,对开发环境进行配置是保证训练效率和模型性能的重要步骤。以下是环境配置的一些最佳实践:

- **版本控制**:始终使用最新稳定版本的框架和依赖库。

- **硬件加速**:使用GPU进行训练时,确保安装了正确的NVIDIA驱动和CUDA版本。

- **环境隔离**:使用虚拟环境如conda或virtualenv来管理不同项目的依赖,避免版本冲突。

- **依赖管理**:通过`requirements.txt`或`environment.yml`文件管理依赖,便于团队协作。

- **系统优化**:针对深度学习计算特点,可能需要调整操作系统的资源分配设置,比如增加共享内存。

## 3.2 数据处理与模型训练

在深度学习项目中,数据处理和模型训练是核心环节。数据是模型训练的原料,数据的质量直接关系到模型训练效果的好坏。掌握高效的数据处理技巧和模型训练方法,对于实现高质量的模型至关重要。

### 3.2.1 数据加载与预处理技巧

数据加载和预处理是训练深度学习模型前必须完成的步骤。下面我们将介绍如何加载数据,并给出一些实用的数据预处理技巧。

#### 使用数据加载器

大多数深度学习框架提供了方便的数据加载器工具。例如,在PyTorch中,我们可以使用`DataLoader`来实现批量加载数据。

```python

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

transform = ***pose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

])

dataset = datasets.ImageFolder(root='data/', transform=transform)

data_loader = DataLoader(dataset, batch_size=32, shuffle=True)

```

#### 数据增强(Data Augmentation)

数据增强是一种提升模型泛化能力的技术。通过在训练时对输入数据进行各种变换,我们能够制造出更多的训练样本。

```python

from torchvision import transforms

data_transforms = {

'train': ***pose([

transforms.RandomResizedCrop(224),

transforms.RandomHorizontalFlip(),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

]),

'val': ***pose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

]),

}

```

### 3.2.2 模型训练和验证流程

深度学习模型训练是一个迭代过程,需要不断调整模型结构和超参数以获得最佳性能。以下是一个典型的模型训练和验证流程。

#### 定义训练函数

```python

import torch

def train_model(model, criterion, optimizer, scheduler, num_epochs=25):

for epoch in range(num_epochs):

# Each epoch has a training and validation phase

for phase in ['train', 'val']:

if phase == 'train':

model.train() # Set model to training mode

else:

model.eval() # Set model to evaluate mode

running_loss = 0.0

running_corrects = 0

# Iterate over data.

for inputs, labels in data_loader[phase]:

optimizer.zero_grad()

# Forward

outputs = model(inputs)

_, preds = torch.max(outputs, 1)

loss = criterion(outputs, labels)

# Backward + optimize only if in training phase

if phase == 'train':

loss.backward()

optimizer.step()

# Statistics

running_loss += loss.item() * inputs.size(0)

running_corrects += torch.sum(preds == labels.data)

if phase == 'train':

scheduler.step()

epoch_loss = running_loss / dataset_sizes[phase]

epoch_acc = running_corrects.double() / dataset_sizes[phase]

print(f'Epoch {epoch}/{num_epochs - 1} - {phase} Loss: {epoch_loss:.4f} Acc: {epoch_acc:.4f}')

print()

return model

```

#### 调用训练函数

```python

model_ft = train_model(model_ft, criterion, optimizer_ft, exp_lr_scheduler, num_epochs=25)

```

## 3.3 模型部署与优化

完成模型训练后,下一个挑战是将训练好的模型部署到实际应用中,使其能够在生产环境中发挥效果。部署的过程中,我们往往还需要对模型进行优化,确保其在特定的应用场景中具有良好的性能。

### 3.3.1 模型转换与部署工具

模型部署前,需要将训练得到的模型转换为适合不同平台和设备的格式。PyTorch、TensorFlow等框架都提供了一系列的工具和API来支持模型转换和部署。

#### 使用ONNX进行模型转换

ONNX(Open Neural Network Exchange)是一个开放的模型格式标准,它允许不同框架之间的模型转换。

```python

import torch

from torchvision.models import resnet50

# Load the trained model

model = resnet50(pretrained=True)

# Export the model

dummy_input = torch.randn(1, 3, 224, 224)

torch.onnx.export(model, dummy_input, "model.onnx")

```

#### 使用TensorRT进行模型优化

为了使模型在GPU上运行更快,我们可以使用TensorRT对模型进行优化。TensorRT是NVIDIA提供的深度学习推理加速器。

```python

from训 练好的模型加载进来进行优化

import tensorrt as trt

import pycuda.driver as cuda

import pycuda.autoinit

TRT_LOGGER = trt.Logger(trt.Logger.WARNING)

# Build an engine

builder = trt.Builder(TRT_LOGGER)

network = builder.create_network()

parser = trt.OnnxParser(network, TRT_LOGGER)

# Parse model file

with open("model.onnx", "rb") as model:

print("Beginning ONNX file parsing")

parser.parse(model.read())

print("Completed parsing of ONNX file")

# Build and return an engine

engine = builder.build_cuda_engine(network)

context = engine.create_execution_context()

```

### 3.3.2 模型优化与加速技术

在部署模型时,优化模型以提高性能是一项持续的挑战。以下是一些常用的模型优化和加速技术。

#### 使用量化技术

模型量化是一种有效的模型压缩技术,它可以减少模型的大小并加快计算速度,同时尽量保持模型的准确率。

```python

def quantize_model(model, dtype=torch.qint8):

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

torch.backends.quantized.engine = 'fbgemm'

model_prepared = torch.quantization.prepare(model, inplace=False)

model_int8 = torch.quantization.convert(model_prepared, inplace=False)

return model_int8

```

#### 使用剪枝技术

剪枝技术通过去除模型中不重要的参数来减少模型复杂度。这样不仅减小了模型的大小,还能降低运行时的资源消耗。

```python

def prune_model(model):

# 首先,使用特定策略识别需要剪枝的层

prunable_layers = [n for n, m in model.named_modules() if isinstance(m, torch.nn.Linear)]

# 应用剪枝策略

# 例如,我们可以使用L1范数来确定哪些权重应该被剪枝

prune.l1_unstructured(model, name='weight', amount=0.1)

# 最后,对剪枝后的模型进行微调,以恢复精度

# ...

```

### 3.3.3 模型部署应用示例

在模型经过优化后,如何将模型部署到实际应用中是一个重要话题。我们可以使用深度学习推理框架如TensorRT、ONNX Runtime等将训练好的模型转换为特定格式进行部署。以下是一个使用TensorRT进行模型部署的简单示例。

```python

# 该部分代码假设已经完成了模型的转换和优化,现在开始进行模型的部署。

# 首先,我们将模型加载到TensorRT引擎中

with engine.create_execution_context() as context:

# 输入数据准备

inputs = np.random.random_sample(size=(1, 3, 224, 224)).astype(np.float32)

d_input = cuda.mem_alloc(1 * inputs.nbytes)

cuda.memcpy_htod(d_input, inputs)

# 输出数据准备

d_output = cuda.mem_alloc(1 * out_size * 4)

bindings = [int(d_input), int(d_output)]

# 执行模型推理

stream = cuda.Stream()

context.execute_async_v2(bindings=bindings, stream_handle=stream.handle)

stream.synchronize()

# 将输出从GPU复制到CPU内存,并打印结果

output = np.empty(out_size, dtype=np.float32)

cuda.memcpy_dtoh(output, d_output)

print(output)

```

## 结语

以上便是第三章“深度学习框架实践应用”的全部内容。在本章中,我们系统地介绍了如何安装和配置深度学习框架、进行数据处理和模型训练,并在模型训练完成后,讲解了如何进行模型转换、优化和部署。通过本章的学习,读者应能够掌握在不同环境下使用深度学习框架解决实际问题的能力,为后续章节的内容打下坚实的基础。

# 4. 深度学习框架进阶应用

随着深度学习技术的不断进步,开发者对于深度学习框架的要求也越来越高。在实际应用中,掌握框架的高级功能是提升模型性能和效率的关键。本章将深入探讨深度学习框架在进阶应用中的核心要素,包括自定义操作与层、多框架对比分析以及深度学习的前沿技术。

## 4.1 自定义操作与层

### 4.1.1 实现自定义层和函数

在深度学习模型开发中,有时需要实现一些标准框架库中不存在的特定操作。这要求我们能够通过框架提供的接口自定义层(Layer)和函数(Function)。以TensorFlow为例,开发者可以通过继承tf.keras.layers.Layer类来创建自定义层。

```python

import tensorflow as tf

class CustomDenseLayer(tf.keras.layers.Layer):

def __init__(self, units=32):

super(CustomDenseLayer, self).__init__()

self.units = units

def build(self, input_shape):

self.kernel = self.add_weight(

name='kernel',

shape=[int(input_shape[-1]), self.units],

initializer='uniform',

trainable=True

)

super(CustomDenseLayer, self).build(input_shape)

def call(self, inputs):

return tf.matmul(inputs, self.kernel)

```

此代码段展示了如何定义一个具有权重的全连接层(Dense Layer)。首先,我们创建了一个新的层类CustomDenseLayer,该类继承自tf.keras.layers.Layer。在__init__方法中初始化了层的参数。build方法用于创建层的权重,并在第一次使用该层时被调用。最后,call方法定义了层的行为,即如何将输入数据转换为输出数据。

### 4.1.2 高级自定义操作的案例研究

在一些复杂的应用场景中,可能需要对现有框架的执行流程进行高级定制。例如,在一个自然语言处理任务中,可能需要实现一个自定义的注意力机制层,或者在图像识别任务中加入自定义的数据增强流程。这些自定义操作不仅提升了模型的性能,还可能帮助开发者更好地理解模型的工作原理。

以PyTorch为例,可以通过继承torch.nn.Module类实现自定义层:

```python

import torch

import torch.nn.functional as F

class CustomAttentionLayer(torch.nn.Module):

def __init__(self, input_dim):

super(CustomAttentionLayer, self).__init__()

self.linear_in = torch.nn.Linear(input_dim, input_dim)

self.linear_out = torch.nn.Linear(input_dim, 1)

def forward(self, inputs):

inputs = F.relu(self.linear_in(inputs))

attention_scores = F.softmax(self.linear_out(inputs), dim=1)

return attention_scores * inputs

```

在这个自定义注意力层中,我们首先定义了两个线性层,一个用于输入数据的转换(self.linear_in),另一个用于输出注意力分数(self.linear_out)。在forward方法中,我们使用了激活函数ReLU对输入数据进行转换,并计算了注意力分数,最后将注意力分数和输入数据相结合。

## 4.2 多框架对比分析

### 4.2.1 主流框架的特性对比

深度学习框架的多样性和专有特性使得选择合适的框架变得复杂。当前主流的深度学习框架包括TensorFlow、PyTorch、Keras等。TensorFlow以其强大的分布式计算能力和模型部署能力而闻名;PyTorch则因其易用性和动态计算图的优势而受到研究者的青睐;Keras作为高层神经网络API,可以运行在TensorFlow、Theano和CNTK之上,提供快速的原型设计。

以下表格展示了这些框架的主要特点:

| 特性 | TensorFlow | PyTorch | Keras |

|------|------------|---------|-------|

| 模型定义 | 基于图的静态计算(Eager Execution支持动态图) | 动态计算图 | 以API为主,支持多后端 |

| 社区支持 | 广泛的社区支持,工业应用广泛 | 研究社区支持强大 | 简单易用,上手较快 |

| 平台兼容 | 跨平台部署能力强,支持移动设备和Web端 | 相对较弱,但在逐渐增强 | 支持跨平台部署 |

| 并行能力 | 多GPU和TPU支持 | 多GPU支持,较新支持TPU | 可以使用后端框架的并行能力 |

### 4.2.2 框架选型的决策树

选择深度学习框架时,需要考虑多个因素,以下是一个框架选型决策树的简单描述:

1. 首先考虑模型部署环境,是否需要跨平台部署能力?

2. 其次考虑开发效率和易用性,是否需要快速原型设计?

3. 再次考虑社区和资源的支持,是否有足够的文档和社区资源?

4. 最后考虑性能和资源优化,是否需要在特定硬件上获得最佳性能?

通过这个决策树,可以有效地缩小选择范围,并最终找到适合项目需求的深度学习框架。

## 4.3 深度学习前沿技术

### 4.3.1 强化学习与生成对抗网络

强化学习和生成对抗网络(GANs)是深度学习领域中两个非常活跃的研究方向。强化学习关注如何基于环境交互来做出决策,其应用广泛,例如自动驾驶、机器人控制等。而GANs通过对抗训练,生成逼真的图像和文本,广泛应用于艺术创作、数据增强等领域。

深度学习框架如TensorFlow和PyTorch都提供了构建和训练这些复杂模型的工具。例如,TensorFlow的TF-Agents库提供了构建强化学习算法的框架,而PyTorch的torchvision库提供了多个GAN模型的预训练权重。

### 4.3.2 深度学习与边缘计算

边缘计算是将数据处理、分析和存储放在靠近数据生成地点的一种计算模式。这种模式在物联网(IoT)设备和移动设备上越来越受到关注。深度学习模型在边缘设备上运行可以降低延迟,提高数据处理效率。

TensorFlow Lite是一个为了移动和嵌入式设备优化的轻量级深度学习库。它可以帮助开发者在移动设备上部署训练好的模型,支持模型量化、硬件加速等优化技术。

在深度学习框架进阶应用的探讨中,本章节通过自定义操作与层、多框架对比分析以及对前沿技术的介绍,向读者展示了如何利用现有深度学习框架解决实际问题和如何把握行业发展的脉络。深度学习框架的发展与应用是AI领域不断进步的基石,掌握这些进阶应用技术对于推动AI技术的创新与应用具有重要的意义。

# 5. 深度学习框架的未来展望

随着人工智能技术的快速发展,深度学习框架作为AI研究与开发的核心工具,其未来发展趋势正吸引着整个行业的目光。这些框架正变得越来越模块化、服务化,同时智能化与自动化水平也在不断提升。以下我们将深入分析深度学习框架的发展趋势,并探讨这些趋势如何影响行业应用,并提供最佳实践与行业解决方案的构建。

## 5.1 深度学习框架的发展趋势

### 5.1.1 框架的模块化与服务化

模块化是深度学习框架发展的一个重要方向,它允许开发者构建和使用只包含所需组件的轻量级框架。这种设计不仅可以提高框架的灵活性和可定制性,还可以改善其性能和资源利用效率。

**代码示例:模块化框架使用**

```python

import tensorflow as tf

from tensorflow.keras.layers import Dense, Dropout

from tensorflow.keras.models import Sequential

# 构建一个简单的序列模型

model = Sequential([

Dense(128, activation='relu', input_shape=(input_shape,)),

Dropout(0.5),

Dense(num_classes, activation='softmax')

])

***pile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

```

在上述代码中,我们只导入了构建模型所需的`Sequential`、`Dense`和`Dropout`模块,并且通过组合这些模块构建了一个具有两个隐藏层和一个输出层的简单神经网络。

服务化则是将深度学习框架作为云服务或API进行提供,使开发者可以更方便地利用框架进行模型训练和部署,而无需关注底层资源管理和框架维护。

### 5.1.2 框架的智能化与自动化

为了降低深度学习技术的使用门槛,框架的智能化和自动化是未来的发展重点之一。智能化可能包括自动模型选择、超参数优化、以及自动特征工程等。自动化则涉及自动的数据管道构建、分布式训练支持、以及模型的自动部署。

**示例流程图:自动化机器学习流程(AutoML)**

```mermaid

graph LR

A[开始] --> B[数据探索与预处理]

B --> C[特征工程]

C --> D[模型选择]

D --> E[超参数调优]

E --> F[模型训练]

F --> G[模型评估]

G --> H[模型部署]

H --> I[监控与反馈]

I --> J[迭代优化]

J --> K[结束]

```

在上述流程中,从数据准备到模型部署的各个环节都可以通过自动化工具来完成,大大减少了深度学习工程师的工作负担。

## 5.2 框架创新对行业的影响

### 5.2.1 行业应用案例分析

框架的创新对行业的应用产生了深远的影响,使得很多传统行业能够快速采用AI技术进行业务优化和模式创新。例如,在医疗健康领域,深度学习框架已经被用于医学图像分析、疾病预测等场景,提高了诊断的准确性和效率。

### 5.2.2 框架创新如何推动AI产业变革

随着框架的模块化、服务化以及智能化,AI产业的变革趋势主要体现在技术门槛的降低、研发周期的缩短和创新能力的提升。这些变化有助于新兴企业的快速成长和整个行业的多元化发展。

## 5.3 框架的最佳实践与行业解决方案

### 5.3.1 成功案例的深度剖析

深度学习框架的创新带来了许多成功的案例,比如在金融服务领域,使用深度学习进行欺诈检测和风险评估。这些成功案例通常结合了框架的最佳实践和特定业务需求的解决方案。

### 5.3.2 行业解决方案的构建与实施

在构建行业解决方案时,深度学习框架需要结合具体业务场景进行定制化。例如,在自动驾驶行业,除了核心模型的开发,还需要将模型集成到车辆系统中,确保实时处理和决策的准确性。

**表格:行业解决方案构建要素**

| 要素 | 描述 | 重要性 |

|-------------|--------------------------------------------------------------------------------------|--------------|

| 数据处理 | 清洗、转换、标注数据以适应模型需求。 | 高 |

| 模型开发 | 根据业务需求,选择合适的模型架构和训练策略。 | 高 |

| 系统集成 | 将训练好的模型集成到业务系统中,确保稳定性和实时性。 | 高 |

| 持续优化 | 根据反馈对模型和系统进行持续的优化和迭代。 | 中 |

| 用户体验 | 考虑解决方案的易用性和用户接受度。 | 中 |

| 安全性与合规性 | 确保解决方案符合相关法律法规和安全标准。 | 高 |

通过以上的章节内容,我们不仅了解了深度学习框架的未来发展趋势,还探讨了这些趋势如何影响行业应用,并展示了构建行业解决方案的最佳实践。深度学习框架将继续成为推动人工智能产业创新和发展的重要动力。

0

0