数据归一化与交叉验证:确保模型稳定性的6个实用步骤

发布时间: 2024-11-19 23:07:26 阅读量: 30 订阅数: 32

# 1. 数据预处理的重要性

在机器学习和数据科学领域,数据预处理是不可或缺的一步。没有经过适当处理的数据可能导致训练出来的模型准确率低,泛化能力差。数据预处理包含了诸如数据清洗、特征选择、数据转换等多个步骤,而数据归一化则是这些步骤中尤为关键的一个环节。

预处理之所以重要,是因为数据在收集和存储过程中可能引入了噪声、缺失值、异常值和不一致的数据格式,这些都会影响到模型的训练效果。通过有效的数据预处理,可以提高数据的质量,使得模型能够从数据中学习到更加准确的规律,从而提升预测性能。

在本章中,我们将探讨数据预处理的重要性,并逐步深入到数据归一化的理论基础,以此来引导读者更好地理解和掌握如何在实际应用中提高数据质量,为建立准确的模型奠定坚实的基础。

# 2. 数据归一化的理论基础

## 2.1 归一化方法概述

### 2.1.1 归一化的定义和目的

数据归一化是机器学习和数据挖掘中经常使用的一种预处理手段。其定义是对原始数据进行一系列变换,使它们落入一个特定的范围,通常是在0到1之间,或者让数据拥有零均值和单位方差。归一化的目的是为了消除不同量纲带来的影响,使得不同特征的数据能够具有可比性,同时也是许多算法正常工作的前提条件,如基于距离的算法(KNN, SVM)和神经网络等。

### 2.1.2 常见归一化技术介绍

- 最小-最大归一化(Min-Max Normalization):这种方法通过对原始数据进行线性变换,将它们缩放到[0,1]区间。计算公式为:x' = (x - min(x)) / (max(x) - min(x)),其中x是原始数据,min(x)和max(x)分别是数据集中的最小值和最大值。

- Z得分标准化(Z-Score Normalization):这种方法将原始数据减去其均值,并除以标准差。公式为:x' = (x - μ) / σ,其中μ是数据集均值,σ是标准差。

- L1范数归一化和L2范数归一化:这两种方法将数据向量转换为单位向量(范数为1),在文本挖掘和图像处理中常用。

## 2.2 归一化在不同数据类型中的应用

### 2.2.1 数值型数据的归一化

数值型数据是最常见的数据类型,例如人的年龄、体温等。对于这些数据的归一化,经常使用的是最小-最大归一化和Z得分标准化。这类数据的特点是具有明显的量纲,因此归一化有助于消除不同量纲带来的影响。

```python

# 最小-最大归一化示例

import numpy as np

from sklearn.preprocessing import MinMaxScaler

# 原始数据

data = np.array([10, 20, 30, 40, 50])

scaler = MinMaxScaler()

data_normalized = scaler.fit_transform(data.reshape(-1, 1))

print(data_normalized)

```

### 2.2.2 分类数据的标签编码

对于分类数据,如性别(男/女)、国家(中国/美国)等,不能直接使用数值型数据的归一化方法。标签编码(Label Encoding)是处理这类数据的常用方法。标签编码将分类标签转换为数值,例如将性别转换为数字。

```python

# 标签编码示例

from sklearn.preprocessing import LabelEncoder

# 原始分类数据

categories = ['男', '女', '女', '男', '女']

le = LabelEncoder()

categories_encoded = le.fit_transform(categories)

print(categories_encoded)

```

### 2.2.3 高维数据的降维技术

在机器学习中,高维数据会带来维度的诅咒。降维技术如主成分分析(PCA)可以在保留尽可能多的特征信息的同时减少数据的维度。

```python

# 主成分分析示例

from sklearn.decomposition import PCA

# 高维数据

data_high_dim = np.array([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

pca = PCA(n_components=2) # 降至2维

data_reduced = pca.fit_transform(data_high_dim)

print(data_reduced)

```

## 2.3 归一化的实践技巧

### 2.3.1 选择合适的归一化策略

根据数据类型和模型特点选择合适的归一化策略至关重要。例如,对于基于距离的模型,最好使用最小-最大归一化或Z得分标准化;而对于分类模型,通常只需要进行标签编码。

### 2.3.2 避免归一化过程中的常见错误

在进行归一化时,常见的错误包括:

- 对验证集和测试集应用不同的归一化参数。

- 归一化后的数据未正确保存或应用,导致数据的归一化状态不一致。

- 对于已经归一化或标准化的数据再次进行归一化。

在应用归一化时,应当始终确保所有的数据集都使用相同的参数进行归一化,这通常意味着从训练集计算出的参数被应用到验证集和测试集上。

通过以上对数据归一化的全面介绍,我们可以看到归一化不仅是一种简单的技术操作,而且是一种在模型构建和评估中发挥关键作用的预处理手段。在后续章节中,我们将进一步讨论交叉验证的理论与实践,并将归一化与交叉验证结合起来分析它们在构建高性能机器学习模型中的应用。

# 3. 交叉验证的理论与实践

在数据科学中,模型评估是一个至关重要的步骤,它帮助我们验证模型的有效性,并提供对模型性能的深入了解。交叉验证是一种强大的评估技术,它通过减少模型评估中的偏差,提高模型泛化能力的可靠性估计。本章节深入探讨交叉验证的理论基础、实现方法和优化策略,同时配合实例分析,以便读者可以掌握交叉验证的综合应用。

## 3.1 交叉验证的基本原理

### 3.1.1 验证集与训练集的概念

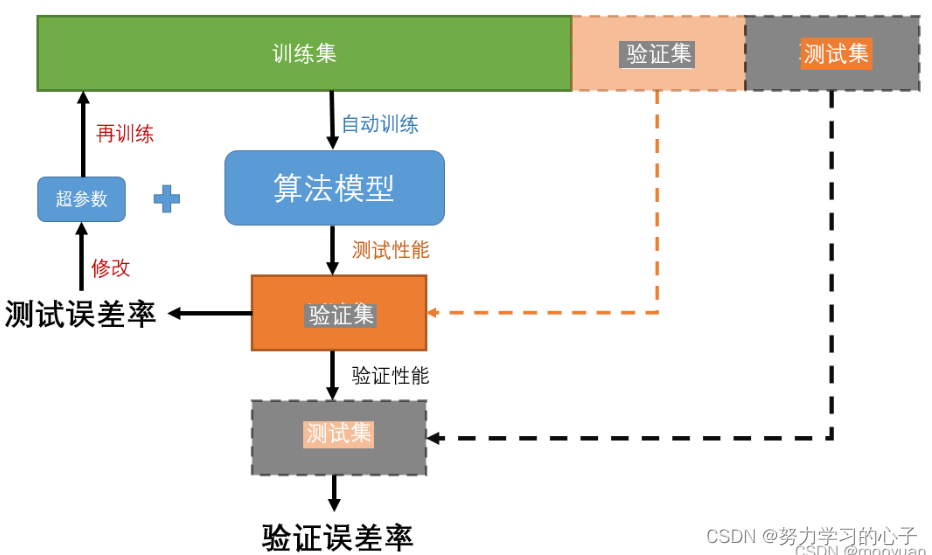

在机器学习模型开发过程中,数据集通常被划分为训练集和测试集。然而,仅使用测试集进行模型评估容易导致模型过拟合训练数据,无法真实反映模型在未知数据上的表现。因此,引入了验证集的概念,用于在模型训练过程中调整超参数和模型结构。验证集是从训练集中划分的一部分数据,用来模拟模型在未见过的数据上的表现。

### 3.1.2 交叉验证的主要类型

交叉验证是一种将数据集划分为多个小的训练/验证集组合的技术,能够更充分地利用有限的数据。主要有以下几种类型:

- **留一交叉验证**:使用一次数据点作为验证集,其余数据作为训练集,这种做法能够提供最接近真实性能的估计,但计算成本高。

- **K折交叉验证**:将原始数据集划分为K个大小相等的子集,一个子集保留作为验证集,其余K-1个子集用于训练。重复此过程K次,每次选择不同的验证集。K折交叉验证是平衡了计算复杂度和模型性能估计稳定性的选择。

## 3.2 交叉验证的实现方法

### 3.2.1 K折交叉验证的步骤

K折交叉验证的步骤如下:

1. **分割数据集**:将数据集分割为K个互不相交的子集。

2. **循环执行**:对于每一个子集:

- 将该子集设为验证集。

- 将剩余的子集合并为训练集。

- 在训练集上训练模型。

- 在验证集上评估模型性能。

3. **性能聚合**:计算K次评估的性能平均值。

### 3.2.2 留一交叉验证的优势

0

0