【Go并发缓存应用】:Fan-out_Fan-in模式在缓存系统中的最佳实践

发布时间: 2024-10-22 22:52:34 阅读量: 37 订阅数: 19

Go-将LMAXDisruptor移植到Go语言中

# 1. Go并发模型与缓存系统概述

在当今的软件开发领域,Go语言因其简洁的并发模型而广受欢迎。并发编程允许程序同时进行多个操作,这对于提高程序效率和响应速度至关重要。Go通过Goroutine和Channel提供了强大的并发支持。Goroutine作为一种轻量级线程,让并发操作变得经济而高效;而Channel则提供了Goroutine间安全通信的机制。与此同时,缓存系统在并发环境中发挥着至关重要的作用,它不仅能够加速数据访问,还能减少对底层数据存储的压力。缓存的加入对系统性能的提升非常明显,但同时也带来了数据一致性等挑战。在接下来的章节中,我们将深入探讨Go并发模型的具体实现,以及如何高效地在并发环境下应用缓存系统。

# 2. Fan-out_Fan-in模式理论基础

### 2.1 并发与并行的概念区分

#### 2.1.1 理解并发的定义及其重要性

并发(Concurrency)是指在一个时间段内,多个任务看起来好像都在同时进行。在单核处理器上,这通常是通过时间分片(time-slicing)实现的,即操作系统轮流给每个任务分配CPU时间。在多核处理器上,真正的并行(Parallelism)也是可能的,其中不同的任务可以同时在不同的CPU核心上运行。并发是设计高效程序的关键,特别是在处理网络通信、多用户交互或需要同时处理多个数据源的场景下。

并发之所以重要,是因为它可以使应用程序更好地利用硬件资源。例如,当一个程序等待磁盘I/O或网络请求时,它可以切换到另一个任务,从而避免CPU空闲。这种类型的“后台处理”可以显著提高应用程序的响应性和吞吐量。此外,在编写并发程序时,开发者往往会发现代码结构和设计模式上有更深的洞见,这有助于提高代码质量和可维护性。

```go

package main

import (

"fmt"

"time"

)

func main() {

fmt.Println("Start")

go func() { fmt.Println("Goroutine 1") }()

go func() { fmt.Println("Goroutine 2") }()

time.Sleep(1 * time.Second) // 模拟等待

fmt.Println("End")

}

```

上面的Go语言代码演示了并发的一个简单实例,其中`main`函数启动了两个goroutine(Go中的轻量级线程)去执行任务。`time.Sleep`用于让主goroutine等待足够的时间以确保其他goroutine有时间执行,否则程序会立即退出,导致其他goroutine没有机会运行。

#### 2.1.2 并行处理与并发处理的对比分析

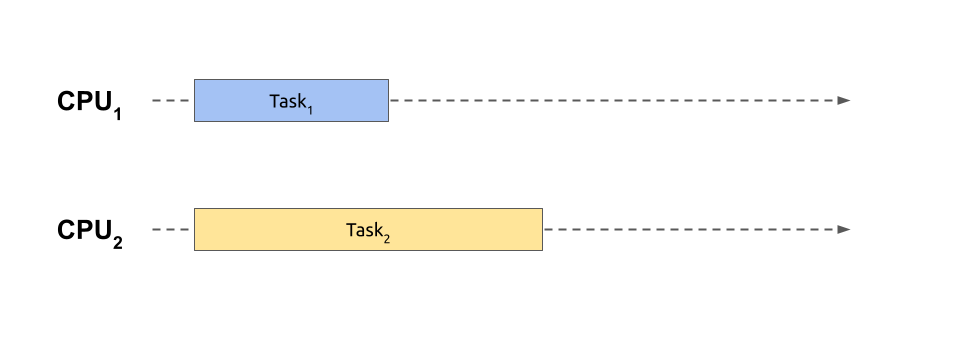

尽管并发和并行在日常对话中经常互换使用,但它们在计算机科学中有明确的区别。并行处理涉及在多个处理器或核心上同时执行多个任务。这意味着并行处理需要硬件支持,因为单核处理器无法真正并行执行任务。

并发处理则是一个更宽泛的概念,它可以包括并行处理,但也涵盖了使用单核处理器和多线程程序时的时间分片。并发程序设计允许程序在没有硬件并行支持的情况下也能同时处理多个任务。然而,并行是并发的一种形式,它利用了多核处理器的能力,能够提供真正的同时执行。

并发和并行的一个关键区别在于,当并发程序运行在单核处理器上时,其性能通常受限于时间分片的效率。而在多核处理器上,并行程序可以显著提高性能,特别是在计算密集型任务中。

```mermaid

graph LR

A[并发] --> B[单核处理器]

A --> C[多核处理器]

C --> D[并行]

B -->|时间分片| E[任务轮换]

C -->|多核心| F[任务同时执行]

```

上面的mermaid流程图简要地描述了并发和并行之间的关系,以及它们在单核和多核处理器上的表现形式。

### 2.2 Fan-out_Fan-in模式的定义与特点

#### 2.2.1 Fan-out_Fan-in模式的起源和原理

Fan-out_Fan-in模式源自信号传输领域,其中“fan-out”描述了一个信号源能够驱动多少个信号输入,“fan-in”描述了多个信号输入能够被合并到一个信号输出的设备中。在计算领域,特别是在并发编程中,Fan-out_Fan-in模式可以类比为将工作分配给多个工作单元(fan-out),然后在工作完成后将结果汇总(fan-in)。

在并发编程中,Fan-out涉及到启动多个并发任务,每个任务独立完成一部分工作。而Fan-in则涉及到收集这些任务的输出并将其合并为一个单一的结果。这个模式特别适合于需要处理大量数据,并且能够将数据切分成小块独立处理的场景。

```go

package main

import (

"fmt"

"sync"

)

func main() {

var wg sync.WaitGroup

ch := make(chan int, 10)

for i := 0; i < 5; i++ {

wg.Add(1)

go func(i int) {

defer wg.Done()

// Fan-out: 执行一些工作...

ch <- i * i // 将结果发送到通道

}(i)

}

go func() {

wg.Wait()

close(ch) // 确保所有结果都发送完毕后关闭通道

}()

// Fan-in: 等待所有goroutine完成,收集结果

for result := range ch {

fmt.Printf("Received: %d\n", result)

}

}

```

上面的Go语言代码展示了一个Fan-out_Fan-in模式的简单实现。使用了`sync.WaitGroup`来等待所有goroutine完成,以及一个通道`ch`来收集结果。

#### 2.2.2 Fan-out与Fan-in的策略和应用场景

Fan-out和Fan-in的策略取决于具体的应用需求。在Fan-out阶段,核心问题是任务分配。理想情况下,每个任务应该是独立的,并且能够同时执行。这涉及到任务的粒度和如何有效地分配任务。在Fan-in阶段,核心问题是结果的合并。合并策略取决于结果的性质,可能包括简单的收集、累加、或者更复杂的合并逻辑,比如在排序或搜索算法中。

Fan-out_Fan-in模式特别适用于以下应用场景:

- 大数据处理:可以将数据集分片处理,然后合并结果。

- Web爬虫:并发地下载网页,然后在所有网页下载完成后进行数据提取。

- 分布式计算:在多个节点上并行地执行计算任务,最后汇总结果。

在实现Fan-out_Fan-in模式时,开发者应该考虑以下几个因素:

- 负载均衡:确保所有工作单元的工作量相对均衡,避免某些单元过载而其他单元空闲。

- 错误处理:在并行任务中,需要有机制来处理和记录错误,确保不会因为个别任务失败而影响整体结果。

- 资源管理:合理管理内存和CPU资源,避免资源浪费或因资源竞争导致的性能问题。

### 2.3 缓存系统的角色与优势

#### 2.3.1 缓存系统在并发环境中的作用

缓存系统是一种优化技术,它存储了频繁访问的数据,以减少数据访问时间和提高系统性能。在并发环境下,缓存系统能够显著减少对持久化存储(如数据库或文件系统)的访问次数,从而提高并发任务的执行速度。

缓存系统的主要作用包括:

- 减少延迟:缓存通常提供比原始数据源更低的访问延迟,因为它存储在更快的内存中。

- 增加吞吐量:当多个并发任务需要相同的数据时,缓存能够提供即时的响应,从而提高整体吞吐量。

- 减轻数据库压力:通过缓存频繁查询的数据,可以减少数据库的读取次数,避免数据库成为系统的瓶颈。

```go

// 示例代码展示了在Go中如何使用缓存

package main

import (

"fmt"

"sync"

"time"

)

var cache map[string]string

var mutex sync.Mutex

func init() {

cache = make(map[string]string)

}

func getFromCache(key string) (string, bool) {

mutex.Lock()

defer mutex.Unlock()

val, found := cache[key]

return val, found

}

func addToCache(key, value string) {

mutex.Lock()

cache[key] = value

mutex.Unlock()

}

func main() {

key :=

```

0

0